Empowering Multimodal LLMs with External Tools: A Comprehensive Survey

作者: Wenbin An, Jiahao Nie, Yaqiang Wu, Feng Tian, Shijian Lu, Qinghua Zheng

分类: cs.CV, cs.CL, cs.MM

发布日期: 2025-08-14

备注: 21 pages, 361 references

🔗 代码/项目: GITHUB

💡 一句话要点

综述:利用外部工具增强多模态大语言模型能力,提升性能、评估和数据质量

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态大语言模型 外部工具 模型增强 知识库 API 模型评估 多模态数据

📋 核心要点

- 现有MLLM在多模态数据质量、复杂任务性能和评估方面存在不足,限制了其可靠性和应用范围。

- 该研究综述了利用外部工具增强MLLM性能的方法,借鉴人类使用工具增强推理和解决问题的能力。

- 论文从数据、性能、评估和未来方向四个维度,探讨了外部工具在MLLM中的应用和潜力。

📝 摘要(中文)

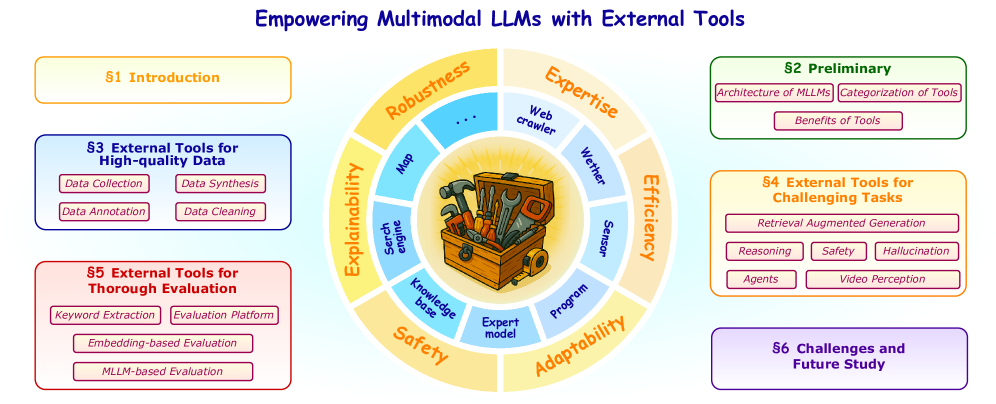

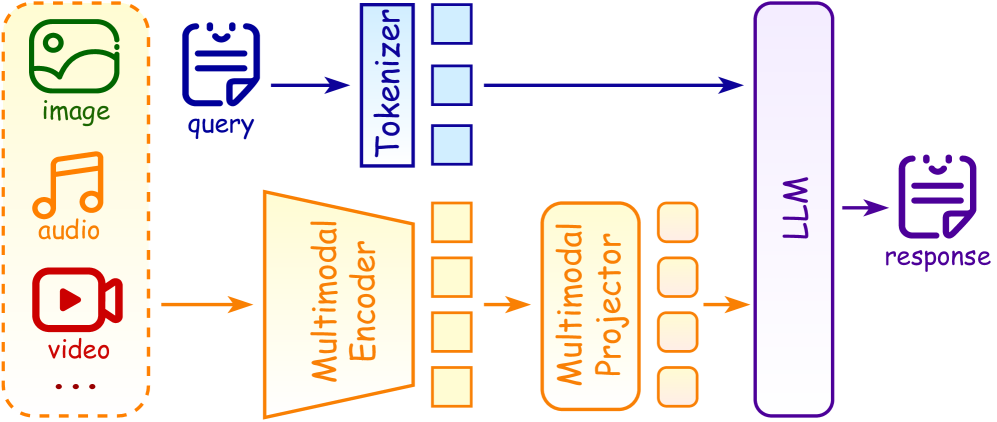

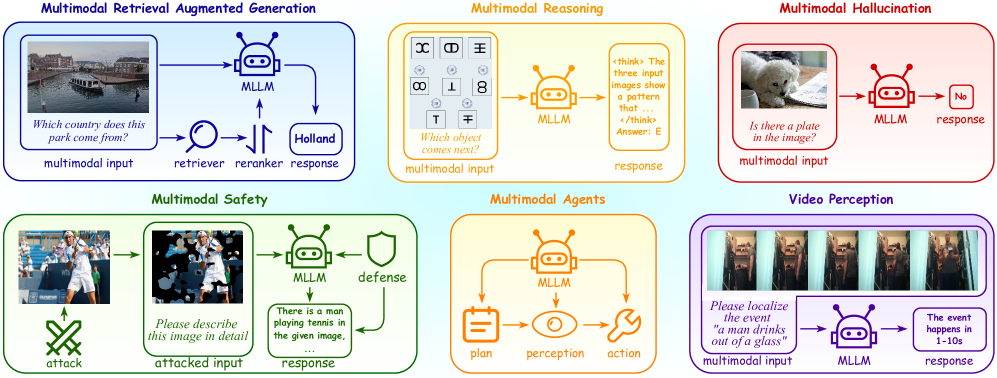

多模态大语言模型(MLLMs),如GPT-4V,通过整合多模态编码器的感知能力和大型语言模型的生成能力,在各种多模态任务中取得了巨大成功,为实现通用人工智能提供了一条有希望的途径。尽管取得了这些进展,但多模态数据质量有限、在许多复杂下游任务上的表现不佳以及不充分的评估协议,继续阻碍着MLLM在不同领域的可靠性和更广泛的适用性。受人类利用外部工具来增强推理和解决问题能力的启发,利用外部工具(例如,API、专家模型和知识库)增强MLLM提供了一种有希望的策略来克服这些挑战。在本文中,我们对利用外部工具来增强MLLM性能进行了全面的综述。我们的讨论围绕外部工具的四个关键维度展开:(1)它们如何促进高质量多模态数据的获取和标注;(2)它们如何帮助提高MLLM在具有挑战性的下游任务中的性能;(3)它们如何实现对MLLM的全面和准确评估;(4)工具增强型MLLM的当前局限性和未来方向。通过本次调查,我们旨在强调外部工具在提升MLLM能力方面的变革潜力,为它们的发展和应用提供前瞻性的视角。

🔬 方法详解

问题定义:现有MLLM在处理复杂多模态任务时,面临数据质量不高、下游任务性能不足以及缺乏全面准确的评估标准等问题。这些问题限制了MLLM的可靠性和泛化能力,阻碍了其在更广泛领域的应用。现有方法难以有效利用外部知识和工具来提升模型能力。

核心思路:论文的核心思路是借鉴人类利用外部工具增强自身能力的模式,将外部工具(如API、专家模型、知识库等)集成到MLLM中,从而提升模型在数据获取、任务执行和评估方面的能力。通过引入外部工具,MLLM可以更好地利用外部知识,提高解决复杂问题的能力。

技术框架:该综述论文并未提出具体的模型框架,而是对现有利用外部工具增强MLLM的方法进行了分类和总结。整体框架可以理解为:首先,确定MLLM需要增强的方面(数据、性能、评估);然后,选择合适的外部工具并将其集成到MLLM中;最后,通过实验验证工具增强的效果。不同的工具和任务可能需要不同的集成方式和模型结构。

关键创新:该论文的关键创新在于系统性地总结和分析了利用外部工具增强MLLM的研究进展,并提出了未来研究方向。它强调了外部工具在提升MLLM能力方面的重要作用,并为研究人员提供了一个全面的参考框架。与现有方法相比,该综述更注重对现有方法的归纳和分析,而非提出全新的技术方案。

关键设计:由于是综述论文,因此没有具体的参数设置、损失函数或网络结构等技术细节。论文主要关注不同外部工具的类型、应用场景和集成方式。例如,如何利用API获取高质量的多模态数据,如何利用专家模型提升MLLM在特定任务上的性能,以及如何利用知识库进行更准确的评估。

🖼️ 关键图片

📊 实验亮点

该综述总结了外部工具在提升MLLM性能方面的多种应用,包括利用工具进行数据增强、提升下游任务性能和实现更全面的模型评估。虽然没有提供具体的性能数据,但该综述强调了外部工具在克服MLLM局限性方面的潜力,并为未来的研究方向提供了有价值的见解。

🎯 应用场景

该研究对多模态大语言模型在智能客服、自动驾驶、医疗诊断、教育等领域具有潜在应用价值。通过外部工具的赋能,MLLM能够更好地理解和处理复杂的多模态信息,从而为各行业提供更智能、更高效的解决方案,并推动人工智能技术的进步。

📄 摘要(原文)

By integrating the perception capabilities of multimodal encoders with the generative power of Large Language Models (LLMs), Multimodal Large Language Models (MLLMs), exemplified by GPT-4V, have achieved great success in various multimodal tasks, pointing toward a promising pathway to artificial general intelligence. Despite this progress, the limited quality of multimodal data, poor performance on many complex downstream tasks, and inadequate evaluation protocols continue to hinder the reliability and broader applicability of MLLMs across diverse domains. Inspired by the human ability to leverage external tools for enhanced reasoning and problem-solving, augmenting MLLMs with external tools (e.g., APIs, expert models, and knowledge bases) offers a promising strategy to overcome these challenges. In this paper, we present a comprehensive survey on leveraging external tools to enhance MLLM performance. Our discussion is structured along four key dimensions about external tools: (1) how they can facilitate the acquisition and annotation of high-quality multimodal data; (2) how they can assist in improving MLLM performance on challenging downstream tasks; (3) how they enable comprehensive and accurate evaluation of MLLMs; (4) the current limitations and future directions of tool-augmented MLLMs. Through this survey, we aim to underscore the transformative potential of external tools in advancing MLLM capabilities, offering a forward-looking perspective on their development and applications. The project page of this paper is publicly available athttps://github.com/Lackel/Awesome-Tools-for-MLLMs.