Cooperative Face Liveness Detection from Optical Flow

作者: Artem Sokolov, Mikhail Nikitin, Anton Konushin

分类: cs.CV

发布日期: 2025-08-14

💡 一句话要点

提出基于光流的协同式人脸活体检测方法,提升安全性。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 人脸活体检测 光流分析 协同交互 呈现攻击防御 时空特征学习

📋 核心要点

- 现有被动式人脸活体检测方法易受各种呈现攻击的欺骗,安全性存在不足。

- 论文提出一种协同式方法,引导用户执行特定面部移动,结合光流分析提取面部体积信息。

- 该方法通过神经分类器处理光流和RGB帧,有效利用时空特征,提升活体检测的可靠性。

📝 摘要(中文)

本文提出了一种新颖的基于视频的协同式人脸活体检测方法。该方法基于一种新的用户交互场景,要求参与者缓慢地将其正面朝向的脸部靠近摄像头。这种受控的脸部靠近协议,结合光流分析,构成了我们方法的核心创新。通过设计一个用户遵循特定移动模式的系统,我们能够通过神经光流估计稳健地提取面部体积信息,从而显著提高真脸与各种呈现攻击(包括打印照片、屏幕显示、面具和视频重放)之间的区分度。我们的方法通过神经分类器处理预测的光流和RGB帧,有效地利用时空特征,与被动方法相比,实现了更可靠的活体检测。

🔬 方法详解

问题定义:现有的人脸活体检测方法,尤其是被动式方法,容易受到各种呈现攻击的欺骗,例如打印照片、屏幕重放、面具等。这些攻击手段不断演进,对现有系统的安全性提出了严峻挑战。因此,需要更鲁棒、更可靠的活体检测方法来区分真实人脸和伪造人脸。

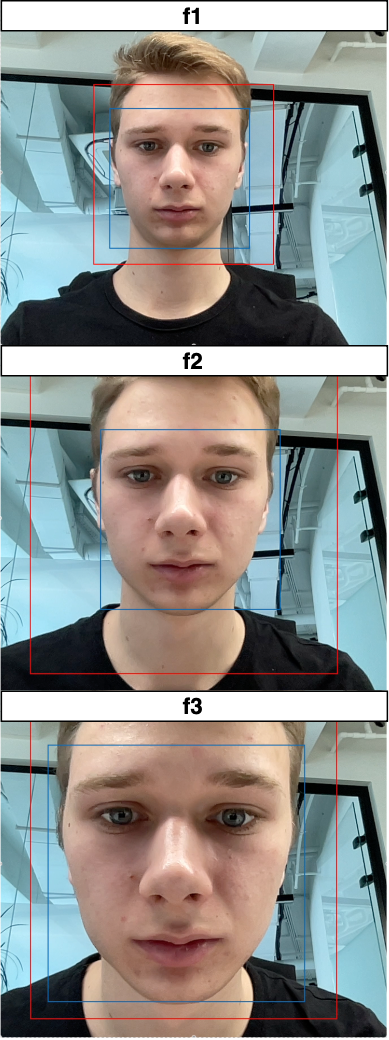

核心思路:论文的核心思路是引入一种协同式的用户交互模式,即要求用户按照特定的方式(缓慢地将脸部靠近摄像头)移动。这种受控的运动模式能够提供额外的时空信息,使得系统能够更容易地提取面部体积信息,从而区分真实人脸和呈现攻击。结合光流分析,可以更精确地捕捉面部运动的细微变化。

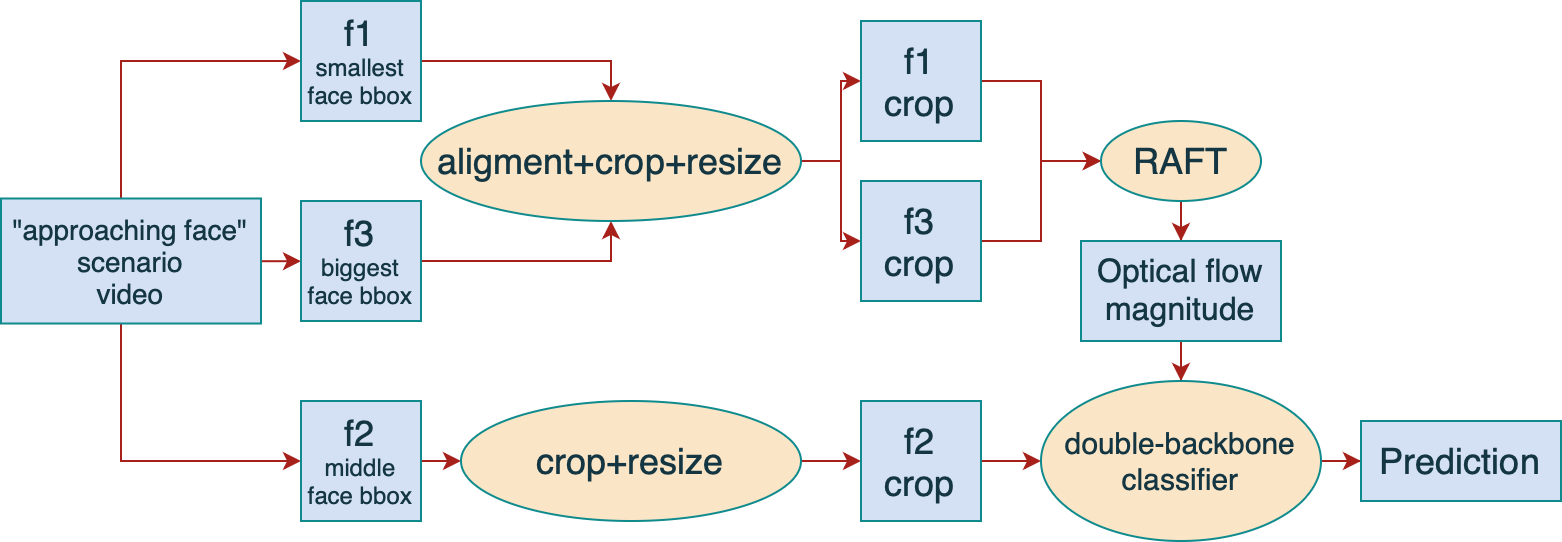

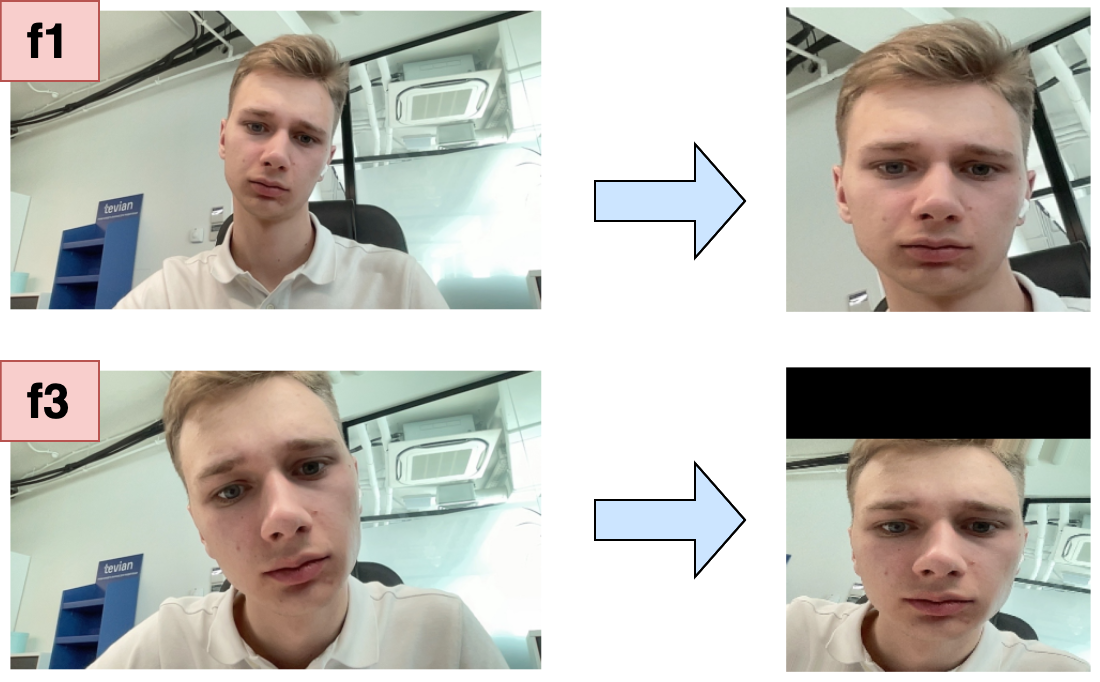

技术框架:该方法的技术框架主要包括以下几个阶段:1) 用户按照指示执行面部靠近摄像头的动作;2) 使用光流估计算法(具体算法未知)从视频帧中提取光流信息;3) 将光流信息和RGB帧输入到神经分类器中;4) 神经分类器对光流和RGB帧进行处理,提取时空特征;5) 神经分类器输出活体检测结果,判断输入是否为真实人脸。

关键创新:该方法最重要的技术创新点在于引入了协同式的用户交互模式,并将其与光流分析相结合。这种协同式的方法能够提供更丰富的时空信息,使得系统能够更准确地提取面部体积信息,从而提高活体检测的鲁棒性。与传统的被动式方法相比,该方法能够更好地抵抗各种呈现攻击。

关键设计:论文中没有详细说明神经分类器的具体网络结构、损失函数和参数设置。光流估计算法的选择也未知。这些细节可能在后续的论文或实验报告中给出。关键在于用户交互协议的设计,即如何引导用户进行面部靠近动作,以及如何利用光流信息和RGB帧进行特征提取和分类。

🖼️ 关键图片

📊 实验亮点

论文的主要亮点在于提出了一种新颖的协同式人脸活体检测方法,该方法通过引导用户执行特定的面部移动,并结合光流分析,能够有效地提取面部体积信息,从而提高活体检测的准确性和鲁棒性。具体的性能数据和对比基线未知,但论文声称该方法能够显著提高真脸与各种呈现攻击之间的区分度。

🎯 应用场景

该研究成果可广泛应用于需要高安全级别的人脸识别场景,例如移动支付、门禁系统、身份验证等。通过提高人脸活体检测的准确性和鲁棒性,可以有效防止欺诈行为,保护用户的信息安全和财产安全。未来,该方法可以进一步扩展到其他生物特征识别领域,例如虹膜识别、指纹识别等。

📄 摘要(原文)

In this work, we proposed a novel cooperative video-based face liveness detection method based on a new user interaction scenario where participants are instructed to slowly move their frontal-oriented face closer to the camera. This controlled approaching face protocol, combined with optical flow analysis, represents the core innovation of our approach. By designing a system where users follow this specific movement pattern, we enable robust extraction of facial volume information through neural optical flow estimation, significantly improving discrimination between genuine faces and various presentation attacks (including printed photos, screen displays, masks, and video replays). Our method processes both the predicted optical flows and RGB frames through a neural classifier, effectively leveraging spatial-temporal features for more reliable liveness detection compared to passive methods.