Lameness detection in dairy cows using pose estimation and bidirectional LSTMs

作者: Helena Russello, Rik van der Tol, Eldert J. van Henten, Gert Kootstra

分类: cs.CV

发布日期: 2025-08-14

💡 一句话要点

提出基于姿态估计和双向LSTM的奶牛跛足检测方法

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 奶牛跛足检测 姿态估计 双向LSTM 时间序列分析 智慧畜牧业

📋 核心要点

- 现有跛足检测方法依赖人工设计的运动特征,泛化能力和准确率受限。

- 利用T-LEAP进行无标记姿态估计,结合BLSTM自动学习时序运动特征,无需人工干预。

- 实验表明,该方法在小数据集上表现出色,仅需1秒视频即可达到85%的准确率,优于传统方法。

📝 摘要(中文)

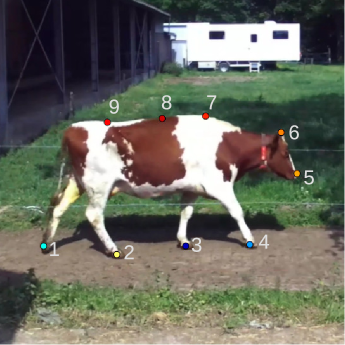

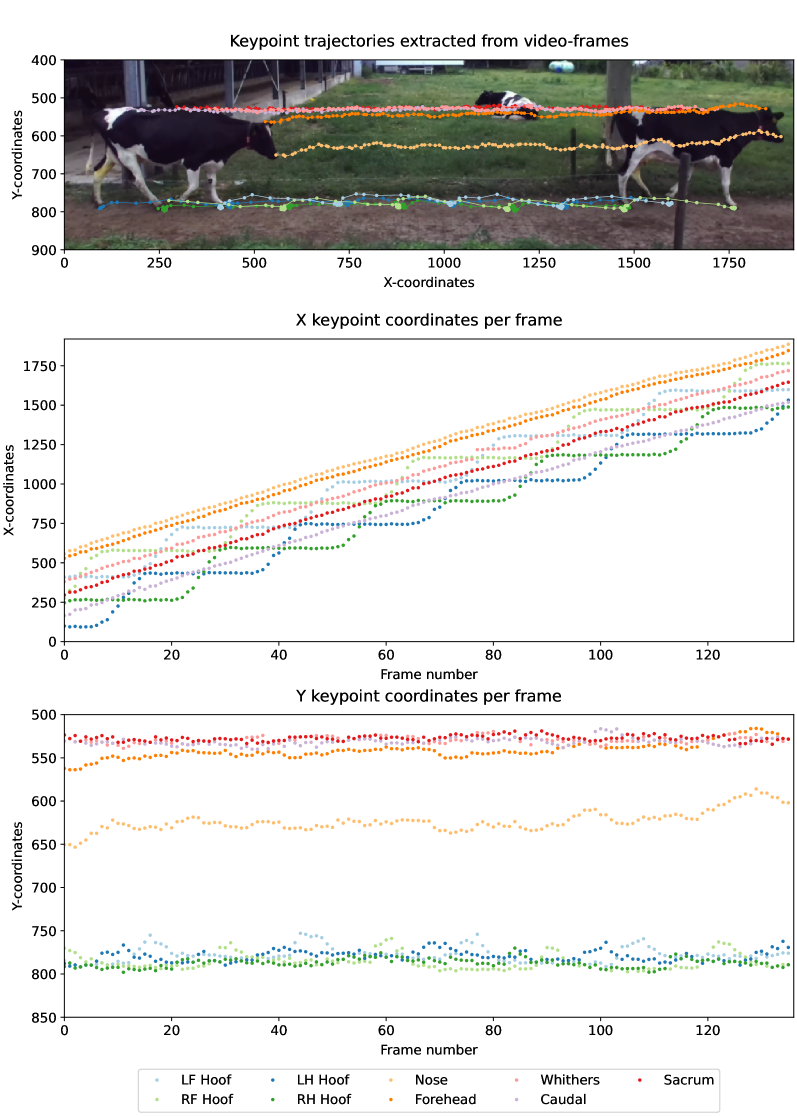

本研究提出了一种结合姿态估计和双向长短期记忆(BLSTM)神经网络的奶牛跛足检测方法。结合姿态估计和BLSTM分类器具有以下优势:无需标记的姿态估计,通过从关键点轨迹中学习时间运动特征来消除手动特征工程,以及处理短序列和小训练数据集。从行走奶牛的视频中,使用T-LEAP姿态估计模型提取了九个关键点(位于奶牛的蹄、头部和背部)的运动序列。然后,将关键点的轨迹作为BLSTM分类器的输入,该分类器经过训练以执行二元跛足分类。我们的方法显著优于一种依赖于手动设计的运动特征的既定方法:我们最好的架构实现了85%的分类准确率,而基于特征的方法的准确率为80%。此外,我们证明了我们的BLSTM分类器可以使用短短一秒钟的视频数据检测跛足。

🔬 方法详解

问题定义:本论文旨在解决奶牛跛足的自动检测问题。传统方法依赖于人工设计的运动特征,这些特征的提取过程繁琐,且泛化能力较弱。此外,这些方法通常需要较长的视频序列才能做出准确判断,限制了其在实际应用中的效率。

核心思路:论文的核心思路是利用深度学习方法自动学习奶牛的运动特征,从而避免人工特征工程的局限性。具体而言,通过姿态估计模型提取奶牛关键点的时序轨迹,然后利用双向LSTM网络对这些轨迹进行分析,从而判断奶牛是否跛足。这种方法能够捕捉到奶牛运动中的细微变化,提高跛足检测的准确率和效率。

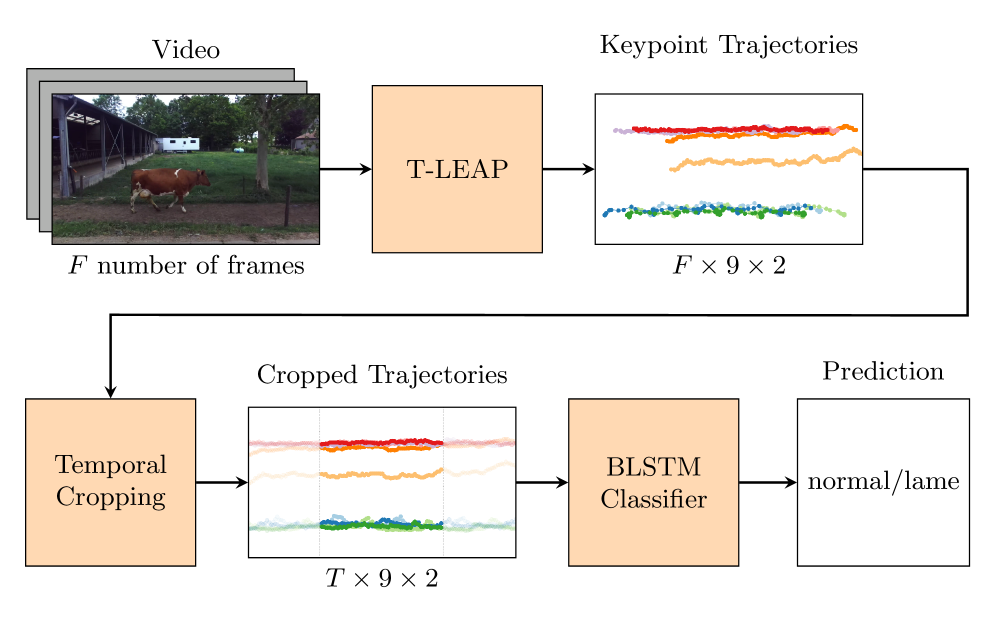

技术框架:整体框架包括两个主要阶段:1) 姿态估计阶段:使用T-LEAP姿态估计模型从视频中提取奶牛的关键点坐标,包括蹄、头部和背部等九个关键点。2) 跛足分类阶段:将关键点的时序轨迹作为BLSTM网络的输入,BLSTM网络学习这些轨迹中的时间依赖关系,并输出奶牛是否跛足的二元分类结果。

关键创新:该方法最重要的创新点在于将姿态估计和BLSTM网络相结合,实现了端到端的跛足检测。与传统方法相比,该方法无需人工设计特征,能够自动学习运动特征,并且能够处理短视频序列。此外,使用BLSTM能够同时考虑过去和未来的信息,从而更准确地捕捉到奶牛的运动特征。

关键设计:T-LEAP模型用于姿态估计,输出9个关键点的坐标。BLSTM网络结构未知,但其输入为关键点坐标的时间序列。损失函数为二元交叉熵损失,用于训练BLSTM网络进行二元分类(跛足/非跛足)。论文强调了使用短序列(1秒)也能取得良好效果。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在跛足检测任务中取得了显著的性能提升。最佳模型达到了85%的分类准确率,优于传统的手工特征方法(80%)。更重要的是,该方法仅需1秒的视频数据即可实现准确的跛足检测,大大提高了检测效率。

🎯 应用场景

该研究成果可应用于智慧畜牧业,实现奶牛跛足的早期自动检测,减少人工干预,降低养殖成本,提高奶牛福利和牛奶产量。该技术还可扩展到其他动物的健康监测,具有广阔的应用前景。

📄 摘要(原文)

This study presents a lameness detection approach that combines pose estimation and Bidirectional Long-Short-Term Memory (BLSTM) neural networks. Combining pose-estimation and BLSTMs classifier offers the following advantages: markerless pose-estimation, elimination of manual feature engineering by learning temporal motion features from the keypoint trajectories, and working with short sequences and small training datasets. Motion sequences of nine keypoints (located on the cows' hooves, head and back) were extracted from videos of walking cows with the T-LEAP pose estimation model. The trajectories of the keypoints were then used as an input to a BLSTM classifier that was trained to perform binary lameness classification. Our method significantly outperformed an established method that relied on manually-designed locomotion features: our best architecture achieved a classification accuracy of 85%, against 80% accuracy for the feature-based approach. Furthermore, we showed that our BLSTM classifier could detect lameness with as little as one second of video data.