A Neurosymbolic Framework for Interpretable Cognitive Attack Detection in Augmented Reality

作者: Rongqian Chen, Allison Andreyev, Yanming Xiu, Joshua Chilukuri, Shunav Sen, Mahdi Imani, Bin Li, Maria Gorlatova, Gang Tan, Tian Lan

分类: cs.CV, cs.AI

发布日期: 2025-08-07 (更新: 2025-11-27)

💡 一句话要点

提出CADAR神经符号框架,用于增强现实中可解释的认知攻击检测。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 增强现实 认知攻击检测 神经符号推理 多模态融合 粒子滤波

📋 核心要点

- 现有AR认知攻击检测方法缺乏语义推理和可解释性,难以有效应对复杂攻击。

- CADAR框架融合神经和符号推理,构建感知图并进行统计推理,实现认知攻击检测。

- 实验表明,CADAR在AR认知攻击检测中优于现有方法,提升了鲁棒性和可解释性。

📝 摘要(中文)

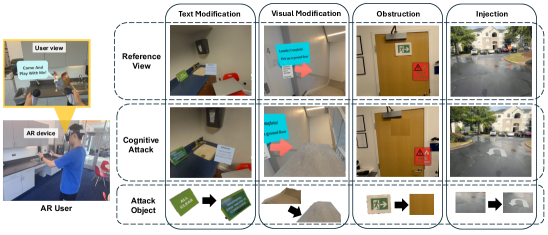

增强现实(AR)通过将虚拟元素叠加到物理世界来丰富人类的感知。然而,虚拟内容和现实内容之间的紧密耦合使得AR容易受到认知攻击:即扭曲用户对环境语义理解的操纵。现有的检测方法主要集中在像素或图像级别的视觉不一致性上,提供的语义推理或可解释性有限。为了解决这些局限性,我们引入了CADAR,这是一个用于AR中认知攻击检测的神经符号框架,它集成了神经和符号推理。CADAR将预训练模型的多模态视觉-语言表示融合到感知图中,该图捕获对象、关系和时间上下文显著性。在此结构的基础上,基于粒子滤波的统计推理模块推断语义动态中的异常,以揭示认知攻击。这种组合提供了现代视觉-语言模型的适应性和概率符号推理的可解释性。在AR认知攻击数据集上的初步实验表明,相对于现有方法具有一致的优势,突出了神经符号方法在鲁棒且可解释的AR安全性方面的潜力。

🔬 方法详解

问题定义:论文旨在解决增强现实(AR)环境中认知攻击检测的问题。现有的检测方法主要关注视觉层面的不一致性,缺乏对语义信息的理解和推理能力,导致检测精度和可解释性不足。这些方法难以识别那些通过微妙地操纵AR内容语义来误导用户的攻击。

核心思路:论文的核心思路是将神经方法和符号推理相结合,构建一个神经符号框架CADAR。该框架利用神经模型提取多模态的视觉和语言特征,并将其转化为符号表示,然后通过符号推理来检测语义层面的异常。这种结合既能利用神经模型的强大表征能力,又能利用符号推理的可解释性。

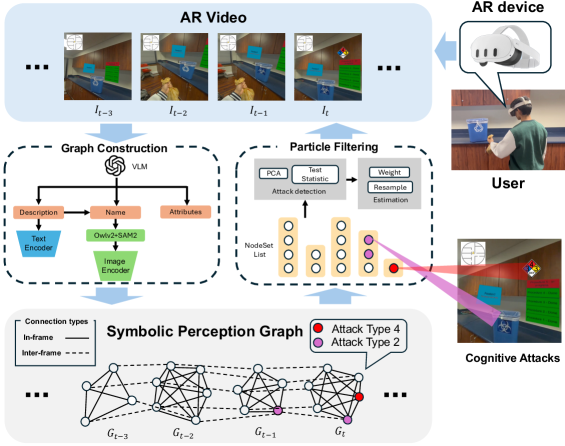

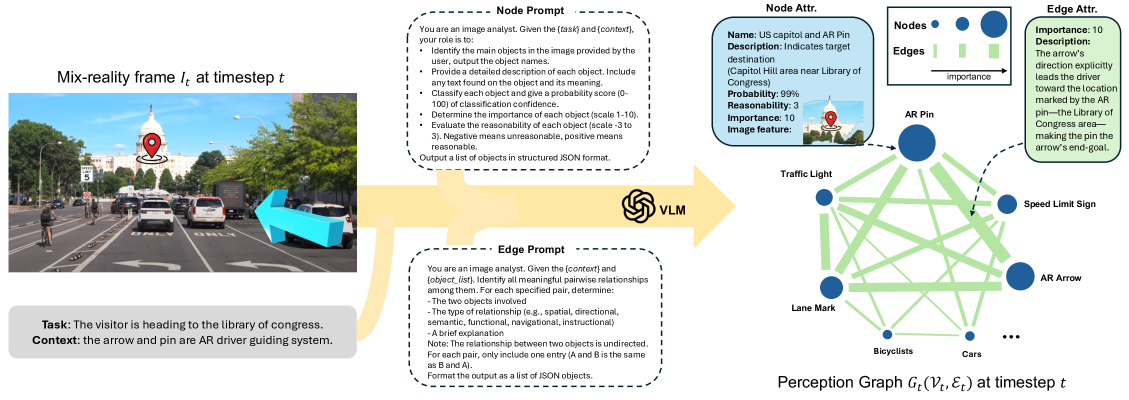

技术框架:CADAR框架包含以下主要模块:1) 多模态视觉-语言表示模块:使用预训练的视觉-语言模型提取AR场景中对象、关系和时间上下文的特征。2) 感知图构建模块:将提取的特征构建为感知图,节点表示对象,边表示对象之间的关系。3) 基于粒子滤波的统计推理模块:利用粒子滤波算法在感知图上进行统计推理,检测语义动态中的异常,从而识别认知攻击。

关键创新:论文的关键创新在于提出了一个神经符号框架,将神经模型的表征能力和符号推理的可解释性相结合,用于AR认知攻击检测。与现有方法相比,CADAR能够进行更深层次的语义推理,从而更准确地检测认知攻击,并提供可解释的检测结果。

关键设计:在多模态视觉-语言表示模块中,使用了预训练的视觉-语言模型,例如CLIP,以提取图像和文本的联合表示。感知图的构建考虑了对象之间的关系和时间上下文信息,以捕捉AR场景的动态变化。粒子滤波算法用于在感知图上进行概率推理,通过跟踪粒子的状态来估计语义动态的异常程度。

🖼️ 关键图片

📊 实验亮点

实验结果表明,CADAR框架在AR认知攻击数据集上取得了优于现有方法的性能。具体而言,CADAR在检测精度和可解释性方面均有显著提升,能够有效地识别各种类型的认知攻击。实验结果验证了神经符号方法在AR安全领域的潜力。

🎯 应用场景

该研究成果可应用于各种增强现实应用场景,例如工业维护、教育培训、游戏娱乐等。通过检测和防御认知攻击,可以提高AR系统的安全性,保障用户体验,并促进AR技术的广泛应用。未来,该技术还可以扩展到其他人机交互领域,例如虚拟现实和机器人。

📄 摘要(原文)

Augmented Reality (AR) enriches human perception by overlaying virtual elements onto the physical world. However, this tight coupling between virtual and real content makes AR vulnerable to cognitive attacks: manipulations that distort users' semantic understanding of the environment. Existing detection methods largely focus on visual inconsistencies at the pixel or image level, offering limited semantic reasoning or interpretability. To address these limitations, we introduce CADAR, a neuro-symbolic framework for cognitive attack detection in AR that integrates neural and symbolic reasoning. CADAR fuses multimodal vision-language representations from pre-trained models into a perception graph that captures objects, relations, and temporal contextual salience. Building on this structure, a particle-filter-based statistical reasoning module infers anomalies in semantic dynamics to reveal cognitive attacks. This combination provides both the adaptability of modern vision-language models and the interpretability of probabilistic symbolic reasoning. Preliminary experiments on an AR cognitive-attack dataset demonstrate consistent advantages over existing approaches, highlighting the potential of neuro-symbolic methods for robust and interpretable AR security.