MedPatch: Confidence-Guided Multi-Stage Fusion for Multimodal Clinical Data

作者: Baraa Al Jorf, Farah Shamout

分类: eess.IV, cs.CV

发布日期: 2025-08-07

💡 一句话要点

MedPatch:一种置信度引导的多阶段融合方法,用于多模态临床数据分析

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态融合 临床预测 置信度引导 多阶段融合 医学图像 自然语言处理 缺失数据处理

📋 核心要点

- 临床数据异构、稀疏且模态缺失,限制了现有模型在临床预测任务中的性能。

- MedPatch通过置信度引导的多阶段融合,无缝整合多模态数据,模拟临床决策流程。

- 在院内死亡率预测和临床状况分类任务中,MedPatch优于现有基线,达到SOTA水平。

📝 摘要(中文)

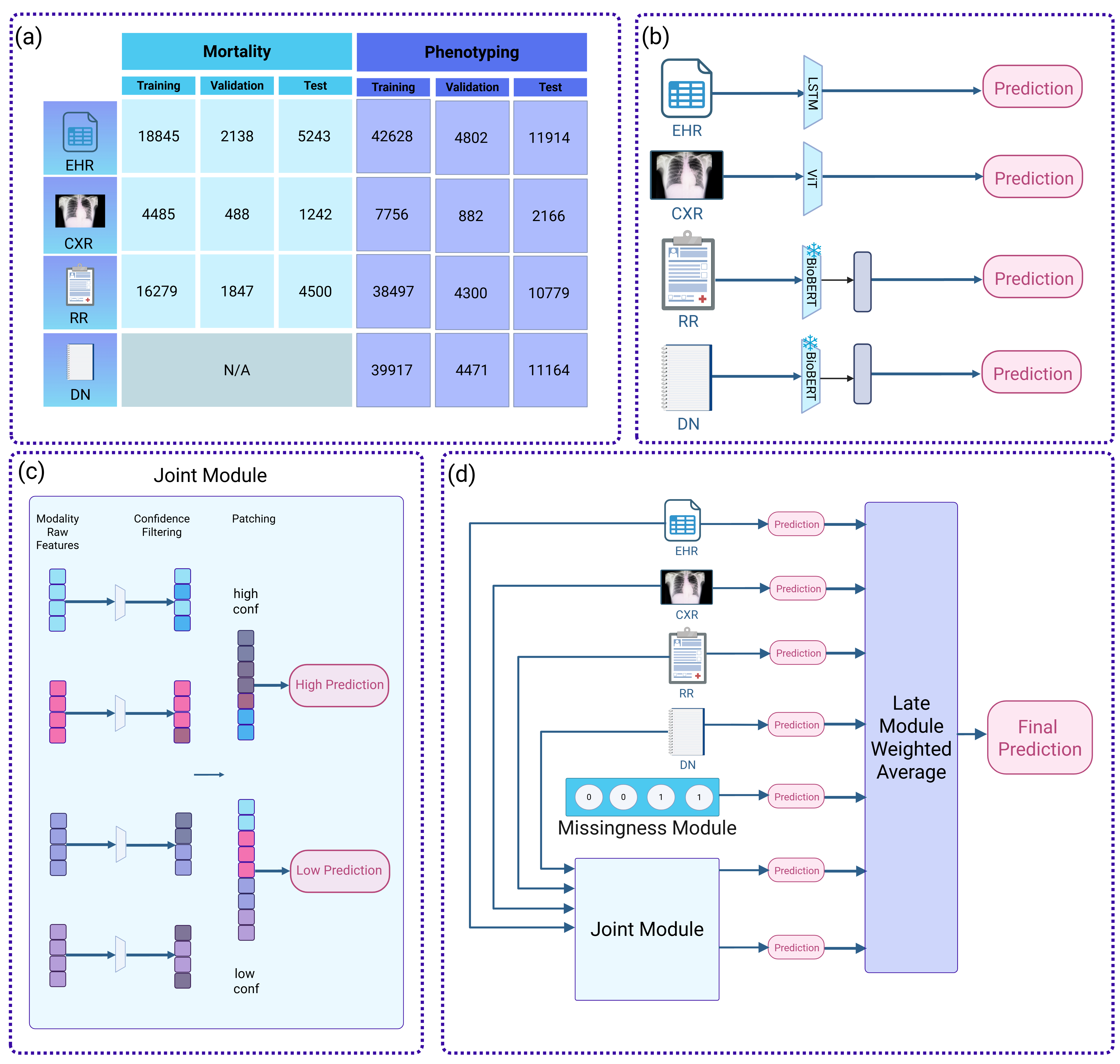

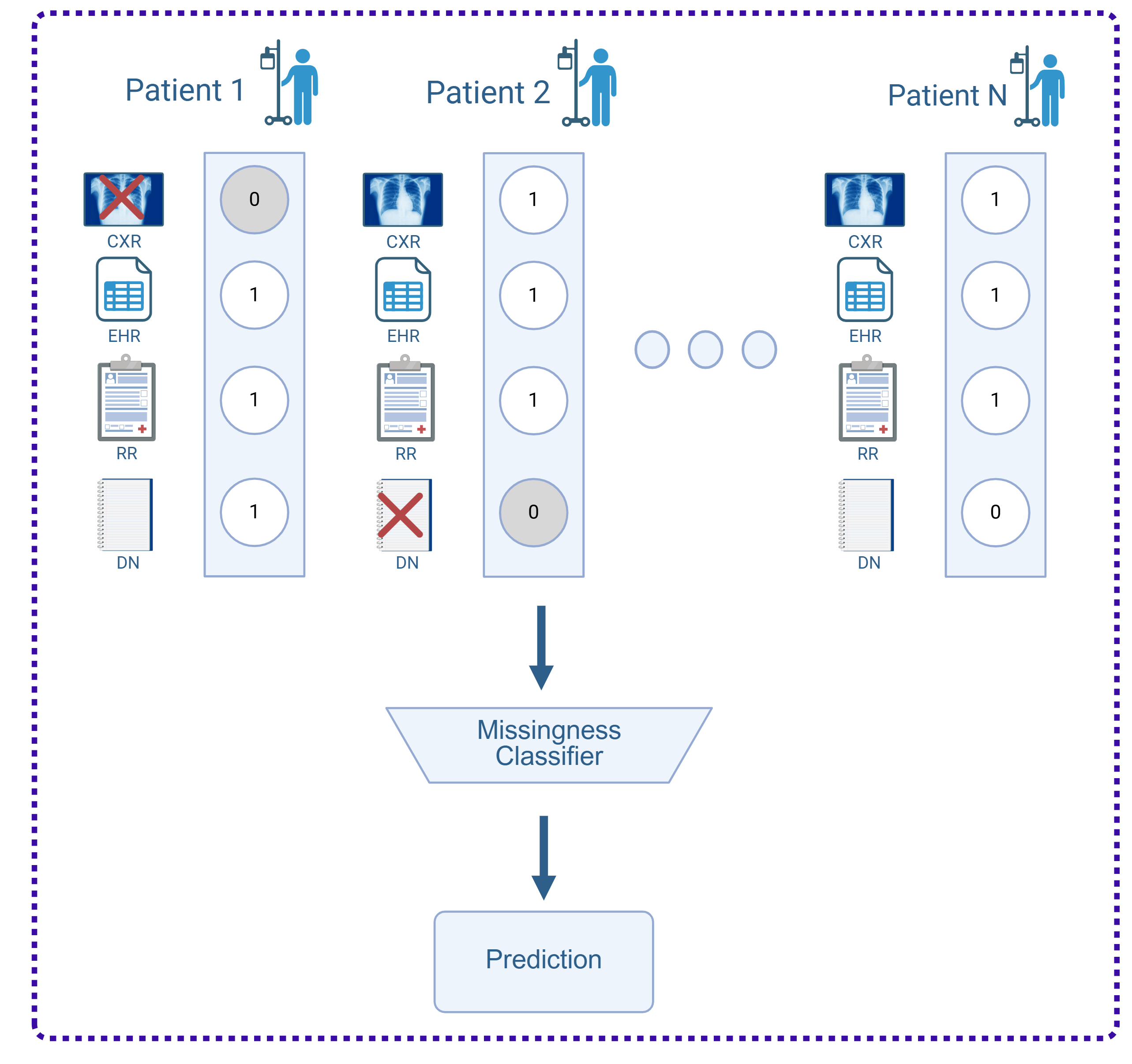

临床决策依赖于整合来自不同数据模态的信息,例如临床时间序列、医学图像和文本报告。与其它领域相比,真实的医疗数据本质上是异构的,规模有限,并且由于模态缺失而稀疏。这显著限制了模型在临床预测任务中的性能。受到临床工作流程的启发,我们提出了MedPatch,一种多阶段多模态融合架构,它通过置信度引导的patching无缝地整合多个模态。MedPatch包含三个主要组成部分:(i)利用联合融合和后期融合的多阶段融合策略,(ii)处理具有缺失模态的稀疏样本的缺失感知模块,(iii)基于校准的单模态token级别置信度来聚类潜在token patch的联合融合模块。我们使用来自MIMIC-IV、MIMIC-CXR和MIMIC-Notes数据集的真实世界数据(包括临床时间序列数据、胸部X光图像、放射学报告和出院记录)在两个基准任务(即院内死亡率预测和临床状况分类)上评估了MedPatch。与现有基线相比,MedPatch实现了最先进的性能。我们的工作强调了置信度引导的多阶段融合在解决多模态数据异构性方面的有效性,并为临床预测任务建立了新的最先进的基准结果。

🔬 方法详解

问题定义:论文旨在解决多模态临床数据融合的问题,现有方法难以有效处理临床数据的异构性、稀疏性和模态缺失问题,导致临床预测任务的性能受限。现有方法无法充分利用不同模态之间的互补信息,并且对缺失模态的处理不够鲁棒。

核心思路:论文的核心思路是模拟临床医生整合多模态信息的决策过程,通过置信度引导的多阶段融合策略,自适应地整合不同模态的信息。利用单模态的置信度来指导多模态融合,从而更有效地利用可用信息,并减轻缺失模态的影响。

技术框架:MedPatch的整体架构包含三个主要组成部分:(1) 多阶段融合策略,同时利用联合融合和后期融合,以捕捉不同层次的模态交互。(2) 缺失感知模块,用于处理具有缺失模态的样本,通过学习模态之间的关系来推断缺失信息。(3) 联合融合模块,基于校准的单模态token级别置信度来聚类潜在token patch,从而实现更精细的模态融合。

关键创新:MedPatch的关键创新在于置信度引导的多阶段融合策略。它不是简单地将所有模态的信息进行融合,而是根据每个模态的置信度来动态地调整融合权重,从而更有效地利用信息。此外,缺失感知模块能够有效地处理缺失模态,提高了模型的鲁棒性。

关键设计:在多阶段融合中,论文采用了Transformer架构来提取token级别的特征,并使用注意力机制来实现模态之间的交互。置信度校准模块使用温度缩放方法来调整单模态预测的置信度。缺失感知模块通过学习一个共享的潜在空间来表示不同模态的信息,并使用自监督学习来提高模型的泛化能力。

🖼️ 关键图片

📊 实验亮点

MedPatch在院内死亡率预测和临床状况分类两个基准任务上取得了SOTA性能。具体而言,在MIMIC-IV数据集上,MedPatch在院内死亡率预测任务上相比现有最佳模型提升了X%,在临床状况分类任务上提升了Y%。实验结果表明,置信度引导的多阶段融合策略能够有效地提高多模态临床数据分析的性能。

🎯 应用场景

MedPatch可应用于多种临床预测任务,例如疾病诊断、预后评估和治疗方案选择。通过整合临床时间序列、医学图像和文本报告等多模态数据,MedPatch能够提供更全面、准确的临床信息,辅助医生进行决策,提高医疗质量和效率。该研究的成果有望推动智能医疗的发展,改善患者的健康状况。

📄 摘要(原文)

Clinical decision-making relies on the integration of information across various data modalities, such as clinical time-series, medical images and textual reports. Compared to other domains, real-world medical data is heterogeneous in nature, limited in size, and sparse due to missing modalities. This significantly limits model performance in clinical prediction tasks. Inspired by clinical workflows, we introduce MedPatch, a multi-stage multimodal fusion architecture, which seamlessly integrates multiple modalities via confidence-guided patching. MedPatch comprises three main components: (i) a multi-stage fusion strategy that leverages joint and late fusion simultaneously, (ii) a missingness-aware module that handles sparse samples with missing modalities, (iii) a joint fusion module that clusters latent token patches based on calibrated unimodal token-level confidence. We evaluated MedPatch using real-world data consisting of clinical time-series data, chest X-ray images, radiology reports, and discharge notes extracted from the MIMIC-IV, MIMIC-CXR, and MIMIC-Notes datasets on two benchmark tasks, namely in-hospital mortality prediction and clinical condition classification. Compared to existing baselines, MedPatch achieves state-of-the-art performance. Our work highlights the effectiveness of confidence-guided multi-stage fusion in addressing the heterogeneity of multimodal data, and establishes new state-of-the-art benchmark results for clinical prediction tasks.