MZEN: Multi-Zoom Enhanced NeRF for 3-D Reconstruction with Unknown Camera Poses

作者: Jong-Ik Park, Carlee Joe-Wong, Gary K. Fedder

分类: cs.CV

发布日期: 2025-08-07

💡 一句话要点

MZEN:多尺度增强NeRF,解决未知相机姿态下三维重建的工业检测难题

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 神经辐射场 三维重建 多尺度图像 相机姿态估计 工业检测 扫描电子显微镜

📋 核心要点

- 现有NeRF方法在工业检测等高精度场景下,难以兼顾全局结构和微米级细节,尤其是在相机姿态未知的情况下。

- MZEN通过引入可学习的缩放标量增强相机模型,并提出一种先全局后局部的姿态估计策略,实现多尺度图像的有效融合。

- 实验表明,MZEN在合成和真实数据集上均显著优于现有方法,PSNR提升高达28%,有效提升了重建质量。

📝 摘要(中文)

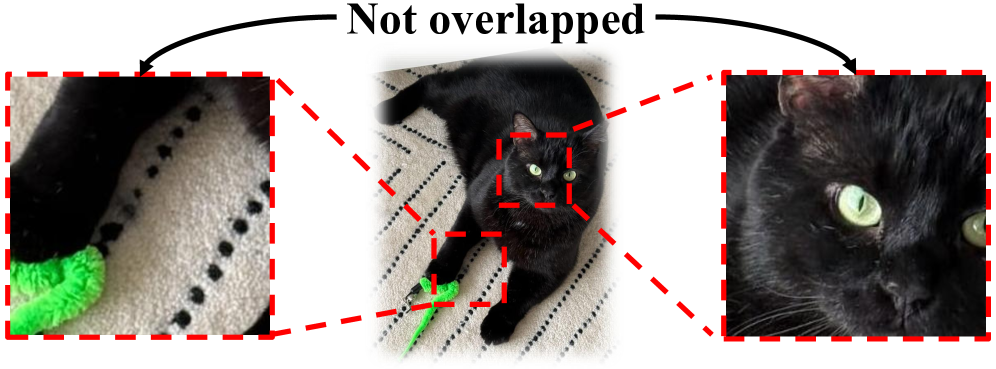

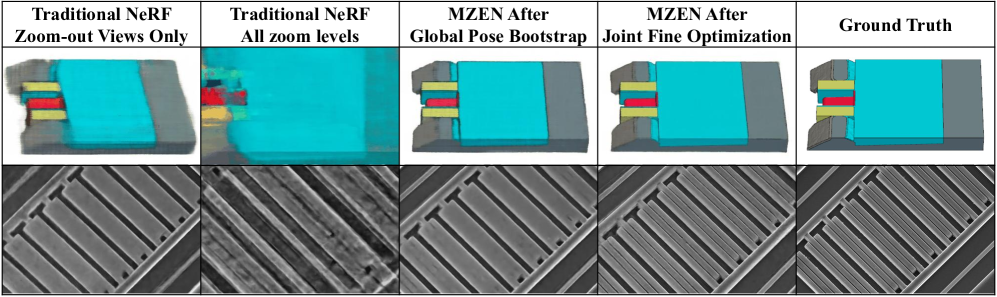

神经辐射场(NeRF)方法擅长从多张二维图像中进行三维重建,即使这些图像是在未知相机姿态下拍摄的。然而,它们仍然遗漏了工业检测中重要的精细结构,例如生产线上亚微米缺陷的检测或使用扫描电子显微镜(SEM)分析芯片。在这些场景中,传感器分辨率是固定的,计算预算也很紧张,因此暴露精细结构的唯一方法是添加放大图像;然而,这打破了无姿态NeRF训练所依赖的多视图一致性。我们提出了多尺度增强NeRF(MZEN),这是第一个原生处理多尺度图像集的NeRF框架。MZEN(i)使用显式的、可学习的缩放标量来缩放焦距,从而增强了针孔相机模型,并且(ii)引入了一种新的姿态策略:首先求解广角图像以建立全局度量框架,然后通过缩放一致的裁剪和匹配程序将放大图像进行姿态引导到最近的广角对应图像,最后进行联合优化。在八个前向场景(合成TCAD模型、微结构的真实SEM和BLEFF对象)中,MZEN始终优于无姿态基线,甚至优于高分辨率变体,将PSNR提高了高达28%,SSIM提高了10%,并将LPIPS降低了高达222%。因此,MZEN将NeRF扩展到真实的工厂环境,在保持全局精度的同时,捕获工业检测必不可少的微米级细节。

🔬 方法详解

问题定义:论文旨在解决在工业检测等场景下,如何利用多尺度图像(包含广角和放大图像)进行高精度三维重建的问题。现有NeRF方法难以处理多尺度图像,因为不同尺度的图像打破了多视图一致性,导致姿态估计和重建效果不佳。此外,工业场景通常对计算资源有限制,需要高效的重建方法。

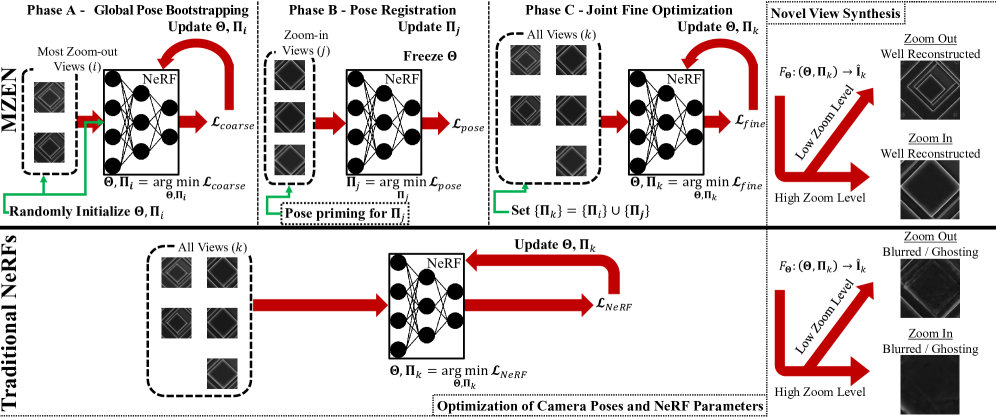

核心思路:MZEN的核心思路是显式地建模不同尺度图像之间的关系,并利用广角图像提供的全局信息来引导放大图像的姿态估计。通过引入可学习的缩放因子,MZEN能够更好地适应不同尺度的图像,并保持多视图一致性。此外,MZEN采用了一种由粗到精的姿态估计策略,先估计广角图像的姿态,再利用广角图像的信息来初始化放大图像的姿态。

技术框架:MZEN的整体框架包含以下几个主要步骤:1) 相机模型增强:在传统的针孔相机模型中引入一个可学习的缩放标量,用于表示不同尺度图像之间的焦距差异。2) 姿态估计:首先使用广角图像估计全局相机姿态,然后使用缩放一致的裁剪和匹配程序将放大图像与最近的广角图像对齐,并进行姿态初始化。3) 联合优化:将所有图像的姿态和NeRF参数进行联合优化,以实现高精度的三维重建。

关键创新:MZEN的关键创新在于:1) 提出了一个显式的、可学习的缩放标量来建模多尺度图像之间的关系。2) 提出了一种由粗到精的姿态估计策略,利用广角图像的全局信息来引导放大图像的姿态估计。与现有方法相比,MZEN能够更好地处理多尺度图像,并实现更高的重建精度。

关键设计:MZEN的关键设计包括:1) 使用MLP网络来表示NeRF,并使用体积渲染技术来生成图像。2) 使用L1损失、SSIM损失和LPIPS损失来优化NeRF参数。3) 使用Adam优化器来训练网络。缩放因子的初始化和学习率的选择对最终结果有一定影响,论文中给出了推荐的参数设置。

🖼️ 关键图片

📊 实验亮点

MZEN在多个数据集上进行了评估,包括合成TCAD模型、微结构的真实SEM图像和BLEFF对象。实验结果表明,MZEN始终优于无姿态基线和高分辨率变体,PSNR提高了高达28%,SSIM提高了10%,LPIPS降低了高达222%。这些结果表明,MZEN能够有效地处理多尺度图像,并实现高精度的三维重建。

🎯 应用场景

MZEN在工业检测领域具有广泛的应用前景,例如生产线上亚微米缺陷的检测、芯片的扫描电子显微镜(SEM)分析、以及其他需要高精度三维重建的场景。该方法可以帮助提高产品质量,降低生产成本,并加速新产品的研发。未来,MZEN可以进一步扩展到其他领域,例如医学影像分析和文物保护等。

📄 摘要(原文)

Neural Radiance Fields (NeRF) methods excel at 3D reconstruction from multiple 2D images, even those taken with unknown camera poses. However, they still miss the fine-detailed structures that matter in industrial inspection, e.g., detecting sub-micron defects on a production line or analyzing chips with Scanning Electron Microscopy (SEM). In these scenarios, the sensor resolution is fixed and compute budgets are tight, so the only way to expose fine structure is to add zoom-in images; yet, this breaks the multi-view consistency that pose-free NeRF training relies on. We propose Multi-Zoom Enhanced NeRF (MZEN), the first NeRF framework that natively handles multi-zoom image sets. MZEN (i) augments the pin-hole camera model with an explicit, learnable zoom scalar that scales the focal length, and (ii) introduces a novel pose strategy: wide-field images are solved first to establish a global metric frame, and zoom-in images are then pose-primed to the nearest wide-field counterpart via a zoom-consistent crop-and-match procedure before joint refinement. Across eight forward-facing scenes$\unicode{x2013}$synthetic TCAD models, real SEM of micro-structures, and BLEFF objects$\unicode{x2013}$MZEN consistently outperforms pose-free baselines and even high-resolution variants, boosting PSNR by up to $28 \%$, SSIM by $10 \%$, and reducing LPIPS by up to $222 \%$. MZEN, therefore, extends NeRF to real-world factory settings, preserving global accuracy while capturing the micron-level details essential for industrial inspection.