TITAN-Guide: Taming Inference-Time AligNment for Guided Text-to-Video Diffusion Models

作者: Christian Simon, Masato Ishii, Akio Hayakawa, Zhi Zhong, Shusuke Takahashi, Takashi Shibuya, Yuki Mitsufuji

分类: cs.CV

发布日期: 2025-08-01

备注: Accepted to ICCV 2025

💡 一句话要点

TITAN-Guide:通过推理时对齐优化,实现对文本到视频扩散模型的引导。

🎯 匹配领域: 支柱七:动作重定向 (Motion Retargeting)

关键词: 文本到视频生成 扩散模型 无训练引导 推理时优化 潜在变量优化 前向梯度下降 多模态对齐

📋 核心要点

- 现有无训练引导方法在文本到视频扩散模型中面临内存需求高和控制精度不足的挑战。

- TITAN-Guide通过优化扩散潜在变量,避免了从引导模型反向传播,从而降低内存需求并提升控制效果。

- 实验证明,TITAN-Guide在降低内存需求的同时,显著提升了文本到视频生成任务的性能。

📝 摘要(中文)

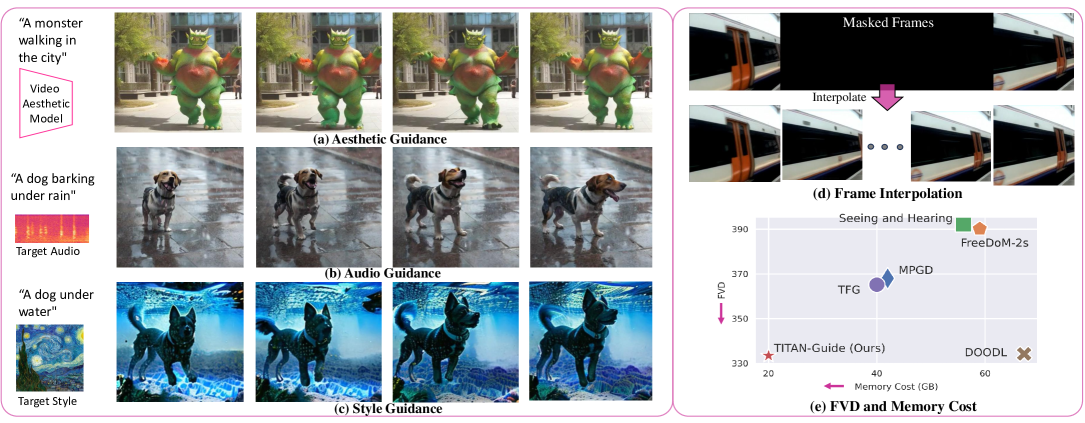

条件扩散模型的发展通常需要大量的监督微调才能控制特定类别的任务。使用现成的模型进行无训练引导是一种避免在基础模型上进行额外微调的可行替代方案。然而,现有的无训练引导框架要么需要大量的内存,要么由于粗略的估计而提供次优的控制。这些缺点限制了其在需要大量计算的扩散模型控制中的应用,例如文本到视频(T2V)扩散模型。本文提出了TITAN-Guide,即用于引导文本到视频扩散模型的推理时对齐优化方法,它克服了内存空间问题,并提供了比同类方法更优的引导控制。特别地,我们开发了一种有效的方法来优化扩散潜在变量,而无需从判别引导模型进行反向传播。我们研究了具有各种方向指令选项的引导扩散任务的前向梯度下降。实验表明,我们的方法在有效管理潜在变量优化过程中的内存方面非常有效,而以前的方法则不足。我们提出的方法不仅最大限度地减少了内存需求,而且还显著提高了各种扩散引导基准测试中的T2V性能。代码、模型和演示可在https://titanguide.github.io上找到。

🔬 方法详解

问题定义:现有的文本到视频扩散模型引导方法,特别是无训练引导方法,面临两个主要问题。一是内存需求过高,限制了其在计算密集型任务中的应用。二是控制精度不足,导致生成的视频与文本描述的对齐效果不佳。这些问题源于现有方法对潜在变量的粗略估计或需要从引导模型进行反向传播。

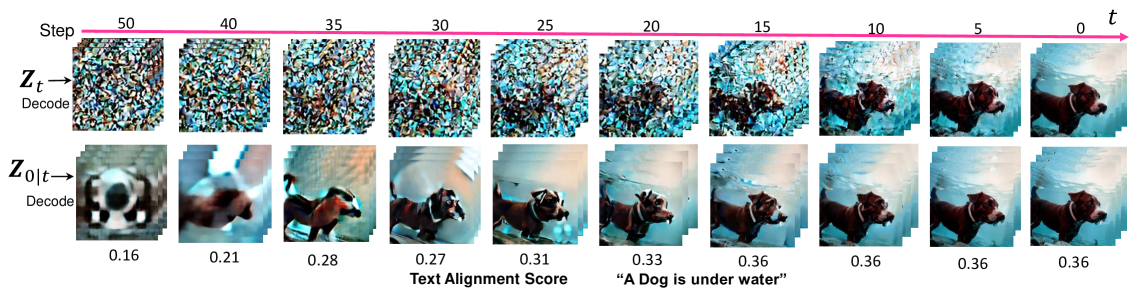

核心思路:TITAN-Guide的核心思路是通过在推理时优化扩散模型的潜在变量,以实现更精确的文本引导。关键在于避免从判别引导模型进行反向传播,从而显著降低内存需求。通过前向梯度下降,在潜在空间中寻找与文本描述更对齐的潜在变量。

技术框架:TITAN-Guide的整体框架包括以下几个主要阶段:1) 使用文本编码器提取文本特征;2) 使用预训练的文本到视频扩散模型生成初始视频;3) 使用判别引导模型(例如CLIP)评估视频与文本的对齐程度;4) 使用前向梯度下降优化扩散模型的潜在变量,以提高对齐程度;5) 根据优化后的潜在变量生成最终视频。

关键创新:TITAN-Guide最重要的技术创新点在于使用前向梯度下降优化潜在变量,而无需从判别引导模型进行反向传播。这与现有方法形成了本质区别,现有方法通常需要反向传播,导致内存需求高昂。此外,TITAN-Guide还探索了不同的方向指令选项,以进一步提高引导效果。

关键设计:TITAN-Guide的关键设计包括:1) 使用预训练的CLIP模型作为判别引导模型,评估视频与文本的对齐程度;2) 使用前向梯度下降算法优化潜在变量,例如使用Adam优化器;3) 设计合适的损失函数,例如基于CLIP相似度的损失函数,以指导潜在变量的优化方向;4) 探索不同的方向指令,例如直接使用CLIP梯度或使用其变体。

🖼️ 关键图片

📊 实验亮点

TITAN-Guide在文本到视频生成任务中表现出色,显著降低了内存需求,同时提高了视频与文本描述的对齐程度。实验结果表明,TITAN-Guide在多个扩散引导基准测试中优于现有方法,实现了更高的生成质量和更低的内存占用。具体性能数据和对比基线可在论文原文中找到。

🎯 应用场景

TITAN-Guide可应用于各种文本到视频生成场景,例如创意视频制作、广告设计、教育内容生成等。该方法降低了内存需求,使得在资源有限的设备上生成高质量视频成为可能。未来,该技术有望进一步扩展到其他多模态生成任务,例如文本到3D模型生成。

📄 摘要(原文)

In the recent development of conditional diffusion models still require heavy supervised fine-tuning for performing control on a category of tasks. Training-free conditioning via guidance with off-the-shelf models is a favorable alternative to avoid further fine-tuning on the base model. However, the existing training-free guidance frameworks either have heavy memory requirements or offer sub-optimal control due to rough estimation. These shortcomings limit the applicability to control diffusion models that require intense computation, such as Text-to-Video (T2V) diffusion models. In this work, we propose Taming Inference Time Alignment for Guided Text-to-Video Diffusion Model, so-called TITAN-Guide, which overcomes memory space issues, and provides more optimal control in the guidance process compared to the counterparts. In particular, we develop an efficient method for optimizing diffusion latents without backpropagation from a discriminative guiding model. In particular, we study forward gradient descents for guided diffusion tasks with various options on directional directives. In our experiments, we demonstrate the effectiveness of our approach in efficiently managing memory during latent optimization, while previous methods fall short. Our proposed approach not only minimizes memory requirements but also significantly enhances T2V performance across a range of diffusion guidance benchmarks. Code, models, and demo are available at https://titanguide.github.io.