PointGauss: Point Cloud-Guided Multi-Object Segmentation for Gaussian Splatting

作者: Wentao Sun, Hanqing Xu, Quanyun Wu, Dedong Zhang, Yiping Chen, Lingfei Ma, John S. Zelek, Jonathan Li

分类: cs.CV

发布日期: 2025-08-01

备注: 22 pages, 9 figures

💡 一句话要点

PointGauss:点云引导的高斯溅射多对象分割,实现实时高效的3D场景理解

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 高斯溅射 点云分割 多对象分割 3D场景理解 辐射场 多视角一致性 实例分割

📋 核心要点

- 现有方法在高斯溅射场景下的多对象分割存在初始化耗时过长和多视角一致性不足的问题。

- PointGauss利用点云信息引导高斯基元的解析,从而快速生成3D实例掩码,并采用GPU加速渲染保证多视角一致性。

- 实验表明,PointGauss在多视角mIoU指标上显著优于现有方法,最高提升达31.78%,同时保持了较高的计算效率。

📝 摘要(中文)

本文提出了一种新颖的PointGauss框架,用于在高斯溅射表示中进行实时多对象分割,该框架由点云引导。与现有方法相比,我们的方法通过点云分割驱动的流程直接解析高斯基元,从而实现高效的3D分割,避免了冗长的初始化和有限的多视角一致性问题。关键创新在于两个方面:(1) 基于点云的高斯基元解码器,可以在1分钟内生成3D实例掩码;(2) GPU加速的2D掩码渲染系统,确保多视角一致性。大量实验表明,与先前的最先进方法相比,我们的方法在多视角mIoU方面取得了显著的性能提升,提升幅度为1.89%到31.78%,同时保持了卓越的计算效率。为了解决当前基准测试的局限性(单对象聚焦、不一致的3D评估、小规模和部分覆盖),我们提出了DesktopObjects-360,这是一个用于辐射场中3D分割的新型综合数据集,具有:(1) 复杂的多对象场景,(2) 全局一致的2D注释,(3) 大规模训练数据(超过2.7万个2D掩码),(4) 完整的360°覆盖,以及 (5) 3D评估掩码。

🔬 方法详解

问题定义:现有方法在高斯溅射场景下进行多对象分割时,通常需要较长的初始化时间,并且难以保证多视角下分割结果的一致性。此外,现有的数据集也存在单对象聚焦、3D评估不一致、规模小和覆盖范围有限等问题。

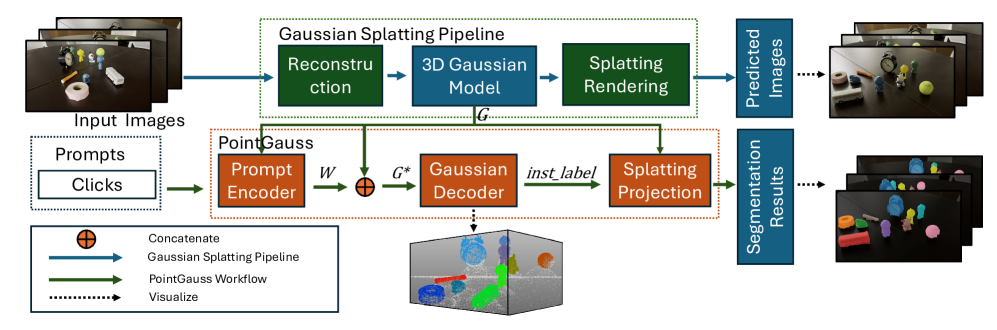

核心思路:PointGauss的核心思路是利用点云信息来引导高斯基元的解析,从而实现快速且多视角一致的3D分割。通过点云分割的结果来指导高斯基元的分配,避免了从头开始学习分割掩码的漫长过程。

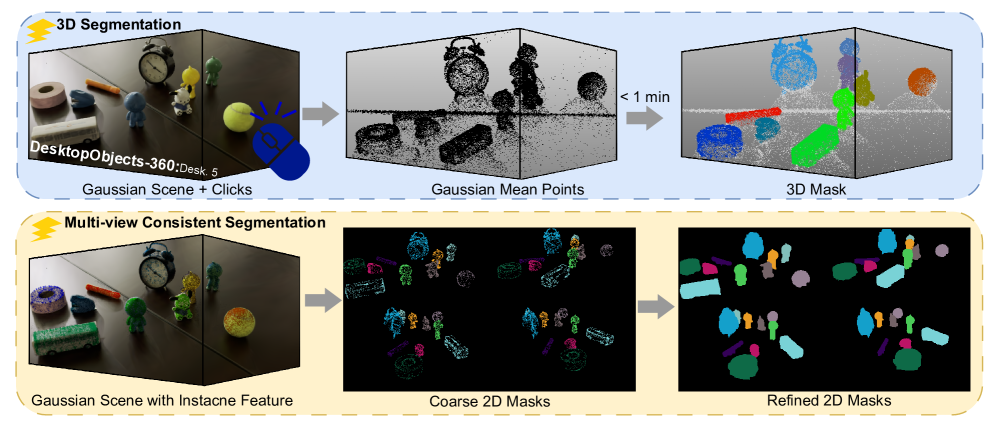

技术框架:PointGauss框架主要包含两个阶段:(1) 基于点云的高斯基元解码器:该模块首先对点云进行分割,然后利用分割结果来生成3D实例掩码,从而将高斯基元分配到不同的对象实例。(2) GPU加速的2D掩码渲染系统:该模块利用GPU加速渲染2D掩码,并确保多视角下分割结果的一致性。

关键创新:PointGauss的关键创新在于利用点云信息来引导高斯基元的解析,从而避免了从头开始学习分割掩码的漫长过程。此外,该方法还提出了一个GPU加速的2D掩码渲染系统,可以有效地保证多视角下分割结果的一致性。与现有方法相比,PointGauss能够更快地生成3D实例掩码,并且具有更好的多视角一致性。

关键设计:PointGauss使用点云分割网络(具体网络结构未知)来预测每个点的语义标签,然后将具有相同标签的高斯基元分配到同一个对象实例。为了保证多视角一致性,该方法采用了一种基于GPU加速的2D掩码渲染技术,具体实现细节未知。损失函数的设计也未知。

🖼️ 关键图片

📊 实验亮点

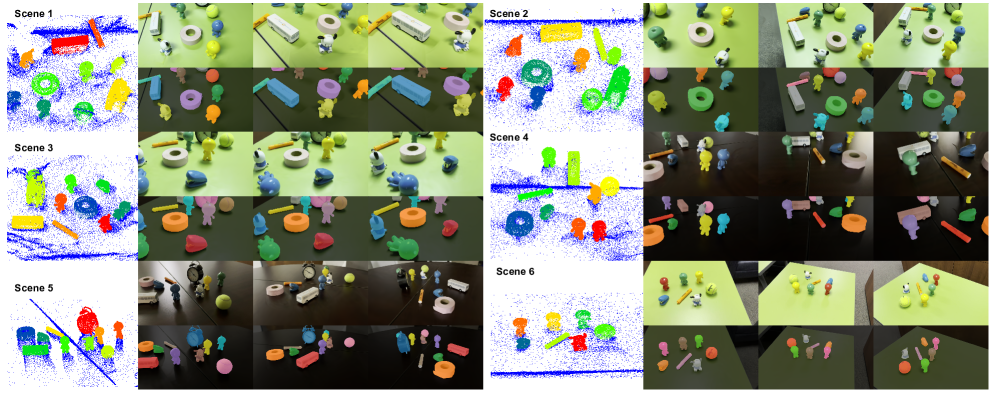

PointGauss在多视角mIoU指标上取得了显著的性能提升,与现有最先进方法相比,提升幅度为1.89%到31.78%。此外,PointGauss还具有较高的计算效率,可以在1分钟内生成3D实例掩码。为了进一步验证该方法的有效性,作者还提出了一个名为DesktopObjects-360的新数据集,该数据集包含复杂的多对象场景、全局一致的2D注释、大规模训练数据和完整的360°覆盖。

🎯 应用场景

PointGauss在机器人导航、自动驾驶、增强现实等领域具有广泛的应用前景。它可以用于快速准确地分割3D场景中的多个对象,从而帮助机器人或自动驾驶车辆更好地理解周围环境,并做出更明智的决策。此外,PointGauss还可以用于增强现实应用中,例如将虚拟对象放置在真实场景中的特定对象上。

📄 摘要(原文)

We introduce PointGauss, a novel point cloud-guided framework for real-time multi-object segmentation in Gaussian Splatting representations. Unlike existing methods that suffer from prolonged initialization and limited multi-view consistency, our approach achieves efficient 3D segmentation by directly parsing Gaussian primitives through a point cloud segmentation-driven pipeline. The key innovation lies in two aspects: (1) a point cloud-based Gaussian primitive decoder that generates 3D instance masks within 1 minute, and (2) a GPU-accelerated 2D mask rendering system that ensures multi-view consistency. Extensive experiments demonstrate significant improvements over previous state-of-the-art methods, achieving performance gains of 1.89 to 31.78% in multi-view mIoU, while maintaining superior computational efficiency. To address the limitations of current benchmarks (single-object focus, inconsistent 3D evaluation, small scale, and partial coverage), we present DesktopObjects-360, a novel comprehensive dataset for 3D segmentation in radiance fields, featuring: (1) complex multi-object scenes, (2) globally consistent 2D annotations, (3) large-scale training data (over 27 thousand 2D masks), (4) full 360° coverage, and (5) 3D evaluation masks.