Robust 3D Object Detection using Probabilistic Point Clouds from Single-Photon LiDARs

作者: Bhavya Goyal, Felipe Gutierrez-Barragan, Wei Lin, Andreas Velten, Yin Li, Mohit Gupta

分类: cs.CV

发布日期: 2025-07-31

备注: ICCV 2025

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

提出概率点云PPC,提升单光子激光雷达在复杂场景下的3D目标检测鲁棒性

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 3D目标检测 激光雷达 概率点云 单光子激光雷达 不确定性建模

📋 核心要点

- 传统3D处理流程在构建点云时忽略了原始测量数据中的不确定性信息,导致下游感知模型精度下降。

- 论文提出概率点云(PPC)表示,为每个点云增加概率属性,捕捉原始数据的测量不确定性。

- 实验表明,基于PPC的3D推理方法在复杂场景下优于现有LiDAR和相机-LiDAR融合模型。

📝 摘要(中文)

本文提出了一种新的3D场景表示方法,称为概率点云(PPC)。PPC通过为每个点云附加一个概率属性来封装原始测量数据中的不确定性(或置信度)。此外,本文还介绍了利用PPC进行鲁棒3D目标检测的推理方法;这些方法具有通用性,可以作为计算量小的即插即用模块用于3D推理流程中。通过仿真和真实数据捕获,证明了基于PPC的3D推理方法在涉及小型、远距离和低反照率物体以及强环境光的具有挑战性的室内和室外场景中,优于几种基于激光雷达以及相机-激光雷达融合模型的基线方法。

🔬 方法详解

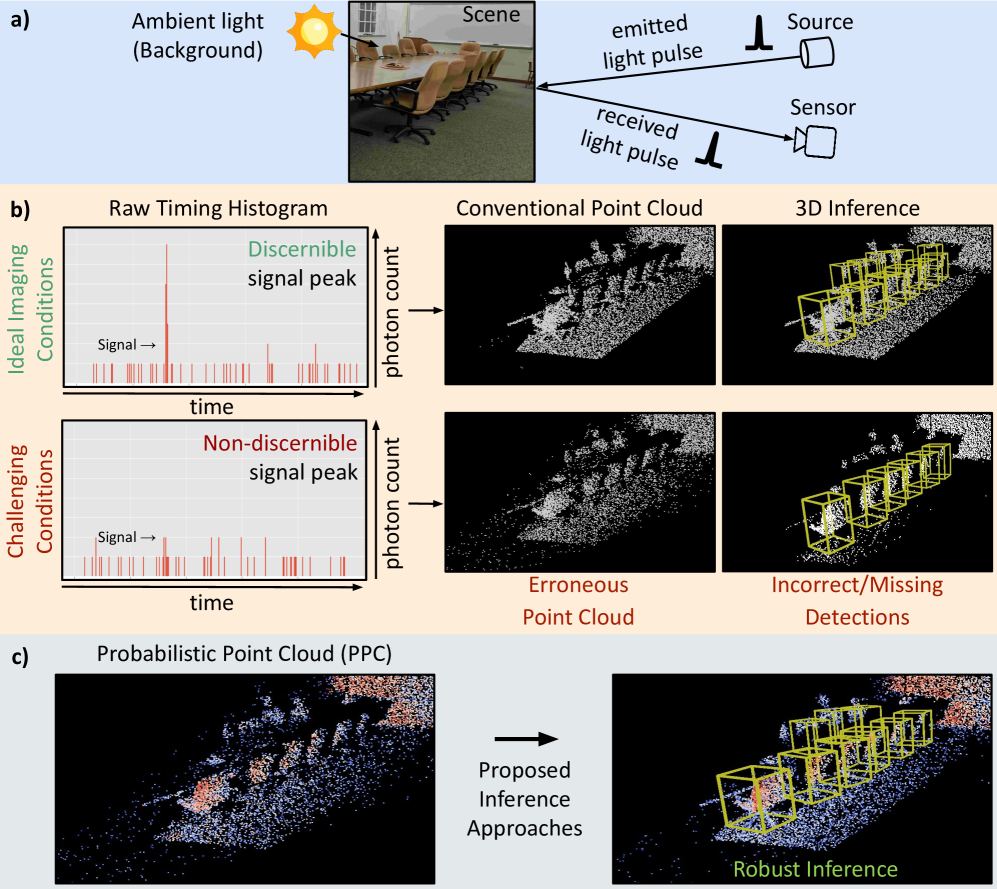

问题定义:现有基于激光雷达的3D目标检测方法在处理稀疏或错误点云时面临挑战,尤其是在远距离、低反射率物体或强环境光等复杂场景下。这是因为传统方法在从原始激光雷达测量数据构建点云时,没有保留任何不确定性信息,导致误差传递到下游的检测模型,严重影响检测精度。

核心思路:论文的核心思路是将原始激光雷达测量数据中的不确定性信息显式地编码到点云表示中,从而使下游的检测模型能够更好地处理噪声和不确定性。具体来说,论文提出了概率点云(PPC)的概念,为每个点云赋予一个概率值,该概率值反映了该点云测量值的置信度。

技术框架:PPC-based 3D目标检测框架主要包含以下几个阶段:1) 原始激光雷达数据获取;2) 基于原始数据计算每个点云的概率值,构建PPC;3) 使用PPC作为输入,进行3D目标检测。论文提出的推理方法可以作为即插即用模块集成到现有的3D目标检测流程中。

关键创新:论文的关键创新在于提出了概率点云(PPC)这一新的3D场景表示方法。与传统的点云表示方法不同,PPC不仅包含点云的位置信息,还包含了每个点云的概率信息,从而能够更好地反映原始测量数据的不确定性。这种表示方法使得下游的检测模型能够更加鲁棒地处理噪声和不确定性,从而提高检测精度。

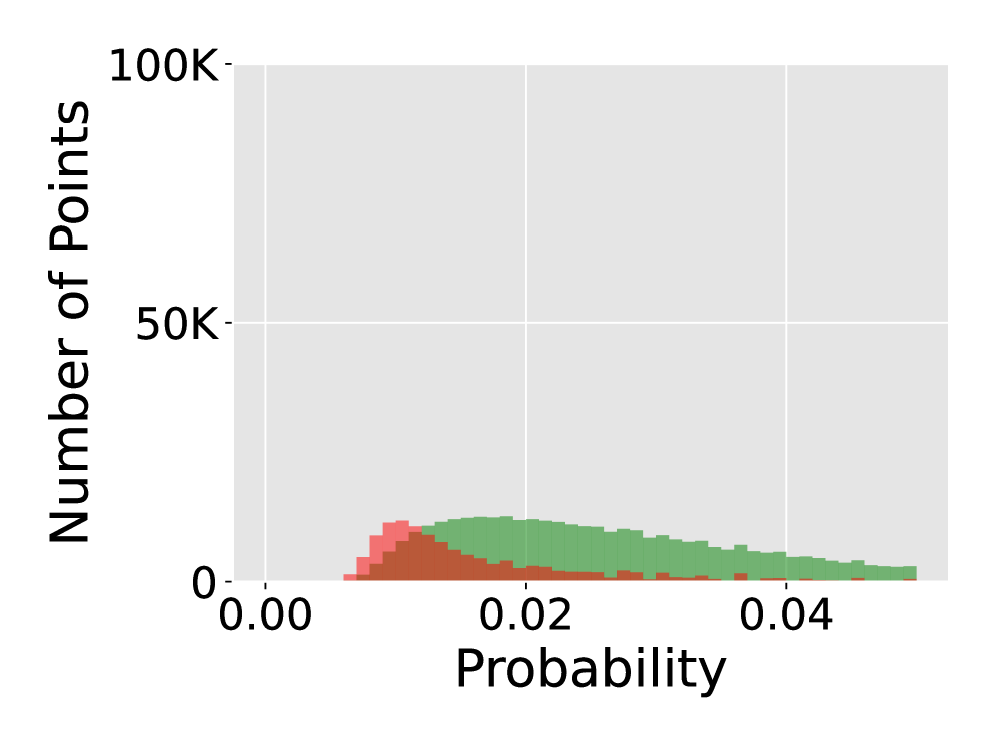

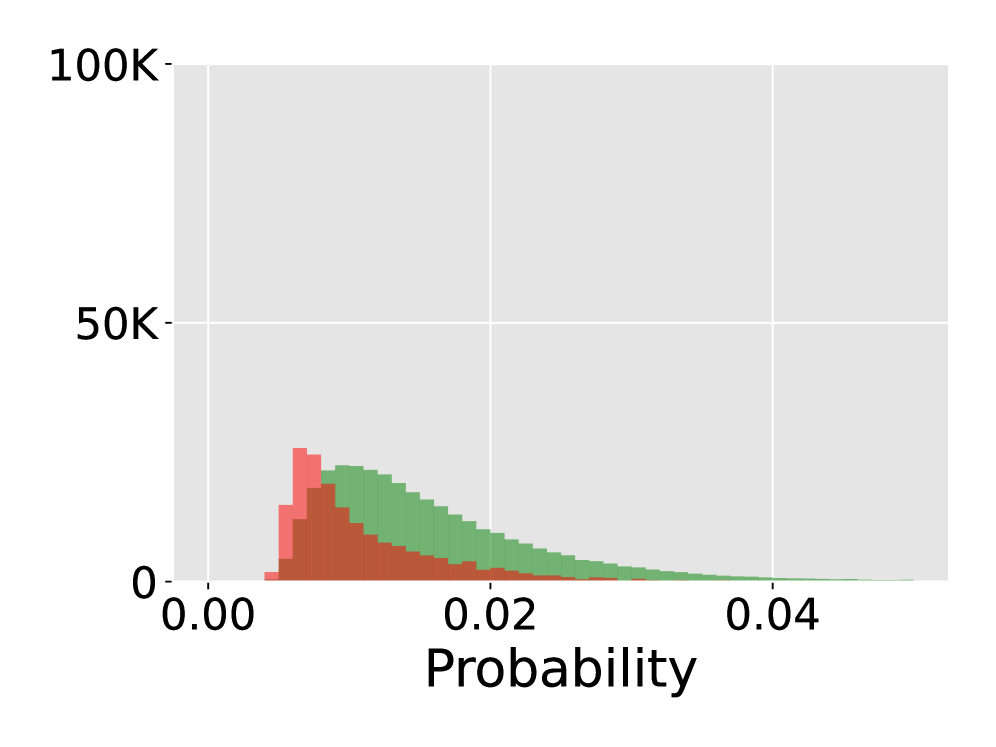

关键设计:论文中,点云的概率值是基于原始激光雷达测量数据计算得到的。具体的计算方法取决于激光雷达的类型和测量原理。例如,对于单光子激光雷达,概率值可以基于光子到达时间分布的统计特性来估计。此外,论文还设计了特定的损失函数,用于训练基于PPC的3D目标检测模型。这些损失函数考虑了点云的概率信息,从而能够更好地优化模型的性能。

🖼️ 关键图片

📊 实验亮点

实验结果表明,基于PPC的3D目标检测方法在各种具有挑战性的场景中都优于现有的方法。例如,在包含小型、远距离和低反照率物体的场景中,PPC方法相比于基线方法,检测精度提升了显著的百分比。此外,PPC方法在强环境光下的表现也优于基线方法,证明了其对噪声和不确定性的鲁棒性。

🎯 应用场景

该研究成果可广泛应用于自动驾驶、机器人导航、智能安防等领域。通过提高在复杂环境下的3D目标检测鲁棒性,可以提升自动驾驶系统的安全性,增强机器人在未知环境中的适应性,并提高智能监控系统的准确性。未来,该方法有望进一步扩展到其他类型的3D传感器和感知任务中。

📄 摘要(原文)

LiDAR-based 3D sensors provide point clouds, a canonical 3D representation used in various scene understanding tasks. Modern LiDARs face key challenges in several real-world scenarios, such as long-distance or low-albedo objects, producing sparse or erroneous point clouds. These errors, which are rooted in the noisy raw LiDAR measurements, get propagated to downstream perception models, resulting in potentially severe loss of accuracy. This is because conventional 3D processing pipelines do not retain any uncertainty information from the raw measurements when constructing point clouds. We propose Probabilistic Point Clouds (PPC), a novel 3D scene representation where each point is augmented with a probability attribute that encapsulates the measurement uncertainty (or confidence) in the raw data. We further introduce inference approaches that leverage PPC for robust 3D object detection; these methods are versatile and can be used as computationally lightweight drop-in modules in 3D inference pipelines. We demonstrate, via both simulations and real captures, that PPC-based 3D inference methods outperform several baselines using LiDAR as well as camera-LiDAR fusion models, across challenging indoor and outdoor scenarios involving small, distant, and low-albedo objects, as well as strong ambient light. Our project webpage is at https://bhavyagoyal.github.io/ppc .