Beyond Linear Bottlenecks: Spline-Based Knowledge Distillation for Culturally Diverse Art Style Classification

作者: Abdellah Zakaria Sellam, Salah Eddine Bekhouche, Cosimo Distante, Abdelmalik Taleb-Ahmed

分类: cs.CV

发布日期: 2025-07-31

💡 一句话要点

提出基于样条函数的知识蒸馏方法,提升文化艺术风格分类精度

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 艺术风格分类 知识蒸馏 Kolmogorov-Arnold Networks 非线性建模 样条函数

📋 核心要点

- 艺术风格分类面临数据集稀缺和风格元素非线性交互的挑战,现有方法难以有效建模全局上下文。

- 论文提出使用Kolmogorov-Arnold Networks (KANs) 替换传统MLP,利用其样条函数建模非线性特征相关性。

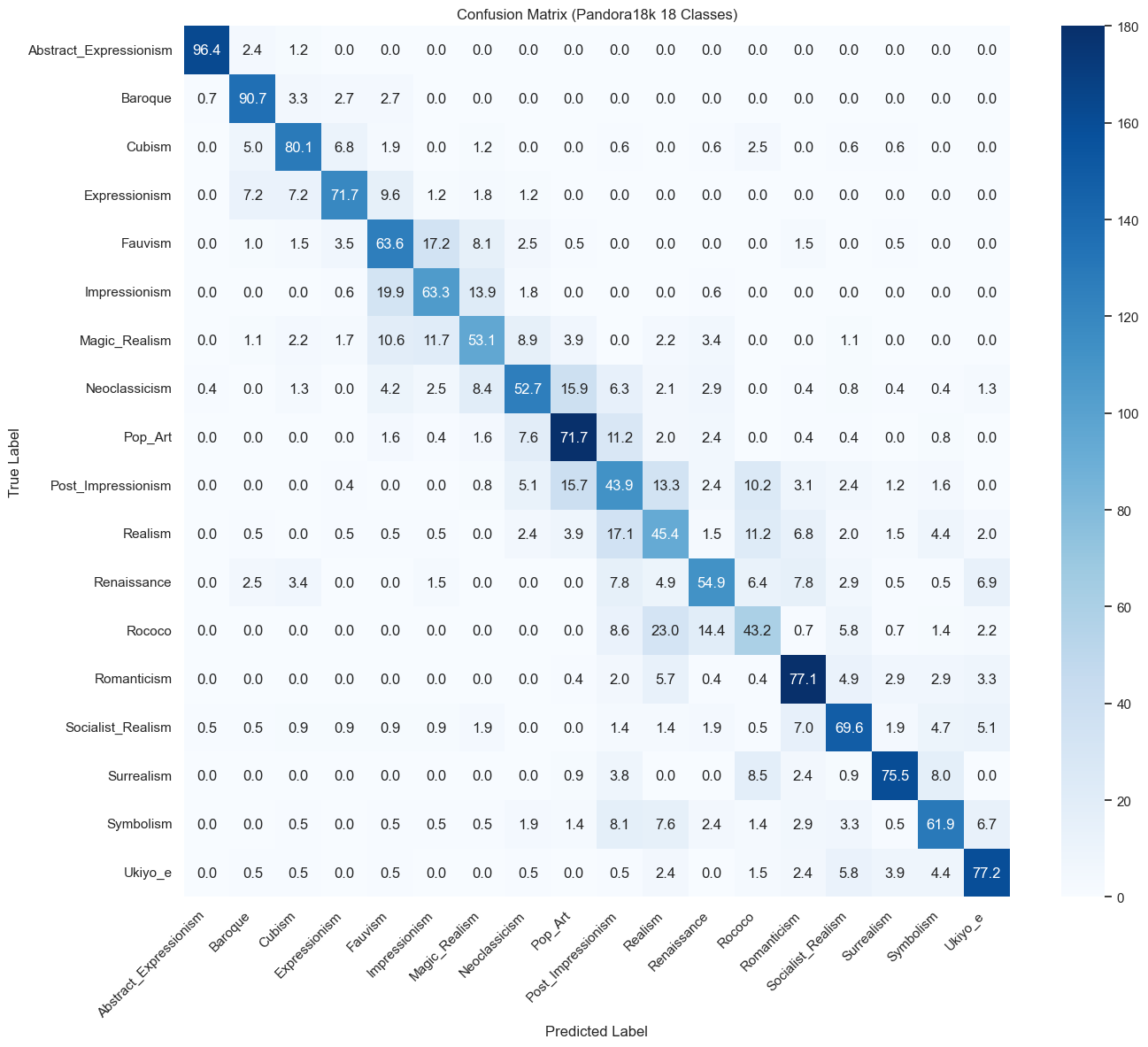

- 实验表明,该方法在WikiArt和Pandora18k数据集上,Top-1准确率优于基线方法,并提升了线性探测精度。

📝 摘要(中文)

艺术风格分类由于缺乏专家标注数据集以及风格元素之间复杂的非线性关系,仍然是计算美学中的一项艰巨挑战。最近的双教师自监督框架虽然减少了对标注数据的依赖,但其线性投影层和局部关注难以建模全局组合上下文和复杂的风格特征交互。本文通过用Kolmogorov-Arnold Networks (KANs)替换传统的MLP投影和预测头,增强了双教师知识蒸馏框架。该方法保留了来自两个教师网络的互补指导,一个强调局部纹理和笔触模式,另一个捕捉更广泛的风格层次,同时利用KANs基于样条的激活函数,以数学精度建模非线性特征相关性。在WikiArt和Pandora18k上的实验表明,该方法在Top-1准确率方面优于基础双教师架构。研究结果突出了KANs在解耦复杂风格流形方面的重要性,从而实现了比MLP投影更好的线性探测精度。

🔬 方法详解

问题定义:论文旨在解决文化艺术风格分类中,由于数据集标注稀缺和风格特征之间复杂的非线性关系,导致现有方法难以有效建模全局上下文和风格特征交互的问题。现有方法,如基于MLP的知识蒸馏,其线性投影层无法充分捕捉风格的非线性特征。

核心思路:论文的核心思路是利用Kolmogorov-Arnold Networks (KANs) 替换传统MLP,KANs基于样条函数的激活函数能够以数学精度建模非线性特征相关性,从而更好地解耦复杂风格流形。通过双教师知识蒸馏框架,结合局部纹理和全局风格信息,提升分类精度。

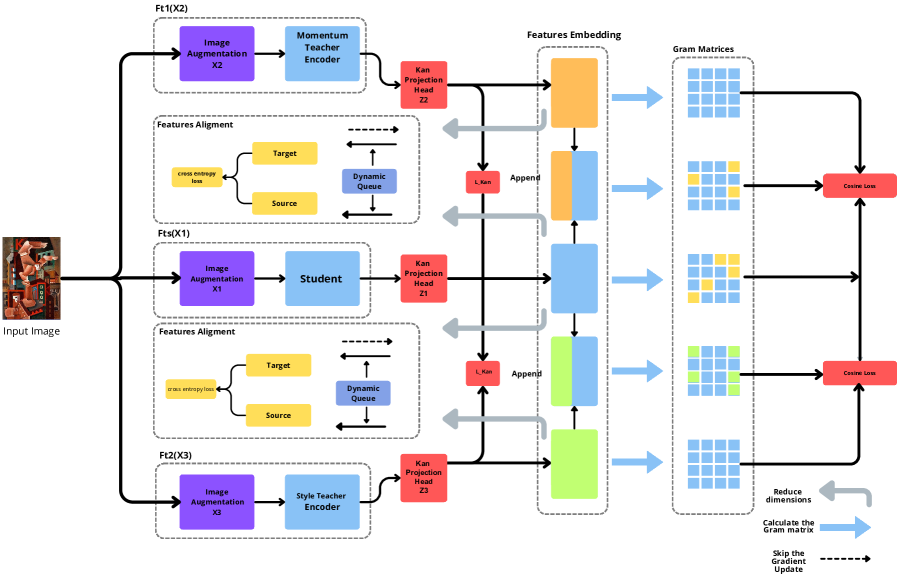

技术框架:整体框架采用双教师知识蒸馏。包含两个教师网络,一个侧重局部纹理和笔触,另一个侧重全局风格层次。学生网络通过KANs学习两个教师网络的知识。框架包含以下主要模块:特征提取模块(使用预训练的CNN),KANs投影和预测头,知识蒸馏损失函数。

关键创新:最重要的技术创新点在于使用KANs替换MLP。KANs的样条函数激活能够更好地建模非线性特征相关性,从而更有效地解耦复杂风格流形。与MLP的线性投影相比,KANs能够捕捉更丰富的风格信息。

关键设计:KANs的具体结构(层数、节点数等)未知,损失函数包括知识蒸馏损失(例如KL散度)和分类损失。教师网络的选择和训练策略未知。关键参数的设置,例如样条函数的阶数和节点数量,可能需要根据具体数据集进行调整。

🖼️ 关键图片

📊 实验亮点

实验结果表明,使用KANs替换MLP后,在WikiArt和Pandora18k数据集上,Top-1准确率优于基础双教师架构。此外,该方法还提升了线性探测精度,表明KANs能够更好地解耦复杂风格流形。具体的性能提升幅度未知。

🎯 应用场景

该研究成果可应用于艺术品分析、风格迁移、图像生成等领域。通过提升艺术风格分类的准确性,可以帮助用户更好地理解艺术作品,促进文化交流,并为艺术创作提供新的工具和方法。未来,该技术还可扩展到其他具有复杂特征交互的分类任务中。

📄 摘要(原文)

Art style classification remains a formidable challenge in computational aesthetics due to the scarcity of expertly labeled datasets and the intricate, often nonlinear interplay of stylistic elements. While recent dual-teacher self-supervised frameworks reduce reliance on labeled data, their linear projection layers and localized focus struggle to model global compositional context and complex style-feature interactions. We enhance the dual-teacher knowledge distillation framework to address these limitations by replacing conventional MLP projection and prediction heads with Kolmogorov-Arnold Networks (KANs). Our approach retains complementary guidance from two teacher networks, one emphasizing localized texture and brushstroke patterns, the other capturing broader stylistic hierarchies while leveraging KANs' spline-based activations to model nonlinear feature correlations with mathematical precision. Experiments on WikiArt and Pandora18k demonstrate that our approach outperforms the base dual teacher architecture in Top-1 accuracy. Our findings highlight the importance of KANs in disentangling complex style manifolds, leading to better linear probe accuracy than MLP projections.