UniLiP: Adapting CLIP for Unified Multimodal Understanding, Generation and Editing

作者: Hao Tang, Chenwei Xie, Xiaoyi Bao, Tingyu Weng, Pandeng Li, Yun Zheng, Liwei Wang

分类: cs.CV

发布日期: 2025-07-31 (更新: 2025-10-10)

🔗 代码/项目: GITHUB

💡 一句话要点

UniLIP:通过自蒸馏和双条件架构,使CLIP具备统一的多模态理解、生成和编辑能力。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态学习 CLIP 图像生成 图像编辑 自蒸馏 统一模型 双条件架构

📋 核心要点

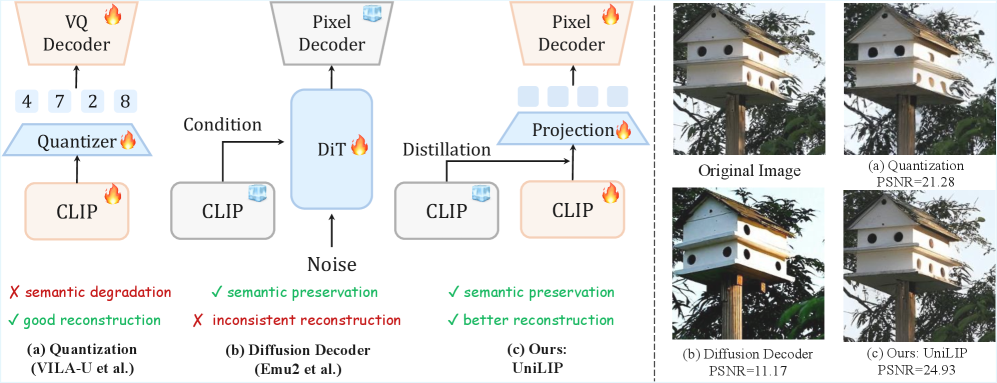

- 现有基于CLIP的统一模型难以平衡理解和重建能力,导致语义退化或重建不一致,这是当前面临的核心问题。

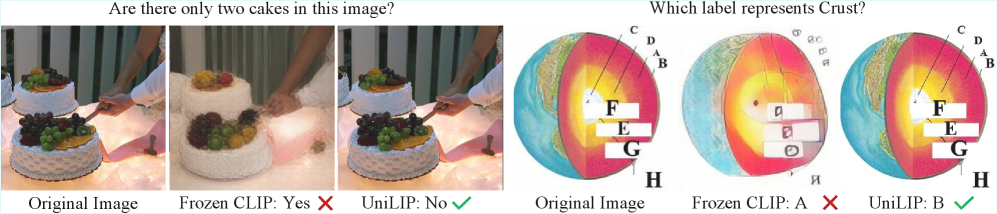

- UniLIP采用两阶段训练方案,通过自蒸馏逐步赋予CLIP高保真重建能力,同时保留其原有的理解性能。

- UniLIP在GenEval、WISE和ImgEdit等基准测试中,以更少的参数超越了更大的统一模型,实现了最先进的性能。

📝 摘要(中文)

本文提出了UniLIP,一个统一的框架,旨在使CLIP适应多模态的理解、生成和编辑任务。尽管CLIP在理解方面表现出色,但它缺乏作为统一视觉编码器所需的重建能力。然而,之前基于CLIP的统一方法未能平衡理解和重建,导致语义退化或不一致的重建结果。为了解决这个问题,我们引入了一种新颖的两阶段训练方案,该方案采用自蒸馏策略,逐步赋予CLIP高保真度的重建能力,同时保留其原始的理解性能。为了增强生成和编辑中的推理和一致性,我们进一步开发了一种基于MetaQuery框架的双条件架构。我们的架构联合利用多模态隐藏状态以获得丰富的上下文细节,并利用可学习的查询嵌入来利用多模态大型语言模型(MLLM)的强大推理能力。凭借先进的图像表示和架构设计,UniLIP展示了卓越的指令遵循和编辑保真度。UniLIP仅使用1B和3B参数,就能胜过更大的统一模型,如BAGEL(7B)和Uniworld-V1(12B),在GenEval上达到0.90,在WISE上达到0.63,在ImgEdit上达到3.94,实现了最先进的性能。这些结果表明,UniLIP成功地扩展了CLIP的应用,使其不仅是理解任务的最佳选择,而且在生成和编辑任务中也取得了极具竞争力的性能。

🔬 方法详解

问题定义:现有基于CLIP的统一模型,虽然试图融合理解和生成能力,但往往顾此失彼,要么牺牲了CLIP原有的语义理解能力,要么无法生成高质量、一致性的图像。因此,如何让CLIP在保持理解能力的同时,具备强大的图像重建和生成能力,是本文要解决的核心问题。

核心思路:UniLIP的核心思路是通过两阶段训练,逐步赋予CLIP图像重建能力,并采用自蒸馏的方式,确保在重建过程中不损失CLIP原有的语义理解能力。此外,引入双条件架构,利用多模态信息和可学习的查询嵌入,增强模型的推理和生成一致性。

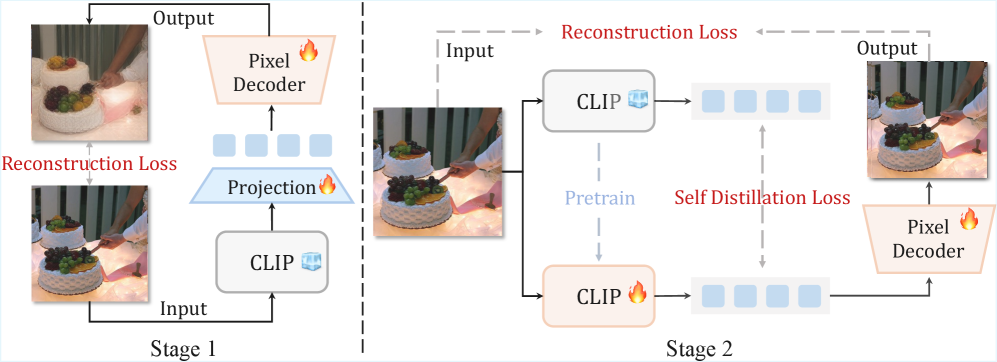

技术框架:UniLIP的整体框架包含两个主要阶段:第一阶段是重建能力的训练,通过自蒸馏损失,让CLIP学习重建输入图像。第二阶段是指令跟随和编辑能力的训练,采用双条件架构,将多模态隐藏状态和可学习的查询嵌入结合,输入到多模态大型语言模型中,进行图像生成和编辑。

关键创新:UniLIP的关键创新在于其两阶段训练策略和自蒸馏损失。自蒸馏损失能够有效地将CLIP原有的知识迁移到重建模型中,避免了语义信息的丢失。双条件架构则增强了模型在生成和编辑任务中的推理能力和一致性。

关键设计:在第一阶段,使用L1损失和感知损失来保证重建图像的质量,同时使用自蒸馏损失来约束重建过程,确保重建后的图像与原始CLIP特征尽可能接近。在第二阶段,MetaQuery框架被用于融合多模态信息,并利用可学习的查询嵌入来引导生成过程。具体的损失函数包括生成对抗损失和CLIP损失,以保证生成图像的质量和与指令的一致性。

🖼️ 关键图片

📊 实验亮点

UniLIP在GenEval、WISE和ImgEdit等基准测试中取得了显著的成果。具体来说,UniLIP在GenEval上达到了0.90,在WISE上达到了0.63,在ImgEdit上达到了3.94,超越了参数量更大的BAGEL (7B) 和 Uniworld-V1 (12B) 等模型,证明了其在多模态理解、生成和编辑方面的卓越性能。

🎯 应用场景

UniLIP具有广泛的应用前景,包括图像编辑、图像生成、视觉问答、图像描述等。它可以应用于创意设计、内容生成、智能助手等领域,为用户提供更加智能和便捷的多模态交互体验。未来,UniLIP有望成为多模态人工智能领域的重要基石。

📄 摘要(原文)

In this paper, we propose UniLIP, a unified framework that adapts CLIP for multimodal understanding, generation and editing. Although CLIP excels at understanding, it lacks reconstruction abilities required to be a unified visual encoder. However, previous CLIP-based unified methods fail to balance understanding and reconstruction, leading to semantic degradation or inconsistent reconstructions. In contrast, we introduce a novel two-stage training scheme with a self-distillation strategy that progressively endows CLIP with high-fidelity reconstruction abilities while preserving its original comprehension performance. For enhanced reasoning and consistency in generation and editing, we further develop a dual-condition architecture built upon the MetaQuery framework. Our architecture jointly utilizes multimodal hidden states for rich contextual details and learnable query embeddings to harness the powerful reasoning abilities of Multimodal Large Language Models (MLLMs). Leveraging advanced image representation and architectural design, UniLIP demonstrates superior instruction following and edit fidelity. With only 1B and 3B parameters, UniLIP can outperform larger unified models such as BAGEL (7B) and Uniworld-V1 (12B), achieving state-of-the-art performance of 0.90 on GenEval, 0.63 on WISE, and 3.94 on ImgEdit. These results demonstrate that UniLIP successfully expands the application of CLIP, establishing its continuous features to not only serve as the optimal choice for understanding tasks but also achieve highly competitive performance in generation and editing tasks. Code and models are available at https://github.com/nnnth/UniLIP.