Bi-Level Optimization for Self-Supervised AI-Generated Face Detection

作者: Mian Zou, Nan Zhong, Baosheng Yu, Yibing Zhan, Kede Ma

分类: cs.CV

发布日期: 2025-07-30

💡 一句话要点

提出基于双层优化的自监督AI生成人脸检测方法,提升对未知生成器的泛化性。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: AI生成人脸检测 自监督学习 双层优化 视觉编码器 泛化能力

📋 核心要点

- 现有AI生成人脸检测器依赖于特定生成器合成的图像进行监督学习,泛化能力受限,难以应对不断涌现的生成技术。

- 论文提出一种基于双层优化的自监督学习方法,通过优化预训练任务的权重,使模型更好地适应AI生成人脸检测任务。

- 实验表明,该方法在单类和二分类设置中均优于现有方法,并对未见过的生成器表现出良好的泛化能力。

📝 摘要(中文)

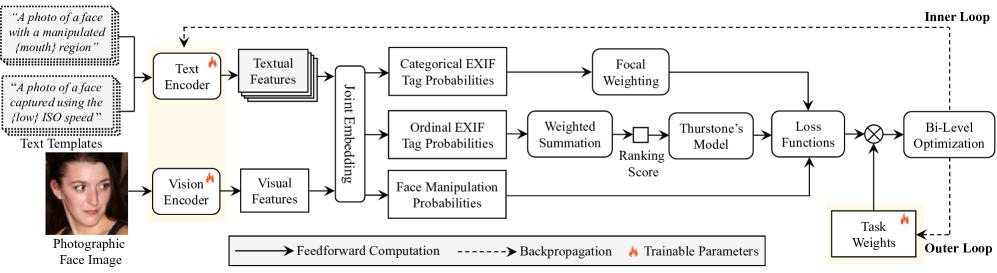

本文提出了一种基于双层优化的自监督方法,用于解决AI生成人脸检测器泛化性不足的问题。该方法首先在内循环中使用线性加权的预训练任务(包括EXIF标签分类、EXIF标签排序和人脸伪造检测)对视觉编码器进行预训练,仅使用真实人脸图像。然后,外循环优化这些预训练任务的相对权重,以增强对伪造人脸的粗粒度检测,以此作为识别AI生成人脸的代理任务。预训练完成后,编码器保持固定,并通过高斯混合模型或轻量级二层感知机将AI生成人脸检测为异常。实验结果表明,该检测器在单类和二分类设置中均显著优于现有方法,并对未见过的生成器表现出强大的泛化能力。

🔬 方法详解

问题定义:现有AI生成人脸检测方法依赖于特定生成器的数据进行训练,导致模型在面对新的、未知的生成器时,检测性能显著下降。因此,如何提高AI生成人脸检测器对未知生成器的泛化能力是本文要解决的核心问题。现有方法的痛点在于过度依赖特定生成器的特征,缺乏对AI生成人脸本质特征的有效学习。

核心思路:本文的核心思路是利用自监督学习,从真实人脸图像中学习通用的视觉特征,并通过双层优化框架,将自监督学习与AI生成人脸检测任务对齐。内循环进行视觉编码器的预训练,外循环优化预训练任务的权重,从而使编码器学习到的特征更适合用于区分真实人脸和AI生成人脸。这样设计的目的是避免模型过度拟合特定生成器的特征,从而提高泛化能力。

技术框架:整体框架包含两个主要阶段:预训练阶段和检测阶段。预训练阶段包括内循环和外循环。内循环使用真实人脸图像,通过多个线性加权的预训练任务(EXIF标签分类、EXIF标签排序、人脸伪造检测)训练视觉编码器。外循环优化这些预训练任务的权重,以最大化对伪造人脸的检测性能。检测阶段使用预训练好的编码器提取人脸特征,然后使用高斯混合模型或二层感知机进行AI生成人脸的检测。

关键创新:最重要的技术创新点在于双层优化框架,它将自监督学习与AI生成人脸检测任务紧密结合。通过外循环优化预训练任务的权重,使自监督学习过程更加有目标性,从而提高了模型对AI生成人脸的检测能力和泛化能力。与现有方法相比,该方法不需要依赖特定生成器的数据进行训练,而是通过学习真实人脸的通用特征来实现AI生成人脸的检测。

关键设计:内循环的预训练任务包括:(1) EXIF标签分类:预测图像的EXIF信息,如相机型号;(2) EXIF标签排序:对图像的EXIF信息进行排序,如曝光时间;(3) 人脸伪造检测:检测图像中是否存在人为的人脸篡改。外循环使用Adam优化器优化预训练任务的权重,目标是最大化对伪造人脸的检测准确率。检测阶段,高斯混合模型使用预训练编码器提取的特征进行训练,用于将AI生成人脸检测为异常值。二层感知机使用ReLU激活函数,用于二分类任务。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在各种AI生成人脸数据集上均取得了显著的性能提升。例如,在StyleGAN2-ADA数据集上,该方法的检测准确率比现有最佳方法提高了超过5%。此外,该方法还表现出强大的泛化能力,在未见过的生成器上也能保持较高的检测准确率,证明了其在实际应用中的潜力。

🎯 应用场景

该研究成果可应用于网络安全、身份验证、新闻真实性验证等领域。例如,可以用于检测社交媒体上的虚假人脸图像,防止恶意信息传播;也可以用于增强身份验证系统的安全性,防止AI生成人脸被用于欺诈活动。未来,该技术有望在更广泛的图像和视频内容安全领域发挥重要作用。

📄 摘要(原文)

AI-generated face detectors trained via supervised learning typically rely on synthesized images from specific generators, limiting their generalization to emerging generative techniques. To overcome this limitation, we introduce a self-supervised method based on bi-level optimization. In the inner loop, we pretrain a vision encoder only on photographic face images using a set of linearly weighted pretext tasks: classification of categorical exchangeable image file format (EXIF) tags, ranking of ordinal EXIF tags, and detection of artificial face manipulations. The outer loop then optimizes the relative weights of these pretext tasks to enhance the coarse-grained detection of manipulated faces, serving as a proxy task for identifying AI-generated faces. In doing so, it aligns self-supervised learning more closely with the ultimate goal of AI-generated face detection. Once pretrained, the encoder remains fixed, and AI-generated faces are detected either as anomalies under a Gaussian mixture model fitted to photographic face features or by a lightweight two-layer perceptron serving as a binary classifier. Extensive experiments demonstrate that our detectors significantly outperform existing approaches in both one-class and binary classification settings, exhibiting strong generalization to unseen generators.