Advancing Fetal Ultrasound Image Quality Assessment in Low-Resource Settings

作者: Dongli He, Hu Wang, Mohammad Yaqub

分类: cs.CV, cs.AI

发布日期: 2025-07-30

备注: Accepted to the MICCAI 2025 MIRASOL Workshop

🔗 代码/项目: GITHUB

💡 一句话要点

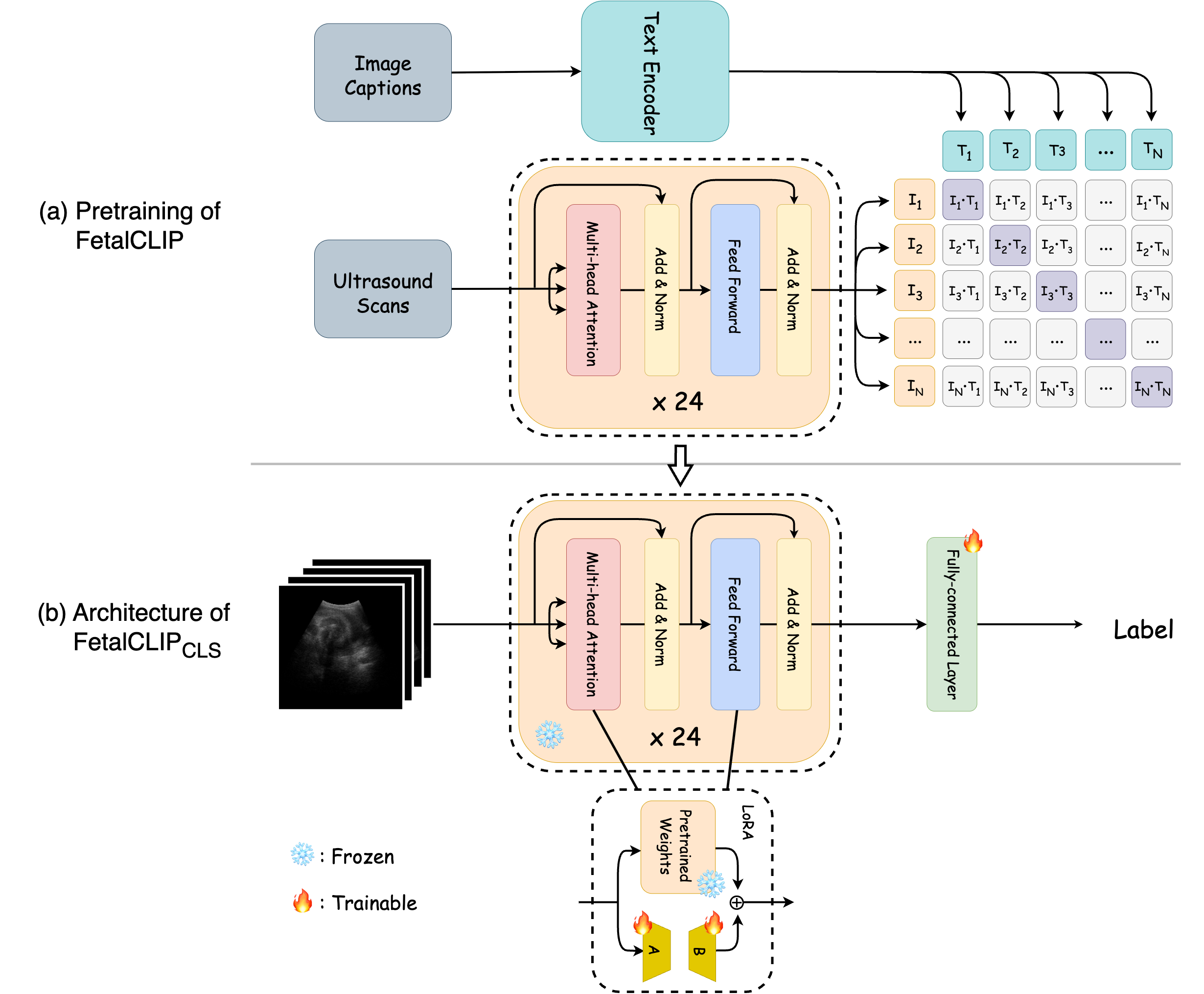

提出FetalCLIP$_{CLS}$,利用胎儿超声图像基础模型提升低资源环境下的图像质量评估。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 胎儿超声 图像质量评估 视觉-语言模型 低秩适应 参数高效微调

📋 核心要点

- 低收入国家缺乏训练有素的超声医师,导致难以获得高质量的胎儿超声图像,影响产前护理。

- 利用预训练的视觉-语言模型FetalCLIP,通过低秩适应(LoRA)进行微调,实现自动胎儿超声图像质量评估。

- 实验表明,FetalCLIP$_{CLS}$在ACOUSLIC-AI数据集上取得了最高的F1分数0.757,优于其他CNN和Transformer基线。

📝 摘要(中文)

准确的胎儿生物特征测量,如腹围,在产前护理中至关重要。然而,获得用于这些测量的高质量超声图像很大程度上取决于超声医师的专业知识,这在低收入国家由于训练有素的人员稀缺而构成重大挑战。为了解决这个问题,我们利用FetalCLIP,一个在超过21万个胎儿超声图像-文本对的精选数据集上预训练的视觉-语言模型,对盲扫超声数据执行自动胎儿超声图像质量评估(IQA)。我们引入了FetalCLIP${CLS}$,一个使用低秩适应(LoRA)从FetalCLIP改编的IQA模型,并在ACOUSLIC-AI数据集上针对六个CNN和Transformer基线对其进行评估。FetalCLIP${CLS}$实现了最高的F1分数0.757。此外,我们表明,当将改编的分割模型重新用于分类时,可以进一步提高性能,达到0.771的F1分数。我们的工作展示了胎儿超声基础模型的参数高效微调如何实现特定任务的适应,从而推进资源有限环境下的产前护理。实验代码可在https://github.com/donglihe-hub/FetalCLIP-IQA获得。

🔬 方法详解

问题定义:论文旨在解决低资源环境下,由于缺乏专业超声医师而导致的胎儿超声图像质量评估难题。现有方法依赖人工评估,效率低且主观性强,难以保证胎儿生物特征测量的准确性,进而影响产前护理质量。

核心思路:论文的核心思路是利用预训练的胎儿超声图像基础模型FetalCLIP,通过参数高效的微调方法(LoRA),将其适应于图像质量评估任务。这种方法避免了从头开始训练模型,降低了计算成本和数据需求,更适合资源有限的环境。

技术框架:整体框架包括以下几个步骤:1) 使用大规模胎儿超声图像-文本对数据集预训练FetalCLIP模型;2) 基于FetalCLIP,使用LoRA方法进行微调,得到FetalCLIP${CLS}$模型,用于图像质量分类;3) 将分割模型进行改造,用于分类任务,并评估其性能;4) 在ACOUSLIC-AI数据集上,将FetalCLIP${CLS}$与CNN和Transformer基线模型进行比较。

关键创新:论文的关键创新在于:1) 将视觉-语言模型FetalCLIP应用于胎儿超声图像质量评估;2) 使用LoRA进行参数高效微调,降低了模型训练的成本;3) 探索了将分割模型重新用于分类任务的可能性,并取得了较好的效果。与现有方法相比,该方法更高效、更易于部署,且对资源的需求更低。

关键设计:论文的关键设计包括:1) 使用超过21万个胎儿超声图像-文本对进行FetalCLIP的预训练;2) 使用LoRA进行微调,显著减少了需要训练的参数数量;3) 将分割模型输出的分割结果作为分类的特征,从而实现分割模型到分类模型的转换;4) 使用F1分数作为主要的评估指标,以衡量模型在图像质量评估任务中的性能。

🖼️ 关键图片

📊 实验亮点

实验结果表明,FetalCLIP$_{CLS}$在ACOUSLIC-AI数据集上取得了0.757的F1分数,显著优于六个CNN和Transformer基线模型。此外,将分割模型重新用于分类任务后,F1分数进一步提升至0.771,验证了该方法的有效性。这些结果表明,通过参数高效微调胎儿超声基础模型,可以有效提升图像质量评估的性能。

🎯 应用场景

该研究成果可应用于低收入国家和偏远地区的远程医疗,辅助缺乏经验的医护人员进行胎儿超声图像质量评估,提高产前诊断的准确性和效率。未来,该技术可集成到便携式超声设备中,实现实时图像质量反馈,从而改善孕妇的健康状况。

📄 摘要(原文)

Accurate fetal biometric measurements, such as abdominal circumference, play a vital role in prenatal care. However, obtaining high-quality ultrasound images for these measurements heavily depends on the expertise of sonographers, posing a significant challenge in low-income countries due to the scarcity of trained personnel. To address this issue, we leverage FetalCLIP, a vision-language model pretrained on a curated dataset of over 210,000 fetal ultrasound image-caption pairs, to perform automated fetal ultrasound image quality assessment (IQA) on blind-sweep ultrasound data. We introduce FetalCLIP${CLS}$, an IQA model adapted from FetalCLIP using Low-Rank Adaptation (LoRA), and evaluate it on the ACOUSLIC-AI dataset against six CNN and Transformer baselines. FetalCLIP${CLS}$ achieves the highest F1 score of 0.757. Moreover, we show that an adapted segmentation model, when repurposed for classification, further improves performance, achieving an F1 score of 0.771. Our work demonstrates how parameter-efficient fine-tuning of fetal ultrasound foundation models can enable task-specific adaptations, advancing prenatal care in resource-limited settings. The experimental code is available at: https://github.com/donglihe-hub/FetalCLIP-IQA.