Gems: Group Emotion Profiling Through Multimodal Situational Understanding

作者: Anubhav Kataria, Surbhi Madan, Shreya Ghosh, Tom Gedeon, Abhinav Dhall

分类: cs.CV, cs.LG

发布日期: 2025-07-30 (更新: 2026-01-12)

🔗 代码/项目: GITHUB

💡 一句话要点

GEMS:通过多模态情境理解进行群体情绪分析

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 群体情绪分析 多模态学习 情境理解 Swin-Transformer S3Attention VGAF-GEMS 情感计算

📋 核心要点

- 现有方法在多人情绪分析中,缺乏对个体、群体和事件等多层次情绪的综合理解,难以捕捉复杂社交场景。

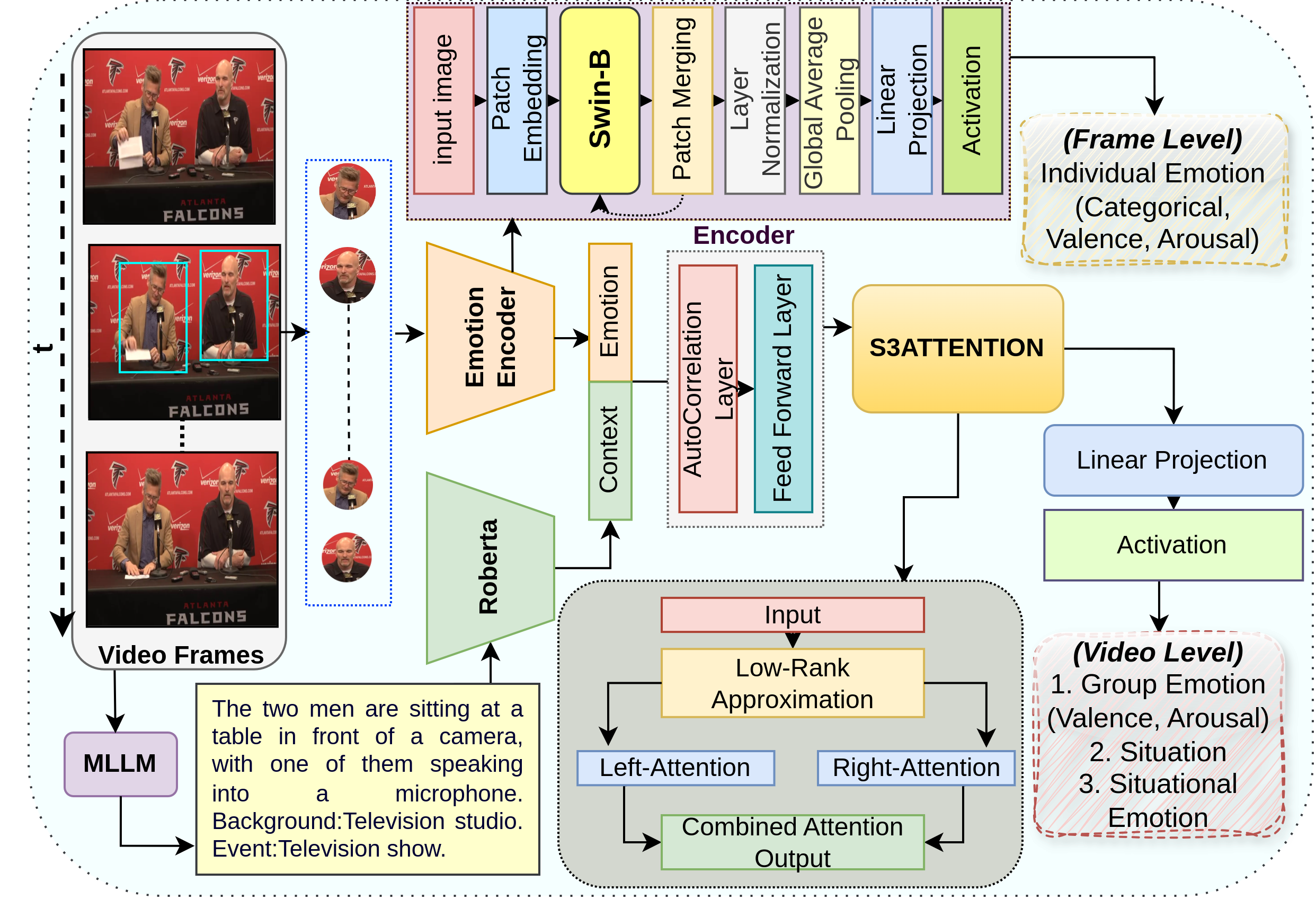

- GEMS模型利用多模态Swin-Transformer和S3Attention机制,整合场景、成员和上下文信息,实现联合情绪预测。

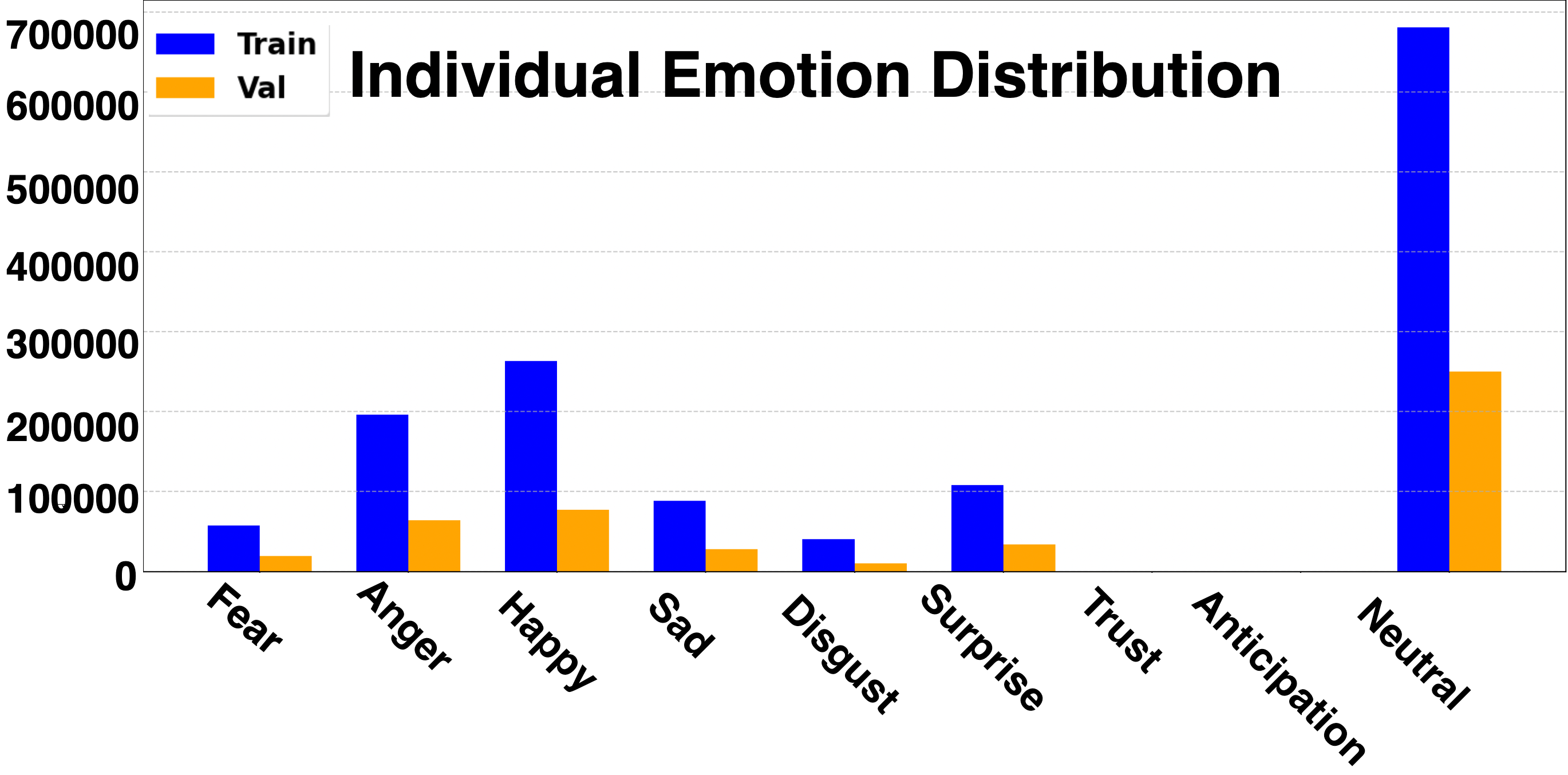

- 通过扩展VGAF数据集,构建VGAF-GEMS基准,GEMS在个体、群体和事件情绪预测上表现出优于现有模型的性能。

📝 摘要(中文)

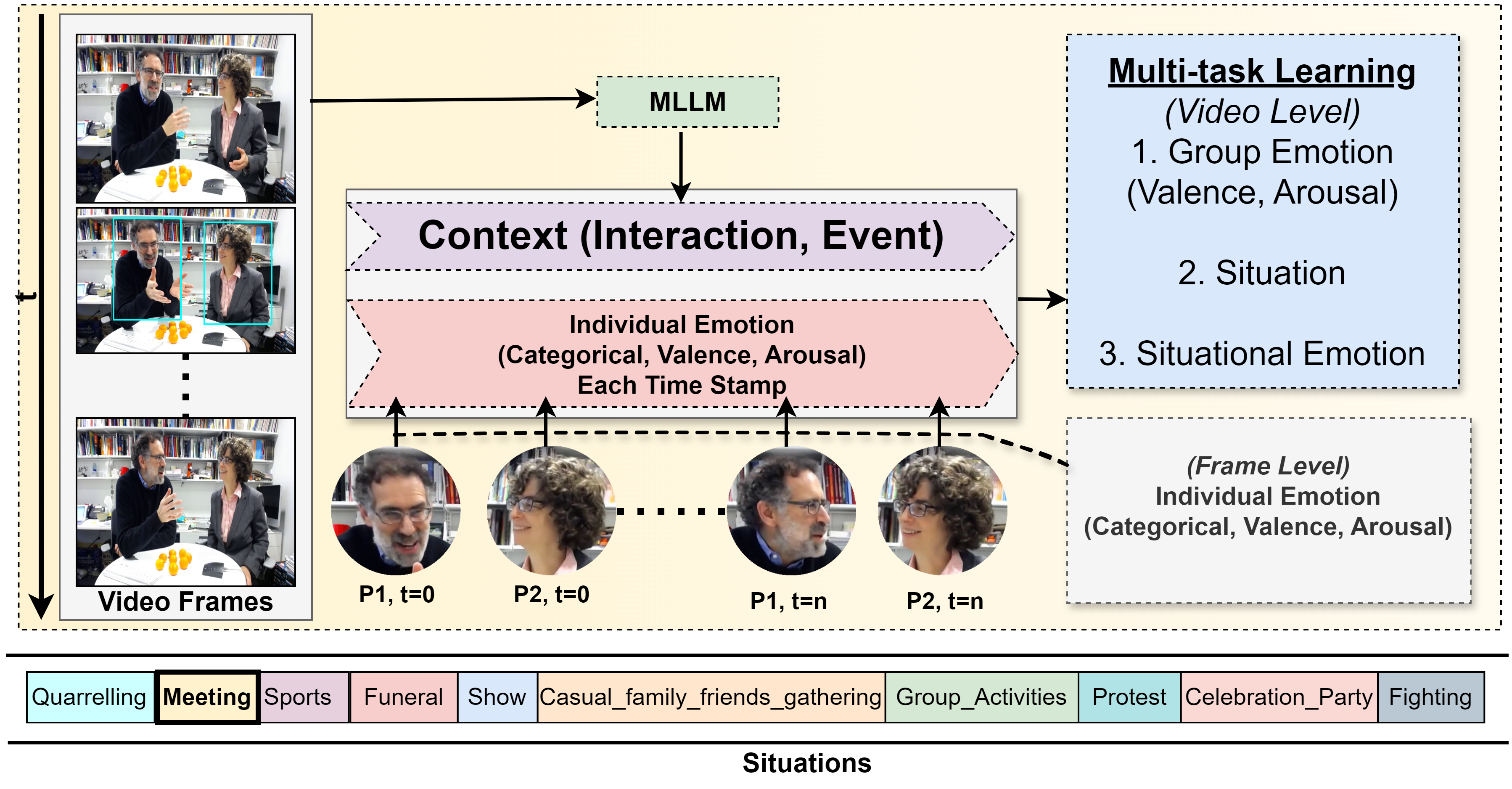

理解个体、群体和事件层面的情绪以及情境信息对于分析多人社交场景至关重要。本文将情绪理解定义为预测从细粒度的个体情绪到粗粒度的群体和事件层面情绪的任务。我们提出了GEMS,它利用基于多模态Swin-Transformer和S3Attention的架构,处理输入场景、群体成员和上下文信息以生成联合预测。现有的多人情绪相关基准主要关注基于时间的情绪感知和群体层面的原子交互。为此,我们扩展并提出了VGAF-GEMS,以便在现有VGAF数据集的群体层面注释之上提供更细粒度和整体的分析。GEMS旨在预测基本的离散和连续情绪(包括效价和唤醒),以及个体、群体和事件层面感知到的情绪。我们的基准测试工作将个体、群体和情境情绪反应整体地联系起来。与改进的现有最佳模型的定量和定性比较证明了GEMS框架在VGAF-GEMS基准测试中的有效性。我们相信这将为进一步的研究铺平道路。代码和数据可在https://github.com/katariaak579/GEMS 获取。

🔬 方法详解

问题定义:论文旨在解决多人社交场景中情绪理解的问题,现有方法主要关注原子交互和群体层面情绪,缺乏对个体、群体和事件等多层次情绪的综合分析,难以捕捉复杂情境下的细粒度情绪变化。

核心思路:论文的核心思路是将情绪理解建模为从细粒度个体情绪到粗粒度群体和事件情绪的预测任务。通过整合场景、群体成员和上下文信息,实现对多层次情绪的联合预测,从而更全面地理解社交场景中的情绪状态。

技术框架:GEMS框架主要包含以下模块:1) 多模态输入处理模块,用于提取场景、群体成员和上下文信息的多模态特征;2) 基于Swin-Transformer的特征编码模块,用于对多模态特征进行编码和融合;3) 基于S3Attention的情绪预测模块,用于预测个体、群体和事件层面的情绪。整体流程是:输入多模态数据 -> 特征提取 -> 特征编码与融合 -> 多层次情绪预测。

关键创新:论文的关键创新在于:1) 提出了基于多模态Swin-Transformer和S3Attention的GEMS模型,能够有效整合多模态信息并进行多层次情绪预测;2) 扩展了VGAF数据集,构建了VGAF-GEMS基准,为更细粒度和整体的情绪分析提供了数据支持;3) 将情绪理解建模为从个体到群体和事件的层次化预测任务,更符合人类认知过程。

关键设计:GEMS模型使用Swin-Transformer作为视觉特征提取器,利用其在图像识别领域的优势。S3Attention机制用于在不同模态和不同层次的特征之间建立关联。损失函数方面,可能采用了多任务学习的损失函数,同时优化个体、群体和事件层面的情绪预测。具体的参数设置和网络结构细节在论文中可能有所描述,但摘要中未明确提及。

🖼️ 关键图片

📊 实验亮点

GEMS框架在VGAF-GEMS基准测试中表现出优于现有模型的性能。虽然摘要中没有给出具体的性能数据和提升幅度,但强调了与改进的现有最佳模型的定量和定性比较,证明了GEMS框架的有效性。该框架能够更准确地预测个体、群体和事件层面的情绪,为多层次情绪分析提供了新的解决方案。

🎯 应用场景

该研究成果可应用于社交机器人、智能监控、在线教育等领域。例如,社交机器人可以利用GEMS模型理解用户的情绪状态,从而提供更个性化的服务。智能监控系统可以分析人群情绪,及时发现异常情况。在线教育平台可以根据学生的情绪反馈,调整教学策略,提高教学效果。未来,该研究有望推动人机交互和情感计算的发展。

📄 摘要(原文)

Understanding individual, group and event level emotions along with contextual information is crucial for analyzing a multi-person social situation. To achieve this, we frame emotion comprehension as the task of predicting fine-grained individual emotion to coarse grained group and event level emotion. We introduce GEMS that leverages a multimodal swin-transformer and S3Attention based architecture, which processes an input scene, group members, and context information to generate joint predictions. Existing multi-person emotion related benchmarks mainly focus on atomic interactions primarily based on emotion perception over time and group level. To this end, we extend and propose VGAF-GEMS to provide more fine grained and holistic analysis on top of existing group level annotation of VGAF dataset. GEMS aims to predict basic discrete and continuous emotions (including valence and arousal) as well as individual, group and event level perceived emotions. Our benchmarking effort links individual, group and situational emotional responses holistically. The quantitative and qualitative comparisons with adapted state-of-the-art models demonstrate the effectiveness of GEMS framework on VGAF-GEMS benchmarking. We believe that it will pave the way of further research. The code and data is available at: https://github.com/katariaak579/GEMS