From Seeing to Experiencing: Scaling Navigation Foundation Models with Reinforcement Learning

作者: Honglin He, Yukai Ma, Wayne Wu, Bolei Zhou

分类: cs.CV, cs.RO

发布日期: 2025-07-29

💡 一句话要点

提出S2E框架,通过强化学习提升导航基础模型在真实城市场景中的交互性和安全性。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱三:空间感知与语义 (Perception & Semantics) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 导航基础模型 强化学习 机器人学习 模拟环境 交互式学习

📋 核心要点

- 现有导航基础模型仅依赖离线数据,缺乏对行为后果的推理和交互适应能力,难以应对真实城市场景的复杂性。

- S2E框架结合视频预训练和强化学习后训练,利用Anchor-Guided Distribution Matching和Residual-Attention模块提升交互性和安全性。

- NavBench-GS基准测试表明,S2E能有效缓解离线数据扩展的收益递减,强化学习后训练优于监督微调。

📝 摘要(中文)

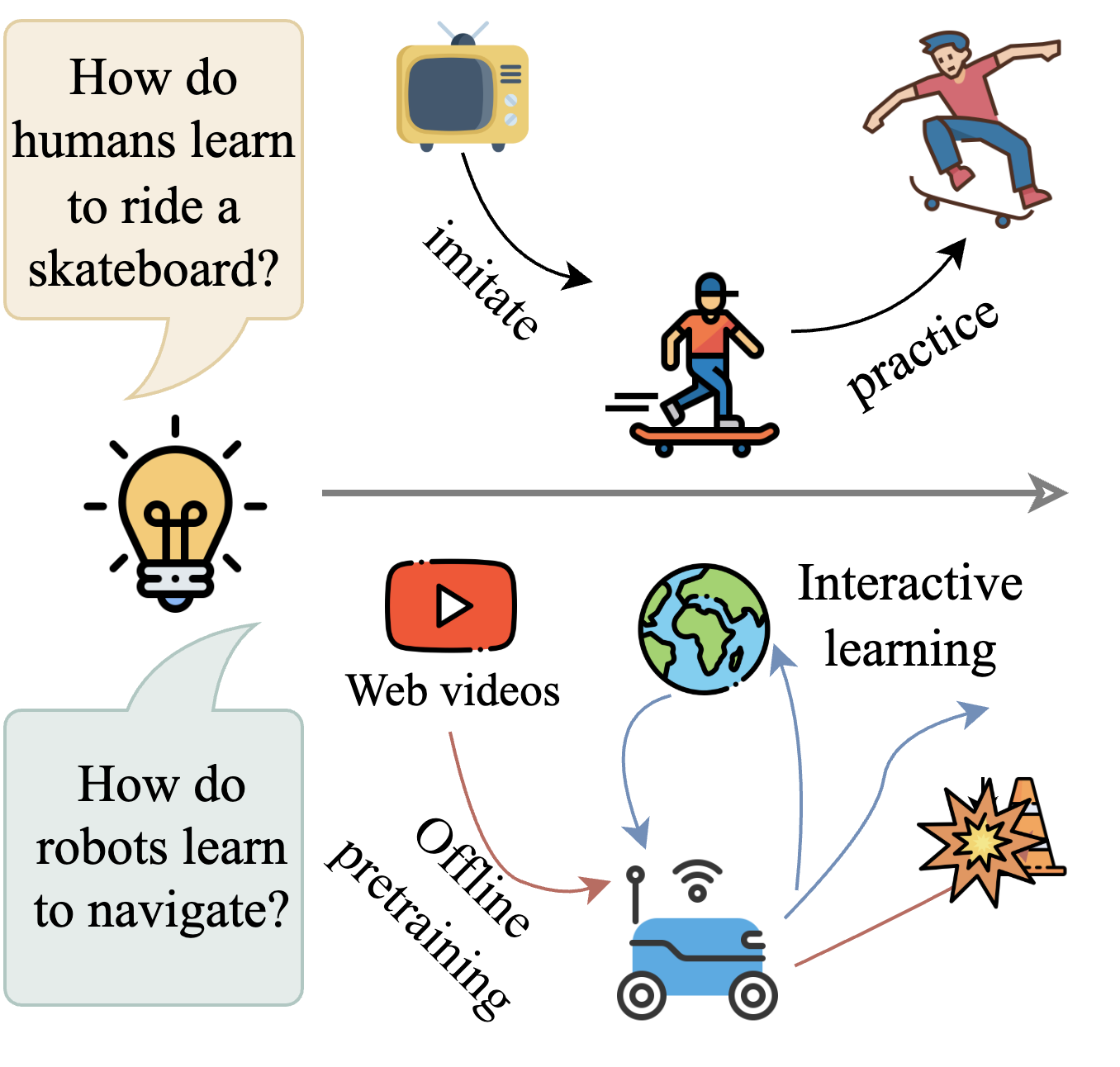

导航基础模型通过大规模网络数据训练,使智能体能够在不同环境和形态中泛化。然而,这些仅在离线数据上训练的模型,通常缺乏对行为后果的推理能力或通过反事实理解进行适应的能力。因此,它们在真实的城市导航中面临重大限制,在真实城市场景中,避开障碍物和行人等交互和安全行为至关重要。为了应对这些挑战,我们引入了Seeing-to-Experiencing (S2E) 框架,通过强化学习来扩展导航基础模型的能力。S2E结合了视频预训练和强化学习后训练的优势,既保持了从大规模真实世界视频中获得的泛化能力,又通过强化学习增强了其在模拟环境中的交互性。具体来说,我们引入了两项创新:一种Anchor-Guided Distribution Matching策略,通过基于锚点的监督来稳定学习并建模多样化的运动模式;以及一个Residual-Attention模块,从模拟环境中获得反应性行为,而不会消除模型的预训练知识。此外,我们建立了一个全面的端到端评估基准NavBench-GS,它建立在真实世界场景的光真实3DGS重建之上,并结合了物理交互,可以系统地评估导航基础模型的泛化性和安全性。大量的实验表明,S2E缓解了仅使用离线数据进行扩展时常见的收益递减现象。我们对强化学习与监督微调在机器人学习后训练中的优势进行了彻底的分析。我们的研究结果强调了整合交互式在线体验对于有效扩展机器人技术中的基础模型的关键作用。

🔬 方法详解

问题定义:现有导航基础模型主要依赖大规模离线数据进行训练,虽然具备一定的泛化能力,但在真实城市场景中,由于缺乏与环境的交互和对自身行为后果的理解,难以实现安全、高效的导航。现有方法的痛点在于无法有效利用在线交互数据提升模型的决策能力和安全性。

核心思路:S2E框架的核心思路是将大规模离线视频数据预训练的泛化能力与强化学习在线交互学习的决策能力相结合。通过预训练获得对环境的初步理解,再通过强化学习在模拟环境中进行交互,学习安全、高效的导航策略。这样既能保持模型的泛化性,又能提升其在复杂环境中的适应性。

技术框架:S2E框架主要包含两个阶段:预训练阶段和后训练阶段。在预训练阶段,模型在大规模真实世界视频数据上进行训练,学习环境的视觉表征和初步的导航策略。在后训练阶段,模型在模拟环境中通过强化学习进行训练,学习与环境的交互,优化导航策略。框架包含Anchor-Guided Distribution Matching模块和Residual-Attention模块,用于稳定学习和保留预训练知识。

关键创新:S2E框架的关键创新在于将离线预训练和在线强化学习相结合,并提出了Anchor-Guided Distribution Matching和Residual-Attention模块。Anchor-Guided Distribution Matching通过锚点引导分布匹配,稳定了强化学习过程,并建模了多样化的运动模式。Residual-Attention模块则在强化学习过程中保留了预训练的知识,避免了灾难性遗忘。

关键设计:Anchor-Guided Distribution Matching使用一组预定义的锚点来指导强化学习过程,通过最小化智能体行为分布与锚点分布之间的差异来稳定学习。Residual-Attention模块使用残差连接和注意力机制,将强化学习获得的策略与预训练的策略相结合,避免了完全覆盖预训练知识。

🖼️ 关键图片

📊 实验亮点

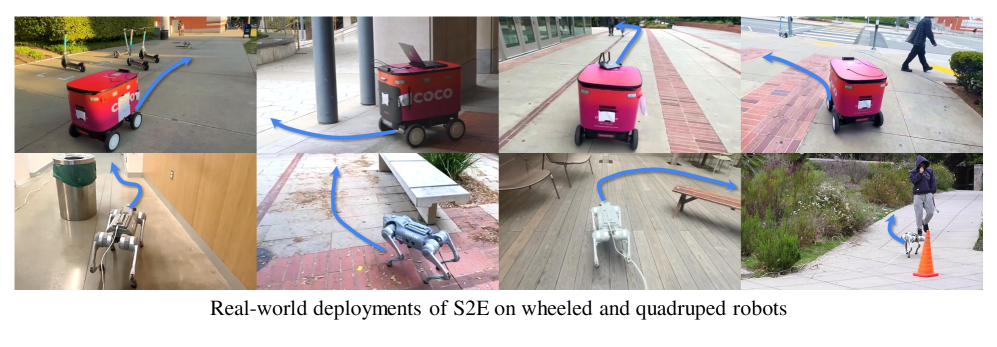

实验结果表明,S2E框架在NavBench-GS基准测试中取得了显著的性能提升,尤其是在安全性和泛化性方面。与仅使用离线数据训练的模型相比,S2E能够更好地适应新的环境和场景,并能有效避免碰撞等安全问题。研究还表明,强化学习后训练优于监督微调,能够更好地提升模型的交互能力。

🎯 应用场景

S2E框架可应用于自动驾驶、机器人导航、虚拟现实等领域。通过提升导航模型在复杂环境中的交互性和安全性,可以实现更智能、更可靠的自主导航系统。该研究对于推动机器人技术在真实世界中的应用具有重要意义,例如,可以用于开发更安全的自动驾驶汽车或更智能的家庭服务机器人。

📄 摘要(原文)

Navigation foundation models trained on massive webscale data enable agents to generalize across diverse environments and embodiments. However, these models trained solely on offline data, often lack the capacity to reason about the consequences of their actions or adapt through counterfactual understanding. They thus face significant limitations in the real-world urban navigation where interactive and safe behaviors, such as avoiding obstacles and moving pedestrians, are critical. To tackle these challenges, we introduce the Seeing-to-Experiencing framework to scale the capability of navigation foundation models with reinforcement learning. S2E combines the strengths of pre-training on videos and post-training through RL. It maintains the generalizability acquired from large-scale real-world videos while enhancing its interactivity through RL in simulation environments. Specifically, we introduce two innovations: an Anchor-Guided Distribution Matching strategy, which stabilizes learning and models diverse motion patterns through anchor-based supervision; and a Residual-Attention Module, which obtains reactive behaviors from simulation environments without erasing the model's pretrained knowledge. Moreover, we establish a comprehensive end-to-end evaluation benchmark, NavBench-GS, built on photorealistic 3DGS reconstructions of real-world scenes that incorporate physical interactions. It can systematically assess the generalizability and safety of navigation foundation models. Extensive experiments show that S2E mitigates the diminishing returns often seen when scaling with offline data alone. We perform a thorough analysis of the benefits of Reinforcement Learning compared to Supervised Fine-Tuning in the context of post-training for robot learning. Our findings emphasize the crucial role of integrating interactive online experiences to effectively scale foundation models in Robotics.