Unleashing the Power of Motion and Depth: A Selective Fusion Strategy for RGB-D Video Salient Object Detection

作者: Jiahao He, Daerji Suolang, Keren Fu, Qijun Zhao

分类: cs.CV

发布日期: 2025-07-29

备注: submitted to TMM on 11-Jun-2024, ID: MM-020522, still in peer review

🔗 代码/项目: GITHUB

💡 一句话要点

提出一种选择性跨模态融合框架SMFNet,用于RGB-D视频显著性目标检测,有效利用运动和深度信息。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: RGB-D视频 显著性目标检测 选择性融合 光流 深度信息 注意力机制 跨模态融合

📋 核心要点

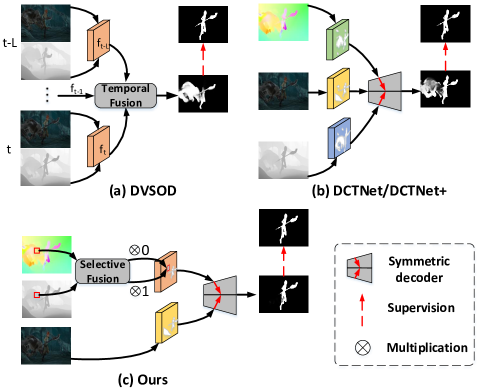

- 现有RGB-D VSOD方法平等对待光流和深度信息,忽略了它们在不同场景下的贡献差异,限制了性能。

- 提出选择性跨模态融合框架SMFNet,通过像素级选择性融合策略PSF,根据贡献自适应融合光流和深度。

- 在多个数据集上与19个SOTA模型进行对比,SMFNet取得了显著的性能提升,并公开了代码和基准。

📝 摘要(中文)

将显著性目标检测(SOD)应用于RGB-D视频是一项新兴任务,称为RGB-D视频显著性目标检测(VSOD),由于融合运动和深度信息能显著提升性能,并且RGB-D视频在日常生活中易于捕获,因此近年来受到越来越多的关注。现有的RGB-D VSOD模型在提取运动线索方面进行了不同的尝试,其中从光流中显式提取运动信息似乎是一种更有效且有前景的替代方案。尽管如此,仍然存在一个关键问题,即如何有效地利用光流和深度来辅助RGB模态进行SOD。先前的方法在模型设计方面总是平等地对待光流和深度,而没有明确考虑它们在个体场景中的不平等贡献,从而限制了运动和深度的潜力。为了解决这个问题并释放运动和深度的力量,我们提出了一种新的选择性跨模态融合框架(SMFNet)用于RGB-D VSOD,该框架结合了一种像素级选择性融合策略(PSF),该策略基于光流和深度的实际贡献实现最佳融合。此外,我们提出了一种多维选择性注意力模块(MSAM),以在多个维度上将PSF导出的融合特征与剩余的RGB模态集成,从而有效地增强特征表示以生成精细的特征。我们对SMFNet与19个最先进的模型在RDVS和DVisal数据集上进行了全面的评估,使该评估成为迄今为止最全面的RGB-D VSOD基准,并且还证明了SMFNet优于其他模型。同时,在包含合成深度的五个视频基准数据集上的评估也验证了SMFNet的有效性。我们的代码和基准测试结果可在https://github.com/Jia-hao999/SMFNet上公开获得。

🔬 方法详解

问题定义:RGB-D视频显著性目标检测旨在从RGB图像、深度图和光流信息中准确识别并分割出视频中的显著性目标。现有方法通常平等地融合深度和光流信息,忽略了它们在不同场景下的重要性差异。例如,在运动模糊或光照变化剧烈的场景中,光流可能不可靠,而深度信息可能更为重要。这种一视同仁的处理方式限制了模型性能的提升。

核心思路:论文的核心思路是根据深度和光流信息在不同场景下的实际贡献,进行选择性的融合。通过学习一个像素级别的选择性融合策略,模型能够自适应地选择更可靠的模态信息,从而提高显著性目标检测的准确性。这种选择性融合能够充分利用不同模态的优势,避免不可靠模态信息的干扰。

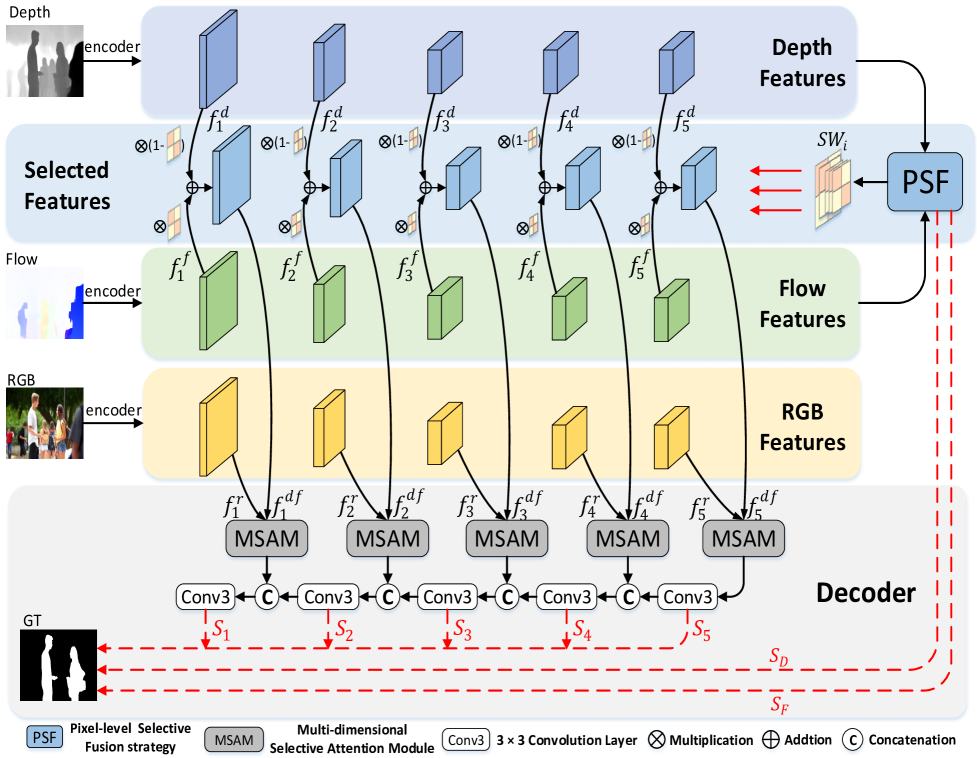

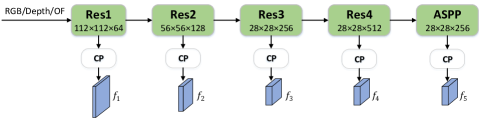

技术框架:SMFNet的整体框架包括以下几个主要模块:1) 特征提取模块:分别提取RGB图像、深度图和光流信息的特征。2) 像素级选择性融合模块(PSF):根据深度和光流的贡献,自适应地融合这两种模态的特征。3) 多维选择性注意力模块(MSAM):将融合后的特征与RGB特征进行融合,并利用注意力机制增强特征表示。4) 显著性预测模块:根据融合后的特征预测显著性图。

关键创新:论文的关键创新在于提出了像素级选择性融合策略(PSF)。PSF模块能够学习一个权重图,用于控制深度和光流信息的融合比例。权重图的生成依赖于深度和光流的局部特征,从而使得模型能够根据场景自适应地选择更可靠的模态信息。这种选择性融合策略能够有效地提高模型对复杂场景的鲁棒性。

关键设计:PSF模块使用一个小型卷积神经网络来预测深度和光流的融合权重。MSAM模块采用多分支结构,分别在通道维度、空间维度和像素维度上进行注意力学习。损失函数包括二元交叉熵损失和IoU损失,用于优化显著性预测结果。具体参数设置和网络结构细节可在论文原文和公开代码中找到。

🖼️ 关键图片

📊 实验亮点

SMFNet在RDVS和DVisal数据集上进行了广泛的实验,并与19个最先进的模型进行了比较。实验结果表明,SMFNet在各项指标上均优于其他模型,取得了显著的性能提升。例如,在RDVS数据集上,SMFNet的F-measure指标达到了0.85,显著优于其他SOTA模型。同时,在包含合成深度的五个视频基准数据集上的评估也验证了SMFNet的有效性。

🎯 应用场景

该研究成果可应用于视频监控、机器人导航、自动驾驶等领域。在视频监控中,可以利用显著性目标检测技术自动识别和跟踪可疑目标。在机器人导航和自动驾驶中,可以帮助机器人或车辆更好地理解周围环境,从而做出更安全的决策。此外,该技术还可以应用于图像编辑、视频压缩等领域。

📄 摘要(原文)

Applying salient object detection (SOD) to RGB-D videos is an emerging task called RGB-D VSOD and has recently gained increasing interest, due to considerable performance gains of incorporating motion and depth and that RGB-D videos can be easily captured now in daily life. Existing RGB-D VSOD models have different attempts to derive motion cues, in which extracting motion information explicitly from optical flow appears to be a more effective and promising alternative. Despite this, there remains a key issue that how to effectively utilize optical flow and depth to assist the RGB modality in SOD. Previous methods always treat optical flow and depth equally with respect to model designs, without explicitly considering their unequal contributions in individual scenarios, limiting the potential of motion and depth. To address this issue and unleash the power of motion and depth, we propose a novel selective cross-modal fusion framework (SMFNet) for RGB-D VSOD, incorporating a pixel-level selective fusion strategy (PSF) that achieves optimal fusion of optical flow and depth based on their actual contributions. Besides, we propose a multi-dimensional selective attention module (MSAM) to integrate the fused features derived from PSF with the remaining RGB modality at multiple dimensions, effectively enhancing feature representation to generate refined features. We conduct comprehensive evaluation of SMFNet against 19 state-of-the-art models on both RDVS and DVisal datasets, making the evaluation the most comprehensive RGB-D VSOD benchmark up to date, and it also demonstrates the superiority of SMFNet over other models. Meanwhile, evaluation on five video benchmark datasets incorporating synthetic depth validates the efficacy of SMFNet as well. Our code and benchmark results are made publicly available at https://github.com/Jia-hao999/SMFNet.