MSGCoOp: Multiple Semantic-Guided Context Optimization for Few-Shot Learning

作者: Zhaolong Wang, Tongfeng Sun, Mingzheng Du, Yachao Huang

分类: cs.CV

发布日期: 2025-07-29

🔗 代码/项目: GITHUB

💡 一句话要点

提出MSGCoOp框架,通过多语义引导上下文优化提升小样本学习泛化能力。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 小样本学习 提示学习 视觉语言模型 上下文优化 语义引导

📋 核心要点

- 现有prompt learning方法在小样本学习中泛化能力不足,容易过拟合已见类别,遗忘通用知识。

- MSGCoOp框架通过多组语义引导的上下文向量,学习更丰富的类别语义信息,提升泛化能力。

- 实验结果表明,MSGCoOp在多个数据集上显著提升了base-to-novel的泛化性能,并具有更强的鲁棒性。

📝 摘要(中文)

本文提出了一种多语义引导上下文优化(MSGCoOp)框架,旨在提升小样本学习的泛化能力,同时保持计算效率。该方法利用一组并行的可学习上下文向量来捕获不同的语义方面。为了丰富这些提示,引入了一种语义引导机制,使其与大型语言模型(LLM)自动生成的全面类描述对齐。此外,多样性正则化损失鼓励提示学习互补和正交的特征,防止它们坍缩为冗余表示。在11个基准数据集上的大量实验表明,MSGCoOp显著提高了base-to-novel泛化性能,相对于强大的KgCoOp基线,平均谐波平均值提高了1.10%。该方法还在跨域泛化任务中表现出增强的鲁棒性。

🔬 方法详解

问题定义:现有基于CLIP的prompt learning方法在小样本学习中,容易过拟合已见类别,导致在新类别上的泛化能力较差。同时,为了提升泛化能力,一些方法引入了复杂的架构或大量的计算开销,限制了实际应用。

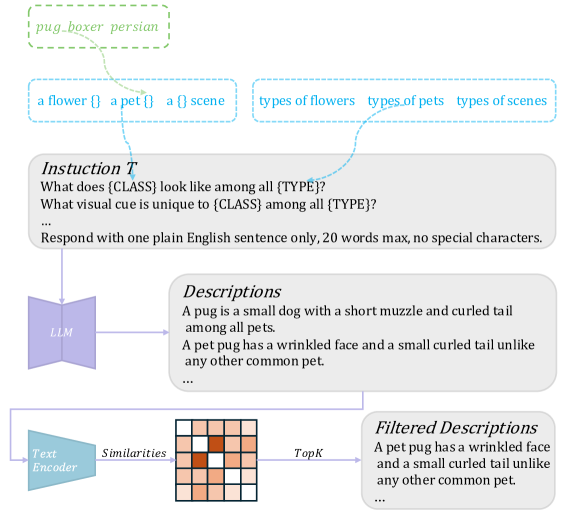

核心思路:MSGCoOp的核心思路是通过学习多个具有不同语义侧重的上下文向量,来更全面地捕捉类别的语义信息。利用大型语言模型生成类别的详细描述,并以此引导上下文向量的学习,避免向量坍缩到单一语义表示。同时,引入多样性正则化损失,鼓励上下文向量学习互补的特征。

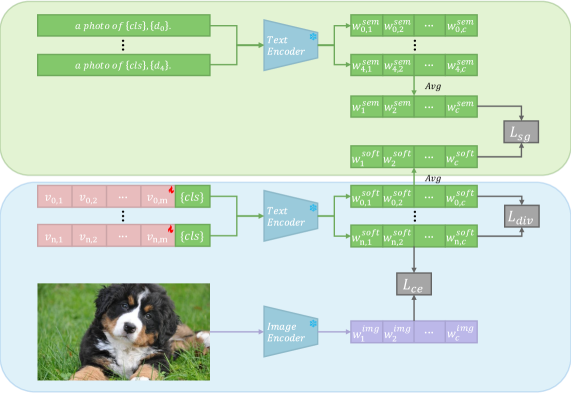

技术框架:MSGCoOp框架主要包含以下几个模块:1) 并行可学习上下文向量:使用多个可学习的上下文向量,每个向量负责捕捉不同的语义信息。2) 语义引导机制:利用LLM生成类别的详细描述,并使用这些描述来引导上下文向量的学习,使其与类别语义对齐。3) 多样性正则化损失:引入多样性正则化损失,鼓励上下文向量学习互补和正交的特征,防止向量坍缩。

关键创新:MSGCoOp的关键创新在于:1) 提出了一种多语义引导的上下文优化方法,能够更全面地捕捉类别的语义信息。2) 利用大型语言模型生成类别的详细描述,并以此引导上下文向量的学习,避免了人工设计的局限性。3) 引入多样性正则化损失,鼓励上下文向量学习互补的特征,提升了模型的泛化能力。

关键设计:MSGCoOp的关键设计包括:1) 上下文向量的数量:实验中探索了不同数量的上下文向量对性能的影响。2) 语义引导机制的实现:使用LLM生成的类别描述,并通过计算相似度来引导上下文向量的学习。3) 多样性正则化损失的计算方式:使用余弦相似度来衡量上下文向量之间的相似性,并以此作为正则化项。

🖼️ 关键图片

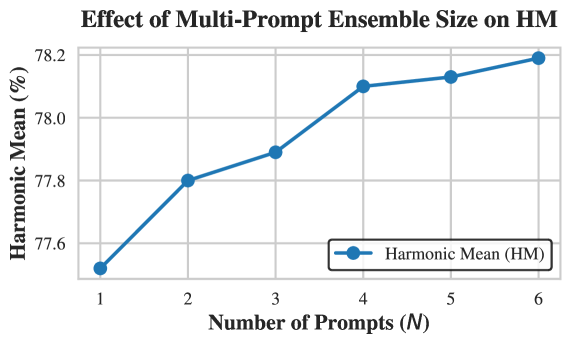

📊 实验亮点

MSGCoOp在11个基准数据集上进行了广泛的实验,结果表明其显著提高了base-to-novel的泛化性能。相对于强大的KgCoOp基线,平均谐波平均值提高了1.10%。此外,MSGCoOp在跨域泛化任务中也表现出增强的鲁棒性,证明了其良好的泛化能力。

🎯 应用场景

MSGCoOp框架可应用于图像分类、目标检测等计算机视觉任务中的小样本学习场景。例如,在医疗影像分析中,可以利用少量病例数据对新的疾病进行诊断。在自动驾驶领域,可以快速适应新的交通场景和物体识别。该研究有助于降低模型对大量标注数据的依赖,加速AI技术在各个领域的落地。

📄 摘要(原文)

Vision-language pre-trained models (VLMs) such as CLIP have demonstrated remarkable zero-shot generalization, and prompt learning has emerged as an efficient alternative to full fine-tuning. However, existing methods often struggle with generalization to novel classes, a phenomenon attributed to overfitting on seen classes and forgetting general knowledge. Furthermore, recent approaches that improve generalization often introduce complex architectures or heavy computational overhead. In this paper, we propose a Multiple Semantic-Guided Context Optimization (MSGCoOp) framework to enhance few-shot generalization while maintaining computational efficiency. Our approach leverages an ensemble of parallel learnable context vectors to capture diverse semantic aspects. To enrich these prompts, we introduce a semantic guidance mechanism that aligns them with comprehensive class descriptions automatically generated by a Large Language Model (LLM). Furthermore, a diversity regularization loss encourages the prompts to learn complementary and orthogonal features, preventing them from collapsing into redundant representations. Extensive experiments on 11 benchmark datasets show that MSGCoOp significantly improves performance on base-to-novel generalization, achieving an average harmonic mean improvement of 1.10\% over the strong KgCoOp baseline. Our method also demonstrates enhanced robustness in cross-domain generalization tasks. Our code is avaliable at: \href{https://github.com/Rain-Bus/MSGCoOp}{https://github.com/Rain-Bus/MSGCoOp}.