EMIT: Enhancing MLLMs for Industrial Anomaly Detection via Difficulty-Aware GRPO

作者: Wei Guan, Jun Lan, Jian Cao, Hao Tan, Huijia Zhu, Weiqiang Wang

分类: cs.CV

发布日期: 2025-07-29

💡 一句话要点

EMIT:通过难度感知GRPO增强MLLM在工业异常检测中的性能

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 工业异常检测 多模态大语言模型 难度感知学习 分组相对策略优化 少样本学习

📋 核心要点

- 现有MLLM在工业异常检测中效果有限,缺乏领域特定适配。

- EMIT框架通过难度感知GRPO增强MLLM,利用GPT生成文本描述弥补缺陷图像。

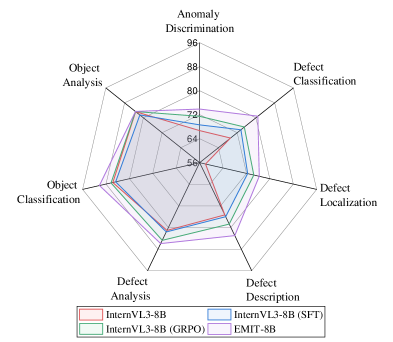

- 实验表明,EMIT在MMAD基准上显著提升了MLLM的IAD性能,平均提升7.77%。

📝 摘要(中文)

工业异常检测(IAD)在维护制造系统的安全性和可靠性方面起着至关重要的作用。虽然多模态大型语言模型(MLLM)展现出强大的视觉-语言推理能力,但如果没有针对特定领域的适配,它们在IAD中的有效性仍然有限。本文提出了EMIT,一个统一的框架,通过难度感知的分组相对策略优化(GRPO)来增强MLLM在IAD中的性能。EMIT构建了一个多任务IAD数据集,并利用GPT生成的对象文本描述来弥补缺失的缺陷图像。对于少样本异常检测,它集成了软提示和热图引导的对比嵌入,这些嵌入来自patch级别的比较。为了更好地处理困难数据样本,即MLLM难以生成正确答案的情况,我们提出了一种难度感知的GRPO,它通过结合响应重采样策略来确保采样响应中包含正确的答案,以及一种优势重加权机制来加强从此类困难数据样本中的学习。在MMAD基准上的大量实验表明,EMIT显著提高了MLLM的IAD性能,在七个任务中实现了比基础模型(InternVL3-8B)平均7.77%的改进。

🔬 方法详解

问题定义:工业异常检测旨在识别制造系统中不符合预期标准的异常情况。现有的多模态大型语言模型(MLLM)虽然具备强大的视觉-语言推理能力,但在直接应用于工业异常检测时,由于缺乏领域知识和对困难样本的处理能力,性能受到限制。尤其是在缺陷图像数据不足的情况下,MLLM难以准确识别和定位异常。

核心思路:EMIT的核心思路是通过难度感知的分组相对策略优化(GRPO)来提升MLLM在工业异常检测中的性能。该方法通过构建多任务数据集、利用GPT生成文本描述来增强数据,并引入难度感知机制来重点学习困难样本,从而使MLLM更好地适应工业异常检测任务。

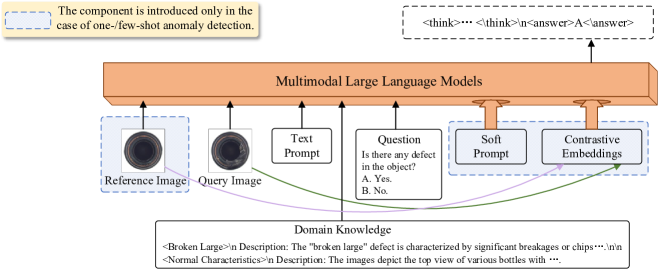

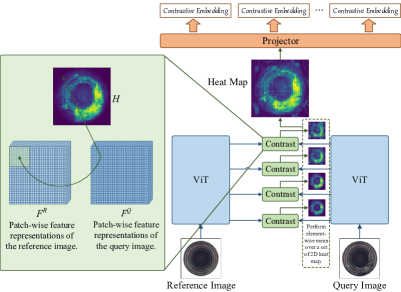

技术框架:EMIT框架包含以下几个主要模块:1) 多任务IAD数据集构建,包含多种工业异常检测任务。2) GPT文本描述生成,用于补充缺陷图像的缺失。3) 软提示和热图引导的对比嵌入,用于少样本异常检测。4) 难度感知的GRPO,用于优化MLLM的策略,使其更好地处理困难样本。整体流程是先对MLLM进行预训练,然后使用EMIT框架进行微调,最后在测试集上评估性能。

关键创新:EMIT的关键创新在于难度感知的GRPO。传统的GRPO在优化过程中,可能会忽略那些MLLM难以给出正确答案的困难样本。而EMIT通过响应重采样策略,确保采样响应中包含正确的答案,并通过优势重加权机制,加强从此类困难数据样本中的学习。这种难度感知的优化方式能够显著提升MLLM在工业异常检测中的性能。

关键设计:难度感知的GRPO包含两个关键设计:一是响应重采样策略,该策略根据MLLM生成答案的置信度,对响应进行重采样,确保采样响应中包含正确的答案。二是优势重加权机制,该机制根据样本的难度,对优势函数进行加权,使得MLLM更加关注困难样本的学习。此外,软提示和热图引导的对比嵌入也起到了重要作用,它们能够帮助MLLM更好地理解图像中的异常信息。

🖼️ 关键图片

📊 实验亮点

EMIT在MMAD基准测试中表现出色,相较于基础模型InternVL3-8B,在七个不同的工业异常检测任务上实现了平均7.77%的性能提升。这一显著的提升表明EMIT框架能够有效地增强MLLM在工业异常检测中的能力,尤其是在处理困难样本和数据不足的情况下。

🎯 应用场景

EMIT框架可广泛应用于各种工业制造场景,例如产品质量检测、设备故障诊断和生产流程优化。通过提升MLLM在工业异常检测中的性能,EMIT能够帮助企业提高生产效率、降低运营成本,并确保产品质量和生产安全。未来,该研究可进一步扩展到其他领域,例如医疗影像分析和智能交通监控。

📄 摘要(原文)

Industrial anomaly detection (IAD) plays a crucial role in maintaining the safety and reliability of manufacturing systems. While multimodal large language models (MLLMs) show strong vision-language reasoning abilities, their effectiveness in IAD remains limited without domain-specific adaptation. In this work, we propose EMIT, a unified framework that enhances MLLMs for IAD via difficulty-aware group relative policy optimization (GRPO). EMIT constructs a multi-task IAD dataset and utilizes GPT-generated object text descriptions to compensate for missing defective images. For few-shot anomaly detection, it integrates a soft prompt and heatmap-guided contrastive embeddings derived from patch-level comparisons. To better handle difficult data samples, i.e., cases where the MLLM struggles to generate correct answers, we propose a difficulty-aware GRPO that extends the original GRPO by incorporating a response resampling strategy to ensure the inclusion of correct answers in the sampled responses, as well as an advantage reweighting mechanism to strengthen learning from such difficult data samples. Extensive experiments on the MMAD benchmark demonstrate that EMIT significantly enhances the IAD performance of MLLMs, achieving an average improvement of 7.77\% over the base model (InternVL3-8B) across seven tasks.