HAMLET-FFD: Hierarchical Adaptive Multi-modal Learning Embeddings Transformation for Face Forgery Detection

作者: Jialei Cui, Jianwei Du, Yanzhe Li, Lei Gao, Hui Jiang, Chenfu Bao

分类: cs.CV, cs.AI

发布日期: 2025-07-28

💡 一句话要点

提出HAMLET-FFD,通过层级自适应多模态学习解决人脸伪造检测的跨域泛化问题。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 人脸伪造检测 跨域泛化 多模态学习 视觉-语言模型 对比学习

📋 核心要点

- 现有的人脸伪造检测方法泛化能力差,难以应对跨域场景,主要原因是依赖于简单的分类目标。

- HAMLET-FFD通过双向跨模态推理,将视觉证据与概念线索结合,迭代评估真实性,提升模型泛化能力。

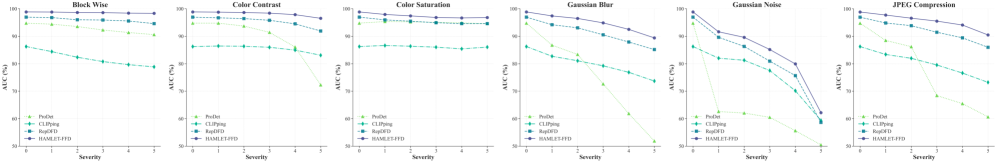

- 实验表明,HAMLET-FFD在多个基准测试中表现出卓越的泛化能力,并在细粒度伪影识别方面有突出表现。

📝 摘要(中文)

人脸操纵技术的快速发展对人脸伪造检测提出了严峻的挑战:跨域泛化能力。传统方法依赖于简单的分类目标,通常无法学习到领域不变的表示。我们提出了HAMLET-FFD,一个受认知启发的层级自适应多模态学习框架,通过双向跨模态推理来应对这一挑战。HAMLET-FFD建立在对比视觉-语言模型(如CLIP)的基础上,引入了一个知识提炼循环,通过整合视觉证据和概念线索来迭代评估真实性,模拟专家法医分析。一个关键创新是双向融合机制,其中文本真实性嵌入引导分层视觉特征的聚合,而调制后的视觉特征细化文本嵌入以生成图像自适应提示。这个闭环过程逐步将视觉观察与语义先验对齐,以增强真实性评估。HAMLET-FFD的设计冻结了所有预训练参数,作为一个外部插件,保留了CLIP的原始能力。大量实验证明了其在多个基准测试中对未见过的操纵的卓越泛化能力,视觉分析揭示了嵌入之间的分工,不同的表示专门用于细粒度的伪影识别。

🔬 方法详解

问题定义:论文旨在解决人脸伪造检测中的跨域泛化问题。现有方法通常在特定数据集上表现良好,但在面对新的、未知的伪造技术或数据集时,性能会显著下降。这是因为这些方法过度拟合了训练数据的特定模式,缺乏对伪造本质的理解,难以提取领域不变的特征表示。

核心思路:HAMLET-FFD的核心思路是模拟人类专家进行人脸鉴别时的认知过程,即结合视觉信息和语义知识进行综合判断。通过构建一个知识提炼循环,迭代地评估人脸的真实性,从而提高模型对不同伪造技术的适应能力。利用对比视觉-语言模型CLIP的强大表征能力,并在此基础上进行改进,实现视觉和文本信息的有效融合。

技术框架:HAMLET-FFD的整体框架包含以下几个主要模块:1) 视觉特征提取模块:利用预训练的CLIP提取人脸图像的层级视觉特征。2) 文本嵌入模块:利用CLIP的文本编码器生成文本真实性嵌入。3) 双向融合模块:该模块是HAMLET-FFD的核心,通过双向融合机制,文本真实性嵌入引导视觉特征的聚合,同时调制后的视觉特征细化文本嵌入,生成图像自适应提示。4) 真实性评估模块:基于融合后的视觉和文本特征,评估人脸的真实性。整个过程形成一个闭环,迭代地提炼知识,提高检测精度。

关键创新:HAMLET-FFD的关键创新在于其双向融合机制和知识提炼循环。双向融合机制使得视觉和文本信息能够相互指导和增强,从而更好地捕捉人脸伪造的细微特征。知识提炼循环则模拟了人类专家不断学习和改进鉴别能力的过程,提高了模型的泛化能力。此外,HAMLET-FFD的设计保留了CLIP的原始能力,作为一个外部插件,易于集成到现有系统中。

关键设计:HAMLET-FFD冻结了预训练CLIP的所有参数,避免了对CLIP原始能力的破坏。双向融合模块的具体实现方式未知,但可以推测使用了注意力机制或其他融合策略,以实现视觉和文本信息的有效交互。损失函数的设计也未知,但可能包括对比损失、分类损失等,以促进视觉和文本特征的对齐和真实性评估。

🖼️ 关键图片

📊 实验亮点

HAMLET-FFD在多个基准测试中表现出卓越的泛化能力,能够有效检测未见过的伪造技术。实验结果表明,该方法在跨域场景下的性能显著优于传统方法。视觉分析揭示了嵌入之间的分工,不同的表示专门用于细粒度的伪影识别,证明了HAMLET-FFD能够有效地捕捉人脸伪造的细微特征。

🎯 应用场景

HAMLET-FFD在信息安全、社会安全等领域具有广泛的应用前景。它可以用于检测社交媒体上的虚假人脸信息,防止恶意传播和网络诈骗。在金融领域,可以用于身份验证,防止欺诈行为。此外,该技术还可以应用于司法鉴定,辅助案件侦破。未来,随着人脸伪造技术的不断发展,HAMLET-FFD有望成为一种重要的安全保障手段。

📄 摘要(原文)

The rapid evolution of face manipulation techniques poses a critical challenge for face forgery detection: cross-domain generalization. Conventional methods, which rely on simple classification objectives, often fail to learn domain-invariant representations. We propose HAMLET-FFD, a cognitively inspired Hierarchical Adaptive Multi-modal Learning framework that tackles this challenge via bidirectional cross-modal reasoning. Building on contrastive vision-language models such as CLIP, HAMLET-FFD introduces a knowledge refinement loop that iteratively assesses authenticity by integrating visual evidence with conceptual cues, emulating expert forensic analysis. A key innovation is a bidirectional fusion mechanism in which textual authenticity embeddings guide the aggregation of hierarchical visual features, while modulated visual features refine text embeddings to generate image-adaptive prompts. This closed-loop process progressively aligns visual observations with semantic priors to enhance authenticity assessment. By design, HAMLET-FFD freezes all pretrained parameters, serving as an external plugin that preserves CLIP's original capabilities. Extensive experiments demonstrate its superior generalization to unseen manipulations across multiple benchmarks, and visual analyses reveal a division of labor among embeddings, with distinct representations specializing in fine-grained artifact recognition.