SaLF: Sparse Local Fields for Multi-Sensor Rendering in Real-Time

作者: Yun Chen, Matthew Haines, Jingkang Wang, Krzysztof Baron-Lis, Sivabalan Manivasagam, Ze Yang, Raquel Urtasun

分类: cs.CV, cs.RO

发布日期: 2025-07-24

💡 一句话要点

提出SaLF:一种支持实时多传感器渲染的稀疏局部场表示方法

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 传感器模拟 神经辐射场 3D高斯溅射 自动驾驶 体素表示

📋 核心要点

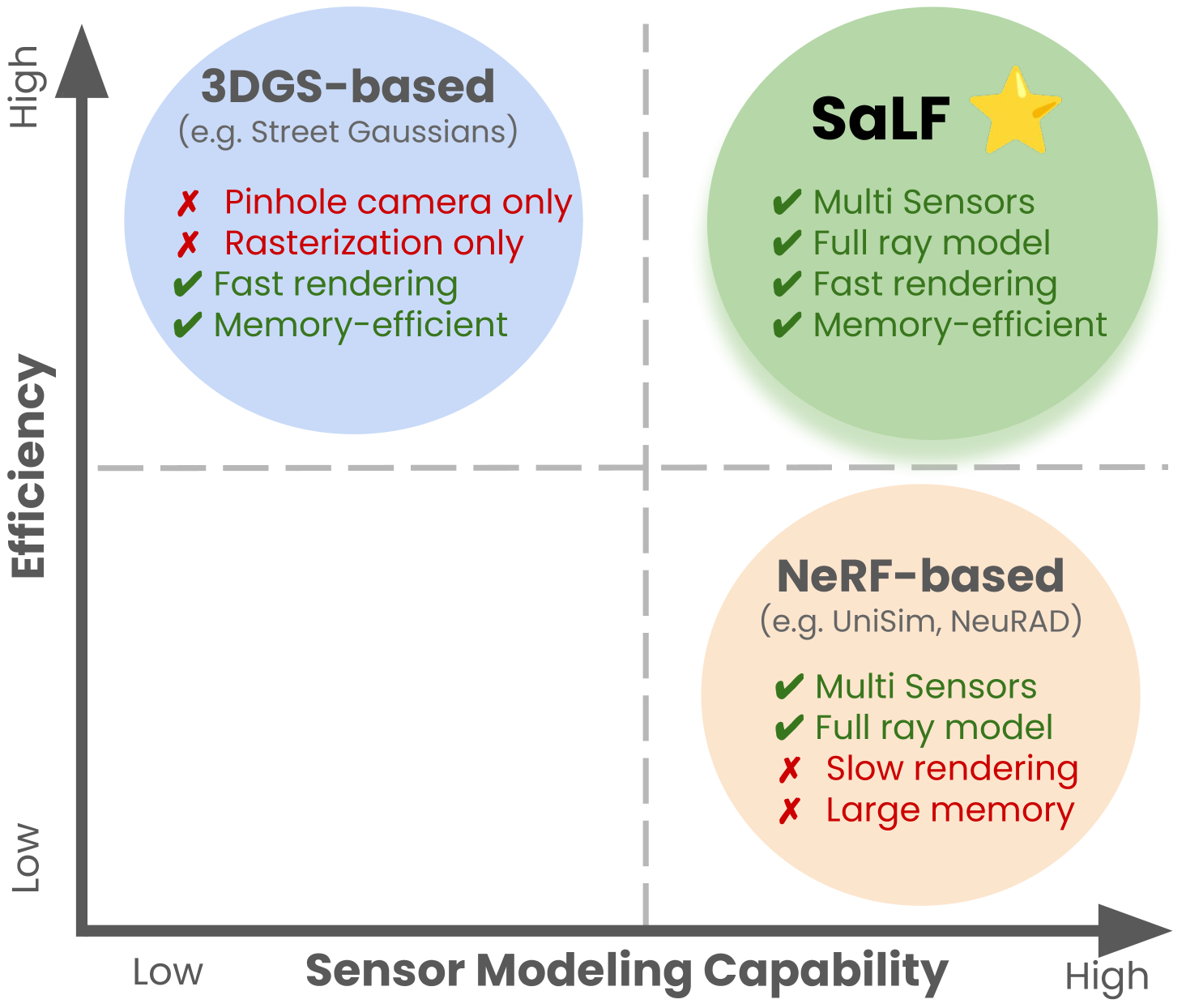

- 现有NeRF方法渲染速度慢,3DGS方法仅限于针孔相机,且两者表示与渲染耦合,缺乏互操作性。

- SaLF将场景表示为稀疏的3D体素基元集合,每个体素是一个局部隐式场,支持光栅化和光线追踪。

- SaLF训练速度快(<30分钟),渲染效率高(相机50+ FPS,激光雷达600+ FPS),并支持多种传感器。

📝 摘要(中文)

高保真度的相机和激光雷达等光基传感器的模拟对于安全和精确的自动驾驶测试至关重要。基于神经辐射场(NeRF)的方法通过隐式表示的光线投射重建传感器观测,已经展示了驾驶场景的精确模拟,但训练和渲染速度慢,限制了规模化应用。3D高斯溅射(3DGS)通过光栅化实现了更快的训练和渲染速度,但主要限于针孔相机传感器,阻碍了其在真实多传感器自动驾驶评估中的应用。此外,NeRF和3DGS都将表示与渲染过程耦合(隐式网络用于基于光线的评估,粒子用于光栅化),阻碍了互操作性,这对于通用性至关重要。本文提出了一种新的体素表示方法——稀疏局部场(SaLF),它支持光栅化和光线追踪。SaLF将体积表示为一组稀疏的3D体素基元,其中每个体素都是一个局部隐式场。SaLF具有快速训练(<30分钟)和渲染能力(相机50+ FPS,激光雷达600+ FPS),具有自适应剪枝和密集化功能,可以轻松处理大型场景,并且可以支持非针孔相机和旋转激光雷达。实验表明,SaLF具有与现有自动驾驶传感器模拟方法相似的真实感,同时提高了效率并增强了功能,从而实现了更具可扩展性的模拟。

🔬 方法详解

问题定义:现有基于NeRF和3DGS的传感器模拟方法存在训练和渲染速度慢、传感器类型受限以及表示与渲染过程耦合等问题。这些限制阻碍了自动驾驶场景下大规模、多传感器融合的仿真测试。

核心思路:SaLF的核心思路是将场景表示为一组稀疏的3D体素基元,每个体素内部使用局部隐式场进行建模。这种方式既能利用体素结构的快速光栅化能力,又能借助隐式场的灵活性来表示复杂的几何和材质属性。通过稀疏化处理,可以有效减少计算量,提高渲染效率。

技术框架:SaLF的整体框架包括以下几个主要阶段:1) 数据采集:利用多传感器系统(如相机和激光雷达)获取场景数据。2) 体素初始化:将场景划分为一组稀疏的3D体素。3) 局部隐式场建模:在每个体素内部,训练一个局部隐式场来表示该体素内的几何和材质属性。4) 渲染:利用光栅化或光线追踪技术,将体素和局部隐式场渲染成图像或点云。5) 自适应优化:根据渲染结果,对体素进行剪枝和密集化,以优化场景表示。

关键创新:SaLF的关键创新在于将稀疏体素结构与局部隐式场相结合。这种混合表示方法既能实现快速渲染,又能保持较高的场景表示精度。此外,SaLF还支持多种传感器类型,包括非针孔相机和旋转激光雷达,使其能够应用于更广泛的自动驾驶场景。

关键设计:SaLF的关键设计包括:1) 稀疏体素结构:采用八叉树等数据结构来管理体素,实现高效的体素查询和更新。2) 局部隐式场:使用小型神经网络来表示每个体素内部的几何和材质属性。3) 自适应剪枝和密集化:根据体素的渲染贡献度,动态调整体素的密度。4) 损失函数:采用光度损失和深度损失等多种损失函数来优化局部隐式场。

🖼️ 关键图片

📊 实验亮点

SaLF在自动驾驶场景的传感器模拟中表现出显著的性能优势。实验结果表明,SaLF的训练时间小于30分钟,相机渲染速度超过50 FPS,激光雷达渲染速度超过600 FPS。与现有方法相比,SaLF在保持相似真实感的同时,显著提高了渲染效率,并支持多种传感器类型。

🎯 应用场景

SaLF可应用于自动驾驶系统的仿真测试、虚拟现实和增强现实等领域。通过高效率、高保真度的传感器模拟,SaLF能够帮助开发者更快速、更安全地测试和验证自动驾驶算法,降低开发成本,加速自动驾驶技术的落地。此外,SaLF还可用于生成逼真的虚拟环境,提升VR/AR用户的沉浸式体验。

📄 摘要(原文)

High-fidelity sensor simulation of light-based sensors such as cameras and LiDARs is critical for safe and accurate autonomy testing. Neural radiance field (NeRF)-based methods that reconstruct sensor observations via ray-casting of implicit representations have demonstrated accurate simulation of driving scenes, but are slow to train and render, hampering scale. 3D Gaussian Splatting (3DGS) has demonstrated faster training and rendering times through rasterization, but is primarily restricted to pinhole camera sensors, preventing usage for realistic multi-sensor autonomy evaluation. Moreover, both NeRF and 3DGS couple the representation with the rendering procedure (implicit networks for ray-based evaluation, particles for rasterization), preventing interoperability, which is key for general usage. In this work, we present Sparse Local Fields (SaLF), a novel volumetric representation that supports rasterization and raytracing. SaLF represents volumes as a sparse set of 3D voxel primitives, where each voxel is a local implicit field. SaLF has fast training (<30 min) and rendering capabilities (50+ FPS for camera and 600+ FPS LiDAR), has adaptive pruning and densification to easily handle large scenes, and can support non-pinhole cameras and spinning LiDARs. We demonstrate that SaLF has similar realism as existing self-driving sensor simulation methods while improving efficiency and enhancing capabilities, enabling more scalable simulation. https://waabi.ai/salf/