Object segmentation in the wild with foundation models: application to vision assisted neuro-prostheses for upper limbs

作者: Bolutife Atoki, Jenny Benois-Pineau, Renaud Péteri, Fabien Baldacci, Aymar de Rugy

分类: cs.CV

发布日期: 2025-07-24

💡 一句话要点

利用基础模型和眼动注视提示,提升复杂场景下神经假肢的物体分割性能

🎯 匹配领域: 支柱六:视频提取与匹配 (Video Extraction) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 物体分割 基础模型 眼动追踪 神经假肢 SAM 视觉辅助 RoboFlow

📋 核心要点

- 现有物体分割方法在复杂、无约束的真实场景中表现不佳,尤其是在神经假肢等应用中。

- 论文提出利用预训练的基础模型SAM,结合眼动注视信息生成提示,引导模型进行物体分割。

- 通过在Grasping-in-the-Wild数据集上的实验,验证了该方法在真实场景下的有效性,IoU提升显著。

📝 摘要(中文)

本文研究了如何利用基础模型解决语义物体分割问题。研究重点在于,经过大量多样物体训练的基础模型,能否在不针对特定日常物体图像进行微调的情况下,在高度杂乱的视觉场景中执行物体分割。这种“in the wild”的场景设定源于视觉引导的上肢神经假肢的应用需求。我们提出了一种基于眼动注视生成提示的方法,以指导Segment Anything Model (SAM) 在我们的分割场景中工作,并针对以自我为中心的视觉数据对其进行微调。在Grasping-in-the-Wild语料库的真实世界挑战性数据上的评估结果表明,我们的方法在IoU分割质量指标上提高了高达0.51个点。该数据集已在RoboFlow平台(https://universe.roboflow.com/iwrist/grasping-in-the-wild)上提供。

🔬 方法详解

问题定义:论文旨在解决复杂、无约束的真实场景下的物体分割问题,特别是针对上肢神经假肢的应用。现有方法在处理此类场景时,由于光照变化、遮挡、背景干扰等因素,分割精度较低,难以满足神经假肢的控制需求。

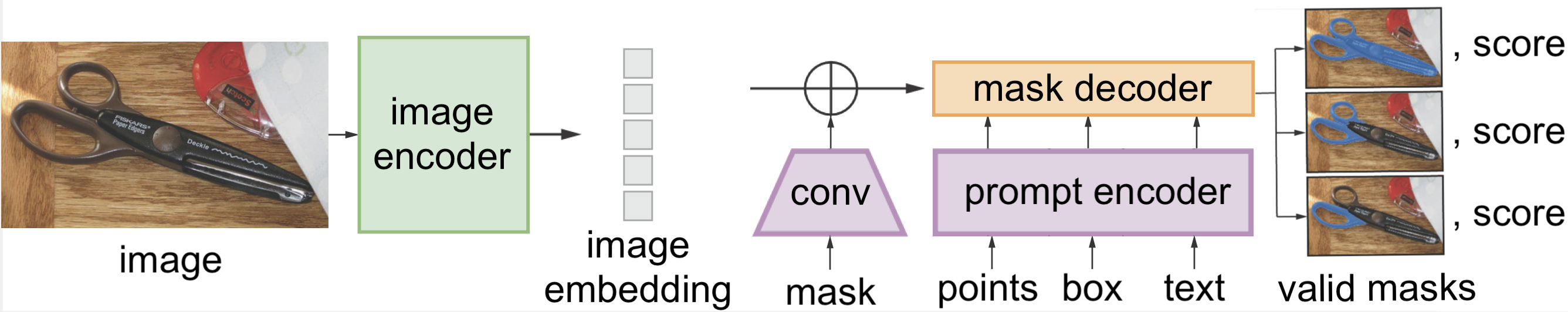

核心思路:论文的核心思路是利用预训练的Segment Anything Model (SAM) 的强大泛化能力,结合眼动追踪技术获取的注视信息,生成有效的分割提示。通过眼动注视,可以确定用户感兴趣的物体区域,从而引导SAM进行更精确的分割。

技术框架:整体框架包括以下几个主要步骤:1) 获取以自我为中心的视觉数据;2) 利用眼动追踪技术获取用户的注视点;3) 基于注视点生成SAM的分割提示;4) 使用SAM进行物体分割;5) 在特定数据集上对SAM进行微调,以进一步提升分割性能。

关键创新:论文的关键创新在于将眼动追踪技术与基础模型SAM相结合,用于解决真实场景下的物体分割问题。通过眼动注视生成提示,可以有效地引导SAM关注用户感兴趣的区域,从而提高分割精度。此外,针对特定应用场景对SAM进行微调,进一步提升了模型的性能。

关键设计:论文中,眼动注视点被用于生成SAM的分割提示,具体实现方式未知。SAM的微调过程可能涉及到特定的损失函数和优化策略,但具体细节未在摘要中提及。数据集 Grasping-in-the-Wild 被用于评估和微调模型。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在Grasping-in-the-Wild数据集上取得了显著的性能提升,IoU指标提高了高达0.51个点。这表明该方法在真实、复杂的场景下具有良好的分割效果,能够有效提升神经假肢的控制精度。

🎯 应用场景

该研究成果可应用于视觉辅助的上肢神经假肢控制,帮助残疾人士更好地抓取和操作物体。此外,该方法还可以扩展到其他需要精确物体分割的领域,如机器人导航、自动驾驶、增强现实等。通过结合眼动追踪和基础模型,可以实现更智能、更自然的交互体验。

📄 摘要(原文)

In this work, we address the problem of semantic object segmentation using foundation models. We investigate whether foundation models, trained on a large number and variety of objects, can perform object segmentation without fine-tuning on specific images containing everyday objects, but in highly cluttered visual scenes. The ''in the wild'' context is driven by the target application of vision guided upper limb neuroprostheses. We propose a method for generating prompts based on gaze fixations to guide the Segment Anything Model (SAM) in our segmentation scenario, and fine-tune it on egocentric visual data. Evaluation results of our approach show an improvement of the IoU segmentation quality metric by up to 0.51 points on real-world challenging data of Grasping-in-the-Wild corpus which is made available on the RoboFlow Platform (https://universe.roboflow.com/iwrist/grasping-in-the-wild)