MVG4D: Image Matrix-Based Multi-View and Motion Generation for 4D Content Creation from a Single Image

作者: DongFu Yin, Xiaotian Chen, Fei Richard Yu, Xuanchen Li, Xinhao Zhang

分类: cs.CV

发布日期: 2025-07-24 (更新: 2025-07-31)

💡 一句话要点

MVG4D:基于图像矩阵的多视角与运动生成,实现单图驱动的4D内容创建

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics) 支柱四:生成式动作 (Generative Motion)

关键词: 4D内容生成 多视角合成 高斯溅射 时间一致性 单图重建 动态场景 图像矩阵 AR/VR

📋 核心要点

- 现有4D内容生成方法在时间一致性、几何保真度和视觉真实感方面存在不足,尤其是在处理运动不连续和背景退化问题时。

- MVG4D通过图像矩阵模块合成时空一致的多视角图像,为4D高斯溅射提供丰富的监督信号,从而优化4D场景的重建。

- 实验结果表明,MVG4D在多个指标上优于现有方法,显著减少了闪烁伪影,并提升了AR/VR体验的沉浸感。

📝 摘要(中文)

本文提出了一种名为MVG4D的新框架,旨在从单张静态图像生成动态4D内容,它结合了多视角合成与4D高斯溅射(4D GS)。MVG4D的核心在于图像矩阵模块,该模块能够合成时间上连贯、空间上多样的多视角图像,为下游的3D和4D重建提供丰富的监督信号。这些多视角图像被用于优化3D高斯点云,并通过轻量级的形变网络将其扩展到时间域。该方法有效地增强了时间一致性、几何保真度和视觉真实感,解决了先前基于4D GS的方法中存在的运动不连续和背景退化等关键问题。在Objaverse数据集上的大量实验表明,MVG4D在CLIP-I、PSNR、FVD和时间效率方面均优于最先进的基线方法。尤其显著的是,它减少了闪烁伪影,并锐化了跨视角和时间的结构细节,从而实现了更具沉浸感的AR/VR体验。MVG4D为从最少输入进行高效且可控的4D生成开辟了新的方向。

🔬 方法详解

问题定义:论文旨在解决从单张图像生成高质量、时间一致的动态4D内容的问题。现有方法,特别是基于4D高斯溅射的方法,在处理复杂运动和长时间序列时,容易出现时间不一致性(如闪烁伪影)和几何失真,导致视觉效果不佳。

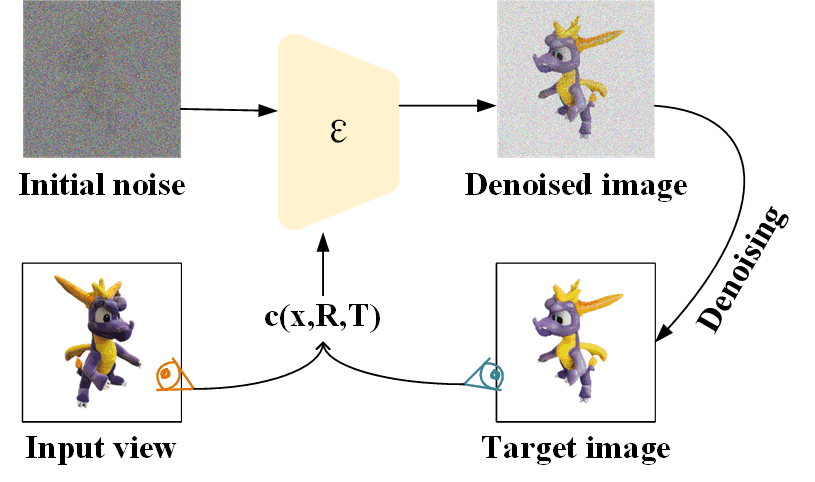

核心思路:论文的核心思路是利用多视角合成来增强4D重建的监督信息。通过从单张图像生成多个视角下的图像序列,可以为4D高斯溅射提供更丰富的几何和运动信息,从而提高重建的质量和时间一致性。这种方法类似于从多个角度观察物体,从而更好地理解其3D结构和运动。

技术框架:MVG4D框架主要包含两个阶段:1) 多视角图像生成阶段:使用图像矩阵模块从单张输入图像生成时间连贯且空间多样的多视角图像序列。2) 4D重建阶段:利用生成的多视角图像作为监督信号,优化3D高斯点云,并通过轻量级的形变网络将其扩展到时间域,最终得到动态4D场景。

关键创新:该方法最重要的创新在于图像矩阵模块的设计,它能够有效地生成时间一致的多视角图像,为后续的4D重建提供高质量的监督信号。与直接优化4D高斯溅射的方法相比,MVG4D通过多视角一致性约束,显著提高了重建的时间稳定性和几何准确性。

关键设计:图像矩阵模块的具体实现细节未知,但可以推测其可能采用了生成对抗网络(GAN)或扩散模型等技术,以生成逼真的多视角图像。形变网络的设计目标是学习3D高斯点云随时间的形变,可能采用了轻量级的神经网络结构,以减少计算量并提高时间效率。损失函数的设计可能包括多视角一致性损失、图像重建损失和时间平滑损失等,以保证生成结果的质量和时间一致性。

🖼️ 关键图片

📊 实验亮点

MVG4D在Objaverse数据集上取得了显著的性能提升,在CLIP-I、PSNR和FVD等指标上均优于现有方法。尤其值得注意的是,MVG4D能够有效地减少闪烁伪影,并锐化结构细节,从而显著提升了生成4D内容的视觉质量和时间一致性。实验结果表明,MVG4D为高效且可控的4D内容生成提供了一种新的解决方案。

🎯 应用场景

MVG4D技术在AR/VR内容创作、游戏开发、电影特效等领域具有广泛的应用前景。它可以帮助用户从单张照片快速生成动态3D模型,用于创建沉浸式体验或虚拟现实场景。此外,该技术还可以应用于机器人导航、自动驾驶等领域,用于生成动态环境模型,提高系统的感知能力。

📄 摘要(原文)

Advances in generative modeling have significantly enhanced digital content creation, extending from 2D images to complex 3D and 4D scenes. Despite substantial progress, producing high-fidelity and temporally consistent dynamic 4D content remains a challenge. In this paper, we propose MVG4D, a novel framework that generates dynamic 4D content from a single still image by combining multi-view synthesis with 4D Gaussian Splatting (4D GS). At its core, MVG4D employs an image matrix module that synthesizes temporally coherent and spatially diverse multi-view images, providing rich supervisory signals for downstream 3D and 4D reconstruction. These multi-view images are used to optimize a 3D Gaussian point cloud, which is further extended into the temporal domain via a lightweight deformation network. Our method effectively enhances temporal consistency, geometric fidelity, and visual realism, addressing key challenges in motion discontinuity and background degradation that affect prior 4D GS-based methods. Extensive experiments on the Objaverse dataset demonstrate that MVG4D outperforms state-of-the-art baselines in CLIP-I, PSNR, FVD, and time efficiency. Notably, it reduces flickering artifacts and sharpens structural details across views and time, enabling more immersive AR/VR experiences. MVG4D sets a new direction for efficient and controllable 4D generation from minimal inputs.