WaveMamba: Wavelet-Driven Mamba Fusion for RGB-Infrared Object Detection

作者: Haodong Zhu, Wenhao Dong, Linlin Yang, Hong Li, Yuguang Yang, Yangyang Ren, Qingcheng Zhu, Zichao Feng, Changbai Li, Shaohui Lin, Runqi Wang, Xiaoyan Luo, Baochang Zhang

分类: cs.CV, cs.MM

发布日期: 2025-07-24

期刊: ICCV, 2025

💡 一句话要点

WaveMamba:基于小波变换和Mamba融合的RGB-红外目标检测方法

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: RGB-红外目标检测 跨模态融合 小波变换 Mamba架构 频率域特征 深度学习 目标检测

📋 核心要点

- 现有RGB-红外目标检测方法难以有效融合两种模态的互补信息,尤其是在频率域特征的利用上。

- WaveMamba通过DWT分解图像,在频率域进行特征融合,并利用Mamba架构进行低频特征的深度融合。

- 实验结果表明,WaveMamba在多个数据集上显著提升了目标检测的精度,平均mAP提升4.5%。

📝 摘要(中文)

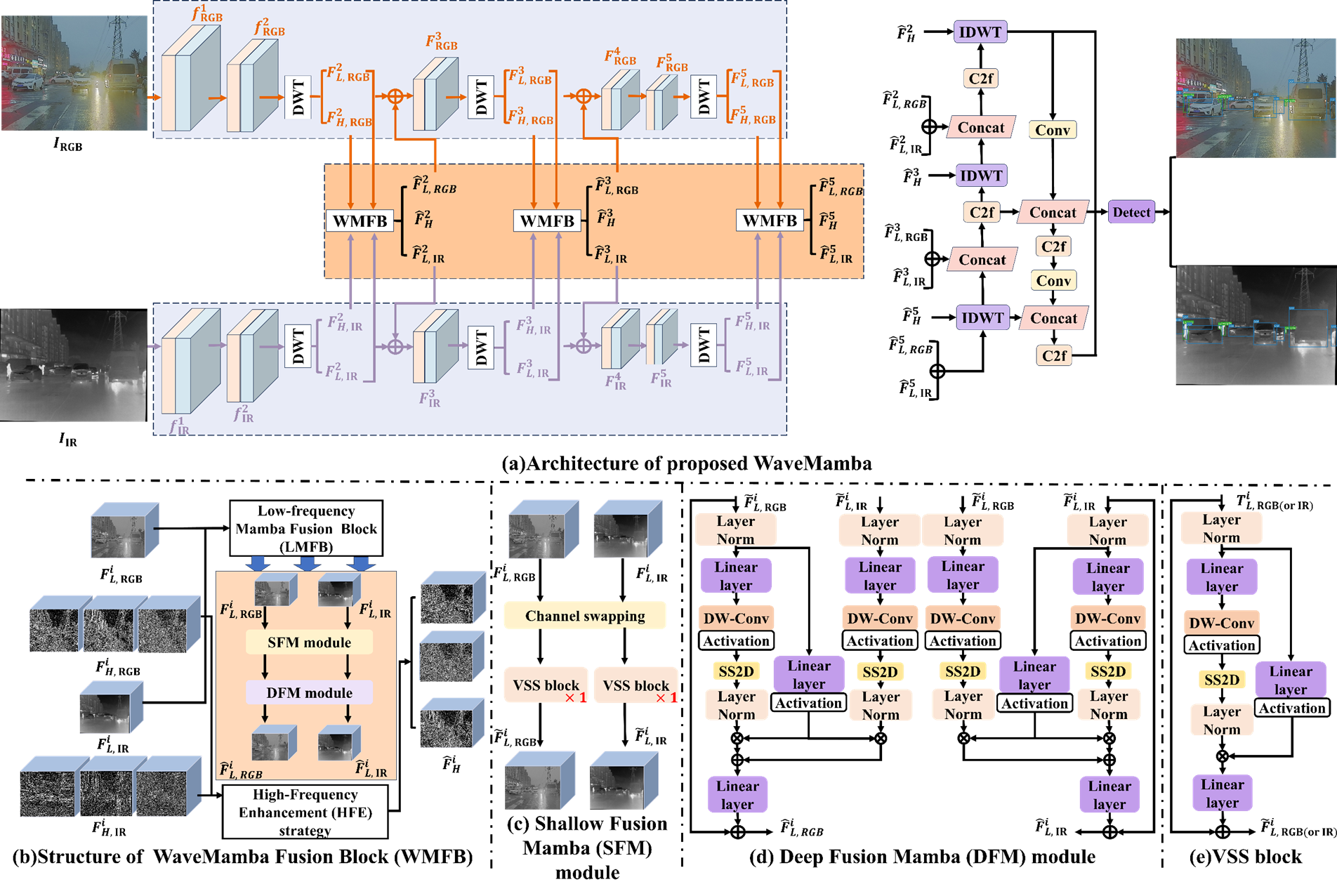

本文提出了一种名为WaveMamba的跨模态融合方法,旨在有效整合RGB和红外图像的互补特性,以提升目标检测性能。该方法利用离散小波变换(DWT)分解RGB和红外图像,提取其独特的频率特征。同时,改进的检测头结合逆离散小波变换(IDWT),减少信息损失,生成最终的检测结果。WaveMamba的核心是WaveMamba融合块(WMFB),它促进了低频和高频子带之间的全面融合。在WMFB中,低频Mamba融合块(LMFB)基于Mamba框架,首先通过通道交换执行初始低频特征融合,然后通过高级门控注意力机制进行深度融合,以增强集成效果。高频特征则采用“绝对最大值”融合策略进行增强。实验结果表明,该方法显著提升了性能,在四个基准测试中,平均mAP超越了现有最佳方法,提升幅度达到4.5%。

🔬 方法详解

问题定义:RGB-红外目标检测旨在利用可见光和红外图像的互补信息来提高目标检测的准确性和鲁棒性。现有的方法通常采用简单的特征拼接或注意力机制进行融合,难以充分利用两种模态在不同频率上的信息。此外,直接在像素空间进行融合可能会引入噪声,影响检测性能。

核心思路:WaveMamba的核心思路是在频率域进行RGB和红外图像的特征融合。通过离散小波变换(DWT)将图像分解为不同频率的子带,然后针对低频和高频子带分别设计融合策略。低频部分使用Mamba架构进行深度融合,高频部分使用绝对最大值融合,从而充分利用两种模态的互补信息。这样设计的目的是为了更好地捕捉不同模态在不同频率上的特征,并减少噪声的影响。

技术框架:WaveMamba的整体框架包括以下几个主要步骤:1) 使用DWT将RGB和红外图像分解为低频和高频子带;2) 使用低频Mamba融合块(LMFB)对低频子带进行融合,LMFB基于Mamba架构,并引入门控注意力机制;3) 使用绝对最大值融合策略对高频子带进行融合;4) 将融合后的低频和高频子带通过逆离散小波变换(IDWT)重构为融合后的特征图;5) 使用改进的检测头对融合后的特征图进行目标检测。

关键创新:WaveMamba的关键创新在于以下几点:1) 提出了一种基于小波变换的跨模态融合方法,能够在频率域有效融合RGB和红外图像的特征;2) 引入了低频Mamba融合块(LMFB),利用Mamba架构进行低频特征的深度融合,并结合门控注意力机制增强特征表示;3) 针对高频子带,提出了一种绝对最大值融合策略,能够有效保留高频细节信息。与现有方法相比,WaveMamba能够更充分地利用RGB和红外图像的互补信息,从而提高目标检测的准确性。

关键设计:在LMFB中,Mamba架构被用于建模低频特征之间的长距离依赖关系。门控注意力机制用于自适应地调整不同通道的权重,从而增强特征表示。绝对最大值融合策略通过选择每个位置上绝对值最大的特征来保留高频细节信息。损失函数采用标准的检测损失函数,例如Faster R-CNN中的分类损失和回归损失。

🖼️ 关键图片

📊 实验亮点

WaveMamba在多个RGB-红外目标检测数据集上取得了显著的性能提升。在四个基准测试中,平均mAP超越了现有最佳方法,提升幅度达到4.5%。这些结果表明,WaveMamba能够有效融合RGB和红外图像的互补信息,提高目标检测的准确性。

🎯 应用场景

WaveMamba在安防监控、自动驾驶、夜间目标检测等领域具有广泛的应用前景。通过融合可见光和红外图像,该方法能够在各种光照条件下提供更准确的目标检测结果,提高系统的鲁棒性和可靠性。未来,该方法可以进一步扩展到其他多模态融合任务中,例如RGB-D目标检测、图像描述等。

📄 摘要(原文)

Leveraging the complementary characteristics of visible (RGB) and infrared (IR) imagery offers significant potential for improving object detection. In this paper, we propose WaveMamba, a cross-modality fusion method that efficiently integrates the unique and complementary frequency features of RGB and IR decomposed by Discrete Wavelet Transform (DWT). An improved detection head incorporating the Inverse Discrete Wavelet Transform (IDWT) is also proposed to reduce information loss and produce the final detection results. The core of our approach is the introduction of WaveMamba Fusion Block (WMFB), which facilitates comprehensive fusion across low-/high-frequency sub-bands. Within WMFB, the Low-frequency Mamba Fusion Block (LMFB), built upon the Mamba framework, first performs initial low-frequency feature fusion with channel swapping, followed by deep fusion with an advanced gated attention mechanism for enhanced integration. High-frequency features are enhanced using a strategy that applies an ``absolute maximum" fusion approach. These advancements lead to significant performance gains, with our method surpassing state-of-the-art approaches and achieving average mAP improvements of 4.5% on four benchmarks.