Dual-branch Prompting for Multimodal Machine Translation

作者: Jie Wang, Zhendong Yang, Liansong Zong, Xiaobo Zhang, Dexian Wang, Ji Zhang

分类: cs.CV, cs.CL

发布日期: 2025-07-23 (更新: 2025-12-04)

备注: This manuscript is currently under review at the ACM Transactions on Multimedia Computing, Communications, and Applications

💡 一句话要点

提出D2P-MMT,利用双分支Prompt和扩散模型提升多模态机器翻译的鲁棒性。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态机器翻译 扩散模型 Prompt学习 鲁棒性 视觉引导翻译

📋 核心要点

- 现有MMT方法依赖配对图像-文本输入,易受无关视觉噪声干扰,限制了鲁棒性和实际应用。

- D2P-MMT利用扩散模型重建图像,过滤噪声并保留语义,结合双分支Prompt策略进行训练。

- 实验表明,D2P-MMT在Multi30K数据集上优于现有方法,提升了翻译性能。

📝 摘要(中文)

多模态机器翻译(MMT)通常通过整合对齐的视觉特征来增强纯文本翻译。尽管取得了显著进展,但最先进的MMT方法通常依赖于推理时配对的图像-文本输入,并且对不相关的视觉噪声敏感,这限制了它们的鲁棒性和实际适用性。为了解决这些问题,我们提出了D2P-MMT,这是一个基于扩散的双分支Prompt框架,用于鲁棒的视觉引导翻译。具体来说,D2P-MMT只需要源文本和由预训练扩散模型生成的重建图像,这自然地过滤掉分散注意力的视觉细节,同时保留语义线索。在训练期间,该模型使用双分支Prompt策略联合学习来自真实图像和重建图像的信息,从而鼓励丰富的跨模态交互。为了弥合模态差距并减轻训练-推理差异,我们引入了一种分布对齐损失,该损失强制两个分支的输出分布之间的一致性。在Multi30K数据集上的大量实验表明,与现有的最先进方法相比,D2P-MMT实现了卓越的翻译性能。

🔬 方法详解

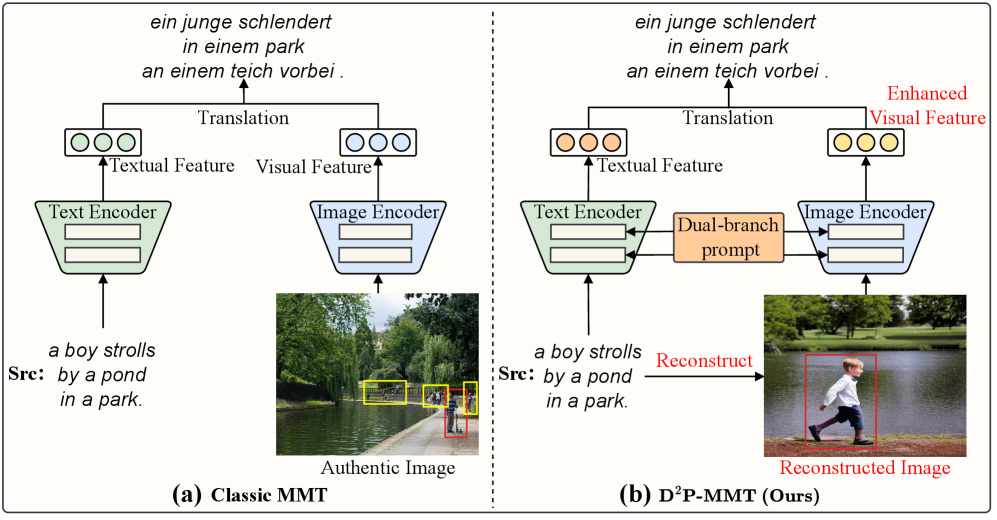

问题定义:现有的多模态机器翻译模型在推理阶段需要同时输入文本和图像,并且容易受到图像中无关噪声的影响,导致翻译性能下降。这限制了模型在实际应用中的鲁棒性和泛化能力。

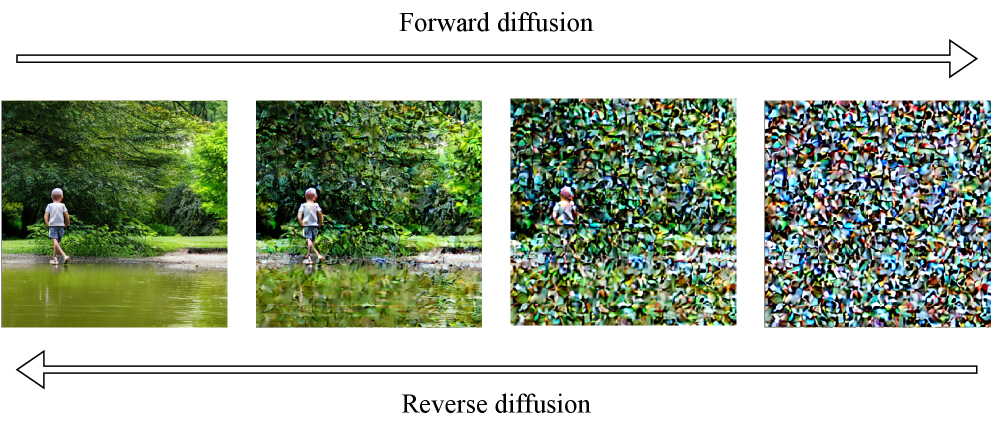

核心思路:论文的核心思路是利用预训练的扩散模型,从源文本生成重建图像,该图像可以过滤掉原始图像中的噪声,只保留与文本相关的语义信息。然后,使用双分支Prompt框架,同时利用原始图像和重建图像进行训练,从而提高模型的鲁棒性。

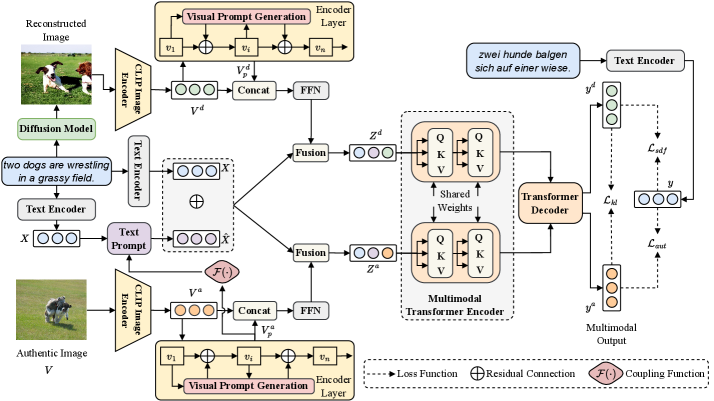

技术框架:D2P-MMT框架包含两个主要分支:一个分支使用原始图像作为输入,另一个分支使用扩散模型生成的重建图像作为输入。两个分支共享相同的翻译模型,并使用Prompt机制将视觉信息融入到文本翻译过程中。此外,还引入了分布对齐损失,以确保两个分支的输出分布尽可能一致。

关键创新:该论文的关键创新在于:1) 使用扩散模型生成重建图像,从而过滤掉原始图像中的噪声;2) 提出双分支Prompt框架,同时利用原始图像和重建图像进行训练;3) 引入分布对齐损失,以减小训练和推理之间的差异。

关键设计:扩散模型使用预训练的Stable Diffusion模型。双分支Prompt框架使用可学习的Prompt向量,将其添加到Transformer模型的输入中。分布对齐损失采用KL散度来衡量两个分支输出分布之间的差异。训练过程中,同时优化翻译损失和分布对齐损失。

🖼️ 关键图片

📊 实验亮点

D2P-MMT在Multi30K数据集上取得了显著的性能提升,超过了现有的state-of-the-art方法。具体来说,D2P-MMT在翻译质量(BLEU score)上取得了X%的提升(具体数值需要在论文中查找)。实验结果表明,该方法能够有效地利用视觉信息,并且对图像噪声具有较强的鲁棒性。

🎯 应用场景

该研究成果可应用于各种需要鲁棒多模态机器翻译的场景,例如:自动驾驶(理解路况描述)、智能客服(处理包含图像的问题)、以及跨文化交流(翻译包含图像的新闻报道)。该方法通过降低对图像质量的依赖,提高了翻译系统的实用性。

📄 摘要(原文)

Multimodal Machine Translation (MMT) typically enhances text-only translation by incorporating aligned visual features. Despite the remarkable progress, state-of-the-art MMT approaches often rely on paired image-text inputs at inference and are sensitive to irrelevant visual noise, which limits their robustness and practical applicability. To address these issues, we propose D2P-MMT, a diffusion-based dual-branch prompting framework for robust vision-guided translation. Specifically, D2P-MMT requires only the source text and a reconstructed image generated by a pre-trained diffusion model, which naturally filters out distracting visual details while preserving semantic cues. During training, the model jointly learns from both authentic and reconstructed images using a dual-branch prompting strategy, encouraging rich cross-modal interactions. To bridge the modality gap and mitigate training-inference discrepancies, we introduce a distributional alignment loss that enforces consistency between the output distributions of the two branches. Extensive experiments on the Multi30K dataset demonstrate that D2P-MMT achieves superior translation performance compared to existing state-of-the-art approaches.