Weak Links in LinkedIn: Enhancing Fake Profile Detection in the Age of LLMs

作者: Apoorva Gulati, Rajesh Kumar, Vinti Agarwal, Aditya Sharma

分类: cs.SI, cs.CV, cs.CY

发布日期: 2025-07-21

备注: 10 pages, 3 figures, 1 table, accepted for publication at ASONAM 2025. https://sites.google.com/view/weaklinksinlinkedin/home

💡 一句话要点

提出GPT辅助对抗训练,提升LinkedIn虚假个人资料检测器在LLM生成内容下的鲁棒性

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 虚假资料检测 大型语言模型 对抗训练 鲁棒性 社交网络安全

📋 核心要点

- 现有虚假个人资料检测器在面对LLM生成的内容时,鲁棒性显著下降,无法有效识别GPT生成的虚假账号。

- 论文提出GPT辅助对抗训练方法,利用GPT生成对抗样本,增强检测器对LLM生成内容的识别能力。

- 实验结果表明,该方法能有效降低LLM生成虚假账号的误接受率,且不影响正常账号的误拒绝率,显著提升检测器的鲁棒性。

📝 摘要(中文)

大型语言模型(LLM)的出现使得在LinkedIn等平台上创建逼真的虚假个人资料变得更加容易。这给基于文本的虚假个人资料检测器带来了重大风险。本研究评估了现有检测器在LLM生成的个人资料面前的鲁棒性。结果表明,现有检测器在检测手动创建的虚假个人资料时非常有效(误接受率:6-7%),但在识别GPT生成的个人资料时却失效(误接受率:42-52%)。我们提出了一种GPT辅助对抗训练作为对策,将误接受率恢复到1-7%之间,且不影响误拒绝率(0.5-2%)。消融研究表明,在数值和文本嵌入上联合训练的检测器表现出最高的鲁棒性,其次是仅使用数值嵌入的检测器,最后是仅使用文本嵌入的检测器。对基于提示的GPT-4Turbo和人工评估员能力的补充分析证实了对鲁棒的自动检测器(如本研究提出的检测器)的需求。

🔬 方法详解

问题定义:当前LinkedIn等社交平台面临着大量由大型语言模型(LLM)生成的虚假个人资料,这些资料具有高度的真实性,使得传统的基于文本的虚假资料检测方法失效。现有检测器在人工生成的虚假资料上表现良好,但在LLM生成的资料上性能急剧下降,存在较高的误接受率。

核心思路:论文的核心思路是利用GPT模型生成对抗样本,并使用这些对抗样本对现有的虚假资料检测器进行对抗训练。通过让检测器学习区分真实资料和由GPT生成的虚假资料,从而提高其在面对LLM生成内容时的鲁棒性。这种方法模拟了攻击者使用LLM生成虚假资料的场景,从而增强了检测器的防御能力。

技术框架:该方法主要包含以下几个阶段:1) 使用GPT模型生成虚假个人资料;2) 将生成的虚假资料与真实资料混合,构建对抗训练数据集;3) 使用对抗训练数据集训练虚假资料检测器;4) 评估训练后的检测器在LLM生成的虚假资料上的性能。整体流程旨在提高检测器在面对新型攻击时的适应性。

关键创新:该论文的关键创新在于将GPT模型引入到对抗训练过程中,利用GPT生成高质量的对抗样本,从而更有效地提升检测器的鲁棒性。与传统的对抗训练方法相比,该方法能够更好地模拟LLM生成虚假资料的特点,从而训练出更具防御能力的检测器。

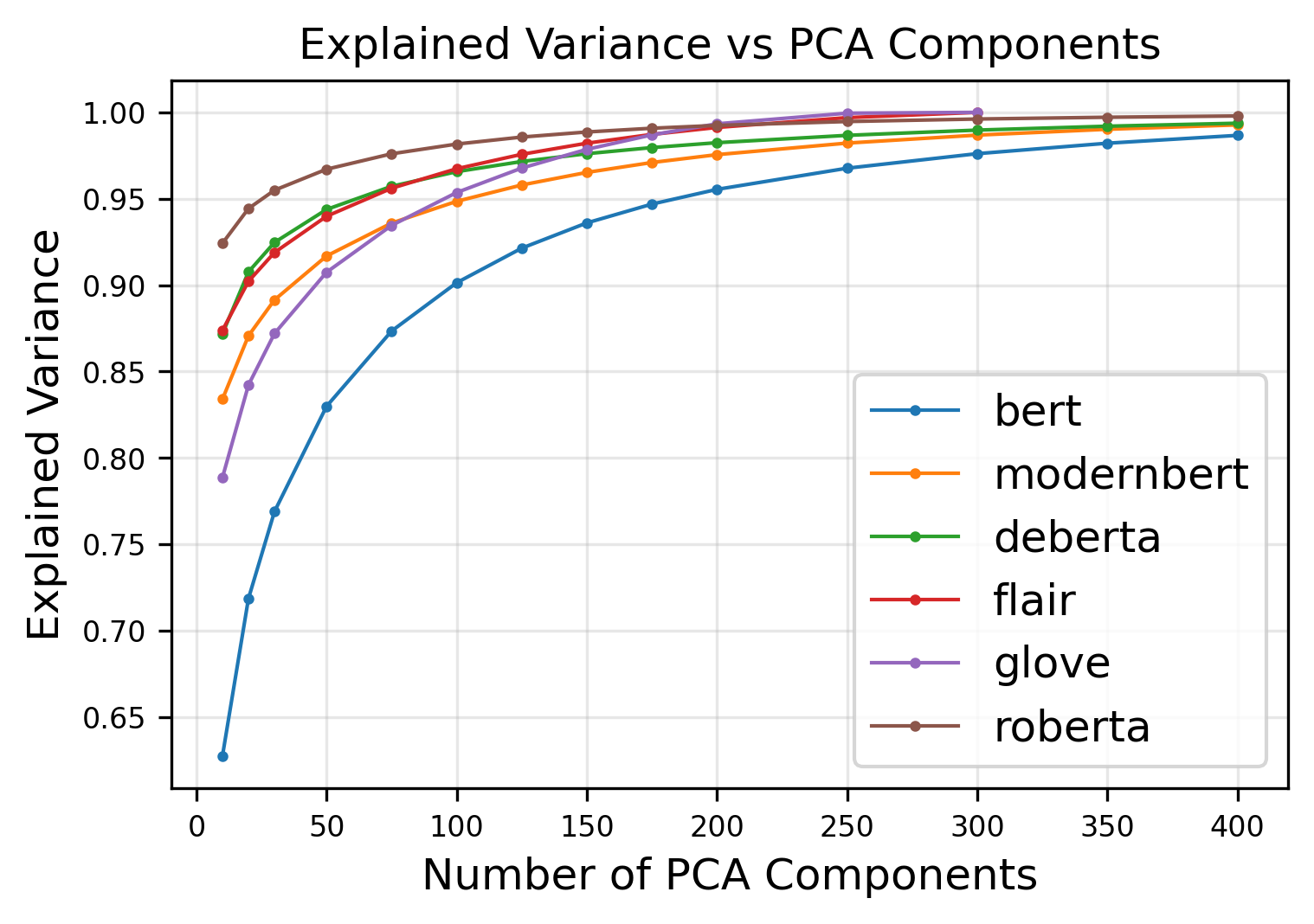

关键设计:论文中对抗训练的具体实现细节未知,但可以推测可能涉及以下关键设计:1) 如何设计GPT的提示(prompt),以生成更具欺骗性的虚假资料;2) 如何平衡对抗样本和真实样本的比例,以避免过拟合;3) 如何选择合适的损失函数,以优化检测器的性能;4) 如何选择合适的嵌入方式(文本、数值或二者结合)以获得最佳的鲁棒性。

🖼️ 关键图片

📊 实验亮点

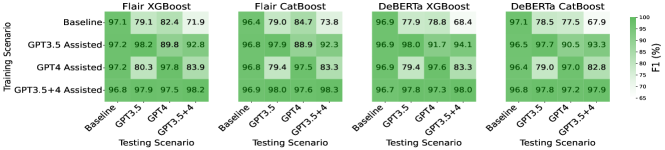

实验结果表明,现有检测器在GPT生成的虚假资料上的误接受率高达42-52%,而经过GPT辅助对抗训练后,误接受率降低到1-7%,显著提升了检测器的鲁棒性。消融实验表明,结合数值和文本嵌入的检测器具有最佳性能。

🎯 应用场景

该研究成果可应用于各类社交平台、招聘网站等,用于检测和过滤LLM生成的虚假个人资料,维护平台生态安全,保护用户免受欺诈和信息污染。未来可扩展到其他类型的虚假信息检测,例如虚假新闻、恶意评论等,具有广泛的应用前景。

📄 摘要(原文)

Large Language Models (LLMs) have made it easier to create realistic fake profiles on platforms like LinkedIn. This poses a significant risk for text-based fake profile detectors. In this study, we evaluate the robustness of existing detectors against LLM-generated profiles. While highly effective in detecting manually created fake profiles (False Accept Rate: 6-7%), the existing detectors fail to identify GPT-generated profiles (False Accept Rate: 42-52%). We propose GPT-assisted adversarial training as a countermeasure, restoring the False Accept Rate to between 1-7% without impacting the False Reject Rates (0.5-2%). Ablation studies revealed that detectors trained on combined numerical and textual embeddings exhibit the highest robustness, followed by those using numerical-only embeddings, and lastly those using textual-only embeddings. Complementary analysis on the ability of prompt-based GPT-4Turbo and human evaluators affirms the need for robust automated detectors such as the one proposed in this study.