Hallucination Score: Towards Mitigating Hallucinations in Generative Image Super-Resolution

作者: Weiming Ren, Raghav Goyal, Zhiming Hu, Tristan Ty Aumentado-Armstrong, Iqbal Mohomed, Alex Levinshtein

分类: cs.CV

发布日期: 2025-07-18 (更新: 2026-01-08)

备注: 31 pages, 21 figures, and 10 tables

💡 一句话要点

提出幻觉评分(Hallucination Score)以缓解生成式超分辨率中的幻觉问题。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 超分辨率 生成模型 幻觉 多模态学习 大型语言模型

📋 核心要点

- 生成式超分辨率模型存在幻觉问题,即生成与低分辨率图像不符的细节,影响实际应用。

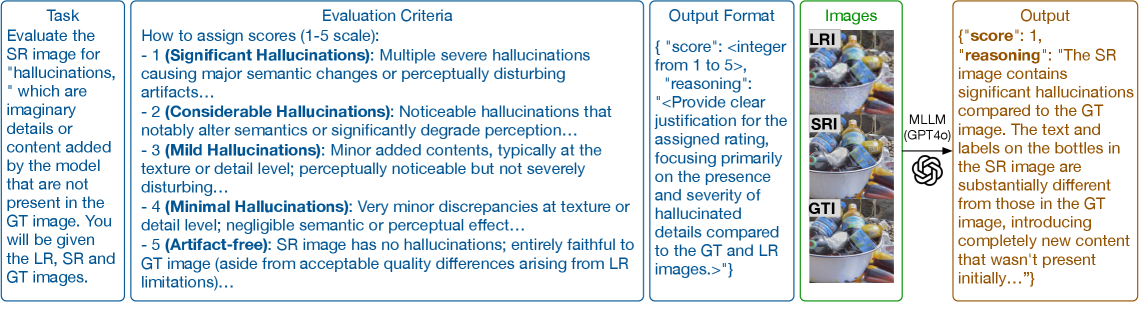

- 利用多模态大型语言模型(MLLM)构建“幻觉评分”(HS),评估生成图像中的幻觉视觉元素。

- 通过实验验证HS与人类评估一致,并可作为奖励函数微调扩散模型,有效缓解幻觉。

📝 摘要(中文)

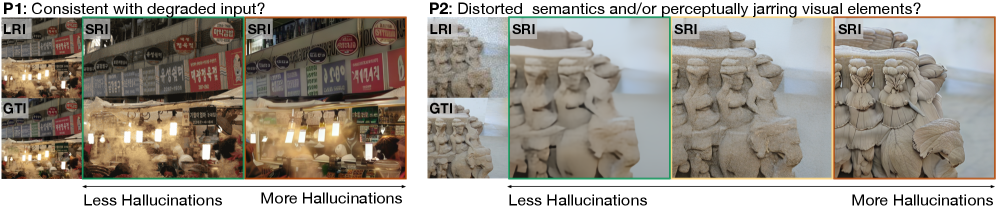

生成式超分辨率(GSR)在感知图像质量方面达到了当前最佳水平,克服了先前非生成模型的“回归平均”模糊。然而,从人类角度来看,此类模型并未完全符合质量和保真度之间的最佳平衡。相反,另一类伪像,其中生成的细节在感知上与低分辨率图像(LRI)或ground-truth图像(GTI)不匹配,是GSR中一个关键但未被充分研究的问题,限制了其在实际中的部署。本文重点关注测量、分析和缓解这些伪像(即“幻觉”)。我们观察到,现有的图像指标或质量模型无法很好地表征幻觉,因为它们与精确的保真度和无参考质量是正交的。相反,我们利用多模态大型语言模型(MLLM),构建一个提示来评估幻觉视觉元素,并生成一个“幻觉评分”(HS)。我们发现HS与人类评估密切相关,并且还为用于超分辨率(SR)模型的先前图像指标提供了补充见解。最后,我们提出了一些有效的HS代理,并演示了如何微调基于扩散的GSR模型以减轻幻觉,利用HS代理作为可微分的奖励函数。

🔬 方法详解

问题定义:生成式超分辨率(GSR)模型虽然在感知质量上表现出色,但容易产生与原始低分辨率图像不一致的细节,即“幻觉”。现有图像质量评价指标无法有效捕捉和量化这些幻觉,导致模型难以优化以减少此类伪像。

核心思路:利用多模态大型语言模型(MLLM)的强大理解能力,设计一个能够评估图像中幻觉视觉元素的提示,从而生成一个“幻觉评分”(HS)。HS旨在量化生成图像中与原始图像不一致的细节程度,并作为优化目标来指导模型的训练。

技术框架:该方法主要包含以下几个阶段:1) 使用MLLM构建幻觉评估提示;2) 利用MLLM对超分辨率图像进行评估,得到幻觉评分HS;3) 设计HS的代理指标,以便进行高效计算;4) 将HS代理作为奖励函数,微调基于扩散的GSR模型,以减少幻觉。

关键创新:该方法的核心创新在于利用MLLM来评估生成图像中的幻觉,这是一种全新的视角。与传统的图像质量评价指标不同,HS能够更好地捕捉生成细节与原始图像之间的语义一致性,从而更准确地量化幻觉程度。

关键设计:关键设计包括:1) 精心设计的MLLM提示,用于引导MLLM关注图像中的幻觉视觉元素;2) HS代理指标的设计,需要在计算效率和准确性之间进行权衡;3) 使用HS代理作为奖励函数进行微调时,需要选择合适的优化算法和超参数,以避免训练不稳定。

🖼️ 关键图片

📊 实验亮点

实验结果表明,提出的幻觉评分(HS)与人类评估具有高度一致性,能够有效量化生成图像中的幻觉程度。通过将HS代理作为奖励函数微调扩散模型,可以显著降低生成图像中的幻觉,提高图像的保真度和感知质量。具体性能提升数据未知。

🎯 应用场景

该研究成果可应用于各种需要高质量图像超分辨率的场景,例如视频监控、医学影像、卫星图像处理等。通过减少生成图像中的幻觉,可以提高图像的可信度和实用性,从而提升相关应用的性能和用户体验。未来,该方法可以进一步扩展到其他生成模型,例如图像修复、图像着色等。

📄 摘要(原文)

Generative super-resolution (GSR) currently sets the state-of-the-art in terms of perceptual image quality, overcoming the "regression-to-the-mean" blur of prior non-generative models. However, from a human perspective, such models do not fully conform to the optimal balance between quality and fidelity. Instead, a different class of artifacts, in which generated details fail to perceptually match the low resolution image (LRI) or ground-truth image (GTI), is a critical but under-studied issue in GSR, limiting its practical deployment. In this work, we focus on measuring, analyzing, and mitigating these artifacts (i.e., "hallucinations"). We observe that hallucinations are not well-characterized with existing image metrics or quality models, as they are orthogonal to both exact fidelity and no-reference quality. Instead, we take advantage of multimodal large language models (MLLMs) by constructing a prompt that assesses hallucinatory visual elements and generates a "Hallucination Score" (HS). We find that HS is closely aligned with human evaluations, and also provides complementary insights to prior image metrics used for super-resolution (SR) models. Finally, we propose a few efficient HS proxies and demonstrate how diffusion-based GSR models can be fine-tuned to mitigate hallucinations, leveraging HS proxies as differentiable reward functions.