Moving Object Detection from Moving Camera Using Focus of Expansion Likelihood and Segmentation

作者: Masahiro Ogawa, Qi An, Atsushi Yamashita

分类: cs.CV

发布日期: 2025-07-18 (更新: 2025-10-20)

备注: 8 pages, 15 figures, RA-L submission

💡 一句话要点

提出FoELS方法,融合光流和纹理信息,解决移动相机下的运动目标检测问题。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 运动目标检测 光流 焦点扩展 图像分割 移动相机

📋 核心要点

- 现有运动目标检测方法依赖光流,在复杂场景和相机运动下表现不佳。

- FoELS融合光流计算的FoE异常值和纹理分割先验,提升运动目标检测精度。

- 实验表明,FoELS在DAVIS 2016数据集和真实交通视频中表现出色。

📝 摘要(中文)

本文提出了一种名为焦点扩展似然与分割(FoELS)的方法,用于从移动相机视角检测运动目标。在机器人技术中,区分运动和静态物体对于3D重建、自主导航和场景理解至关重要。现有方法通常主要依赖光流,但在涉及相机运动的复杂结构化场景中,光流难以检测运动目标。为了解决这个局限性,FoELS的核心思想是整合光流和纹理信息。该方法首先从光流计算焦点扩展(FoE),并从FoE计算的异常值中推导出初始运动似然。然后,将该似然与基于分割的先验融合,以估计最终的运动概率。该方法有效地处理了包括复杂结构化场景、旋转相机运动和平行运动等挑战。在DAVIS 2016数据集和真实交通视频上的综合评估证明了其有效性和最先进的性能。

🔬 方法详解

问题定义:论文旨在解决移动相机场景下运动目标检测的难题。现有方法,特别是那些依赖光流的方法,在复杂、结构化的场景中,以及存在相机运动(如旋转或平行移动)时,往往难以准确区分运动和静态物体。这些方法容易受到光流噪声的干扰,导致检测精度下降。

核心思路:FoELS的核心思路是将光流信息和纹理信息进行有效融合。光流用于估计焦点扩展(FoE),FoE的异常值反映了运动的可能性。同时,利用图像分割提取纹理信息,作为运动检测的先验知识。通过融合这两种信息,可以更鲁棒地检测运动目标。

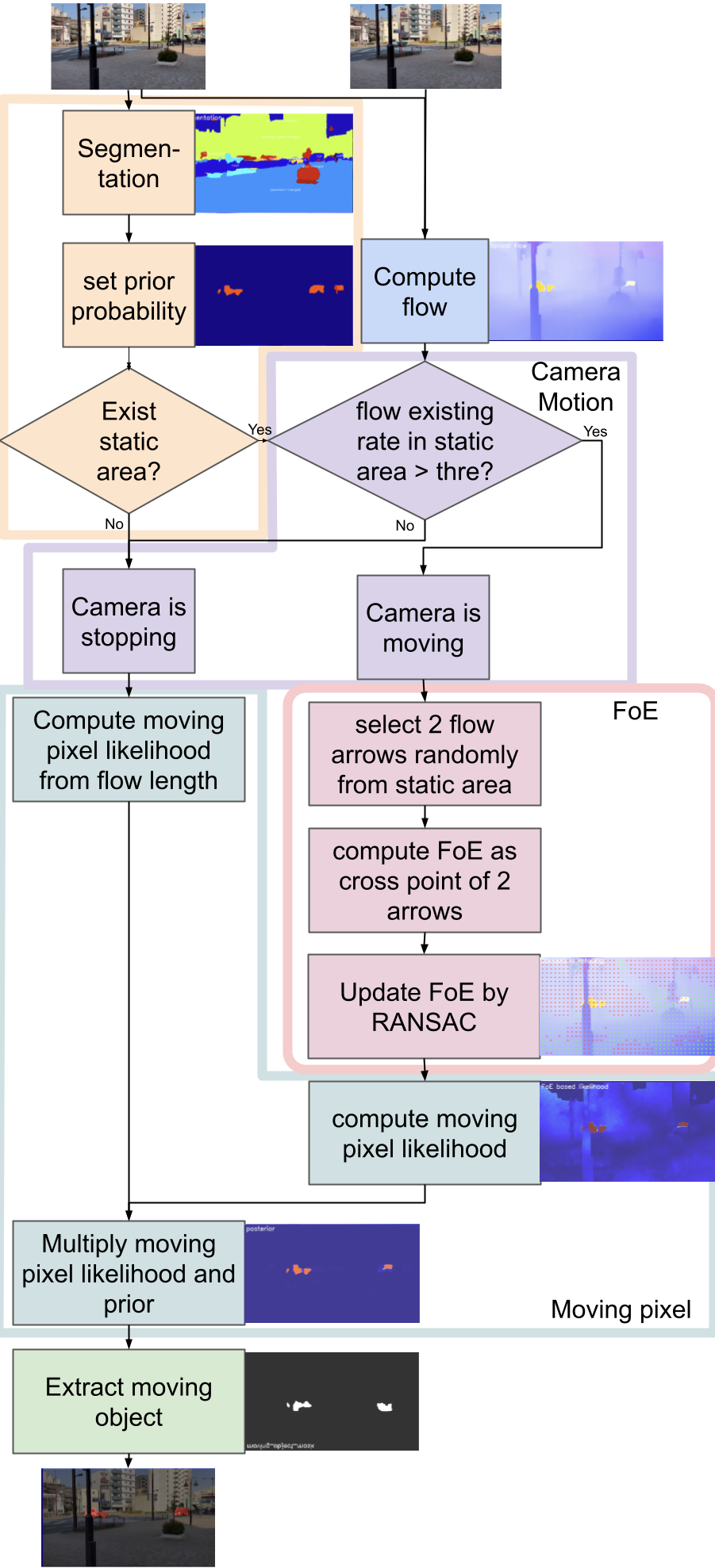

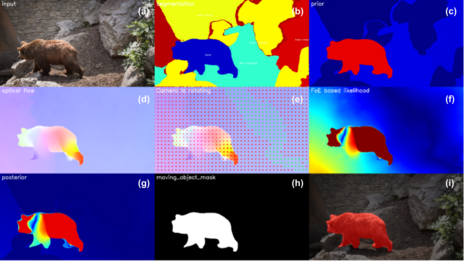

技术框架:FoELS方法主要包含以下几个阶段:1) 光流计算:使用现有的光流算法估计图像中像素的运动矢量。2) 焦点扩展(FoE)计算:根据光流场计算FoE,FoE表示相机运动的汇聚点。3) 运动似然估计:通过分析光流与FoE的一致性,计算初始运动似然。偏离FoE的光流被认为是运动物体的可能性更高。4) 分割先验:利用图像分割算法提取图像的纹理信息,并将其作为运动检测的先验知识。5) 运动概率融合:将运动似然和分割先验进行融合,得到最终的运动概率图。

关键创新:FoELS的关键创新在于将光流的运动信息(通过FoE异常值体现)与图像的纹理信息(通过分割先验体现)进行有效融合。这种融合方式能够克服传统光流方法在复杂场景和相机运动下的局限性,提高运动目标检测的鲁棒性和准确性。与仅依赖光流的方法相比,FoELS能够更好地处理相机运动带来的干扰。

关键设计:FoELS的具体实现细节包括:1) 使用RANSAC算法估计FoE,以减少光流噪声的影响。2) 使用高斯混合模型对运动似然进行建模。3) 使用条件随机场(CRF)对运动概率图进行平滑,以提高分割的准确性。4) 运动似然和分割先验的融合方式采用加权平均,权重的选择需要根据具体场景进行调整。

🖼️ 关键图片

📊 实验亮点

在DAVIS 2016数据集上,FoELS方法在运动目标检测任务中取得了state-of-the-art的性能。与传统光流方法相比,FoELS在复杂场景和相机运动下的检测精度显著提高。在真实交通视频上的实验结果表明,FoELS能够有效地检测车辆、行人等运动目标,具有很强的实用价值。

🎯 应用场景

FoELS方法在机器人自主导航、智能交通监控、视频监控等领域具有广泛的应用前景。例如,在自动驾驶中,FoELS可以帮助车辆准确检测行人、车辆等运动目标,从而提高驾驶安全性。在视频监控中,FoELS可以用于检测异常行为,例如人群聚集、物体遗留等,从而提高安全防范能力。该方法还可应用于增强现实和虚拟现实,实现更逼真的交互体验。

📄 摘要(原文)

Separating moving and static objects from a moving camera viewpoint is essential for 3D reconstruction, autonomous navigation, and scene understanding in robotics. Existing approaches often rely primarily on optical flow, which struggles to detect moving objects in complex, structured scenes involving camera motion. To address this limitation, we propose Focus of Expansion Likelihood and Segmentation (FoELS), a method based on the core idea of integrating both optical flow and texture information. FoELS computes the focus of expansion (FoE) from optical flow and derives an initial motion likelihood from the outliers of the FoE computation. This likelihood is then fused with a segmentation-based prior to estimate the final moving probability. The method effectively handles challenges including complex structured scenes, rotational camera motion, and parallel motion. Comprehensive evaluations on the DAVIS 2016 dataset and real-world traffic videos demonstrate its effectiveness and state-of-the-art performance.