A Real-Time System for Egocentric Hand-Object Interaction Detection in Industrial Domains

作者: Antonio Finocchiaro, Alessandro Sebastiano Catinello, Michele Mazzamuto, Rosario Leonardi, Antonino Furnari, Giovanni Maria Farinella

分类: cs.CV

发布日期: 2025-07-17 (更新: 2025-12-04)

备注: 12 pages, 4 figures, In International Conference on Image Analysis and Processing

💡 一句话要点

提出一种工业领域实时手-物交互检测系统,提升人机交互效率。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱六:视频提取与匹配 (Video Extraction)

关键词: 手-物交互检测 实时系统 工业应用 动作识别 物体检测 级联架构 Mamba模型

📋 核心要点

- 现有实时应用中,手-物交互检测面临速度和精度的挑战,影响用户体验。

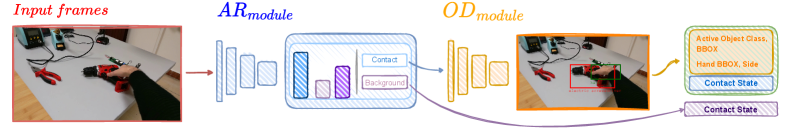

- 提出级联架构,先用动作识别模块判断交互状态,再用物体检测模块识别目标物体。

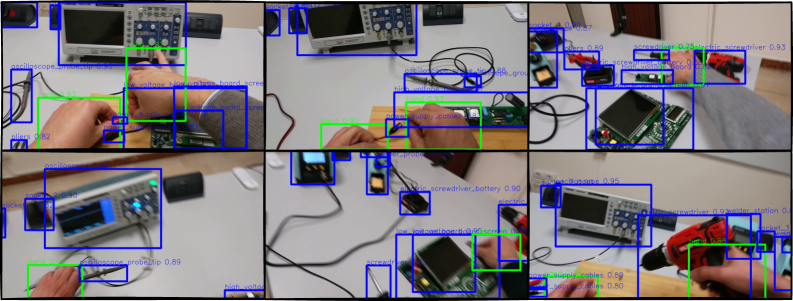

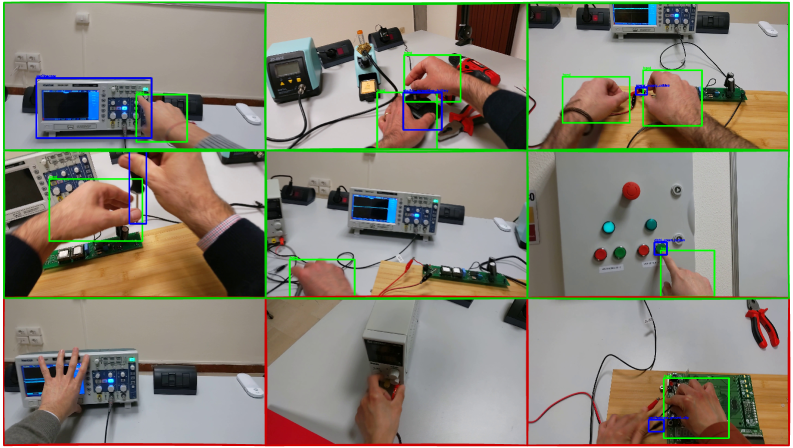

- 实验结果表明,该方法在ENIGMA-51数据集上实现了较好的性能,并在速度上满足实时性要求。

📝 摘要(中文)

本文提出了一种高效的实时手-物交互检测方法,旨在提升以自我为中心的视觉应用中的用户体验。该方法通过快速准确地检测与周围物体的交互来实现。该方法包含一个动作识别模块和一个物体检测模块,用于识别确认交互后的活动物体。动作识别模块采用Mamba模型,以EfficientNetV2作为骨干网络,在ENIGMA-51基准测试中以30fps的速度实现了38.52%的p-AP。物体检测模块采用微调的YOLOWorld,达到了85.13%的AP(针对手和物体)。这些模型以级联架构实现,其中动作识别和物体检测模块顺序运行。当动作识别预测到接触状态时,它会激活物体检测模块,后者对相关帧执行推理,以检测和分类活动物体。

🔬 方法详解

问题定义:论文旨在解决工业领域中,以人为中心的视觉场景下,实时且准确地检测手部与物体交互的问题。现有方法通常难以在保证高精度的同时,满足实时性的要求,尤其是在计算资源受限的环境下。因此,如何在有限的计算资源下,实现快速且准确的手-物交互检测是一个关键挑战。

核心思路:论文的核心思路是将手-物交互检测任务分解为两个阶段:首先,通过动作识别模块快速判断是否存在交互行为;然后,仅当检测到交互行为时,才激活物体检测模块,从而减少不必要的计算开销。这种级联架构能够有效地平衡检测精度和计算效率。

技术框架:该系统由两个主要模块组成:动作识别模块和物体检测模块。动作识别模块使用Mamba模型,并以EfficientNetV2作为骨干网络,用于识别手部动作,判断是否存在与物体的接触。当动作识别模块预测到接触状态时,它会激活物体检测模块。物体检测模块使用微调的YOLOWorld模型,用于检测和分类与手部交互的物体。两个模块以级联的方式顺序执行。

关键创新:该方法的主要创新在于采用了级联架构,将动作识别和物体检测模块解耦,并根据动作识别的结果动态地激活物体检测模块。这种设计显著降低了计算复杂度,提高了系统的实时性。此外,选择Mamba模型作为动作识别模块,并结合EfficientNetV2骨干网络,在保证精度的前提下,进一步提升了模型的推理速度。

关键设计:动作识别模块使用Mamba模型,EfficientNetV2作为backbone。物体检测模块使用YOLOWorld,并针对手和物体进行了微调。级联架构的关键在于动作识别模块的阈值设置,需要平衡检测精度和召回率,以确保在尽可能减少计算开销的同时,不会遗漏重要的交互事件。损失函数和优化器的具体选择在论文中未明确说明,属于未知信息。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在ENIGMA-51基准测试中,动作识别模块以30fps的速度实现了38.52%的p-AP。物体检测模块达到了85.13%的AP(针对手和物体)。这些结果表明,该方法在保证较高检测精度的同时,能够满足实时性的要求,为工业领域的实际应用提供了可行性。

🎯 应用场景

该研究成果可广泛应用于工业自动化、人机协作、虚拟现实等领域。例如,在智能制造中,该系统可以帮助机器人理解工人的操作意图,从而更安全、高效地完成任务。在VR/AR环境中,该系统可以提供更自然、流畅的交互体验,提升用户的沉浸感。未来,该技术有望进一步拓展到医疗、教育等领域,实现更智能、便捷的人机交互。

📄 摘要(原文)

Hand-object interaction detection remains an open challenge in real-time applications, where intuitive user experiences depend on fast and accurate detection of interactions with surrounding objects. We propose an efficient approach for detecting hand-objects interactions from streaming egocentric vision that operates in real time. Our approach consists of an action recognition module and an object detection module for identifying active objects upon confirmed interaction. Our Mamba model with EfficientNetV2 as backbone for action recognition achieves 38.52% p-AP on the ENIGMA-51 benchmark at 30fps, while our fine-tuned YOLOWorld reaches 85.13% AP for hand and object. We implement our models in a cascaded architecture where the action recognition and object detection modules operate sequentially. When the action recognition predicts a contact state, it activates the object detection module, which in turn performs inference on the relevant frame to detect and classify the active object.