PhysX-3D: Physical-Grounded 3D Asset Generation

作者: Ziang Cao, Zhaoxi Chen, Liang Pan, Ziwei Liu

分类: cs.CV

发布日期: 2025-07-16 (更新: 2025-11-28)

备注: Accepted by NeurIPS 2025, Spotlight Project page: https://physx-3d.github.io/

💡 一句话要点

提出PhysX-3D框架,用于生成具有物理属性的3D资产,解决现有方法忽略物理属性的问题。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 3D资产生成 物理属性 物理人工智能 数据集构建 图像到3D 具身智能 物理模拟

📋 核心要点

- 现有3D生成方法主要关注几何和纹理,忽略了物理属性,限制了其在模拟和具身智能等物理领域的应用。

- PhysX-3D通过PhysXNet数据集和PhysXGen框架,将物理知识融入3D资产生成过程,显式建模结构与物理属性的关联。

- 实验表明,PhysX-3D框架能够生成具有合理物理属性的3D资产,并在性能和泛化能力上表现出优越性。

📝 摘要(中文)

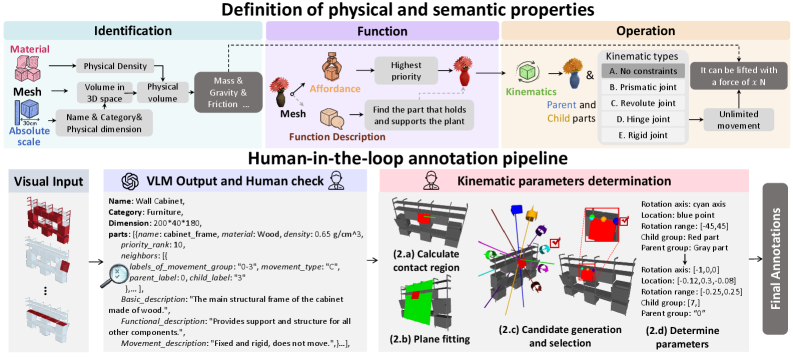

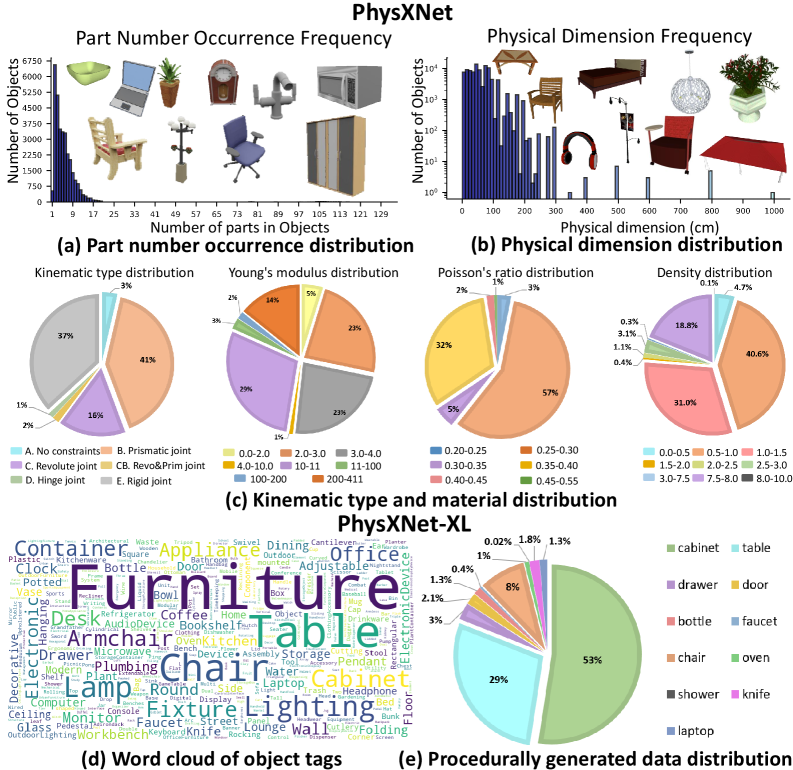

本文提出PhysX-3D,一个用于生成具有物理属性的3D资产的端到端框架。现有3D生成方法主要关注几何和纹理,忽略了物理属性建模。为了弥补物理标注3D数据集的空白,我们提出了PhysXNet,这是首个物理属性标注的3D数据集,系统地标注了五个基础维度:绝对尺度、材料、可供性、运动学和功能描述。我们设计了一个基于视觉-语言模型的可扩展人机协作标注流程,能够从原始3D资产高效地创建物理优先的资产。此外,我们提出了PhysXGen,一个用于物理属性图像到3D资产生成的前馈框架,将物理知识注入到预训练的3D结构空间中。PhysXGen采用双分支架构,显式地建模3D结构和物理属性之间的潜在相关性,从而生成具有合理的物理预测且保持原始几何质量的3D资产。大量实验验证了我们框架的优越性能和良好的泛化能力。所有代码、数据和模型都将发布,以促进生成物理人工智能的未来研究。

🔬 方法详解

问题定义:现有3D生成方法主要关注几何形状和纹理,忽略了物体重要的物理属性,导致生成的3D资产难以直接应用于需要物理交互的场景,例如模拟和具身智能。缺乏带有物理属性标注的大规模3D数据集也是一个关键瓶颈。

核心思路:PhysX-3D的核心思路是将物理知识融入到3D资产生成过程中。通过构建物理属性标注的数据集,并设计能够显式建模3D结构和物理属性之间相关性的生成框架,从而生成具有物理合理性的3D资产。

技术框架:PhysX-3D包含两个主要组成部分:PhysXNet数据集和PhysXGen框架。PhysXNet是一个物理属性标注的3D数据集,涵盖绝对尺度、材料、可供性、运动学和功能描述五个维度。PhysXGen是一个图像到3D资产生成的前馈框架,它采用双分支架构,分别处理3D结构和物理属性,并将两者融合生成最终的3D资产。

关键创新:PhysX-3D的关键创新在于:1) 提出了首个物理属性标注的3D数据集PhysXNet,填补了该领域的空白;2) 设计了PhysXGen框架,能够显式地建模3D结构和物理属性之间的潜在相关性,从而生成具有物理合理性的3D资产。与现有方法相比,PhysX-3D更加关注3D资产的物理属性,使其更适用于物理交互场景。

关键设计:PhysXNet数据集的标注流程采用了人机协作的方式,利用视觉-语言模型提高标注效率。PhysXGen框架的双分支架构分别处理几何信息和物理属性信息,并通过特定的融合机制将两者结合。具体的损失函数和网络结构细节在论文中有详细描述,但摘要中未提及具体参数设置。

🖼️ 关键图片

📊 实验亮点

论文通过实验验证了PhysX-3D框架的有效性。实验结果表明,PhysXGen能够生成具有合理物理属性的3D资产,并在几何质量和物理属性预测方面优于现有方法。具体的性能数据和提升幅度在摘要中未提及,需要在论文正文中查找。

🎯 应用场景

PhysX-3D在机器人技术、游戏开发、虚拟现实/增强现实、物理模拟等领域具有广泛的应用前景。它可以用于生成具有逼真物理属性的3D模型,从而提高模拟环境的真实性和交互性,并促进具身智能的发展。该研究为物理人工智能领域的研究奠定了基础。

📄 摘要(原文)

3D modeling is moving from virtual to physical. Existing 3D generation primarily emphasizes geometries and textures while neglecting physical-grounded modeling. Consequently, despite the rapid development of 3D generative models, the synthesized 3D assets often overlook rich and important physical properties, hampering their real-world application in physical domains like simulation and embodied AI. As an initial attempt to address this challenge, we propose \textbf{PhysX-3D}, an end-to-end paradigm for physical-grounded 3D asset generation. 1) To bridge the critical gap in physics-annotated 3D datasets, we present PhysXNet - the first physics-grounded 3D dataset systematically annotated across five foundational dimensions: absolute scale, material, affordance, kinematics, and function description. In particular, we devise a scalable human-in-the-loop annotation pipeline based on vision-language models, which enables efficient creation of physics-first assets from raw 3D assets.2) Furthermore, we propose \textbf{PhysXGen}, a feed-forward framework for physics-grounded image-to-3D asset generation, injecting physical knowledge into the pre-trained 3D structural space. Specifically, PhysXGen employs a dual-branch architecture to explicitly model the latent correlations between 3D structures and physical properties, thereby producing 3D assets with plausible physical predictions while preserving the native geometry quality. Extensive experiments validate the superior performance and promising generalization capability of our framework. All the code, data, and models will be released to facilitate future research in generative physical AI.