MMHU: A Massive-Scale Multimodal Benchmark for Human Behavior Understanding

作者: Renjie Li, Ruijie Ye, Mingyang Wu, Hao Frank Yang, Zhiwen Fan, Hezhen Hu, Zhengzhong Tu

分类: cs.CV

发布日期: 2025-07-16

💡 一句话要点

提出大规模多模态人类行为理解基准MMHU,助力安全驾驶系统发展

🎯 匹配领域: 支柱四:生成式动作 (Generative Motion) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 人类行为理解 自动驾驶 多模态数据集 运动预测 行为识别

📋 核心要点

- 现有自动驾驶领域缺乏全面评估人类行为理解的基准数据集,限制了相关算法的开发和性能评估。

- MMHU通过整合多来源数据,并采用人机协作标注,构建了一个大规模、多模态、标注丰富的人类行为理解数据集。

- 论文提供了数据集的详细分析,并在MMHU上进行了多个任务的基准测试,为后续研究提供了参考和评估标准。

📝 摘要(中文)

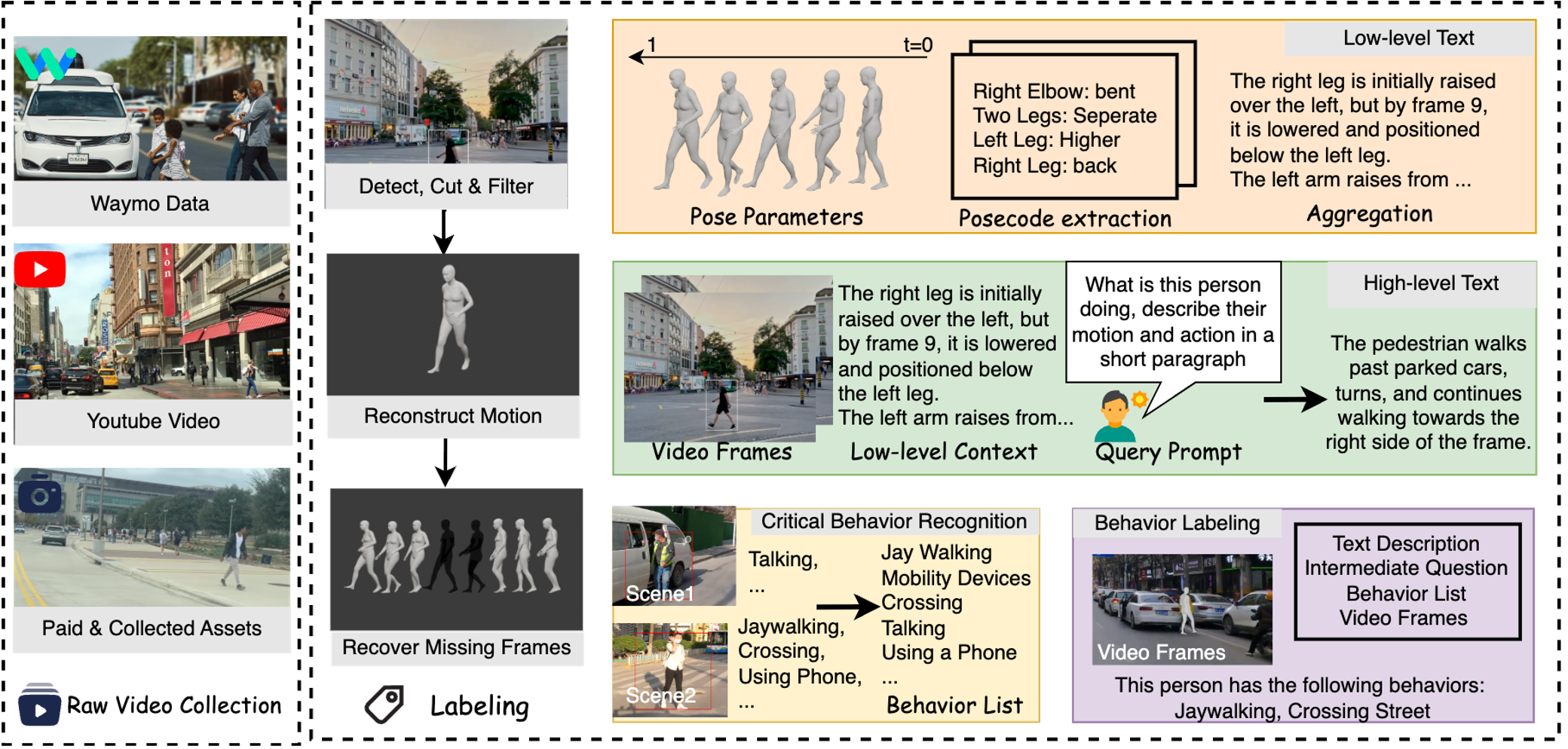

本文提出了一个大规模的人类行为分析基准数据集MMHU,旨在促进自动驾驶中人类行为理解的研究。该数据集包含57k个人类运动片段和1.73M帧,数据来源多样,包括Waymo等现有驾驶数据集、YouTube上的真实场景视频以及自采集数据。MMHU数据集具有丰富的标注信息,包括人类运动和轨迹、运动文本描述、人类意图以及与驾驶安全相关的关键行为标签。作者开发了一个人机协作的标注流程,生成了丰富的行为描述。此外,论文还对数据集进行了全面的分析,并针对运动预测、运动生成和人类行为问答等多个任务进行了基准测试,提供了一个广泛的评估套件。

🔬 方法详解

问题定义:目前自动驾驶领域对人类行为的理解至关重要,但缺乏一个大规模、多模态的基准数据集来全面评估相关算法的性能。现有方法难以有效利用多模态信息,且缺乏对人类意图和驾驶安全相关行为的细粒度标注。

核心思路:论文的核心思路是构建一个包含多种模态信息(如视频、轨迹、文本描述)的大规模数据集,并提供丰富的标注,包括人类运动、轨迹、意图以及与驾驶安全相关的关键行为标签。通过这个数据集,可以促进对人类行为更深入的理解和预测。

技术框架:MMHU数据集的构建流程主要包括数据收集、数据清洗和数据标注三个阶段。数据来源于Waymo等现有驾驶数据集、YouTube上的真实场景视频以及自采集数据。标注过程采用人机协作的方式,利用人工标注的准确性和机器标注的效率,生成高质量的标注信息。数据集涵盖了人类运动片段、帧级别标注、文本描述和行为标签等多种信息。

关键创新:MMHU的关键创新在于其大规模、多模态和标注丰富性。与现有数据集相比,MMHU不仅包含视频和轨迹信息,还提供了人类意图和驾驶安全相关行为的细粒度标注,以及对人类运动的文本描述。此外,人机协作的标注流程保证了标注的质量和效率。

关键设计:数据集包含57k个人类运动片段和1.73M帧。标注信息包括:人类运动和轨迹(bounding box, trajectory)、运动文本描述(caption)、人类意图(intention label)以及关键行为标签(critical behavior label)。论文未明确提及损失函数和网络结构等细节,但提供了基于该数据集的运动预测、运动生成和人类行为问答等任务的基准测试。

🖼️ 关键图片

📊 实验亮点

论文在MMHU数据集上进行了运动预测、运动生成和人类行为问答等多个任务的基准测试。实验结果表明,现有方法在这些任务上仍有很大的提升空间。MMHU数据集的发布,为相关研究提供了一个重要的评估平台和数据资源,有望推动人类行为理解领域的快速发展。具体性能数据和提升幅度在摘要中未明确给出。

🎯 应用场景

MMHU数据集可广泛应用于自动驾驶、机器人导航、智能监控等领域。通过对人类行为的理解和预测,可以提高自动驾驶系统的安全性,减少交通事故的发生。此外,该数据集还可以用于训练更智能的机器人,使其能够更好地与人类交互和协作。在智能监控领域,可以用于异常行为检测和预警。

📄 摘要(原文)

Humans are integral components of the transportation ecosystem, and understanding their behaviors is crucial to facilitating the development of safe driving systems. Although recent progress has explored various aspects of human behavior$\unicode{x2014}$such as motion, trajectories, and intention$\unicode{x2014}$a comprehensive benchmark for evaluating human behavior understanding in autonomous driving remains unavailable. In this work, we propose $\textbf{MMHU}$, a large-scale benchmark for human behavior analysis featuring rich annotations, such as human motion and trajectories, text description for human motions, human intention, and critical behavior labels relevant to driving safety. Our dataset encompasses 57k human motion clips and 1.73M frames gathered from diverse sources, including established driving datasets such as Waymo, in-the-wild videos from YouTube, and self-collected data. A human-in-the-loop annotation pipeline is developed to generate rich behavior captions. We provide a thorough dataset analysis and benchmark multiple tasks$\unicode{x2014}$ranging from motion prediction to motion generation and human behavior question answering$\unicode{x2014}$thereby offering a broad evaluation suite. Project page : https://MMHU-Benchmark.github.io.