Mitigating Object Hallucinations via Sentence-Level Early Intervention

作者: Shangpin Peng, Senqiao Yang, Li Jiang, Zhuotao Tian

分类: cs.CV

发布日期: 2025-07-16 (更新: 2025-07-26)

🔗 代码/项目: GITHUB

💡 一句话要点

提出SENTINEL框架,通过句子级早期干预缓解多模态大语言模型中的对象幻觉问题

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱三:空间感知与语义 (Perception & Semantics) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态大语言模型 对象幻觉 早期干预 偏好学习 上下文感知 句子级别 C-DPO损失

📋 核心要点

- 现有缓解多模态大语言模型幻觉的方法计算成本高昂或引入数据分布不匹配问题。

- SENTINEL框架通过在句子级别进行早期干预,利用领域内偏好学习来减少幻觉。

- 实验表明,SENTINEL能显著减少幻觉,并在幻觉和通用能力基准测试中超越现有技术。

📝 摘要(中文)

多模态大语言模型(MLLMs)在跨模态理解方面取得了革命性进展,但仍然存在幻觉问题,即生成与视觉输入相矛盾的虚构内容。现有的幻觉缓解方法要么计算成本过高,要么在训练数据和模型输出之间引入分布不匹配。我们发现一个关键点:幻觉主要出现在文本生成的早期阶段,并通过后续输出传播。为了解决这个问题,我们提出了SENTINEL(通过领域内偏好学习进行句子级早期干预)框架,该框架消除了对人工标注的依赖。具体来说,我们首先通过迭代采样模型输出,通过与两个开放词汇检测器进行交叉检查来验证对象是否存在,并将句子分类为幻觉/非幻觉类别,从而引导高质量的领域内偏好对。随后,我们使用上下文连贯的积极样本和幻觉消极样本来迭代构建上下文感知的偏好数据。最后,我们使用上下文感知的偏好损失(C-DPO)训练模型,该损失强调在幻觉最初出现的句子级别进行判别学习。实验结果表明,与原始模型相比,SENTINEL可以将幻觉减少90%以上,并且在幻觉基准和通用能力基准上都优于先前的最先进方法,证明了其优越性和泛化能力。模型、数据集和代码可在https://github.com/pspdada/SENTINEL获得。

🔬 方法详解

问题定义:论文旨在解决多模态大语言模型中存在的对象幻觉问题,即模型生成的内容与视觉输入不符。现有方法要么计算成本过高,难以实际应用,要么引入了训练数据和模型输出之间的分布差异,影响模型性能。

核心思路:论文的核心思路是,对象幻觉通常在文本生成的早期阶段出现并传播。因此,通过在句子级别进行早期干预,可以有效地抑制幻觉的产生。论文利用领域内偏好学习,无需人工标注,自动构建高质量的训练数据,从而引导模型生成更符合视觉输入的文本。

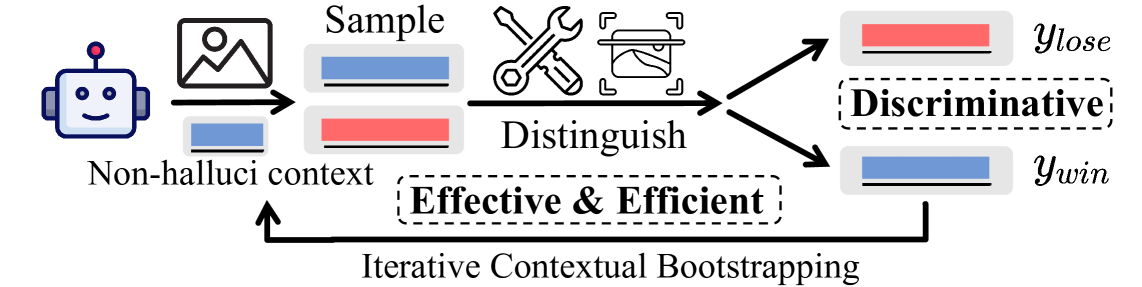

技术框架:SENTINEL框架包含以下主要阶段:1) 偏好对引导:通过迭代采样模型输出,并使用两个开放词汇检测器进行交叉验证,自动标注句子为幻觉或非幻觉,构建高质量的领域内偏好对。2) 上下文感知偏好数据构建:利用上下文连贯的积极样本和幻觉消极样本,迭代构建上下文感知的偏好数据,用于后续训练。3) 模型训练:使用上下文感知的偏好损失(C-DPO)训练模型,强调在句子级别进行判别学习,从而抑制幻觉的产生。

关键创新:SENTINEL的关键创新在于:1) 句子级早期干预:直接在幻觉产生的早期阶段进行干预,更有效地抑制幻觉。2) 无人工标注的偏好学习:通过自动化的方式构建高质量的偏好数据,避免了对昂贵的人工标注的依赖。3) 上下文感知的偏好学习:考虑了句子之间的上下文关系,使模型能够生成更连贯和准确的文本。

关键设计:论文使用了上下文感知的偏好损失(C-DPO)来训练模型。C-DPO损失函数的设计旨在最大化积极样本的概率,同时最小化消极样本(幻觉样本)的概率,并且考虑了句子之间的上下文关系。具体的损失函数形式未知,需要在论文中查找。

🖼️ 关键图片

📊 实验亮点

SENTINEL框架在实验中表现出色,与原始模型相比,幻觉减少了90%以上。此外,SENTINEL在幻觉基准测试和通用能力基准测试中均优于先前的最先进方法,证明了其优越性和泛化能力。这些结果表明,SENTINEL是一种有效的幻觉缓解方法,具有很强的实际应用价值。

🎯 应用场景

该研究成果可应用于各种需要可靠多模态理解的场景,例如:视觉问答、图像描述、机器人导航等。通过减少对象幻觉,可以提高多模态大语言模型在这些应用中的准确性和可靠性,从而提升用户体验和安全性。未来,该方法有望推广到更广泛的多模态任务中,并促进人机交互的进一步发展。

📄 摘要(原文)

Multimodal large language models (MLLMs) have revolutionized cross-modal understanding but continue to struggle with hallucinations - fabricated content contradicting visual inputs. Existing hallucination mitigation methods either incur prohibitive computational costs or introduce distribution mismatches between training data and model outputs. We identify a critical insight: hallucinations predominantly emerge at the early stages of text generation and propagate through subsequent outputs. To address this, we propose SENTINEL (Sentence-level Early iNtervention Through IN-domain prEference Learning), a framework that eliminates dependency on human annotations. Specifically, we first bootstrap high-quality in-domain preference pairs by iteratively sampling model outputs, validating object existence through cross-checking with two open-vocabulary detectors, and classifying sentences into hallucinated/non-hallucinated categories. Subsequently, we use context-coherent positive samples and hallucinated negative samples to build context-aware preference data iteratively. Finally, we train models using a context-aware preference loss (C-DPO) that emphasizes discriminative learning at the sentence level where hallucinations initially manifest. Experimental results show that SENTINEL can reduce hallucinations by over 90% compared to the original model and outperforms the previous state-of-the-art method on both hallucination benchmarks and general capabilities benchmarks, demonstrating its superiority and generalization ability. The models, datasets, and code are available at https://github.com/pspdada/SENTINEL.