Boosting Multimodal Learning via Disentangled Gradient Learning

作者: Shicai Wei, Chunbo Luo, Yang Luo

分类: cs.CV

发布日期: 2025-07-14

备注: Accepted to ICCV2025

🔗 代码/项目: GITHUB

💡 一句话要点

提出解耦梯度学习框架DGL,解决多模态学习中模态编码器与融合模块的优化冲突问题。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态学习 梯度解耦 模态融合 优化冲突 单模态学习

📋 核心要点

- 多模态学习中,各模态性能常低于单模态,现有方法未能解释主导模态性能下降的原因。

- 论文提出解耦梯度学习(DGL)框架,通过截断和替换梯度,分离模态编码器和融合模块的优化。

- 实验表明,DGL在多种模态、任务和框架下均有效,验证了解耦梯度学习的优越性。

📝 摘要(中文)

多模态学习常遇到欠优化问题,性能甚至不如单模态学习。现有方法将其归因于模态间的不平衡学习,并通过梯度调制进行重平衡。然而,它们未能解释为何多模态模型中的主导模态也比单模态学习表现更差。本文揭示了多模态模型中模态编码器和模态融合模块之间的优化冲突。具体而言,我们证明了多模态模型中的跨模态融合会降低反向传播到每个模态编码器的梯度,导致多模态模型中每个模态的性能不如单模态模型。为此,我们提出了一个解耦梯度学习(DGL)框架,以解耦多模态模型中模态编码器和模态融合模块的优化。DGL截断了从多模态损失反向传播到模态编码器的梯度,并用来自单模态损失的梯度替换它。此外,DGL移除了从单模态损失反向传播到模态融合模块的梯度。这有助于消除模态编码器和模态融合模块之间的梯度干扰,同时确保它们各自的优化过程。最后,在多种模态类型、任务和具有密集跨模态交互的框架上的大量实验证明了所提出的DGL的有效性和通用性。

🔬 方法详解

问题定义:多模态学习模型中,各模态的性能往往低于对应的单模态模型,即使是主导模态也不例外。现有方法主要关注模态之间的不平衡问题,但忽略了模态编码器和模态融合模块之间的优化冲突。这种冲突导致模态编码器接收到的梯度减小,从而影响其学习效果。

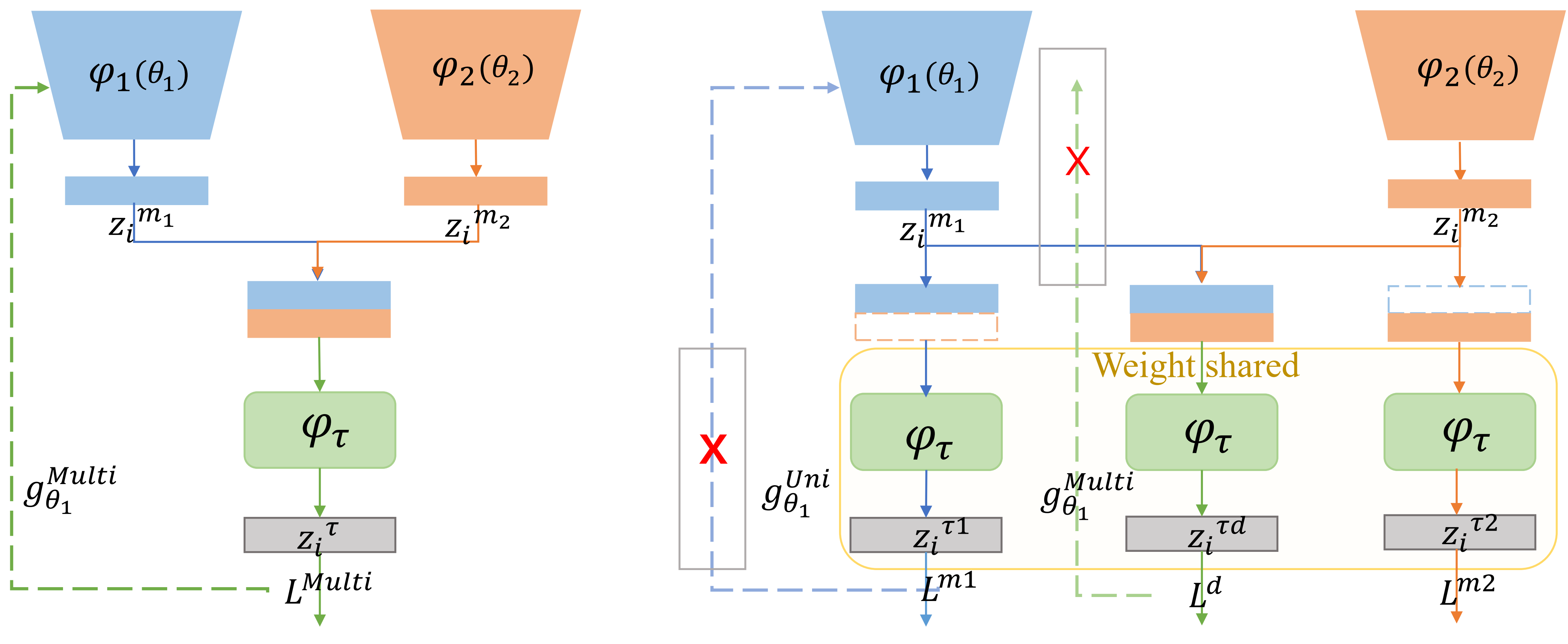

核心思路:论文的核心思路是解耦模态编码器和模态融合模块的优化过程。通过截断和替换梯度,使得模态编码器专注于学习单模态特征,而模态融合模块专注于学习跨模态交互,从而避免两者之间的干扰。

技术框架:DGL框架主要包含以下几个步骤:首先,分别计算单模态损失和多模态损失。然后,截断从多模态损失反向传播到模态编码器的梯度,并用从单模态损失计算得到的梯度替换它。同时,移除从单模态损失反向传播到模态融合模块的梯度。最后,利用更新后的梯度进行模型参数更新。

关键创新:DGL的关键创新在于解耦了模态编码器和模态融合模块的优化。与现有方法不同,DGL直接解决了梯度冲突问题,而不是简单地调整模态之间的权重。这种解耦策略能够更有效地利用单模态和多模态信息,从而提升模型性能。

关键设计:DGL框架的关键设计在于梯度的截断和替换。具体来说,对于每个模态编码器,只使用单模态损失计算得到的梯度进行更新,而对于模态融合模块,只使用多模态损失计算得到的梯度进行更新。这种设计保证了每个模块都能够专注于学习其特定的任务,避免了相互干扰。

🖼️ 关键图片

📊 实验亮点

论文在多个数据集和任务上进行了实验,结果表明DGL能够显著提升多模态模型的性能。例如,在一些数据集上,DGL可以将模型的准确率提升5%以上,并且在不同模态组合和模型结构下都表现出良好的泛化能力。实验结果充分验证了DGL的有效性和通用性。

🎯 应用场景

该研究成果可广泛应用于各种多模态学习任务,例如视频理解、语音识别、图像描述等。通过解耦模态编码器和融合模块的优化,可以提升多模态模型的性能和鲁棒性,从而在智能交互、自动驾驶、医疗诊断等领域发挥重要作用。

📄 摘要(原文)

Multimodal learning often encounters the under-optimized problem and may have worse performance than unimodal learning. Existing methods attribute this problem to the imbalanced learning between modalities and rebalance them through gradient modulation. However, they fail to explain why the dominant modality in multimodal models also underperforms that in unimodal learning. In this work, we reveal the optimization conflict between the modality encoder and modality fusion module in multimodal models. Specifically, we prove that the cross-modal fusion in multimodal models decreases the gradient passed back to each modality encoder compared with unimodal models. Consequently, the performance of each modality in the multimodal model is inferior to that in the unimodal model. To this end, we propose a disentangled gradient learning (DGL) framework to decouple the optimization of the modality encoder and modality fusion module in the multimodal model. DGL truncates the gradient back-propagated from the multimodal loss to the modality encoder and replaces it with the gradient from unimodal loss. Besides, DGL removes the gradient back-propagated from the unimodal loss to the modality fusion module. This helps eliminate the gradient interference between the modality encoder and modality fusion module while ensuring their respective optimization processes. Finally, extensive experiments on multiple types of modalities, tasks, and frameworks with dense cross-modal interaction demonstrate the effectiveness and versatility of the proposed DGL. Code is available at \href{https://github.com/shicaiwei123/ICCV2025-GDL}{https://github.com/shicaiwei123/ICCV2025-GDL}