3DGAA: Realistic and Robust 3D Gaussian-based Adversarial Attack for Autonomous Driving

作者: Yixun Zhang, Lizhi Wang, Junjun Zhao, Wending Zhao, Feng Zhou, Yonghao Dang, Jianqin Yin

分类: cs.CV

发布日期: 2025-07-14 (更新: 2025-09-29)

备注: Submitted to WACV 2026

💡 一句话要点

提出基于3D高斯模型的对抗攻击框架3DGAA,提升自动驾驶目标检测系统的安全性。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 对抗攻击 3D高斯溅射 自动驾驶 目标检测 物理攻击 鲁棒性 可迁移性

📋 核心要点

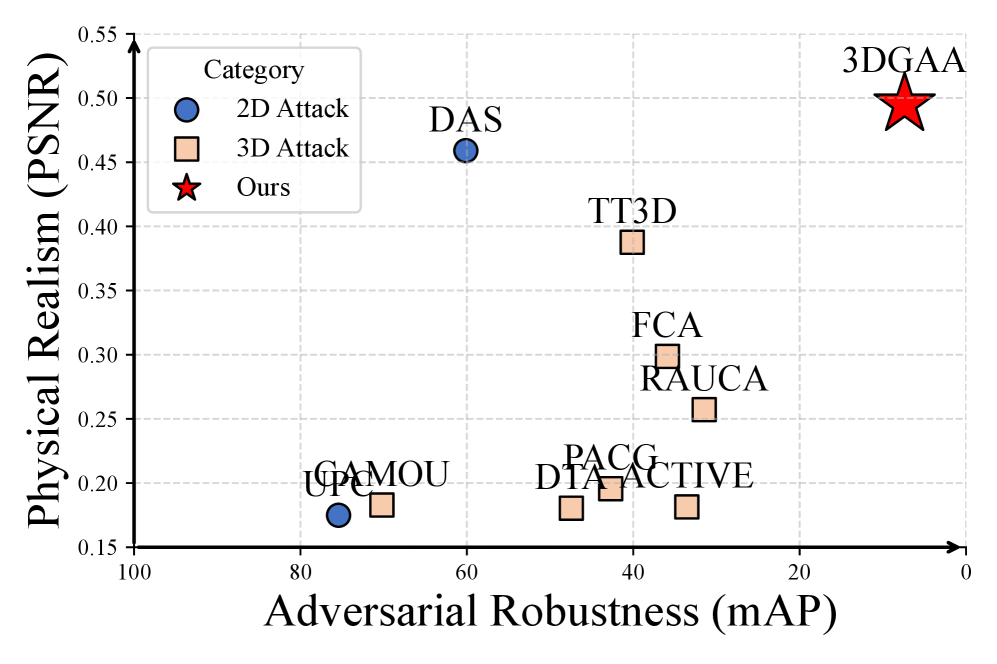

- 现有2D/3D物理攻击侧重纹理优化,难以兼顾物理真实性和攻击鲁棒性,对自动驾驶系统构成安全威胁。

- 3DGAA利用3D高斯模型,联合优化几何和外观属性,生成物理上可行且具有迁移性的对抗性目标。

- 实验表明,3DGAA显著降低目标检测mAP,优于现有3D物理攻击,并在不同物理条件下保持高迁移性。

📝 摘要(中文)

本文提出了一种新颖的基于3D高斯模型的对抗攻击框架(3DGAA),用于生成逼真且鲁棒的对抗性目标,以攻击自动驾驶中基于摄像头的目标检测系统。与现有侧重于纹理优化的2D和3D物理攻击不同,3DGAA利用3D高斯溅射(3DGS)的完整14维参数化,联合优化几何形状和外观,从而以物理上可实现的方式生成对抗性目标。此外,引入物理过滤模块来过滤异常值以保持几何保真度,并引入物理增强模块来模拟复杂的物理场景,从而增强攻击在真实环境中的泛化能力。在虚拟基准和使用微型车辆模型的物理环境中评估了3DGAA。实验结果表明,3DGAA能够将检测mAP从87.21%降低到7.38%,显著优于现有的3D物理攻击。此外,该方法在不同的物理条件下保持了较高的可迁移性,展示了物理可实现对抗攻击的新技术水平。

🔬 方法详解

问题定义:现有的基于摄像头的自动驾驶目标检测系统容易受到对抗攻击的影响,尤其是在物理世界中。现有的2D和3D物理攻击方法通常侧重于纹理优化,难以在物理真实性和攻击鲁棒性之间取得平衡。这些方法生成的对抗样本可能在物理世界中难以实现,或者在不同的物理条件下效果不佳。

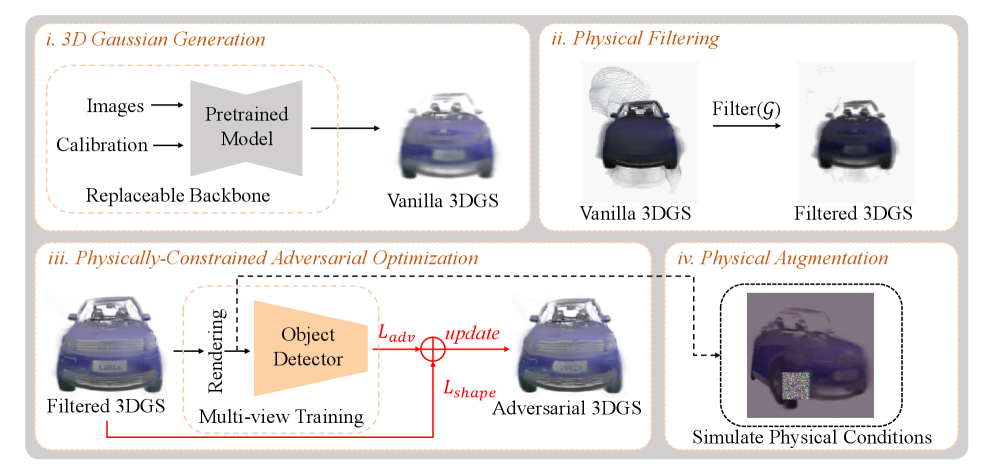

核心思路:本文的核心思路是利用3D高斯溅射(3DGS)的参数化能力,同时优化对抗样本的几何形状和外观属性。通过联合扰动形状、尺度、旋转、颜色和透明度等参数,生成更逼真、更鲁棒的对抗性目标。这种方法旨在克服现有方法仅关注纹理优化带来的局限性,提高对抗攻击在物理世界中的有效性和可迁移性。

技术框架:3DGAA框架主要包含三个模块:对抗目标生成模块、物理过滤模块和物理增强模块。对抗目标生成模块利用3DGS的参数化能力,通过优化目标函数生成对抗样本。物理过滤模块用于过滤掉不符合物理规律的异常值,保持对抗样本的几何保真度。物理增强模块通过模拟各种物理场景,如不同的光照条件、视角和遮挡等,增强对抗样本的泛化能力。

关键创新:3DGAA的关键创新在于利用3DGS的完整14维参数化,实现了几何形状和外观属性的联合优化。与现有方法仅关注纹理优化不同,3DGAA能够更全面地控制对抗样本的物理属性,从而生成更逼真、更鲁棒的对抗性目标。此外,物理过滤模块和物理增强模块进一步提高了对抗攻击在物理世界中的有效性和可迁移性。

关键设计:对抗目标生成模块使用基于梯度下降的优化算法,迭代更新3DGS的参数,以最大化目标检测器的损失函数。目标函数包括对抗损失、几何损失和外观损失。对抗损失用于降低目标检测器的置信度,几何损失用于保持对抗样本的几何形状,外观损失用于保持对抗样本的外观逼真度。物理过滤模块使用统计方法过滤掉不符合物理规律的异常值。物理增强模块通过随机变换光照、视角和遮挡等参数,生成不同的训练样本。

🖼️ 关键图片

📊 实验亮点

实验结果表明,3DGAA能够显著降低目标检测器的性能,将mAP从87.21%降低到7.38%,大幅优于现有的3D物理攻击方法。此外,3DGAA在不同的物理条件下表现出很高的可迁移性,表明其生成的对抗样本在真实世界中具有很强的攻击能力。这些结果验证了3DGAA的有效性和鲁棒性,为自动驾驶系统的安全性研究提供了新的思路。

🎯 应用场景

3DGAA的研究成果可应用于提升自动驾驶系统的安全性,通过评估和增强目标检测算法的鲁棒性,防御潜在的物理对抗攻击。此外,该方法也可用于其他计算机视觉任务,如机器人导航、智能监控等,提高系统在复杂物理环境中的可靠性。未来,该研究可推动对抗攻击和防御技术的发展,促进更安全、更可靠的智能系统设计。

📄 摘要(原文)

Camera-based object detection systems play a vital role in autonomous driving, yet they remain vulnerable to adversarial threats in real-world environments. Existing 2D and 3D physical attacks, due to their focus on texture optimization, often struggle to balance physical realism and attack robustness. In this work, we propose 3D Gaussian-based Adversarial Attack (3DGAA), a novel adversarial object generation framework that leverages the full 14-dimensional parameterization of 3D Gaussian Splatting (3DGS) to jointly optimize geometry and appearance in physically realizable ways. Unlike prior works that rely on patches or texture optimization, 3DGAA jointly perturbs both geometric attributes (shape, scale, rotation) and appearance attributes (color, opacity) to produce physically realistic and transferable adversarial objects. We further introduce a physical filtering module that filters outliers to preserve geometric fidelity, and a physical augmentation module that simulates complex physical scenarios to enhance attack generalization under real-world conditions. We evaluate 3DGAA on both virtual benchmarks and physical-world setups using miniature vehicle models. Experimental results show that 3DGAA achieves to reduce the detection mAP from 87.21\% to 7.38\%, significantly outperforming existing 3D physical attacks. Moreover, our method maintains high transferability across different physical conditions, demonstrating a new state-of-the-art in physically realizable adversarial attacks.