Can GPT-4o mini and Gemini 2.0 Flash Predict Fine-Grained Fashion Product Attributes? A Zero-Shot Analysis

作者: Shubham Shukla, Kunal Sonalkar

分类: cs.CV, cs.AI

发布日期: 2025-07-14 (更新: 2025-07-30)

备注: Version 2: Added a missing citation

🔗 代码/项目: GITHUB

💡 一句话要点

零样本分析:GPT-4o mini与Gemini 2.0 Flash在细粒度时尚产品属性预测上的能力评估

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 零样本学习 时尚属性识别 多模态学习 DeepFashion-MultiModal

📋 核心要点

- 现有方法在细粒度时尚产品属性识别方面存在不足,大型语言模型在该领域的性能尚未充分探索。

- 本文提出利用GPT-4o mini和Gemini 2.0 Flash进行零样本学习,仅使用图像作为输入,评估其在时尚产品属性识别上的能力。

- 实验结果表明,Gemini 2.0 Flash在所有属性上的宏平均F1分数为56.79%,优于GPT-4o-mini的43.28%,展现了其在该任务上的潜力。

📝 摘要(中文)

时尚零售业务的核心在于理解产品。产品属性标注有助于根据业务流程理解产品,高质量的属性标注能够改善客户体验,方便客户浏览零售网站上数百万件商品,并最终提升客户的“发现体验”。尽管大型语言模型(LLM)在理解多模态数据方面表现出卓越的能力,但它们在细粒度时尚属性识别方面的性能仍有待探索。本文对兼顾性能、速度和成本效益的先进LLM,主要是GPT-4o-mini和Gemini 2.0 Flash,进行了零样本评估。我们使用DeepFashion-MultiModal数据集评估这些模型在时尚产品属性标注任务中的表现。我们的研究评估了这些模型在18个时尚属性类别上的表现,深入了解了这些模型的优势所在。我们仅使用图像作为产品信息的唯一输入,以创建一个受限环境。分析表明,Gemini 2.0 Flash表现出最强的整体性能,在所有属性上的宏平均F1分数为56.79%,而GPT-4o-mini的宏平均F1分数为43.28%。通过详细的错误分析,我们的发现为在生产电子商务产品属性标注相关任务中部署这些LLM提供了实践见解,并强调了对特定领域微调方法的需求。这项工作也为时尚AI和多模态属性提取的未来研究奠定了基础。

🔬 方法详解

问题定义:论文旨在评估大型语言模型在细粒度时尚产品属性识别任务中的零样本学习能力。现有方法要么依赖于人工标注,成本高昂,要么在细粒度属性识别上表现不佳,无法满足电商平台对产品理解的需求。

核心思路:论文的核心思路是直接利用预训练的大型语言模型(GPT-4o mini和Gemini 2.0 Flash)的多模态理解能力,无需任何针对特定任务的训练或微调,仅通过输入产品图像,让模型预测产品的各种属性。这种零样本学习的方式可以快速部署,降低成本。

技术框架:整体流程非常简单:1) 选择DeepFashion-MultiModal数据集,该数据集包含大量的时尚产品图像和对应的属性标注;2) 将产品图像输入到GPT-4o mini或Gemini 2.0 Flash模型中;3) 模型输出预测的属性标签;4) 将预测结果与数据集中的真实标签进行比较,计算各项评估指标(如宏平均F1分数)。

关键创新:该研究的关键创新在于首次对GPT-4o mini和Gemini 2.0 Flash在细粒度时尚产品属性识别任务上的零样本学习能力进行了系统性的评估。之前的研究可能更多关注通用图像识别任务,而忽略了时尚领域的特殊性和挑战。

关键设计:论文的关键设计在于选择了DeepFashion-MultiModal数据集,该数据集包含了18个类别的时尚属性,可以全面评估模型的属性识别能力。此外,论文还采用了宏平均F1分数作为评估指标,可以更好地反映模型在各个属性类别上的平均性能,避免了类别不平衡带来的影响。

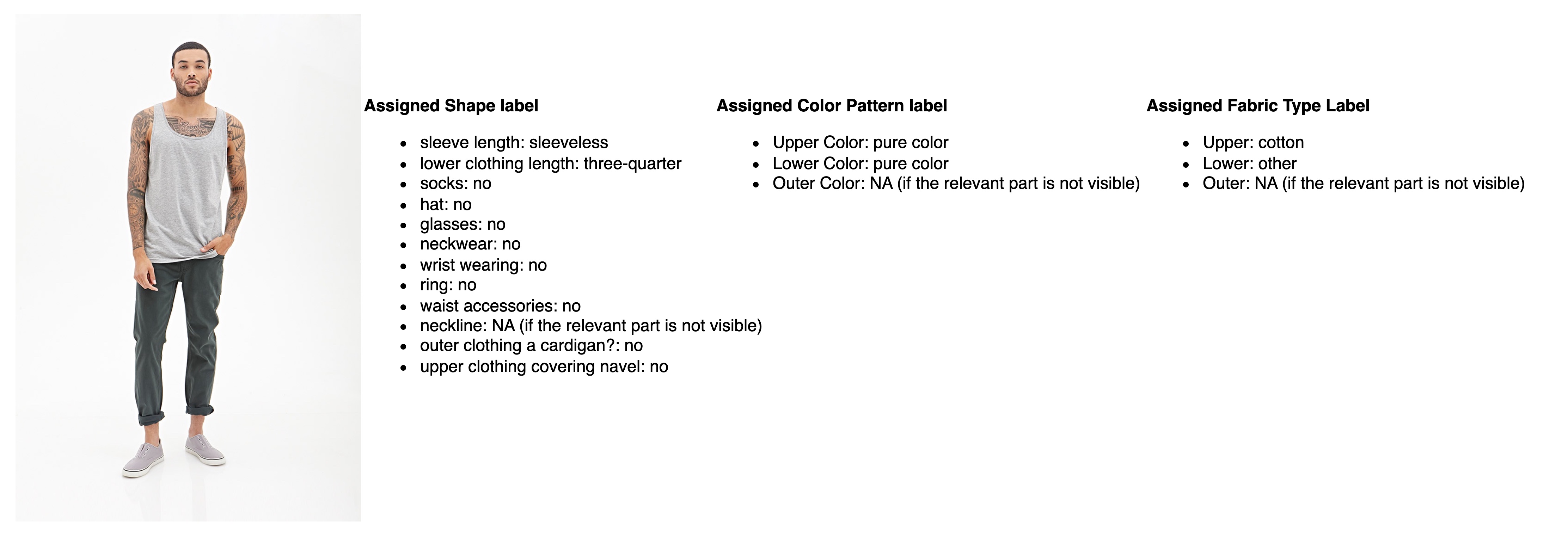

🖼️ 关键图片

📊 实验亮点

实验结果表明,Gemini 2.0 Flash在所有属性上的宏平均F1分数为56.79%,显著优于GPT-4o-mini的43.28%。这一结果表明,Gemini 2.0 Flash在细粒度时尚产品属性识别方面具有更强的零样本学习能力,更适合直接应用于电商场景。

🎯 应用场景

该研究成果可直接应用于电商平台的商品属性自动标注,提升商品搜索和推荐的准确性,改善用户购物体验。未来,该方法还可扩展到其他零售领域,例如家居用品、电子产品等,实现更智能化的商品管理和个性化推荐。

📄 摘要(原文)

The fashion retail business is centered around the capacity to comprehend products. Product attribution helps in comprehending products depending on the business process. Quality attribution improves the customer experience as they navigate through millions of products offered by a retail website. It leads to well-organized product catalogs. In the end, product attribution directly impacts the 'discovery experience' of the customer. Although large language models (LLMs) have shown remarkable capabilities in understanding multimodal data, their performance on fine-grained fashion attribute recognition remains under-explored. This paper presents a zero-shot evaluation of state-of-the-art LLMs that balance performance with speed and cost efficiency, mainly GPT-4o-mini and Gemini 2.0 Flash. We have used the dataset DeepFashion-MultiModal (https://github.com/yumingj/DeepFashion-MultiModal) to evaluate these models in the attribution tasks of fashion products. Our study evaluates these models across 18 categories of fashion attributes, offering insight into where these models excel. We only use images as the sole input for product information to create a constrained environment. Our analysis shows that Gemini 2.0 Flash demonstrates the strongest overall performance with a macro F1 score of 56.79% across all attributes, while GPT-4o-mini scored a macro F1 score of 43.28%. Through detailed error analysis, our findings provide practical insights for deploying these LLMs in production e-commerce product attribution-related tasks and highlight the need for domain-specific fine-tuning approaches. This work also lays the groundwork for future research in fashion AI and multimodal attribute extraction.