SnapMoGen: Human Motion Generation from Expressive Texts

作者: Chuan Guo, Inwoo Hwang, Jian Wang, Bing Zhou

分类: cs.CV

发布日期: 2025-07-12 (更新: 2025-10-23)

备注: Project Webpage: https://snap-research.github.io/SnapMoGen/

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

SnapMoGen:提出高质量文本驱动人体运动生成数据集与改进的生成模型MoMask++

🎯 匹配领域: 支柱四:生成式动作 (Generative Motion)

关键词: 文本到运动生成 人体运动生成 运动捕捉 数据集构建 Transformer模型 掩码建模 多尺度token 长文本生成

📋 核心要点

- 现有文本到运动生成方法受限于数据集,难以从长文本或细粒度文本生成高质量运动。

- SnapMoGen通过构建包含高质量运动捕捉数据和详细文本描述的大规模数据集来解决此问题。

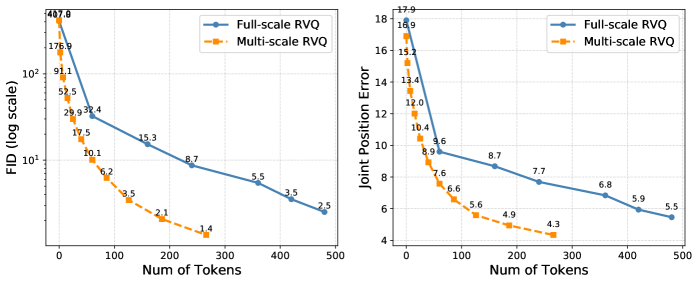

- 提出的MoMask++模型通过多尺度token序列和单生成式掩码transformer,在运动生成任务上取得了SOTA性能。

📝 摘要(中文)

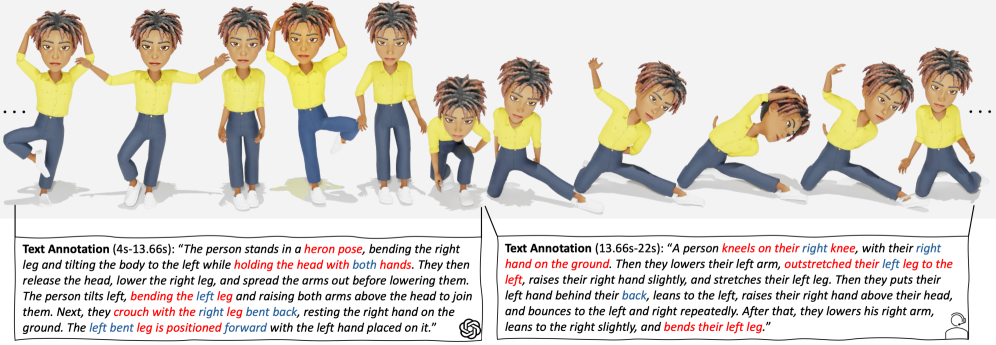

近年来,文本到运动生成取得了显著进展。然而,由于数据集的限制,当前方法主要局限于从短文本或通用文本提示中合成运动,这削弱了细粒度的可控性和对未见提示的泛化能力。本文介绍了一个新的文本-运动数据集SnapMoGen,该数据集具有高质量的运动捕捉数据和准确、富有表现力的文本注释。该数据集包含20K个运动片段,总计44小时,以及122K个详细的文本描述,平均每个描述48个单词(相比之下,HumanML3D为12个单词)。重要的是,这些运动片段保留了原始的时间连续性,因为它们位于长序列中,这有助于长期运动生成和混合的研究。此外,我们改进了先前的生成式掩码建模方法。我们的模型MoMask++将运动转换为多尺度token序列,更好地利用了token容量,并学习使用单个生成式掩码transformer生成所有token。MoMask++在HumanML3D和SnapMoGen基准测试中都实现了最先进的性能。此外,我们通过使用LLM重新格式化输入以与SnapMoGen的表现力和叙述风格对齐,展示了处理随意用户提示的能力。

🔬 方法详解

问题定义:现有文本到运动生成方法受限于数据集规模和文本描述的丰富程度,难以生成与复杂、细粒度文本描述相符的自然、流畅的人体运动。现有方法在处理长文本提示和未见过的提示时,泛化能力较弱。

核心思路:论文的核心思路是构建一个大规模、高质量的文本-运动数据集,并在此基础上改进生成模型。通过更丰富的数据,模型能够学习到更细致的文本和运动之间的对应关系,从而提升生成质量和泛化能力。同时,通过改进的生成模型,更好地利用数据集中的信息,提升生成效率和质量。

技术框架:整体框架包含两个主要部分:数据集构建和模型设计。数据集构建方面,收集了大量的运动捕捉数据,并配以详细的文本描述。模型设计方面,提出了MoMask++模型,该模型基于Transformer架构,采用掩码建模的方式进行训练。MoMask++将运动数据转换为多尺度token序列,并使用单个生成式掩码Transformer生成所有token。

关键创新:论文的关键创新点在于:1) 构建了大规模、高质量的SnapMoGen数据集,该数据集包含丰富的文本描述和连续的运动捕捉数据。2) 提出了MoMask++模型,该模型通过多尺度token序列和单生成式掩码Transformer,有效地利用了数据集中的信息,提升了生成质量和效率。

关键设计:MoMask++的关键设计包括:1) 多尺度token序列:将运动数据转换为不同尺度的token序列,以便模型能够捕捉不同层次的运动信息。2) 单生成式掩码Transformer:使用单个Transformer生成所有token,避免了传统方法中需要多个Transformer的问题,提高了生成效率。3) 使用LLM对用户输入进行重格式化,使其与SnapMoGen数据集的风格对齐,从而提升了模型在实际应用中的效果。

🖼️ 关键图片

📊 实验亮点

MoMask++模型在HumanML3D和SnapMoGen数据集上均取得了SOTA性能。在SnapMoGen数据集上,MoMask++能够生成与长文本描述相符的自然、流畅的人体运动。此外,通过结合LLM,该模型能够处理随意用户提示,展示了良好的泛化能力。

🎯 应用场景

该研究成果可应用于虚拟现实、游戏开发、动画制作等领域。通过输入自然语言描述,可以生成逼真的人体运动,从而简化内容创作流程,提升用户体验。未来,该技术有望应用于人机交互、机器人控制等更广泛的领域。

📄 摘要(原文)

Text-to-motion generation has experienced remarkable progress in recent years. However, current approaches remain limited to synthesizing motion from short or general text prompts, primarily due to dataset constraints. This limitation undermines fine-grained controllability and generalization to unseen prompts. In this paper, we introduce SnapMoGen, a new text-motion dataset featuring high-quality motion capture data paired with accurate, expressive textual annotations. The dataset comprises 20K motion clips totaling 44 hours, accompanied by 122K detailed textual descriptions averaging 48 words per description (vs. 12 words of HumanML3D). Importantly, these motion clips preserve original temporal continuity as they were in long sequences, facilitating research in long-term motion generation and blending. We also improve upon previous generative masked modeling approaches. Our model, MoMask++, transforms motion into multi-scale token sequences that better exploit the token capacity, and learns to generate all tokens using a single generative masked transformer. MoMask++ achieves state-of-the-art performance on both HumanML3D and SnapMoGen benchmarks. Additionally, we demonstrate the ability to process casual user prompts by employing an LLM to reformat inputs to align with the expressivity and narration style of SnapMoGen. Project webpage: https://snap-research.github.io/SnapMoGen/