VIP: Visual Information Protection through Adversarial Attacks on Vision-Language Models

作者: Hanene F. Z. Brachemi Meftah, Wassim Hamidouche, Sid Ahmed Fezza, Olivier Déforges

分类: eess.IV, cs.CV, cs.LG

发布日期: 2025-07-11

🔗 代码/项目: GITHUB

💡 一句话要点

提出基于对抗攻击的视觉信息保护方法,用于保护视觉-语言模型中的隐私信息。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视觉-语言模型 对抗攻击 隐私保护 感兴趣区域 多模态学习

📋 核心要点

- 现有的视觉-语言模型存在隐私泄露风险,容易无意中处理或暴露用户的敏感视觉信息。

- 该论文提出一种新的对抗攻击策略,选择性地隐藏图像中感兴趣区域的信息,保护隐私的同时保持图像整体语义。

- 实验结果表明,该方法能够有效降低视觉-语言模型检测目标区域的准确率,同时保持图像的全局语义完整性。

📝 摘要(中文)

近年来,视觉-语言模型(VLMs)在处理文本和视觉输入方面取得了显著进展。这些模型表现出了令人印象深刻的性能,并在各种应用中得到广泛应用。然而,这种广泛应用也引发了对用户隐私的严重担忧,尤其是在模型无意中处理或暴露私人视觉信息时。本文将VLMs中的隐私保护问题定义为对抗攻击问题。我们提出了一种新的攻击策略,选择性地隐藏图像中指定感兴趣区域(ROIs)内的信息,有效地阻止VLMs访问敏感内容,同时保持图像其余部分的语义完整性。与通常会破坏整个图像的传统对抗攻击不同,我们的方法在未被遮蔽的区域保持了高度的连贯性。在LLaVA、Instruct-BLIP和BLIP2-T5这三个最先进的VLMs上的实验结果表明,检测目标ROIs的准确率降低了高达98%,同时保持了全局图像语义的完整性,这得到了干净输出和对抗输出之间的高相似性分数的证实。我们相信这项工作有助于在多模态模型中实现更具隐私意识的使用,并为进一步研究提供实用的工具,源代码可在https://github.com/hbrachemi/Vlm_defense-attack公开获取。

🔬 方法详解

问题定义:论文旨在解决视觉-语言模型(VLMs)中存在的隐私泄露问题。现有方法,如直接使用VLMs进行图像理解,可能无意中暴露图像中的敏感信息,例如人脸、身份标识等。传统的对抗攻击虽然可以干扰模型,但通常会破坏整个图像,影响图像的可用性。因此,需要一种方法能够在保护隐私的同时,尽可能保持图像的语义完整性。

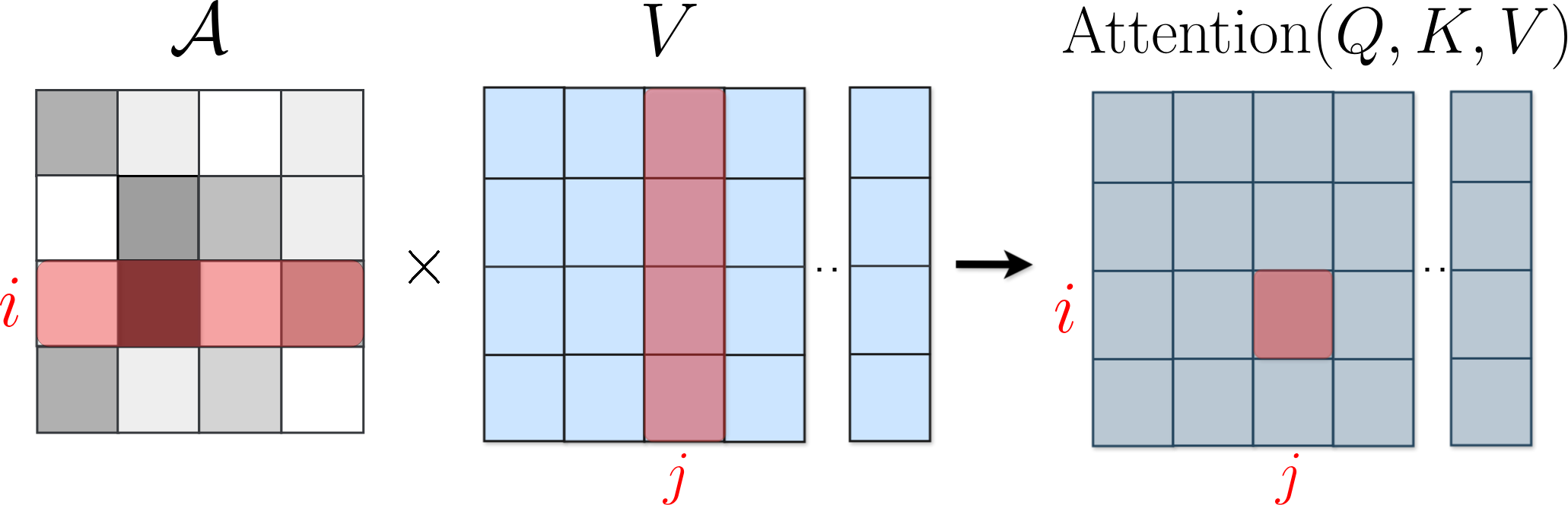

核心思路:论文的核心思路是将隐私保护问题转化为一个对抗攻击问题。通过在图像的特定区域(感兴趣区域,ROIs)引入对抗扰动,使得VLMs无法正确识别或理解这些区域的内容,从而达到保护隐私的目的。同时,通过控制扰动的范围和强度,尽可能减少对图像其余部分的影响,保持图像的整体语义。

技术框架:该方法主要包含以下几个阶段:1) 确定感兴趣区域(ROIs):根据需要保护的隐私信息,确定图像中需要进行对抗攻击的区域。2) 生成对抗扰动:针对ROIs,生成能够欺骗VLMs的对抗扰动。3) 将扰动添加到图像:将生成的对抗扰动添加到原始图像的ROIs中,生成对抗样本。4) 评估攻击效果:使用VLMs对对抗样本进行测试,评估攻击是否成功,即VLMs是否无法正确识别或理解ROIs中的内容。同时,评估图像的语义保持程度。

关键创新:该方法的关键创新在于:1) 选择性攻击:只针对图像的特定区域进行攻击,而不是像传统对抗攻击那样干扰整个图像。2) 隐私保护与语义保持的平衡:通过控制扰动的范围和强度,在保护隐私的同时,尽可能保持图像的整体语义。3) 针对VLMs的对抗攻击:专门针对视觉-语言模型设计对抗攻击方法,利用VLMs的特性来提高攻击的有效性。

关键设计:论文中可能涉及的关键设计包括:1) 对抗扰动的生成方法:例如,可以使用基于梯度的方法(如FGSM、PGD)或基于优化的方法来生成对抗扰动。2) 损失函数的设计:损失函数需要考虑两个方面:一是攻击的有效性,即扰动能够成功欺骗VLMs;二是图像的语义保持程度,即扰动不能过度破坏图像的整体语义。3) ROIs的选择策略:如何选择需要保护的ROIs,例如,可以使用目标检测算法来自动识别图像中的敏感区域。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在LLaVA、Instruct-BLIP和BLIP2-T5三个先进的视觉-语言模型上,能够将目标感兴趣区域的检测准确率降低高达98%。同时,通过计算干净图像和对抗样本之间的相似度,验证了该方法能够在有效保护隐私的同时,保持图像的全局语义完整性。这些结果表明该方法在视觉-语言模型的隐私保护方面具有显著优势。

🎯 应用场景

该研究成果可应用于多种场景,例如:保护社交媒体平台用户上传图片的隐私,防止人脸识别系统滥用,以及在医学图像分析中保护患者的敏感信息。通过对抗攻击,可以有效防止视觉-语言模型泄露图像中的隐私信息,从而促进多模态模型的安全应用和发展。未来,该技术可以集成到图像处理工具或隐私保护软件中,为用户提供更便捷的隐私保护服务。

📄 摘要(原文)

Recent years have witnessed remarkable progress in developing Vision-Language Models (VLMs) capable of processing both textual and visual inputs. These models have demonstrated impressive performance, leading to their widespread adoption in various applications. However, this widespread raises serious concerns regarding user privacy, particularly when models inadvertently process or expose private visual information. In this work, we frame the preservation of privacy in VLMs as an adversarial attack problem. We propose a novel attack strategy that selectively conceals information within designated Region Of Interests (ROIs) in an image, effectively preventing VLMs from accessing sensitive content while preserving the semantic integrity of the remaining image. Unlike conventional adversarial attacks that often disrupt the entire image, our method maintains high coherence in unmasked areas. Experimental results across three state-of-the-art VLMs namely LLaVA, Instruct-BLIP, and BLIP2-T5 demonstrate up to 98% reduction in detecting targeted ROIs, while maintaining global image semantics intact, as confirmed by high similarity scores between clean and adversarial outputs. We believe that this work contributes to a more privacy conscious use of multimodal models and offers a practical tool for further research, with the source code publicly available at: https://github.com/hbrachemi/Vlm_defense-attack.