Dual Dimensions Geometric Representation Learning Based Document Dewarping

作者: Heng Li, Qingcai Chen, Xiangping Wu

分类: cs.CV

发布日期: 2025-07-11 (更新: 2025-07-16)

🔗 代码/项目: GITHUB

💡 一句话要点

提出基于双维度几何表征学习的文档图像去畸变方法D2Dewarp

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 文档去畸变 几何表征学习 双维度感知 形变估计 特征融合

📋 核心要点

- 现有文档去畸变方法主要依赖文本行信息,但忽略了垂直方向的形变感知,限制了校正效果。

- D2Dewarp模型通过同时关注文档的水平和垂直方向的线条,实现更精细的形变感知和校正。

- 论文提出了自动标注方法构建大规模数据集,并在中英文数据集上验证了D2Dewarp的优越性。

📝 摘要(中文)

文档图像去畸变在深度学习时代仍然是一个具有挑战性的任务。现有方法虽然通过利用文本行感知有所改进,但通常只关注单一的水平维度。本文提出了一种细粒度的形变感知模型,称为D2Dewarp,它专注于文档水平和垂直方向的双维度,以改善文档去畸变效果。该模型可以感知文档细节中不同方向的畸变趋势。为了结合水平和垂直粒度特征,设计了一个基于X和Y坐标的有效融合模块,以促进两个维度之间的交互和约束,实现特征互补。由于当前公开的去畸变数据集中缺乏带标注的线条特征,我们还提出了一种自动细粒度标注方法,利用公开的文档纹理图像和一个自动渲染引擎来构建一个新的大规模畸变训练数据集。代码和数据集将公开发布。在公开的中英文基准测试中,定量和定性结果均表明,与最先进的方法相比,我们的方法取得了更好的校正效果。

🔬 方法详解

问题定义:文档图像去畸变旨在消除扫描或拍摄文档时产生的几何畸变,使其恢复到原始的平面状态。现有方法主要依赖于文本行信息,但通常只关注水平方向的形变,忽略了垂直方向的形变,导致校正效果不佳,尤其是在复杂畸变情况下。此外,缺乏带有细粒度标注(如水平和垂直线条)的大规模数据集也是一个挑战。

核心思路:D2Dewarp的核心思路是同时利用文档图像的水平和垂直方向的线条信息,进行双维度的形变感知。通过捕捉两个方向上的畸变趋势,可以更准确地估计文档的形变场,从而实现更精确的去畸变。这种双维度的方法能够更好地处理复杂的文档畸变情况。

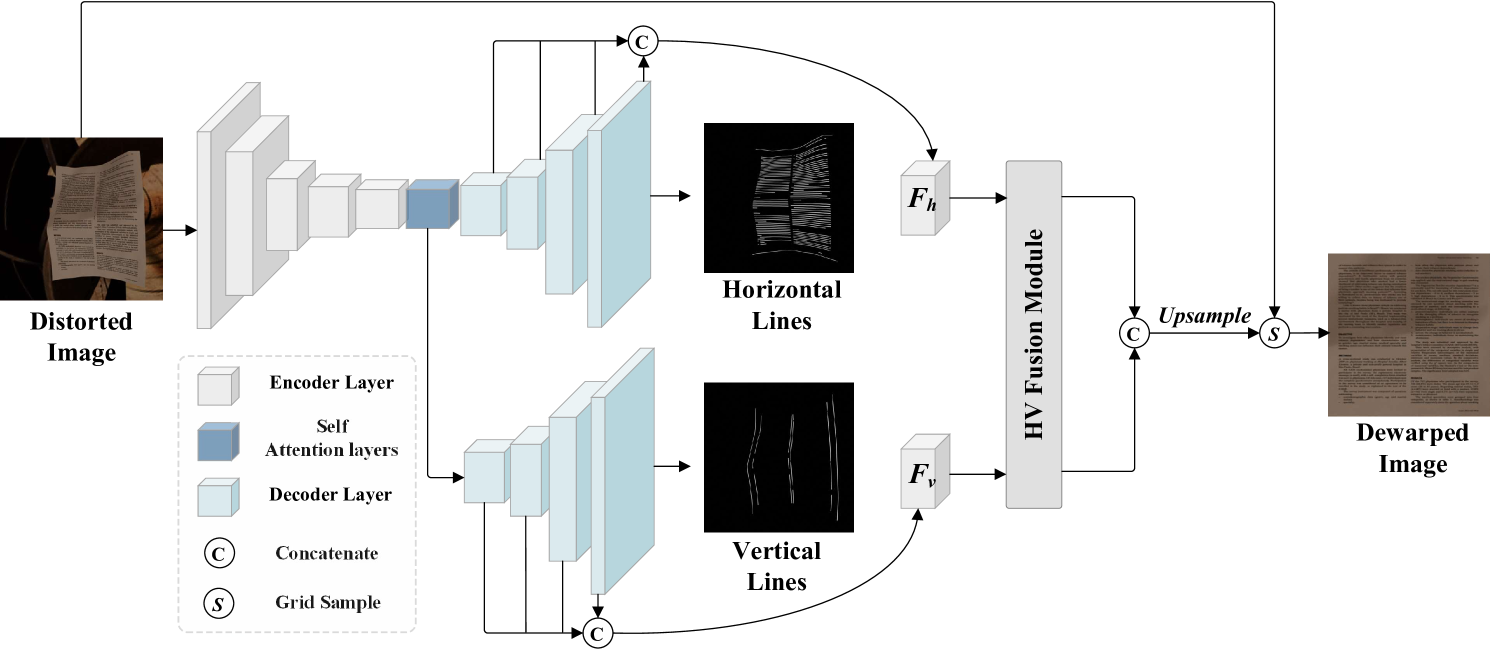

技术框架:D2Dewarp的整体框架包含以下几个主要模块:1) 特征提取模块:用于提取文档图像的特征表示。2) 水平线条形变感知模块:用于感知水平方向的线条形变。3) 垂直线条形变感知模块:用于感知垂直方向的线条形变。4) 特征融合模块:基于X和Y坐标,将水平和垂直方向的特征进行融合,实现特征互补。5) 形变场估计模块:利用融合后的特征估计文档的形变场。6) 图像校正模块:根据估计的形变场对文档图像进行校正。

关键创新:D2Dewarp的关键创新在于其双维度的形变感知方法,即同时考虑水平和垂直方向的线条信息。与现有方法只关注单一维度相比,D2Dewarp能够更全面地捕捉文档的形变信息,从而实现更精确的去畸变。此外,自动生成细粒度标注数据集的方法也是一个重要的创新点,解决了缺乏训练数据的问题。

关键设计:特征融合模块是关键设计之一,它基于X和Y坐标将水平和垂直方向的特征进行融合,促进两个维度之间的交互和约束。具体的网络结构和损失函数细节在论文中应该有更详细的描述(未知)。自动标注数据集的方法利用了公开的文档纹理图像和自动渲染引擎,生成带有水平和垂直线条标注的合成数据。

🖼️ 关键图片

📊 实验亮点

D2Dewarp在公开的中英文基准测试中取得了优于现有最先进方法的去畸变效果。具体性能数据(如PSNR、SSIM等)和提升幅度需要在论文中查找(未知)。该方法在视觉效果上也表现出更好的校正能力,尤其是在处理复杂畸变时。

🎯 应用场景

D2Dewarp可应用于文档数字化、档案管理、OCR识别等领域。通过消除文档图像的几何畸变,可以提高OCR的识别精度,改善文档的阅读体验,并为后续的文档分析和处理提供更好的基础。该技术在图书馆、档案馆、企业等场景下具有广泛的应用前景,有助于提高工作效率和数据质量。

📄 摘要(原文)

Document image dewarping remains a challenging task in the deep learning era. While existing methods have improved by leveraging text line awareness, they typically focus only on a single horizontal dimension. In this paper, we propose a fine-grained deformation perception model that focuses on Dual Dimensions of document horizontal-vertical-lines to improve document Dewarping called D2Dewarp. It can perceive distortion trends in different directions across document details. To combine the horizontal and vertical granularity features, an effective fusion module based on X and Y coordinate is designed to facilitate interaction and constraint between the two dimensions for feature complementarity. Due to the lack of annotated line features in current public dewarping datasets, we also propose an automatic fine-grained annotation method using public document texture images and an automatic rendering engine to build a new large-scale distortion training dataset. The code and dataset will be publicly released. On public Chinese and English benchmarks, both quantitative and qualitative results show that our method achieves better rectification results compared with the state-of-the-art methods. The dataset will be publicly available at https://github.com/xiaomore/DocDewarpHV