RegGS: Unposed Sparse Views Gaussian Splatting with 3DGS Registration

作者: Chong Cheng, Yu Hu, Sicheng Yu, Beizhen Zhao, Zijian Wang, Hao Wang

分类: cs.CV

发布日期: 2025-07-10 (更新: 2025-07-18)

备注: Accepted to ICCV 2025

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

RegGS:基于3DGS配准的无位姿稀疏视图高斯溅射重建

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 3D高斯溅射 稀疏视图重建 高斯配准 最优传输 新视角合成 位姿估计 场景对齐

📋 核心要点

- 现有基于优化的3DGS方法在稀疏视图下重建效果差,因为缺乏足够的先验信息。

- RegGS通过3D高斯配准,将前馈网络生成的局部高斯对齐到全局一致的表示,从而解决稀疏视图问题。

- 实验表明,RegGS能高保真地配准局部高斯,实现精确的位姿估计和高质量的新视角合成。

📝 摘要(中文)

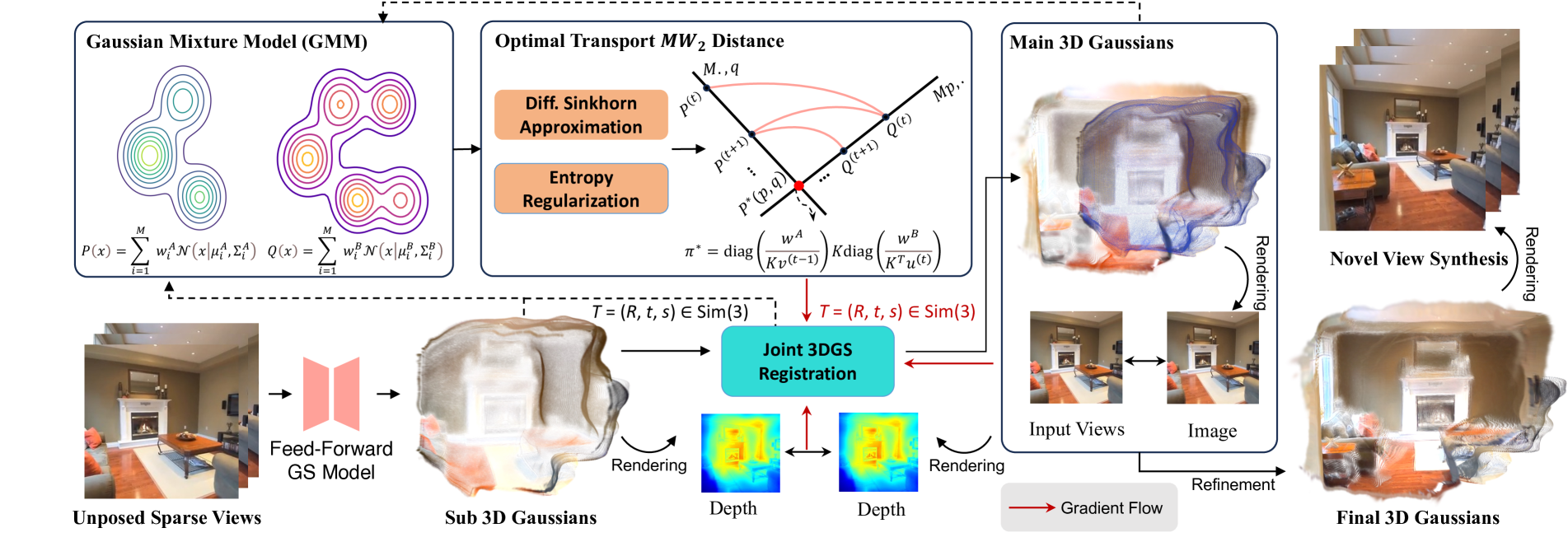

3D高斯溅射(3DGS)已展现出从无位姿图像重建场景的潜力。然而,基于优化的3DGS方法由于先验知识有限,在稀疏视图下表现不佳。同时,前馈高斯方法受到输入格式的限制,难以整合更多输入视图。为了解决这些挑战,我们提出了RegGS,一个基于3D高斯配准的框架,用于重建无位姿稀疏视图。RegGS将前馈网络生成的局部3D高斯对齐到全局一致的3D高斯表示中。在技术上,我们实现了一种熵正则化的Sinkhorn算法,以高效地求解最优传输混合2-Wasserstein (MW2)距离,该距离作为Sim(3)空间中高斯混合模型(GMM)的对齐度量。此外,我们设计了一个联合3DGS配准模块,集成了MW2距离、光度一致性和深度几何。这实现了由粗到精的配准过程,同时准确地估计相机位姿并对齐场景。在RE10K和ACID数据集上的实验表明,RegGS有效地以高保真度配准局部高斯,实现了精确的位姿估计和高质量的新视角合成。

🔬 方法详解

问题定义:论文旨在解决在无位姿的稀疏视图下,如何高质量地重建3D场景的问题。现有的基于优化的3DGS方法在稀疏视图下,由于缺乏足够的几何先验信息,容易陷入局部最优,导致重建质量下降。而前馈高斯方法虽然速度快,但难以有效融合多个视角的输入信息,限制了其在稀疏视图场景下的应用。

核心思路:RegGS的核心思路是将场景分解为多个局部高斯表示,然后通过高斯配准的方式,将这些局部表示对齐到全局一致的坐标系下。这种方法既能利用前馈网络的快速生成能力,又能通过配准的方式,融合多个视角的几何信息,从而提高重建质量。

技术框架:RegGS的整体框架包含以下几个主要模块:1) 局部高斯生成模块:使用前馈网络从每个视图中生成局部3D高斯表示。2) 高斯配准模块:使用熵正则化的Sinkhorn算法计算MW2距离,作为高斯混合模型的对齐度量,并估计Sim(3)变换。3) 联合优化模块:将MW2距离、光度一致性和深度几何信息整合到一个联合损失函数中,进行由粗到精的位姿估计和场景对齐。

关键创新:RegGS的关键创新在于提出了基于最优传输的3D高斯配准方法。具体来说,使用熵正则化的Sinkhorn算法高效地计算MW2距离,并将其作为高斯混合模型的对齐度量。这种方法能够有效地处理高斯分布之间的复杂关系,从而实现更精确的配准。与传统的基于ICP的配准方法相比,RegGS能够更好地处理噪声和离群点,并且不需要进行显式的对应关系匹配。

关键设计:在损失函数设计方面,RegGS综合考虑了MW2距离、光度一致性和深度几何信息。MW2距离用于约束高斯分布之间的对齐程度,光度一致性用于约束渲染图像与输入图像之间的相似度,深度几何信息用于约束重建场景的几何一致性。此外,RegGS还采用了由粗到精的配准策略,首先使用全局配准进行粗略的位姿估计,然后使用局部配准进行精细的场景对齐。

🖼️ 关键图片

📊 实验亮点

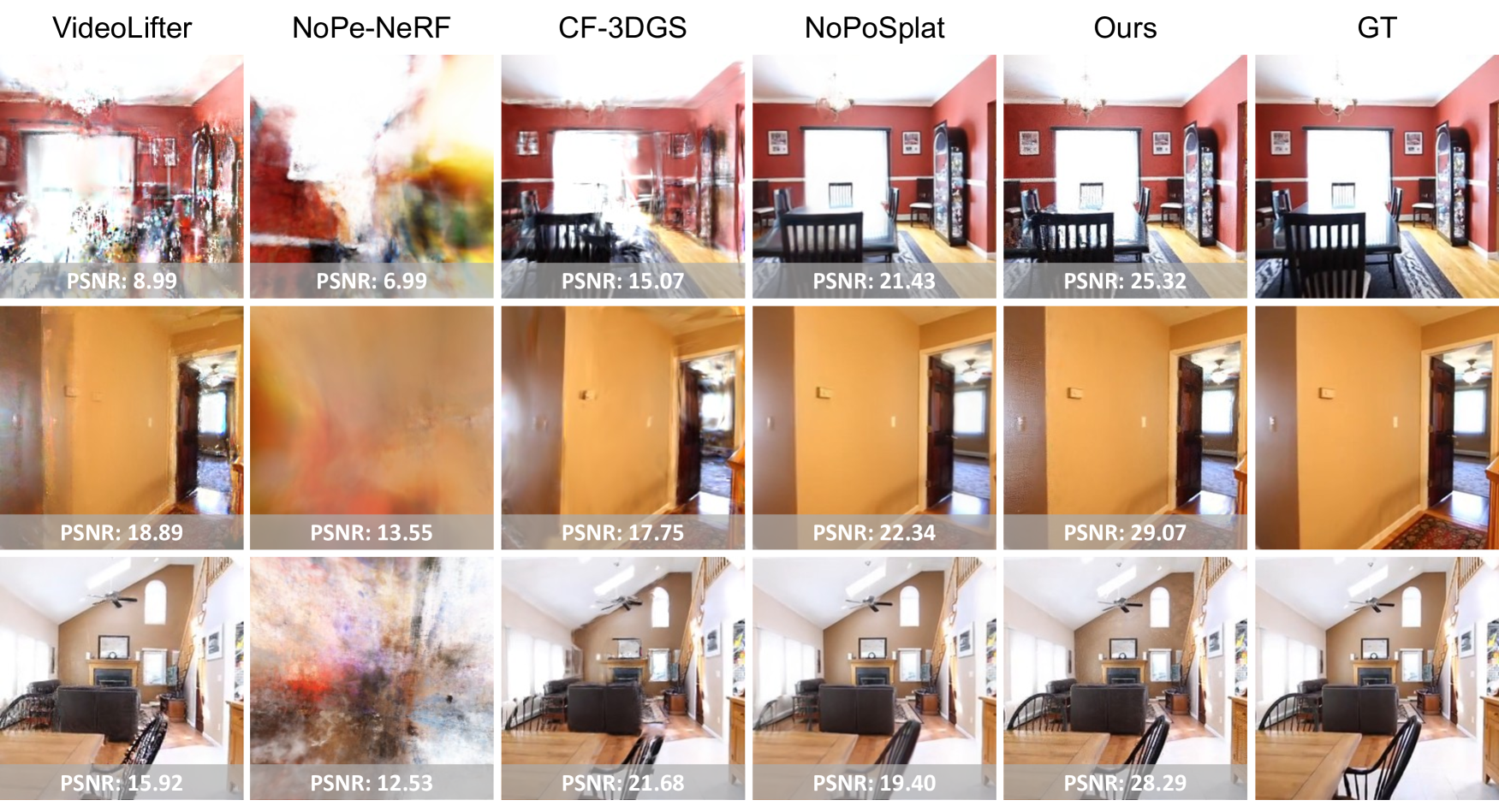

RegGS在RE10K和ACID数据集上进行了实验,结果表明RegGS能够有效地配准局部高斯,实现精确的位姿估计和高质量的新视角合成。相较于现有方法,RegGS在稀疏视图下的重建质量有了显著提升。具体性能数据未知,但论文强调了RegGS在高保真度配准局部高斯方面的优势。

🎯 应用场景

RegGS在三维重建、虚拟现实、增强现实、机器人导航等领域具有广泛的应用前景。例如,可以用于从手机拍摄的少量照片中重建高质量的3D模型,或者用于机器人自主探索未知环境。该研究的实际价值在于降低了三维重建对输入数据的要求,提高了重建的效率和质量。未来,RegGS可以进一步扩展到动态场景重建、语义场景理解等更复杂的任务中。

📄 摘要(原文)

3D Gaussian Splatting (3DGS) has demonstrated its potential in reconstructing scenes from unposed images. However, optimization-based 3DGS methods struggle with sparse views due to limited prior knowledge. Meanwhile, feed-forward Gaussian approaches are constrained by input formats, making it challenging to incorporate more input views. To address these challenges, we propose RegGS, a 3D Gaussian registration-based framework for reconstructing unposed sparse views. RegGS aligns local 3D Gaussians generated by a feed-forward network into a globally consistent 3D Gaussian representation. Technically, we implement an entropy-regularized Sinkhorn algorithm to efficiently solve the optimal transport Mixture 2-Wasserstein $(\text{MW}_2)$ distance, which serves as an alignment metric for Gaussian mixture models (GMMs) in $\mathrm{Sim}(3)$ space. Furthermore, we design a joint 3DGS registration module that integrates the $\text{MW}_2$ distance, photometric consistency, and depth geometry. This enables a coarse-to-fine registration process while accurately estimating camera poses and aligning the scene. Experiments on the RE10K and ACID datasets demonstrate that RegGS effectively registers local Gaussians with high fidelity, achieving precise pose estimation and high-quality novel-view synthesis. Project page: https://3dagentworld.github.io/reggs/.