Robust and Generalizable Heart Rate Estimation via Deep Learning for Remote Photoplethysmography in Complex Scenarios

作者: Kang Cen, Chang-Hong Fu, Hong Hong

分类: cs.CV

发布日期: 2025-07-10

备注: 7 pages, 3 figures

💡 一句话要点

提出一种深度学习方法以解决复杂场景下心率估计问题

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱八:物理动画 (Physics-based Animation)

关键词: 心率估计 远程光电容积脉搏波 深度学习 3D卷积神经网络 特征提取 动态混合损失 复杂场景 鲁棒性

📋 核心要点

- 现有的rPPG技术在复杂场景下的心率估计准确性和鲁棒性不足,难以满足实际应用需求。

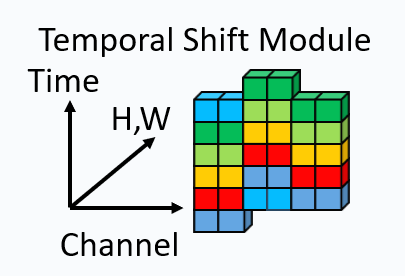

- 本文提出了一种基于3D卷积神经网络的rPPG提取网络,结合差分帧融合和时间移位模块,增强特征提取能力。

- 在多个数据集上进行的实验表明,模型在复杂场景下的表现优越,MAE达到7.58,显著优于现有方法。

📝 摘要(中文)

非接触式远程光电容积脉搏波(rPPG)技术能够通过面部视频测量心率。然而,现有网络模型在复杂场景下的准确性、鲁棒性和泛化能力仍面临挑战。本文提出了一种端到端的rPPG提取网络,利用3D卷积神经网络从原始面部视频中重建准确的rPPG信号。我们引入了差分帧融合模块,将差分帧与原始帧结合,使帧级表示能够捕捉血容量脉搏(BVP)变化。此外,结合自注意力机制的时间移位模块(TSM)有效增强了rPPG特征,同时计算开销最小。我们还提出了一种新颖的动态混合损失函数,为网络提供更强的监督,有效缓解过拟合。综合实验在PURE、UBFC-rPPG及复杂场景下的MMPD数据集上进行,结果表明我们网络的鲁棒性和泛化能力优越。具体而言,在PURE数据集上训练后,我们的模型在MMPD测试集上达到了7.58的平均绝对误差(MAE),超越了现有最先进模型。

🔬 方法详解

问题定义:本文旨在解决复杂场景下的心率估计问题,现有方法在准确性和鲁棒性方面存在不足,尤其是在不同环境和光照条件下的表现不佳。

核心思路:提出了一种端到端的rPPG提取网络,利用3D卷积神经网络重建rPPG信号,并通过差分帧融合模块和时间移位模块提升特征提取的有效性。

技术框架:整体架构包括输入的面部视频数据,通过3D卷积神经网络进行特征提取,接着利用差分帧融合模块和时间移位模块进行信号重建,最后通过动态混合损失函数进行训练和优化。

关键创新:引入差分帧融合模块和时间移位模块,结合自注意力机制,显著提升了rPPG特征的提取能力,与传统方法相比,能够更好地捕捉BVP变化。

关键设计:采用动态混合损失函数以增强网络的监督能力,减少过拟合风险,同时在3D卷积网络中优化了参数设置,以提高模型的训练效率和准确性。

🖼️ 关键图片

📊 实验亮点

实验结果显示,模型在MMPD测试集上达到了7.58的平均绝对误差(MAE),在PURE数据集上训练后,显著超越了现有最先进模型,展示了优越的鲁棒性和泛化能力。

🎯 应用场景

该研究的潜在应用领域包括健康监测、远程医疗和智能穿戴设备等。通过非接触式心率监测,能够在不干扰用户的情况下实时获取生理数据,具有重要的实际价值和广泛的市场前景。未来,该技术有望在更多复杂环境中应用,提升人们的健康管理能力。

📄 摘要(原文)

Non-contact remote photoplethysmography (rPPG) technology enables heart rate measurement from facial videos. However, existing network models still face challenges in accu racy, robustness, and generalization capability under complex scenarios. This paper proposes an end-to-end rPPG extraction network that employs 3D convolutional neural networks to reconstruct accurate rPPG signals from raw facial videos. We introduce a differential frame fusion module that integrates differential frames with original frames, enabling frame-level representations to capture blood volume pulse (BVP) variations. Additionally, we incorporate Temporal Shift Module (TSM) with self-attention mechanisms, which effectively enhance rPPG features with minimal computational overhead. Furthermore, we propose a novel dynamic hybrid loss function that provides stronger supervision for the network, effectively mitigating over fitting. Comprehensive experiments were conducted on not only the PURE and UBFC-rPPG datasets but also the challenging MMPD dataset under complex scenarios, involving both intra dataset and cross-dataset evaluations, which demonstrate the superior robustness and generalization capability of our network. Specifically, after training on PURE, our model achieved a mean absolute error (MAE) of 7.58 on the MMPD test set, outperforming the state-of-the-art models.