MUVOD: A Novel Multi-view Video Object Segmentation Dataset and A Benchmark for 3D Segmentation

作者: Bangning Wei, Joshua Maraval, Meriem Outtas, Kidiyo Kpalma, Nicolas Ramin, Lu Zhang

分类: cs.CV

发布日期: 2025-07-10

💡 一句话要点

提出MUVOD多视角视频对象分割数据集,并为3D分割提供基准。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 多视角视频 对象分割 动态场景 4D分割 数据集

📋 核心要点

- 基于NeRF和3D GS的方法在静态场景的3D对象分割中越来越受欢迎,但在动态场景的4D对象分割方面,由于缺乏足够大且精确标注的多视角视频数据集,仍然是一个未被充分探索的领域。

- MUVOD数据集旨在通过提供包含多个视角和时间帧的真实世界场景,以及精确的4D分割掩码,来解决动态场景下多视角视频对象分割的数据匮乏问题。

- 该论文还提出了一个评估指标和一个基线分割方法,并提供了一个3D对象分割任务的基准,旨在鼓励和评估该领域的发展,并为未来的研究提供参考。

📝 摘要(中文)

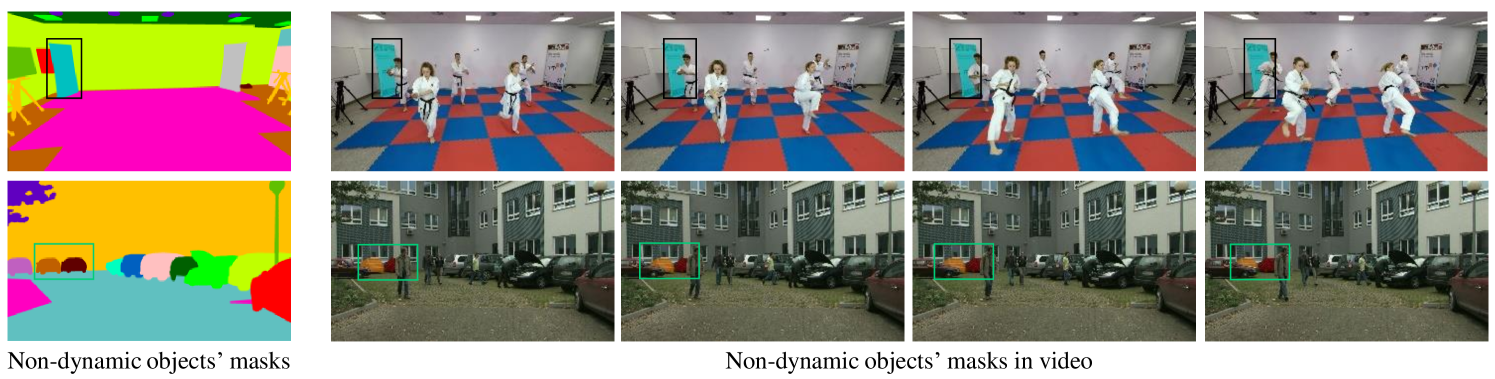

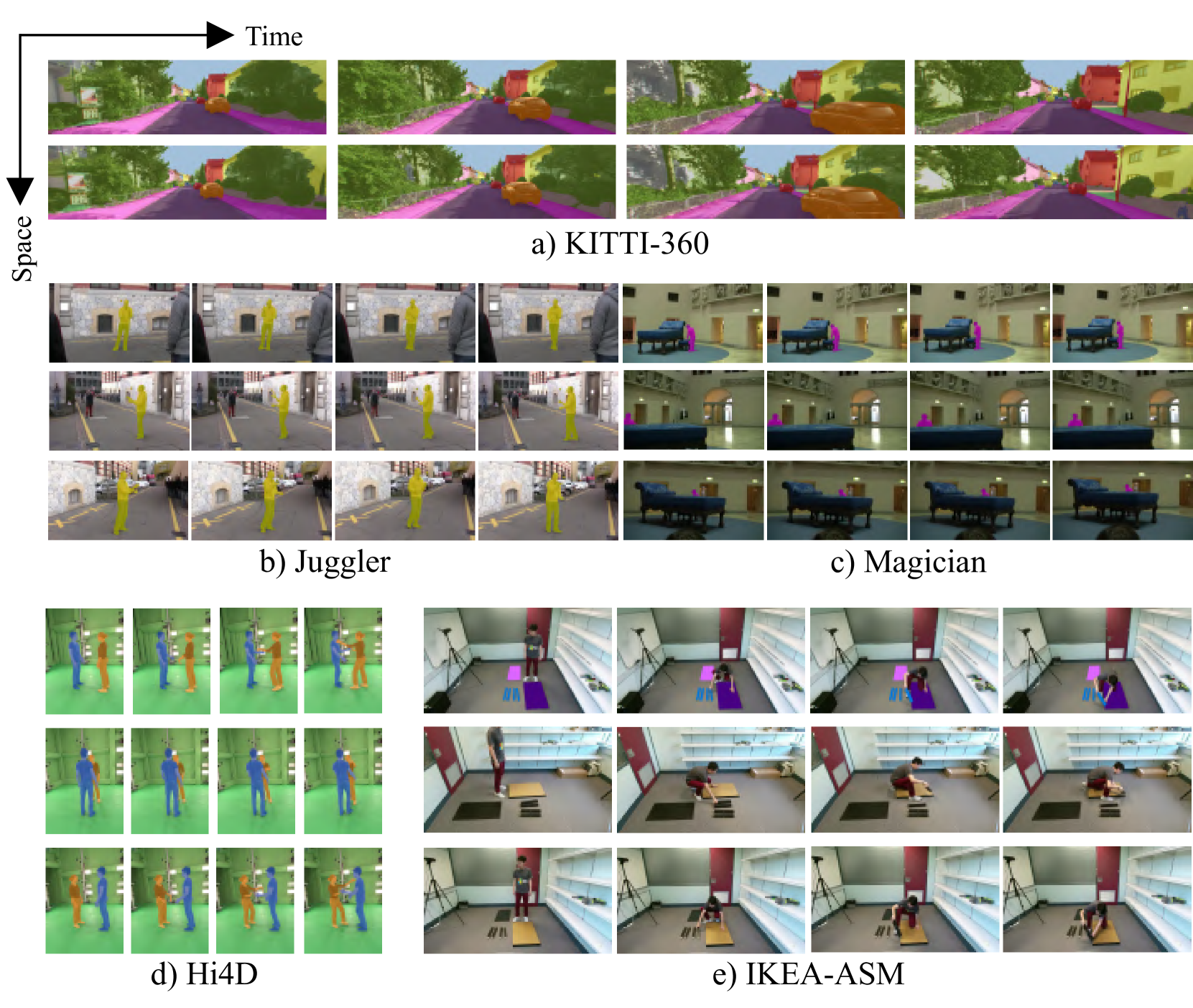

本文提出了MUVOD,一个新的多视角视频数据集,用于训练和评估重建真实场景中的对象分割。该数据集包含17个场景,描述了各种室内或室外活动,数据来源于不同类型的相机设备。每个场景包含至少9个视角,最多46个视角。我们提供了7830张RGB图像(每个视频30帧),以及对应的4D运动分割掩码,这意味着场景中的任何感兴趣对象都可以在给定视角的时序帧或属于同一相机设备的不同视角中进行跟踪。该数据集包含73个类别的459个实例,旨在作为多视角视频分割方法的基本基准。我们还提出了一个评估指标和一个基线分割方法,以鼓励和评估该领域的发展。此外,我们还提出了一个新的3D对象分割任务基准,该基准包含从MUVOD数据集中选择的带注释的多视角图像子集,包含不同场景下50个不同状态的对象,从而可以更全面地分析最先进的3D对象分割方法。MUVOD数据集可在https://volumetric-repository.labs.b-com.com/#/muvod 获取。

🔬 方法详解

问题定义:论文旨在解决动态场景下多视角视频对象分割缺乏高质量数据集的问题。现有方法受限于数据集规模和标注质量,难以有效训练和评估。尤其是在4D(3D空间+时间)分割方面,缺乏能够跟踪对象在时间和空间中运动的数据集。

核心思路:论文的核心思路是构建一个大规模、高质量的多视角视频数据集,包含各种室内和室外活动场景,并提供精确的4D分割标注。通过提供这样的数据集,可以促进多视角视频对象分割算法的开发和评估,并推动该领域的发展。

技术框架:MUVOD数据集的构建流程包括:1) 从不同来源收集多视角视频数据;2) 对每个场景进行精确的4D分割标注,确保对象在时间和空间中的一致性;3) 提供评估指标和基线分割方法,方便研究人员进行比较和分析;4) 选取数据集子集构建3D对象分割基准。

关键创新:MUVOD数据集的关键创新在于其大规模、高质量和4D分割标注。它不仅提供了多个视角的信息,还考虑了时间维度上的对象运动,这使得研究人员可以开发更鲁棒和准确的动态场景分割算法。此外,该数据集还提供了评估指标和基线方法,方便研究人员进行比较和分析。

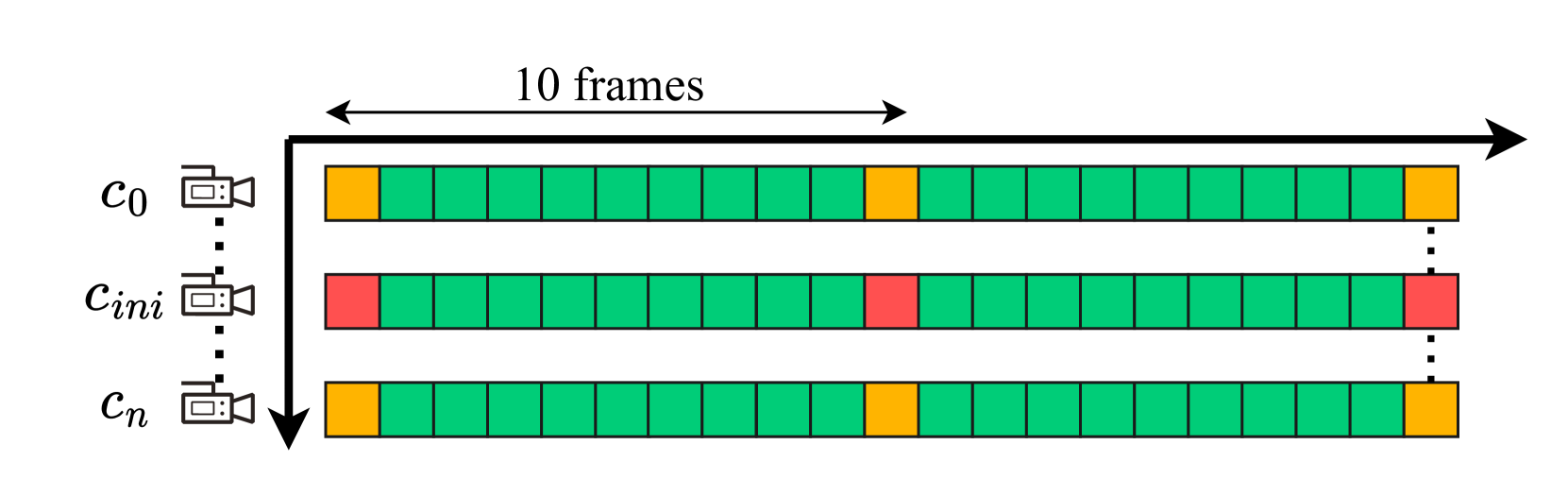

关键设计:MUVOD数据集包含17个场景,每个场景包含9到46个视角,共计7830张RGB图像。每个图像都带有精确的4D分割掩码,涵盖73个类别的459个实例。数据集的标注质量经过严格的审核,确保对象在时间和空间中的一致性。此外,论文还提出了一个基于IoU的评估指标,用于评估分割算法的性能。基线分割方法采用了一种基于深度学习的分割模型,并在MUVOD数据集上进行了训练和评估。

🖼️ 关键图片

📊 实验亮点

论文提出的MUVOD数据集包含7830张RGB图像,涵盖73个类别的459个实例,每个图像都带有精确的4D分割掩码。论文还提供了一个基于IoU的评估指标和一个基于深度学习的基线分割方法。实验结果表明,该基线方法在MUVOD数据集上取得了良好的性能,为未来的研究提供了一个有价值的参考。

🎯 应用场景

MUVOD数据集的潜在应用领域包括自动驾驶、机器人导航、视频监控、增强现实和虚拟现实等。该数据集可以用于训练和评估各种多视角视频对象分割算法,从而提高这些应用在复杂动态环境中的感知能力。例如,在自动驾驶中,可以利用MUVOD数据集训练车辆识别和跟踪算法,从而提高驾驶安全性。

📄 摘要(原文)

The application of methods based on Neural Radiance Fields (NeRF) and 3D Gaussian Splatting (3D GS) have steadily gained popularity in the field of 3D object segmentation in static scenes. These approaches demonstrate efficacy in a range of 3D scene understanding and editing tasks. Nevertheless, the 4D object segmentation of dynamic scenes remains an underexplored field due to the absence of a sufficiently extensive and accurately labelled multi-view video dataset. In this paper, we present MUVOD, a new multi-view video dataset for training and evaluating object segmentation in reconstructed real-world scenarios. The 17 selected scenes, describing various indoor or outdoor activities, are collected from different sources of datasets originating from various types of camera rigs. Each scene contains a minimum of 9 views and a maximum of 46 views. We provide 7830 RGB images (30 frames per video) with their corresponding segmentation mask in 4D motion, meaning that any object of interest in the scene could be tracked across temporal frames of a given view or across different views belonging to the same camera rig. This dataset, which contains 459 instances of 73 categories, is intended as a basic benchmark for the evaluation of multi-view video segmentation methods. We also present an evaluation metric and a baseline segmentation approach to encourage and evaluate progress in this evolving field. Additionally, we propose a new benchmark for 3D object segmentation task with a subset of annotated multi-view images selected from our MUVOD dataset. This subset contains 50 objects of different conditions in different scenarios, providing a more comprehensive analysis of state-of-the-art 3D object segmentation methods. Our proposed MUVOD dataset is available at https://volumetric-repository.labs.b-com.com/#/muvod.