Behave Your Motion: Habit-preserved Cross-category Animal Motion Transfer

作者: Zhimin Zhang, Bi'an Du, Caoyuan Ma, Zheng Wang, Wei Hu

分类: cs.CV, cs.AI

发布日期: 2025-07-10

💡 一句话要点

提出一种保持动物行为习惯的跨类别动物运动迁移框架

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱七:动作重定向 (Motion Retargeting) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 动物运动迁移 行为习惯保持 跨类别迁移 生成模型 大型语言模型

📋 核心要点

- 现有运动迁移方法忽略了动物运动中物种特有的行为习惯,导致跨类别迁移效果不佳。

- 提出一种基于生成框架的运动迁移模型,通过习惯保持模块学习并保留动物的独特行为特征。

- 构建了四足动物数据集DeformingThings4D-skl,实验结果验证了该模型在跨类别运动迁移中的优越性。

📝 摘要(中文)

动物运动体现了物种特有的行为习惯,因此跨类别的运动迁移对于动画和虚拟现实应用来说是一项关键但复杂的任务。现有的运动迁移方法主要集中于人体运动,强调骨骼对齐(运动重定向)或风格一致性(运动风格迁移),往往忽略了动物独特习惯行为的保持。为了弥补这一差距,我们提出了一种新颖的习惯保持的跨类别动物运动迁移框架。该模型建立在生成框架之上,引入了一个具有类别特定习惯编码器的习惯保持模块,使其能够学习捕捉独特习惯特征的运动先验。此外,我们集成了一个大型语言模型(LLM),以促进运动迁移到以前未观察到的物种。为了评估我们方法的有效性,我们引入了DeformingThings4D-skl数据集,这是一个带有骨骼绑定的四足动物数据集,并进行了广泛的实验和定量分析,验证了我们提出的模型的优越性。

🔬 方法详解

问题定义:论文旨在解决跨类别动物运动迁移中,如何保持动物特有的行为习惯的问题。现有方法主要针对人体运动,侧重于骨骼对齐或风格迁移,忽略了动物运动中蕴含的物种特性,导致迁移后的运动不自然,缺乏真实感。

核心思路:论文的核心思路是利用生成模型学习动物运动的先验知识,并引入一个习惯保持模块,该模块通过类别特定的习惯编码器来捕捉和保留动物的独特行为特征。通过这种方式,模型能够在运动迁移过程中,尽可能地保留源动物的行为习惯,使迁移后的运动更加自然和真实。

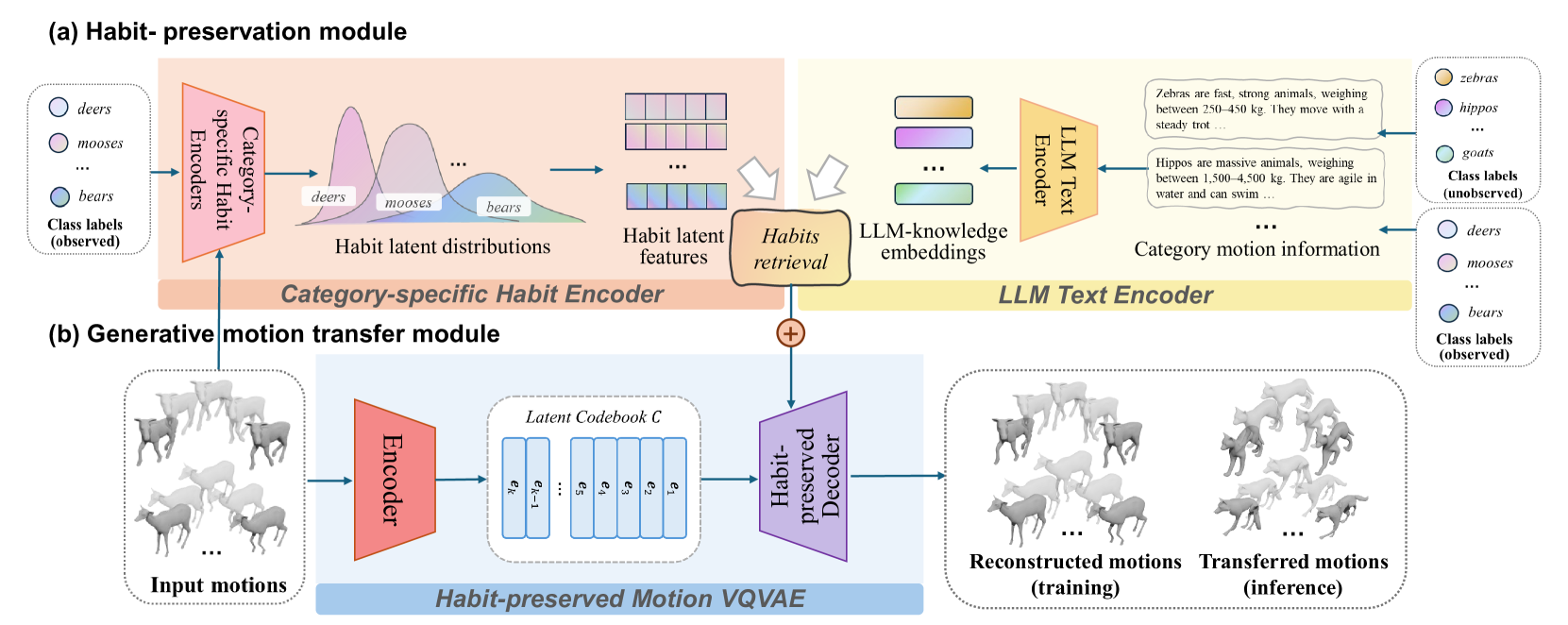

技术框架:整体框架基于生成模型,主要包含以下模块:1) 运动编码器:将输入的源动物运动序列编码成潜在空间表示。2) 习惯编码器:针对不同动物类别,学习其特有的行为习惯,并将其编码成习惯向量。3) 运动解码器:根据潜在空间表示和习惯向量,生成目标动物的运动序列。4) 大型语言模型(LLM):用于处理未见过的动物类别,辅助习惯编码器的学习。

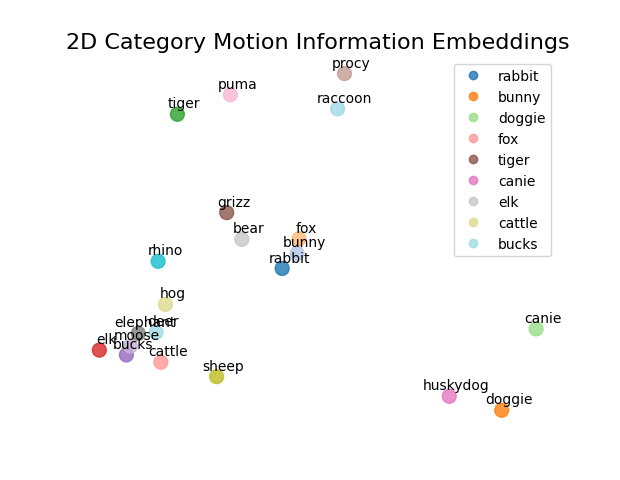

关键创新:论文的关键创新在于提出了习惯保持模块,该模块能够显式地学习和保留动物的独特行为习惯。与现有方法相比,该模块能够更好地捕捉动物运动的本质特征,从而实现更自然的跨类别运动迁移。此外,利用LLM处理未见过的动物类别也是一个创新点。

关键设计:习惯编码器采用类别特定的设计,针对不同动物类别训练不同的编码器,以更好地捕捉其特有的行为习惯。损失函数包括运动重建损失、习惯保持损失和对抗损失,用于保证生成运动的质量、习惯的保留和整体的真实性。DeformingThings4D-skl数据集的构建为四足动物运动迁移提供了数据支持。

🖼️ 关键图片

📊 实验亮点

论文构建了新的四足动物数据集DeformingThings4D-skl,并进行了大量实验验证。实验结果表明,该模型在跨类别动物运动迁移任务上优于现有方法,能够生成更自然、更符合动物行为习惯的运动序列。定量分析表明,该模型在运动质量和习惯保持方面均取得了显著提升。

🎯 应用场景

该研究成果可广泛应用于动画制作、游戏开发、虚拟现实等领域。例如,可以用于创建更逼真的动物角色动画,提升游戏体验,或在虚拟现实环境中模拟各种动物的行为。此外,该技术还可以应用于机器人控制领域,使机器人能够模仿动物的运动方式,从而实现更灵活和高效的运动。

📄 摘要(原文)

Animal motion embodies species-specific behavioral habits, making the transfer of motion across categories a critical yet complex task for applications in animation and virtual reality. Existing motion transfer methods, primarily focused on human motion, emphasize skeletal alignment (motion retargeting) or stylistic consistency (motion style transfer), often neglecting the preservation of distinct habitual behaviors in animals. To bridge this gap, we propose a novel habit-preserved motion transfer framework for cross-category animal motion. Built upon a generative framework, our model introduces a habit-preservation module with category-specific habit encoder, allowing it to learn motion priors that capture distinctive habitual characteristics. Furthermore, we integrate a large language model (LLM) to facilitate the motion transfer to previously unobserved species. To evaluate the effectiveness of our approach, we introduce the DeformingThings4D-skl dataset, a quadruped dataset with skeletal bindings, and conduct extensive experiments and quantitative analyses, which validate the superiority of our proposed model.