Mastering Regional 3DGS: Locating, Initializing, and Editing with Diverse 2D Priors

作者: Lanqing Guo, Yufei Wang, Hezhen Hu, Yan Zheng, Yeying Jin, Siyu Huang, Zhangyang Wang

分类: cs.CV

发布日期: 2025-07-07

💡 一句话要点

提出基于2D先验的区域3DGS编辑方法,提升编辑效率与质量。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱三:空间感知与语义 (Perception & Semantics) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 3D高斯溅射 局部编辑 2D扩散模型 逆渲染 深度估计

📋 核心要点

- 3D场景编辑中,局部区域编辑比全局编辑更常见,但3D语义解析的不足限制了编辑精度。

- 利用2D扩散编辑精确定位修改区域,结合逆渲染和深度信息初始化3DGS,实现视图一致的编辑。

- 实验结果表明,该方法在保持先进性能的同时,实现了高达4倍的加速。

📝 摘要(中文)

本文提出了一种针对3D高斯溅射(3DGS)场景的区域编辑方法。与全局编辑不同,该方法专注于修改局部区域。由于3D语义解析性能通常不如2D,导致在3D空间中进行精确的目标操作更加困难,限制了编辑的保真度。为了解决这个问题,本文利用2D扩散编辑来准确识别每个视图中的修改区域,然后通过逆渲染进行3D定位。接着,细化正面视图,并使用从2D基础模型预测的深度图初始化一个粗糙的、具有一致视图和近似形状的3DGS,从而支持迭代的、视图一致的编辑过程,逐步增强结构细节和纹理,以确保跨视角的连贯性。实验表明,该方法在实现最先进性能的同时,速度提高了4倍,为3D场景局部编辑提供了一种更高效的方法。

🔬 方法详解

问题定义:现有3D场景编辑方法,特别是基于3DGS的方法,在局部区域编辑时面临挑战。3D语义解析精度不如2D,难以精确定位和分割需要编辑的区域。这导致编辑操作不够精确,影响编辑质量和效率。此外,如何保证编辑后场景在不同视角下的一致性也是一个难题。

核心思路:论文的核心思路是利用成熟的2D图像编辑技术作为先验知识,辅助3D场景的局部编辑。具体来说,首先在2D图像上进行精确的区域定位和编辑,然后将这些2D信息反投影到3D空间,用于指导3DGS的初始化和优化。通过这种方式,可以有效地利用2D的优势,提高3D编辑的精度和效率。

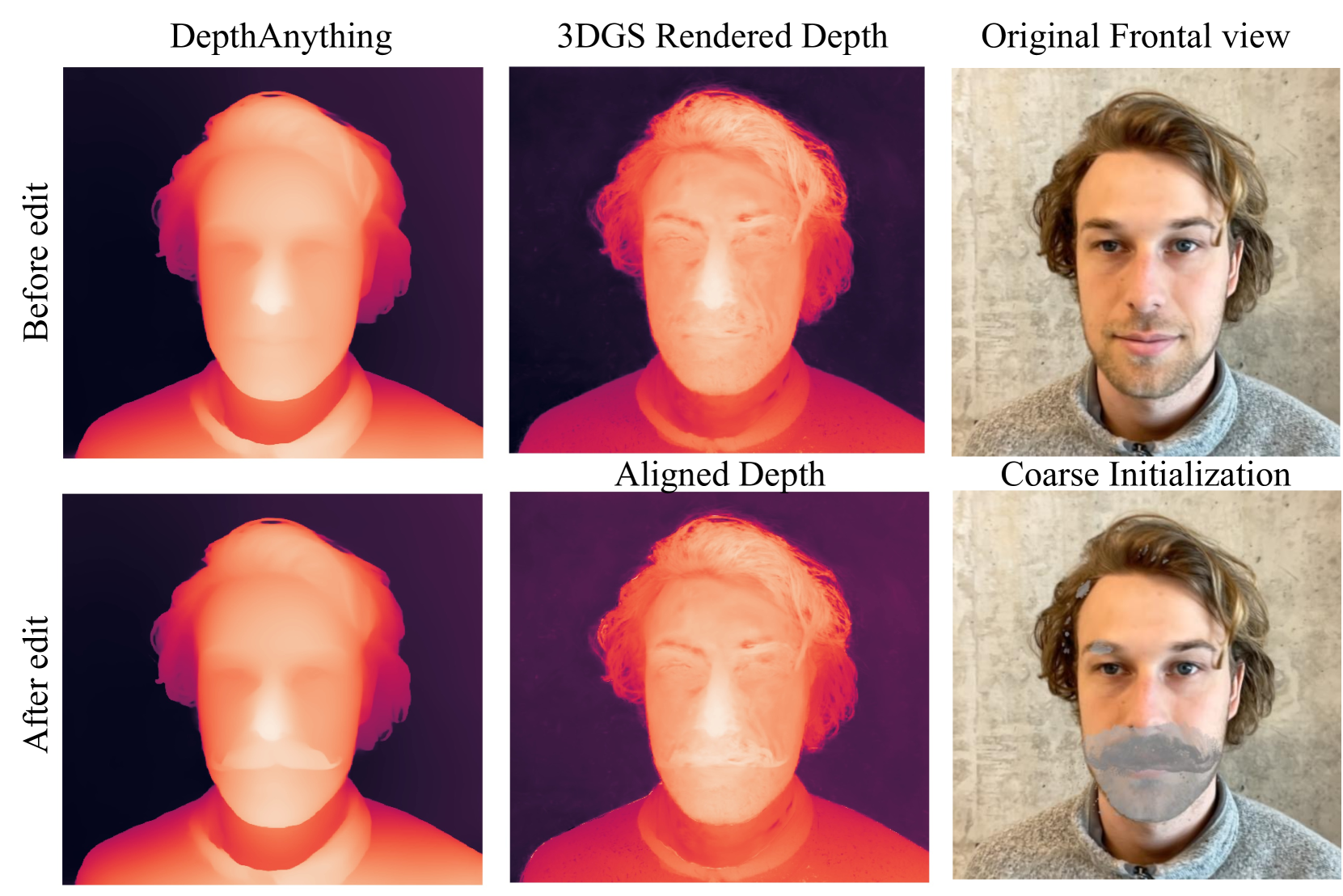

技术框架:该方法主要包含以下几个阶段: 1. 2D区域定位与编辑:使用2D扩散模型在多个视图中识别和编辑目标区域。 2. 3D定位:通过逆渲染将2D编辑区域投影到3D空间,确定3D编辑范围。 3. 3DGS初始化:利用2D深度估计初始化一个粗糙的3DGS,保证视图一致性。 4. 迭代优化:通过迭代优化3DGS参数,逐步提升编辑区域的细节和纹理质量,同时保持整体场景的连贯性。

关键创新:该方法最重要的创新点在于将2D图像编辑的先验知识引入到3DGS的局部编辑中。通过2D扩散模型进行精确的区域定位,避免了直接在3D空间进行语义解析的困难。同时,利用2D深度估计初始化3DGS,保证了编辑后场景在不同视角下的一致性。

关键设计: * 2D扩散模型选择:选择合适的2D扩散模型,以保证编辑区域的质量和一致性。 * 逆渲染方法:采用有效的逆渲染方法,将2D编辑区域准确地投影到3D空间。 * 3DGS初始化策略:设计合理的3DGS初始化策略,充分利用2D深度信息,减少后续优化迭代次数。 * 损失函数设计:设计合适的损失函数,平衡编辑区域的质量和整体场景的连贯性。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在3D场景局部编辑任务上取得了state-of-the-art的性能,并且相比现有方法,速度提升了高达4倍。这表明该方法在保证编辑质量的同时,显著提高了编辑效率,具有很强的实用价值。

🎯 应用场景

该研究成果可应用于虚拟现实、增强现实、游戏开发、电影制作等领域。例如,可以用于快速修改3D场景中的特定物体,如更换家具、改变建筑外观等。该方法能够提高3D内容创作的效率和质量,降低制作成本,并为用户提供更加灵活和个性化的3D体验。

📄 摘要(原文)

Many 3D scene editing tasks focus on modifying local regions rather than the entire scene, except for some global applications like style transfer, and in the context of 3D Gaussian Splatting (3DGS), where scenes are represented by a series of Gaussians, this structure allows for precise regional edits, offering enhanced control over specific areas of the scene; however, the challenge lies in the fact that 3D semantic parsing often underperforms compared to its 2D counterpart, making targeted manipulations within 3D spaces more difficult and limiting the fidelity of edits, which we address by leveraging 2D diffusion editing to accurately identify modification regions in each view, followed by inverse rendering for 3D localization, then refining the frontal view and initializing a coarse 3DGS with consistent views and approximate shapes derived from depth maps predicted by a 2D foundation model, thereby supporting an iterative, view-consistent editing process that gradually enhances structural details and textures to ensure coherence across perspectives. Experiments demonstrate that our method achieves state-of-the-art performance while delivering up to a $4\times$ speedup, providing a more efficient and effective approach to 3D scene local editing.