Spatio-Temporal LLM: Reasoning about Environments and Actions

作者: Haozhen Zheng, Beitong Tian, Mingyuan Wu, Zhenggang Tang, Klara Nahrstedt, Alex Schwing

分类: cs.CV, cs.LG

发布日期: 2025-07-07 (更新: 2025-10-15)

备注: Code and data are available at https://zoezheng126.github.io/STLLM-website/

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

提出时空LLM,解决多模态大模型在环境理解和行为推理上的挑战。

🎯 匹配领域: 支柱六:视频提取与匹配 (Video Extraction) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 时空推理 多模态学习 大语言模型 点云 视频理解 环境理解 行为识别

📋 核心要点

- 现有多模态大模型在理解环境整体信息和其中发生的行为的时空关系上存在不足,限制了其在现实世界中的应用。

- 论文提出两种时空LLM(STLLM)基线,分别通过直接融合多模态信息和对齐空间上下文来增强模型对环境和行为的理解。

- 在自建的REA数据集上,STLLM基线显著优于现有模型,验证了所提出方法的有效性,为相关研究提供了新的思路。

📝 摘要(中文)

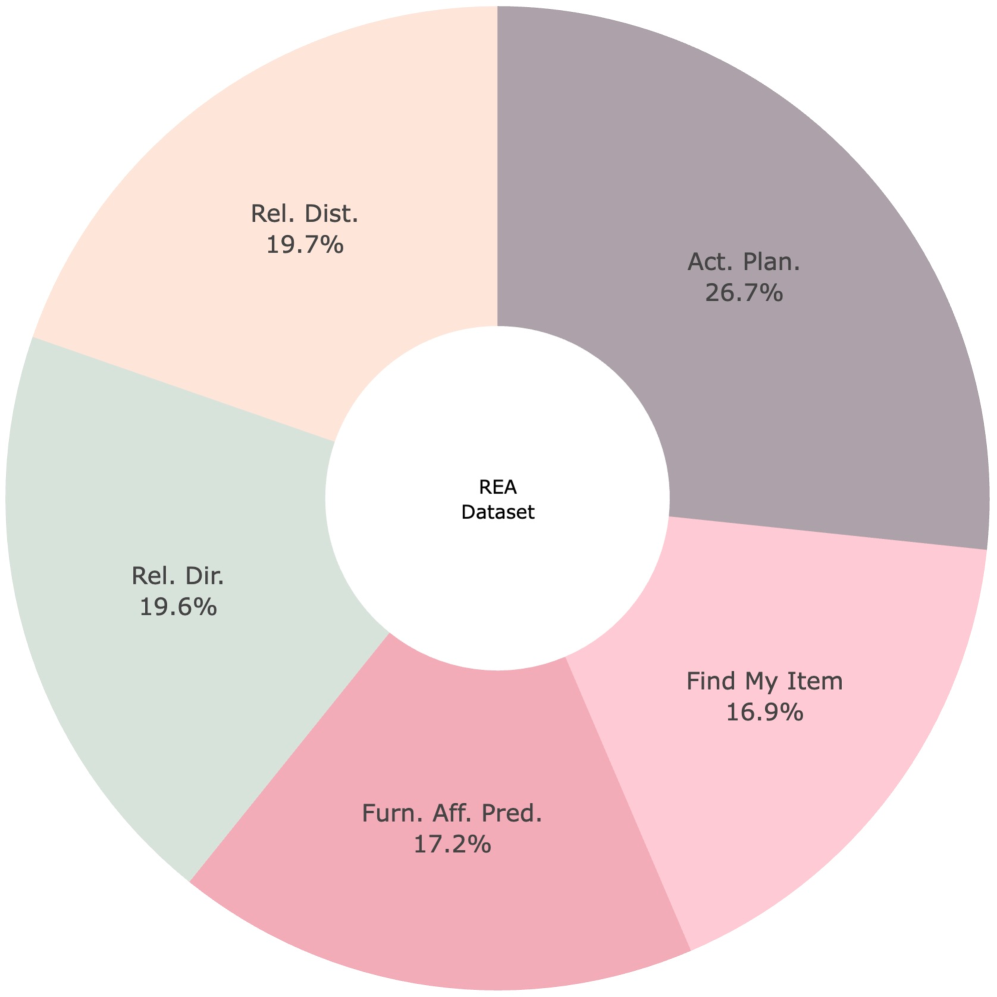

多模态大语言模型(MLLM)在快速发展,但面临“时空”提示的挑战,即需要同时理解由点云编码的完整环境和由第一视角视频片段编码的环境中的行为。这种整体的时空理解对于在现实世界中运行的智能体至关重要。为了解决这个问题,我们首先构建了一个大规模数据集。使用收集的“环境与行为推理”(REA)数据集,我们证明了现有的MLLM难以正确回答“时空”提示。基于此数据集,我们研究了两种时空LLM(STLLM)基线:1) STLLM-3D,直接融合点云、视频和文本表示作为LLM的输入;2) STLLM-Aligner,在LLM解码之前将空间上下文与视频和文本对齐。两种基线都旨在增强环境的空间理解和第一视角观察的时间定位。在REA数据集上,STLLM基线优于现有模型,证明了我们设计的有效性。代码和数据可在https://zoezheng126.github.io/STLLM-website/获取。

🔬 方法详解

问题定义:现有多模态大语言模型(MLLMs)在处理需要同时理解环境(由点云表示)和环境中发生的行为(由第一视角视频表示)的“时空”提示时表现不佳。痛点在于缺乏对环境的整体空间理解以及对行为的时间定位能力,导致无法准确推理环境与行为之间的关系。

核心思路:论文的核心思路是通过设计专门的时空LLM(STLLM)来增强模型对环境的空间理解和对行为的时间定位能力。具体而言,通过融合点云、视频和文本等多模态信息,或者在输入LLM之前对齐空间上下文与视频和文本,从而使模型能够更好地理解环境和行为之间的关系。

技术框架:论文提出了两种STLLM基线:STLLM-3D和STLLM-Aligner。STLLM-3D直接将点云、视频和文本的特征表示融合后输入LLM进行解码。STLLM-Aligner则首先将空间上下文与视频和文本进行对齐,然后再输入LLM进行解码。整体流程包括多模态特征提取、特征融合/对齐以及LLM解码三个主要阶段。

关键创新:论文的关键创新在于针对“时空”提示问题,提出了两种有效的STLLM架构。与现有方法相比,STLLM更加关注环境的空间信息和行为的时间信息,并通过专门的设计来增强模型对这些信息的理解。此外,REA数据集的构建也为相关研究提供了新的benchmark。

关键设计:STLLM-3D的关键设计在于如何有效地融合点云、视频和文本的特征表示。STLLM-Aligner的关键设计在于如何对齐空间上下文与视频和文本,例如可以使用注意力机制来实现对齐。论文中可能还涉及一些超参数的设置,例如学习率、batch size等,以及损失函数的选择,例如交叉熵损失等。具体的网络结构细节需要参考论文原文。

🖼️ 关键图片

📊 实验亮点

实验结果表明,在REA数据集上,STLLM基线显著优于现有的多模态大语言模型。具体性能提升数据需要在论文中查找,但整体趋势表明,所提出的STLLM在处理“时空”提示方面具有显著优势,验证了其设计的有效性。

🎯 应用场景

该研究成果可应用于机器人导航、自动驾驶、智能家居等领域。例如,机器人可以利用该技术理解周围环境,并根据人类的指令执行相应的动作。在自动驾驶领域,可以帮助车辆更好地理解交通场景,从而提高驾驶安全性。在智能家居领域,可以实现更自然的人机交互。

📄 摘要(原文)

Despite significant recent progress of Multimodal Large Language Models (MLLMs), current MLLMs are challenged by "spatio-temporal" prompts, i.e., prompts that refer to 1) the entirety of an environment encoded in a point cloud that the MLLM should consider; and simultaneously also refer to 2) actions that happened in part of the environment and are encoded in a short ego-centric video clip. However, such a holistic spatio-temporal understanding is important for agents operating in the real world. To address this challenge, we first develop a framework to collect a large-scale dataset. Using the collected "Reasoning about Environments and Actions" (REA) dataset, we show that recent MLLMs indeed struggle to correctly answer "spatio-temporal" prompts. Building on this dataset, we study two spatio-temporal LLM (STLLM) baselines: 1) STLLM-3D, which directly fuses point cloud, video, and text representations as inputs to the LLM; and 2) STLLM-Aligner, which aligns spatial context with video and text before LLM decoding. Both baselines aim to enhance spatial understanding of environments and temporal grounding of egocentric observations. On REA, the STLLM baselines outperform existing models, demonstrating the effectiveness of our designs. Code and data are available at https://zoezheng126.github.io/STLLM-website/.