CoT-Segmenter: Enhancing OOD Detection in Dense Road Scenes via Chain-of-Thought Reasoning

作者: Jeonghyo Song, Kimin Yun, DaeUng Jo, Jinyoung Kim, Youngjoon Yoo

分类: cs.CV

发布日期: 2025-07-05 (更新: 2025-08-20)

备注: 6 pages, 3 figures. Accepted at IEEE International Conference on Advanced Visual and Signal-Based Systems 2025

💡 一句话要点

提出CoT-Segmenter,利用思维链推理增强复杂道路场景中的OOD检测

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 域外检测 语义分割 思维链推理 大型语言模型 道路场景理解

📋 核心要点

- 现有OOD分割方法在处理密集遮挡、小目标和前景主导等复杂道路场景时表现不佳。

- 提出CoT-Segmenter,利用GPT-4等大型语言模型的思维链推理能力,提升图像理解和OOD检测。

- 实验表明,该框架在标准基准和RoadAnomaly数据集的挑战性子集上均优于现有方法。

📝 摘要(中文)

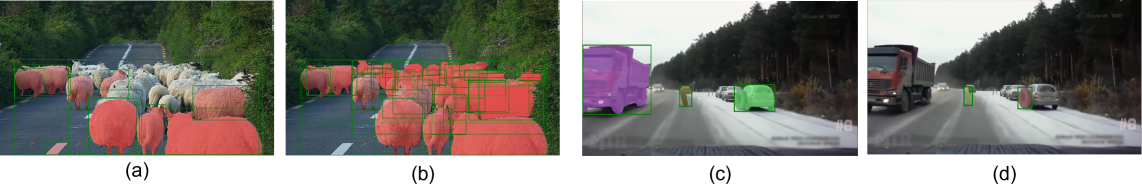

有效的域外(OOD)检测对于确保语义分割模型的可靠性至关重要,尤其是在安全性和准确性至关重要的复杂道路环境中。尽管大型语言模型(LLM),特别是GPT-4,通过思维链(CoT)提示显著增强了多模态推理,但基于CoT的视觉推理在OOD语义分割中的应用在很大程度上仍未被探索。本文通过对道路场景异常的广泛分析,确定了当前最先进的OOD分割方法持续面临挑战的三个场景:(1)密集堆叠和重叠的物体,(2)具有小物体的远距离场景,以及(3)大型前景主导物体。为了应对这些挑战,我们提出了一种新颖的基于CoT的框架,用于道路异常场景中的OOD检测。我们的方法利用了基础模型(如GPT-4)的广泛知识和推理能力,通过改进图像理解和与观察到的问题场景属性对齐的基于提示的推理来增强OOD检测。大量实验表明,我们的框架在标准基准和我们新定义的RoadAnomaly数据集的挑战性子集上始终优于最先进的方法,为复杂驾驶环境中的OOD语义分割提供了一个鲁棒且可解释的解决方案。

🔬 方法详解

问题定义:论文旨在解决复杂道路场景下,现有OOD(Out-of-Distribution)语义分割方法在处理密集堆叠物体、远距离小物体以及大型前景物体时表现不佳的问题。这些场景的复杂性使得模型难以准确识别和分割异常物体,从而影响自动驾驶等应用的安全性和可靠性。现有方法的痛点在于缺乏对场景上下文的深入理解和推理能力。

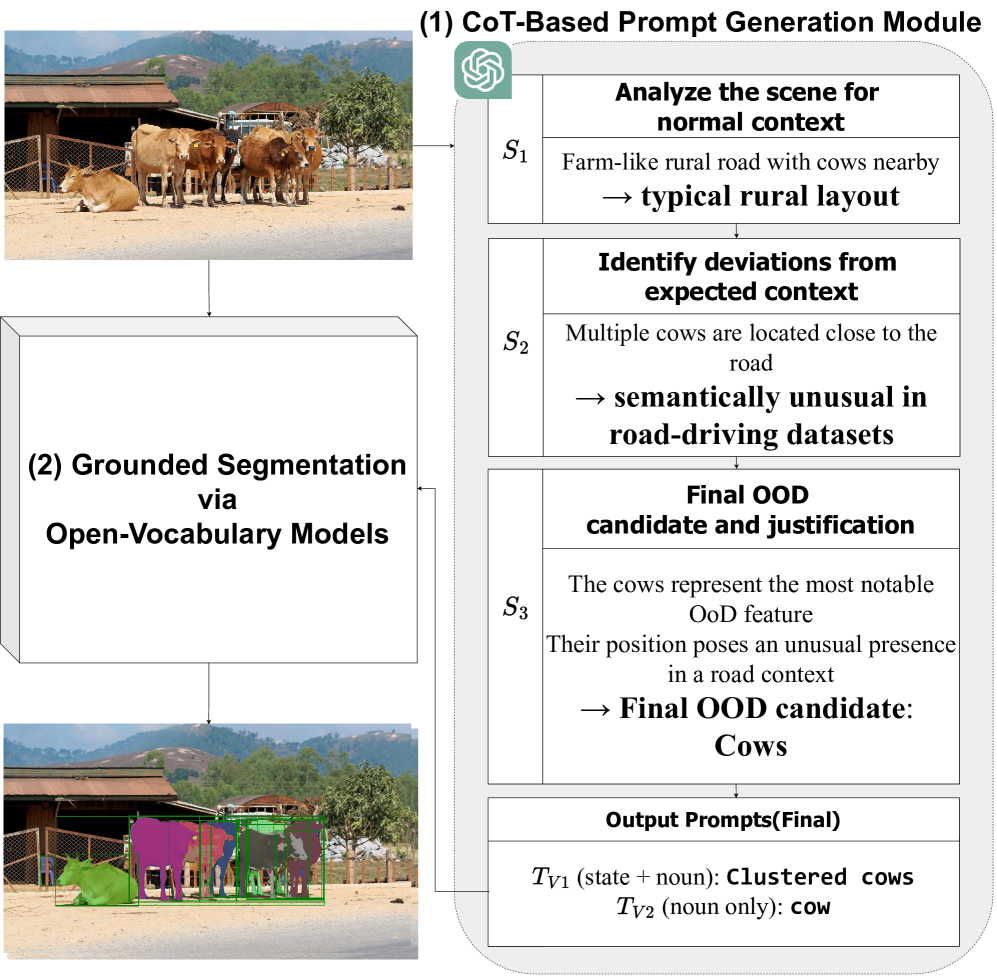

核心思路:论文的核心思路是利用大型语言模型(LLM),特别是GPT-4的思维链(Chain-of-Thought, CoT)推理能力,来增强OOD检测。通过将视觉信息与LLM的知识和推理能力相结合,模型可以更好地理解场景上下文,从而更准确地识别异常物体。这种设计旨在弥补现有方法在复杂场景理解方面的不足。

技术框架:CoT-Segmenter框架主要包含以下几个阶段:1) 图像输入:输入包含异常物体的道路场景图像。2) 特征提取:使用卷积神经网络(CNN)提取图像的视觉特征。3) CoT提示:将视觉特征作为提示输入到GPT-4等LLM中,引导LLM进行思维链推理,分析场景中的潜在异常。4) OOD检测:根据LLM的推理结果,判断图像中是否存在OOD物体,并进行分割。整体流程是将视觉信息转化为LLM可以理解的语言信息,利用LLM的推理能力辅助OOD检测。

关键创新:该论文最重要的技术创新点在于将思维链推理引入到OOD语义分割任务中。与传统的基于像素或特征的OOD检测方法不同,CoT-Segmenter利用LLM的知识和推理能力,从更高层次理解场景,从而更准确地识别异常物体。这种方法的本质区别在于它不仅仅依赖于视觉特征,还利用了LLM的语义理解能力。

关键设计:论文的关键设计包括:1) 如何有效地将视觉特征转化为LLM可以理解的提示。2) 如何设计CoT提示,引导LLM进行有效的推理。3) 如何将LLM的推理结果与分割结果相结合,实现准确的OOD分割。具体的参数设置、损失函数和网络结构等技术细节在论文中可能没有详细描述,需要进一步查阅论文原文。

🖼️ 关键图片

📊 实验亮点

CoT-Segmenter在RoadAnomaly数据集上进行了评估,并在标准基准和新定义的挑战性子集上均取得了显著的性能提升。实验结果表明,该方法能够有效应对密集遮挡、小目标和前景主导等复杂场景,优于现有的OOD分割方法。具体的性能数据和提升幅度需要在论文中查找。

🎯 应用场景

该研究成果可广泛应用于自动驾驶、智能交通、机器人导航等领域。通过提高复杂道路场景下的OOD检测能力,可以有效提升自动驾驶系统的安全性和可靠性,减少事故风险。此外,该方法还可以应用于其他需要高精度语义分割的场景,例如遥感图像分析、医学图像诊断等,具有重要的实际应用价值和广阔的发展前景。

📄 摘要(原文)

Effective Out-of-Distribution (OOD) detection is criti-cal for ensuring the reliability of semantic segmentation models, particularly in complex road environments where safety and accuracy are paramount. Despite recent advancements in large language models (LLMs), notably GPT-4, which significantly enhanced multimodal reasoning through Chain-of-Thought (CoT) prompting, the application of CoT-based visual reasoning for OOD semantic segmentation remains largely unexplored. In this paper, through extensive analyses of the road scene anomalies, we identify three challenging scenarios where current state-of-the-art OOD segmentation methods consistently struggle: (1) densely packed and overlapping objects, (2) distant scenes with small objects, and (3) large foreground-dominant objects. To address the presented challenges, we propose a novel CoT-based framework targeting OOD detection in road anomaly scenes. Our method leverages the extensive knowledge and reasoning capabilities of foundation models, such as GPT-4, to enhance OOD detection through improved image understanding and prompt-based reasoning aligned with observed problematic scene attributes. Extensive experiments show that our framework consistently outperforms state-of-the-art methods on both standard benchmarks and our newly defined challenging subset of the RoadAnomaly dataset, offering a robust and interpretable solution for OOD semantic segmentation in complex driving environments.