Dynamic Multimodal Prototype Learning in Vision-Language Models

作者: Xingyu Zhu, Shuo Wang, Beier Zhu, Miaoge Li, Yunfan Li, Junfeng Fang, Zhicai Wang, Dongsheng Wang, Hanwang Zhang

分类: cs.CV

发布日期: 2025-07-04 (更新: 2025-11-30)

备注: ICCV 2025

💡 一句话要点

提出ProtoMM,通过动态多模态原型学习提升视觉-语言模型在测试时自适应的性能。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视觉-语言模型 测试时自适应 多模态学习 原型学习 动态更新

📋 核心要点

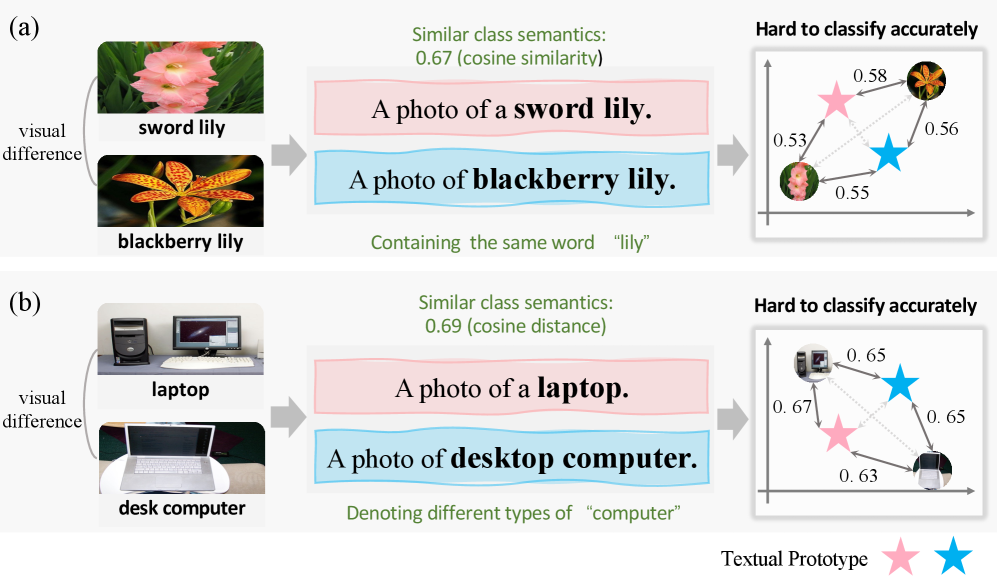

- 现有测试时自适应方法主要依赖文本模态原型,忽略了类名语义模糊性,导致原型无法充分捕捉视觉概念。

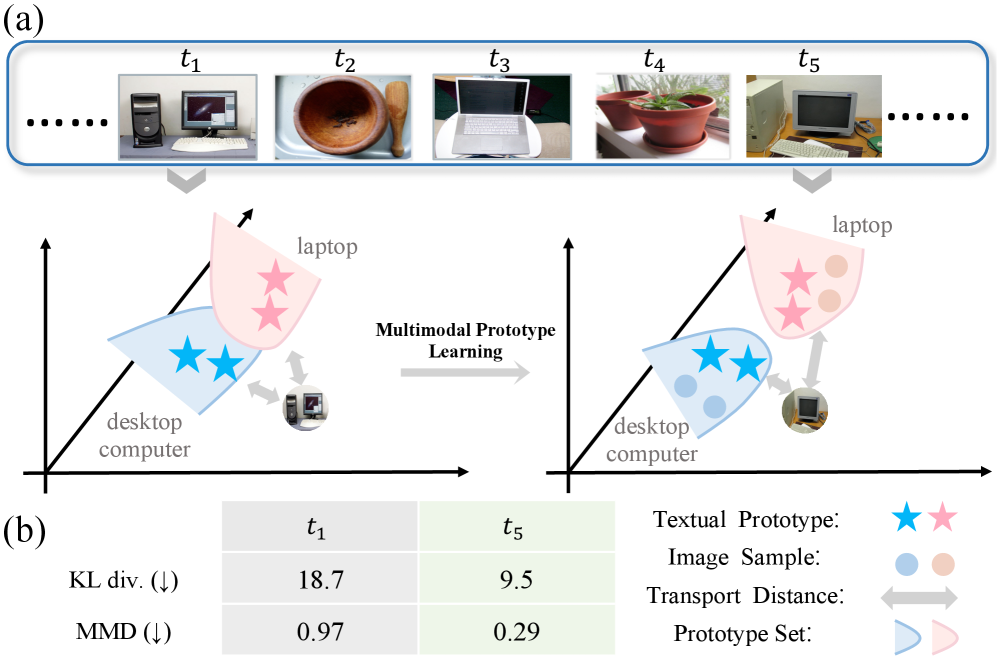

- ProtoMM构建多模态原型,将原型视为文本描述和视觉粒子的离散分布,动态更新视觉粒子以适应测试数据流。

- 实验结果表明,ProtoMM在多个零样本基准测试中优于现有方法,在ImageNet及其变体上平均提升1.03%的准确率。

📝 摘要(中文)

随着预训练视觉-语言模型(VLMs),例如CLIP,受到越来越多的关注,大量的研究致力于许多下游任务,尤其是在测试时自适应(TTA)方面。然而,先前的工作主要集中在仅在文本模态中学习原型,而忽略了类名中存在的模糊语义。这些模糊性导致文本原型不足以捕捉视觉概念,从而限制了性能。为了解决这个问题,我们引入了ProtoMM,一个无需训练的框架,它构建多模态原型以在测试时自适应VLMs。通过将原型视为文本描述和视觉粒子上的离散分布,ProtoMM能够组合多模态特征以进行全面的原型学习。更重要的是,视觉粒子随着测试流的流动而动态更新。这使得我们的多模态原型能够不断地从数据中学习,从而增强了它们在未见场景中的泛化能力。此外,我们通过将原型和测试图像的语义距离表示为一个最优传输问题来量化它们的重要性。在15个零样本基准上的大量实验证明了我们方法的有效性,在ImageNet及其变体数据集上实现了比最先进方法平均1.03%的准确率提升。

🔬 方法详解

问题定义:现有视觉-语言模型在测试时自适应(TTA)任务中,主要依赖于文本模态的原型学习。然而,类名本身可能存在语义模糊性,导致仅基于文本的原型无法准确捕捉视觉概念,限制了模型在未见场景下的泛化能力。现有方法缺乏对视觉信息的有效利用和动态调整机制,难以适应不断变化的测试数据流。

核心思路:ProtoMM的核心思路是构建多模态原型,融合文本和视觉信息,以更全面地表示类别概念。通过将原型视为文本描述和视觉粒子的离散分布,模型能够利用两种模态的互补信息。更重要的是,ProtoMM引入了动态更新机制,使视觉粒子能够随着测试数据流的流动而不断学习和调整,从而适应新的场景。

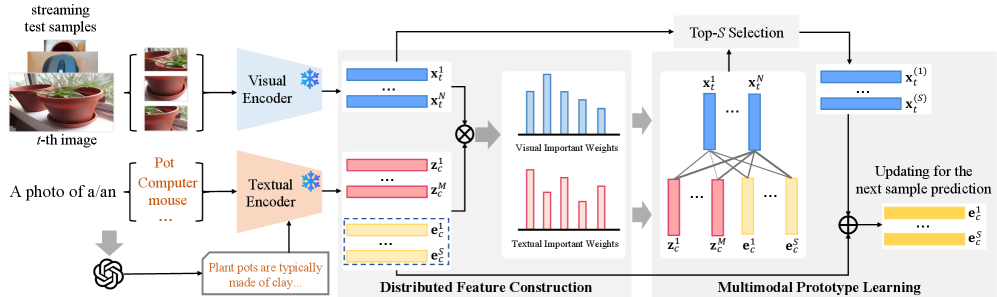

技术框架:ProtoMM是一个无需训练的测试时自适应框架,其主要流程如下:1) 初始化:使用预训练的视觉-语言模型(如CLIP)提取文本特征和视觉特征。2) 构建多模态原型:将每个类别的原型表示为文本描述和视觉粒子的组合。3) 动态更新视觉粒子:随着测试数据的输入,视觉粒子不断更新,以适应新的数据分布。4) 分类:通过计算测试图像与多模态原型之间的距离来进行分类。5) 最优传输:使用最优传输问题来量化原型和测试图像的重要性。

关键创新:ProtoMM的关键创新在于以下几点:1) 多模态原型学习:融合文本和视觉信息,更全面地表示类别概念。2) 动态更新机制:视觉粒子能够随着测试数据流的流动而不断学习和调整。3) 最优传输:使用最优传输问题来量化原型和测试图像的重要性。与现有方法相比,ProtoMM能够更好地利用视觉信息,并适应不断变化的测试数据流。

关键设计:ProtoMM的关键设计包括:1) 原型表示:将原型表示为文本描述和视觉粒子的离散分布。2) 视觉粒子更新:使用动量更新策略来更新视觉粒子。3) 距离度量:使用余弦相似度来计算测试图像与多模态原型之间的距离。4) 最优传输:使用Sinkhorn算法来解决最优传输问题。

🖼️ 关键图片

📊 实验亮点

ProtoMM在15个零样本基准测试中取得了显著的性能提升。在ImageNet及其变体数据集上,ProtoMM的平均准确率比最先进方法提高了1.03%。实验结果表明,ProtoMM能够有效利用多模态信息,并动态适应测试数据,从而提高视觉-语言模型的性能。

🎯 应用场景

ProtoMM具有广泛的应用前景,例如图像分类、目标检测、图像检索等。该方法可以应用于自动驾驶、医疗诊断、智能安防等领域,提高视觉-语言模型在实际应用中的性能和鲁棒性。通过动态适应测试数据,ProtoMM能够有效应对数据分布变化带来的挑战,提升模型的泛化能力。

📄 摘要(原文)

With the increasing attention to pre-trained vision-language models (VLMs), \eg, CLIP, substantial efforts have been devoted to many downstream tasks, especially in test-time adaptation (TTA). However, previous works focus on learning prototypes only in the textual modality while overlooking the ambiguous semantics in class names. These ambiguities lead to textual prototypes that are insufficient to capture visual concepts, resulting in limited performance. To address this issue, we introduce \textbf{ProtoMM}, a training-free framework that constructs multimodal prototypes to adapt VLMs during the test time. By viewing the prototype as a discrete distribution over the textual descriptions and visual particles, ProtoMM has the ability to combine the multimodal features for comprehensive prototype learning. More importantly, the visual particles are dynamically updated as the testing stream flows. This allows our multimodal prototypes to continually learn from the data, enhancing their generalizability in unseen scenarios. In addition, we quantify the importance of the prototypes and test images by formulating their semantic distance as an optimal transport problem. Extensive experiments on 15 zero-shot benchmarks demonstrate the effectiveness of our method, achieving a 1.03\% average accuracy improvement over state-of-the-art methods on ImageNet and its variant datasets.