Investigating Redundancy in Multimodal Large Language Models with Multiple Vision Encoders

作者: Yizhou Wang, Song Mao, Yang Chen, Yufan Shen, Yinqiao Yan, Pinlong Cai, Ding Wang, Guohang Yan, Zhi Yu, Xuming Hu, Botian Shi

分类: cs.CV, cs.AI

发布日期: 2025-07-04 (更新: 2025-09-26)

💡 一句话要点

揭示多视觉编码器MLLM中的冗余性,提出利用率和信息差距指标进行诊断。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态大语言模型 视觉编码器 冗余分析 条件利用率 信息差距 编码器掩蔽 模型优化

📋 核心要点

- 现有MLLM倾向于集成多个视觉编码器以提升性能,但忽略了编码器之间可能存在冗余。

- 通过编码器掩蔽实验和提出的条件利用率(CUR)与信息差距(IG)指标来量化编码器冗余。

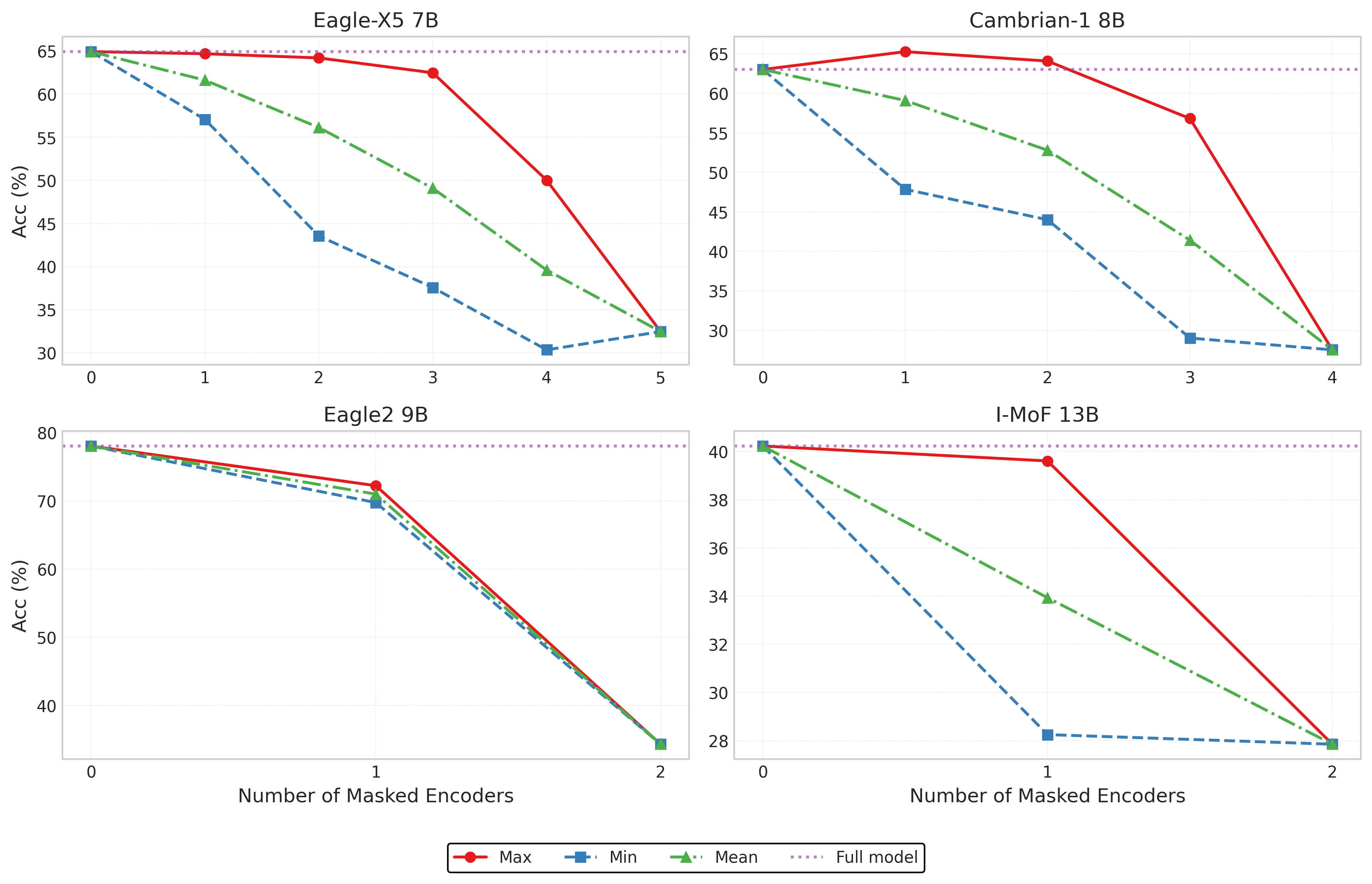

- 实验表明,特定编码器掩蔽有时能提升性能,单/双编码器变体也能恢复大部分性能,挑战了“编码器越多越好”的假设。

📝 摘要(中文)

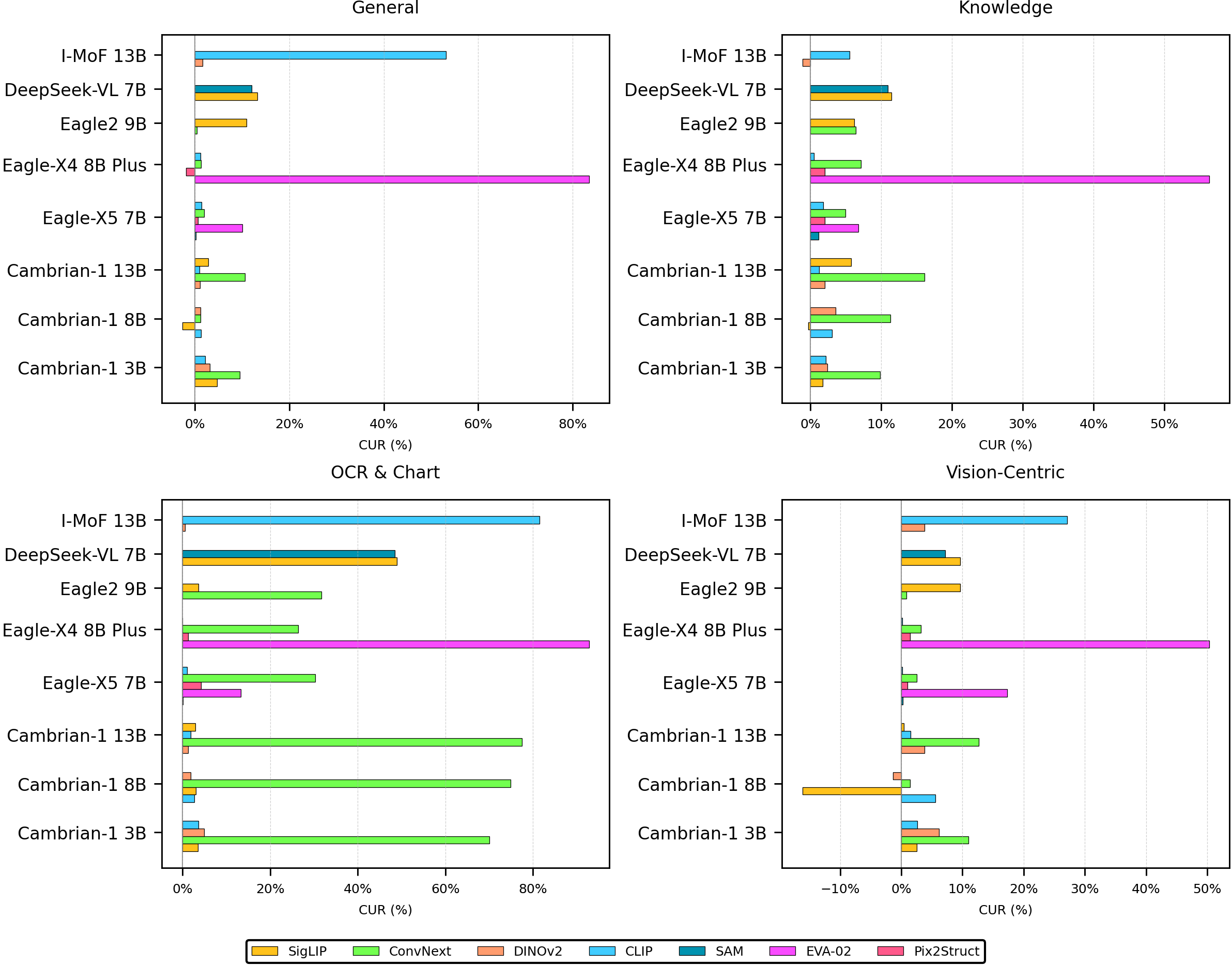

本文研究了多模态大语言模型(MLLM)中多个视觉编码器的冗余问题。尽管集成多个视觉编码器旨在通过不同的预训练目标获取互补的视觉信号,但实验表明这种假设在实践中常常失效。通过对多个代表性多编码器MLLM进行系统性的编码器掩蔽,发现性能通常会平缓下降,甚至在某些情况下有所提升,揭示了普遍存在的编码器冗余。为了量化这种效应,本文提出了两个原则性指标:条件利用率(CUR)和信息差距(IG)。利用这些工具,观察到(i)在OCR和图表等任务上存在很强的专业化,单个编码器的CUR可以超过90%;(ii)在通用VQA和基于知识的任务上存在高度冗余,编码器在很大程度上可以互换;(iii)存在具有负CUR的有害编码器。值得注意的是,掩蔽特定的编码器可以使特定任务类别的准确率提高高达16%,并使整体性能提高3.6%。此外,单编码器和双编码器变体在大多数非OCR任务上恢复了超过90%的基线性能。这项分析挑战了MLLM中“编码器越多越好”的启发式方法,并为开发更高效和有效多模态架构提供了可操作的诊断方法。

🔬 方法详解

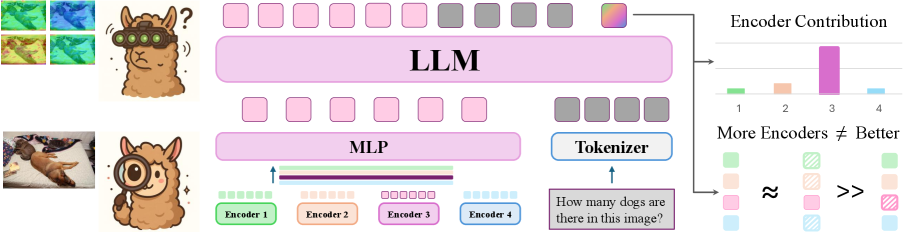

问题定义:论文旨在解决多模态大语言模型(MLLM)中多个视觉编码器之间存在的冗余问题。现有方法盲目地堆叠多个视觉编码器,期望通过不同的预训练目标获得互补的视觉信号,但忽略了编码器之间可能存在信息重叠,导致计算资源的浪费和性能的潜在下降。因此,如何有效评估和利用多编码器MLLM中的信息冗余是本文要解决的关键问题。

核心思路:论文的核心思路是通过系统性的编码器掩蔽实验,分析不同编码器对MLLM性能的贡献,从而揭示编码器之间的冗余程度。同时,论文提出了两个量化指标:条件利用率(CUR)和信息差距(IG),用于更精确地评估每个编码器的边际贡献和编码器之间的异质性。通过这些分析,可以识别出冗余甚至有害的编码器,从而指导更高效的多模态架构设计。

技术框架:论文的技术框架主要包括以下几个步骤:1) 选择代表性的多编码器MLLM模型作为研究对象。2) 设计编码器掩蔽实验,通过屏蔽不同的编码器组合,观察模型在不同任务上的性能变化。3) 提出条件利用率(CUR)指标,用于衡量在其他编码器存在的情况下,某个编码器的边际贡献。CUR定义为在移除该编码器后,模型性能下降的程度。4) 提出信息差距(IG)指标,用于衡量模型中不同编码器之间的效用异质性。IG越大,表示编码器之间的贡献差异越大。5) 通过实验分析,验证CUR和IG指标的有效性,并基于分析结果提出优化多模态架构的建议。

关键创新:论文最重要的技术创新点在于提出了条件利用率(CUR)和信息差距(IG)这两个指标,用于量化多编码器MLLM中的冗余性。与现有方法不同,这两个指标不仅考虑了单个编码器的性能,还考虑了编码器之间的相互作用,能够更准确地评估每个编码器的实际贡献。此外,通过编码器掩蔽实验,论文揭示了多编码器MLLM中普遍存在的冗余现象,挑战了“编码器越多越好”的传统观念。

关键设计:条件利用率(CUR)的计算公式为:CUR(encoder_i) = (Performance_full - Performance_masked_i) / Performance_full。其中,Performance_full表示使用所有编码器时的模型性能,Performance_masked_i表示移除第i个编码器后的模型性能。信息差距(IG)的计算方式未知,需要在论文中查找具体公式。编码器掩蔽实验中,采用了不同的编码器组合进行屏蔽,以全面评估每个编码器的贡献。具体屏蔽策略和实验设置需要在论文中查找。

🖼️ 关键图片

📊 实验亮点

实验结果表明,在特定任务(如OCR和图表)上,单个编码器的条件利用率(CUR)可以超过90%,表明存在很强的专业化。在通用VQA和知识型任务上,编码器之间存在高度冗余。值得注意的是,掩蔽特定编码器可以使特定任务类别的准确率提高高达16%,并使整体性能提高3.6%。单编码器和双编码器变体在大多数非OCR任务上恢复了超过90%的基线性能。

🎯 应用场景

该研究成果可应用于多模态大语言模型的优化设计,通过识别和移除冗余的视觉编码器,降低计算成本,提升模型效率。此外,该研究提出的分析方法和指标可用于评估不同多模态架构的优劣,指导更高效的多模态融合策略的开发。未来,可以进一步探索如何根据任务需求动态选择合适的编码器组合,实现自适应的多模态信息融合。

📄 摘要(原文)

Recent multimodal large language models (MLLMs) increasingly integrate multiple vision encoders to improve performance on various benchmarks, assuming that diverse pretraining objectives yield complementary visual signals. However, we show this assumption often fails in practice. Through systematic encoder masking across representative multi encoder MLLMs, we find that performance typically degrades gracefully and sometimes even improves when selected encoders are masked, revealing pervasive encoder redundancy. To quantify this effect, we introduce two principled metrics: the Conditional Utilization Rate (CUR), which measures an encoders marginal contribution in the presence of others, and the Information Gap (IG), which captures heterogeneity in encoder utility within a model. Using these tools, we observe (i) strong specialization on tasks like OCR and Chart, where a single encoder can dominate with a CUR greater than 90%, (ii) high redundancy on general VQA and knowledge-based tasks, where encoders are largely interchangeable, (iii) instances of detrimental encoders with negative CUR. Notably, masking specific encoders can yield up to 16% higher accuracy on a specific task category and 3.6% overall performance boost compared to the full model.Furthermore, single and dual encoder variants recover over 90% of baseline on most non OCR tasks. Our analysis challenges the more encoders are better heuristic in MLLMs and provides actionable diagnostics for developing more efficient and effective multimodal architectures.