LiteReality: Graphics-Ready 3D Scene Reconstruction from RGB-D Scans

作者: Zhening Huang, Xiaoyang Wu, Fangcheng Zhong, Hengshuang Zhao, Matthias Nießner, Joan Lasenby

分类: cs.CV, cs.AI, cs.GR

发布日期: 2025-07-03

备注: Project Page: https://litereality.github.io; Video: https://www.youtube.com/watch?v=ecK9m3LXg2c&feature=youtu.be

💡 一句话要点

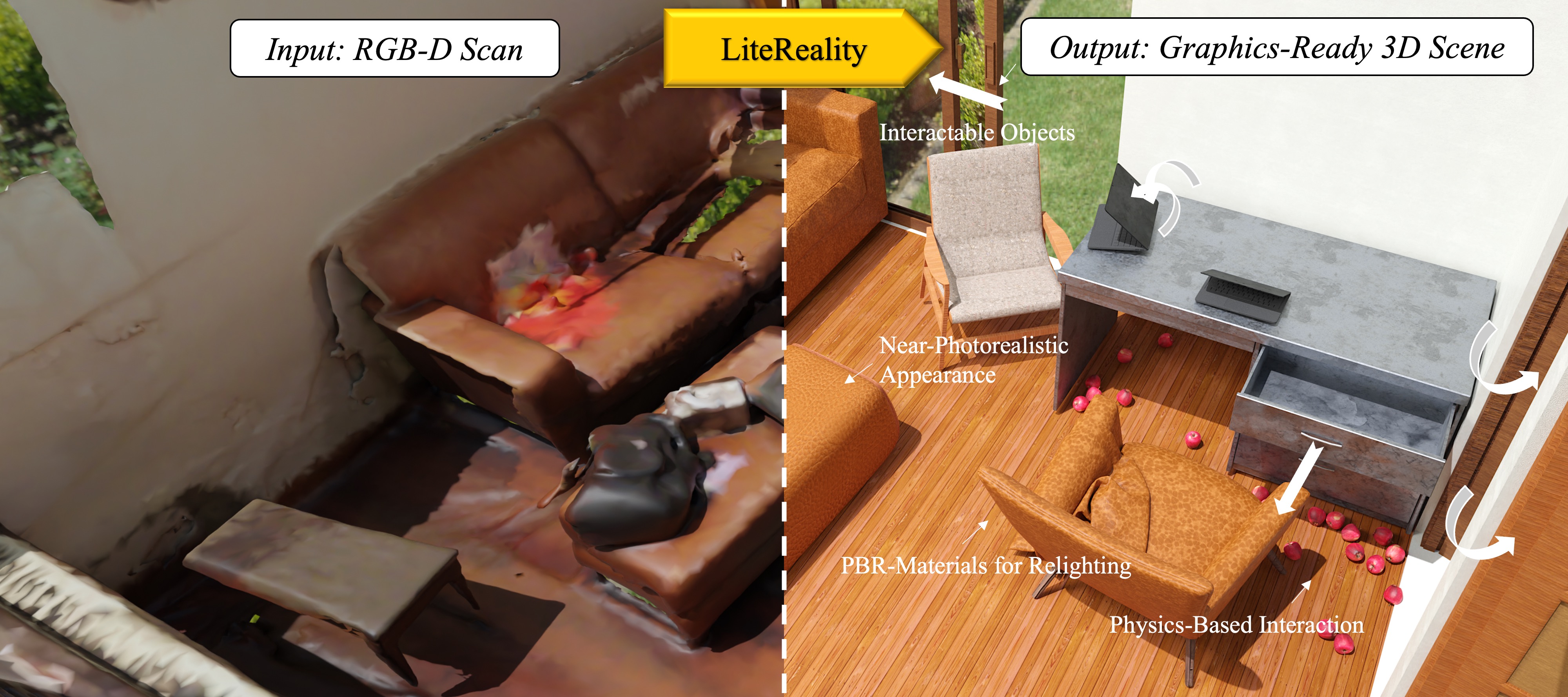

LiteReality:从RGB-D扫描重建可用于图形渲染的交互式3D场景

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 3D场景重建 RGB-D扫描 场景理解 模型检索 材质绘制 物理模拟 图形渲染

📋 核心要点

- 现有方法难以从RGB-D扫描中重建具有图形渲染能力(如对象独立性、物理材质)的交互式3D场景。

- LiteReality通过场景理解、模型检索、材质绘制和物理集成,将RGB-D扫描转换为紧凑、逼真且可交互的3D场景。

- LiteReality在Scan2CAD上实现了SOTA的对象检索性能,并提出了鲁棒的材质绘制模块,可处理未对齐、遮挡和光照不良等问题。

📝 摘要(中文)

我们提出了LiteReality,一种新颖的流程,可以将室内环境的RGB-D扫描转换为紧凑、逼真且可交互的3D虚拟副本。LiteReality不仅重建了视觉上与现实相似的场景,还支持图形管线所需的关键特性,例如对象独立性、可动性、高质量的基于物理的渲染材质以及基于物理的交互。LiteReality首先执行场景理解,并在结构化场景图的帮助下将结果解析为连贯的3D布局和对象。然后,它通过从精选的资产数据库中检索视觉上最相似的3D艺术家制作的模型来重建场景。接下来,材质绘制模块通过恢复高质量、空间变化的材质来增强真实感。最后,重建的场景被集成到具有基本物理属性的模拟引擎中,以实现交互行为。最终的场景紧凑、可编辑,并且完全兼容标准图形管线,使其适用于AR/VR、游戏、机器人和数字孪生等应用。此外,LiteReality还引入了一个无需训练的对象检索模块,该模块在Scan2CAD基准测试中实现了最先进的相似性性能,以及一个强大的材质绘制模块,能够将任何风格的图像外观转移到3D资产,即使在严重的未对齐、遮挡和光照不良的情况下也是如此。我们通过真实扫描和公共数据集证明了LiteReality的有效性。

🔬 方法详解

问题定义:现有方法在从RGB-D扫描重建3D场景时,难以兼顾场景的真实感、可交互性以及与标准图形管线的兼容性。尤其是在对象独立性、物理材质和物理交互等方面存在不足,限制了其在AR/VR、游戏和机器人等领域的应用。

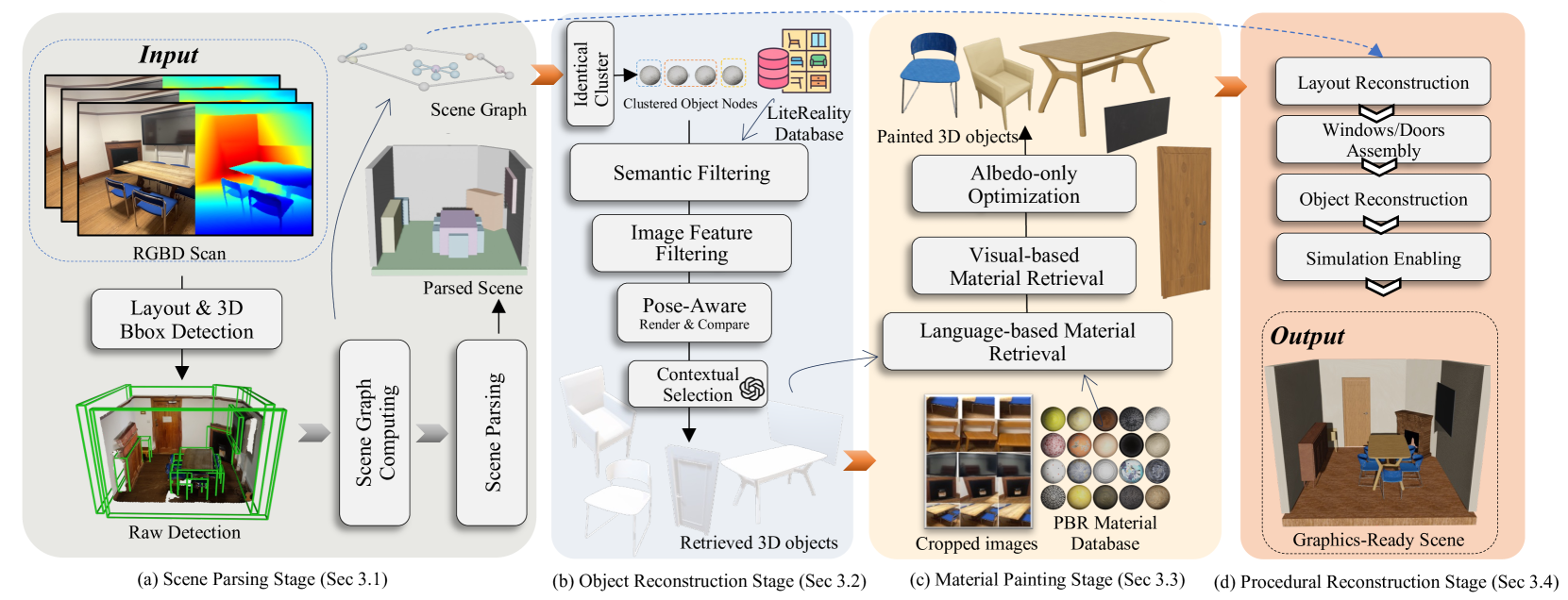

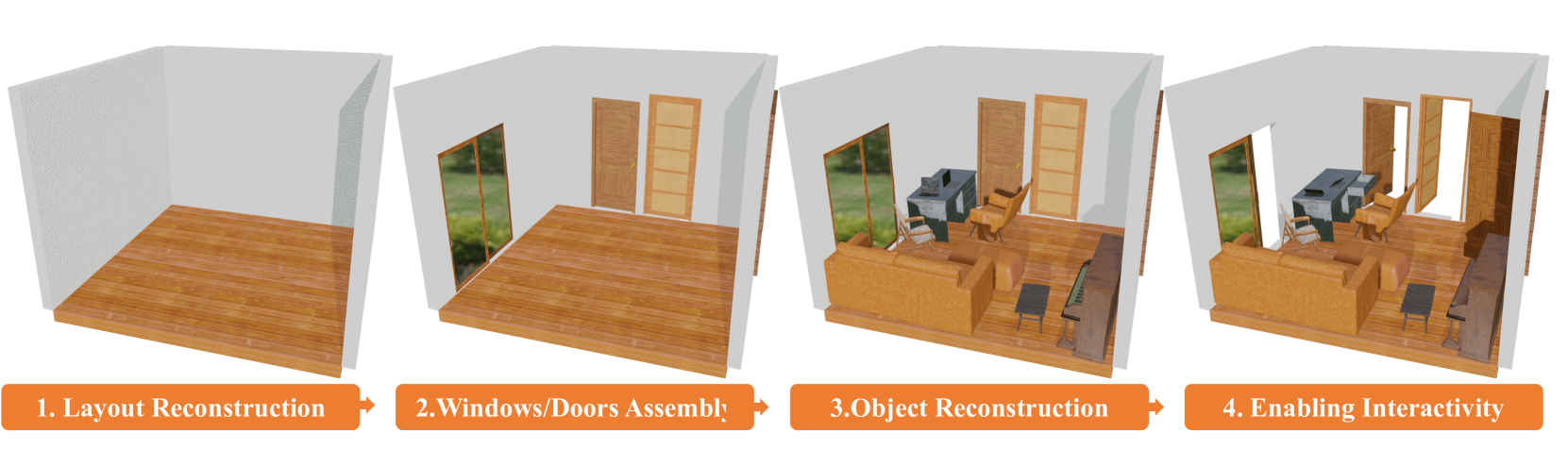

核心思路:LiteReality的核心思路是将场景重建问题分解为场景理解、模型检索、材质绘制和物理集成四个阶段。通过场景理解获得场景的结构化表示,然后从预定义的资产库中检索相似的3D模型进行组装,再利用材质绘制模块增强真实感,最后集成物理属性以实现交互。这种方法能够有效地利用现有的3D模型资源,并提高重建场景的质量和效率。

技术框架:LiteReality的整体框架包括以下几个主要模块:1) 场景理解:利用场景图对RGB-D扫描进行解析,得到场景的结构化表示。2) 模型检索:从预定义的3D模型资产库中检索与场景中的对象最相似的模型。3) 材质绘制:将图像中的材质信息转移到检索到的3D模型上,增强场景的真实感。4) 物理集成:将重建的场景集成到物理引擎中,赋予其基本的物理属性,实现交互。

关键创新:LiteReality的关键创新在于:1) 提出了一个无需训练的对象检索模块,在Scan2CAD基准测试中取得了领先的性能。2) 提出了一个鲁棒的材质绘制模块,能够处理严重的未对齐、遮挡和光照不良等问题,将图像中的材质信息转移到3D模型上。

关键设计:在对象检索模块中,使用了深度特征和几何特征来计算模型之间的相似度。在材质绘制模块中,设计了一种基于图像对齐和纹理合成的方法,将图像中的材质信息无缝地转移到3D模型上。具体的损失函数和网络结构等细节在论文中有详细描述(未知)。

🖼️ 关键图片

📊 实验亮点

LiteReality在Scan2CAD基准测试中,对象检索模块取得了state-of-the-art的相似性性能,超过了现有方法。此外,材质绘制模块能够有效地将图像中的材质信息转移到3D模型上,即使在严重的未对齐、遮挡和光照不良的情况下也能保持较好的效果。具体的性能提升数据在论文中有详细描述(未知)。

🎯 应用场景

LiteReality重建的3D场景紧凑、可编辑且与标准图形管线兼容,因此适用于AR/VR、游戏、机器人和数字孪生等领域。例如,可以用于创建逼真的虚拟环境,训练机器人在虚拟环境中执行任务,或者构建数字孪生模型用于远程监控和控制。

📄 摘要(原文)

We propose LiteReality, a novel pipeline that converts RGB-D scans of indoor environments into compact, realistic, and interactive 3D virtual replicas. LiteReality not only reconstructs scenes that visually resemble reality but also supports key features essential for graphics pipelines -- such as object individuality, articulation, high-quality physically based rendering materials, and physically based interaction. At its core, LiteReality first performs scene understanding and parses the results into a coherent 3D layout and objects with the help of a structured scene graph. It then reconstructs the scene by retrieving the most visually similar 3D artist-crafted models from a curated asset database. Next, the Material Painting module enhances realism by recovering high-quality, spatially varying materials. Finally, the reconstructed scene is integrated into a simulation engine with basic physical properties to enable interactive behavior. The resulting scenes are compact, editable, and fully compatible with standard graphics pipelines, making them suitable for applications in AR/VR, gaming, robotics, and digital twins. In addition, LiteReality introduces a training-free object retrieval module that achieves state-of-the-art similarity performance on the Scan2CAD benchmark, along with a robust material painting module capable of transferring appearances from images of any style to 3D assets -- even under severe misalignment, occlusion, and poor lighting. We demonstrate the effectiveness of LiteReality on both real-life scans and public datasets. Project page: https://litereality.github.io; Video: https://www.youtube.com/watch?v=ecK9m3LXg2c