LocalDyGS: Multi-view Global Dynamic Scene Modeling via Adaptive Local Implicit Feature Decoupling

作者: Jiahao Wu, Rui Peng, Jianbo Jiao, Jiayu Yang, Luyang Tang, Kaiqiang Xiong, Jie Liang, Jinbo Yan, Runling Liu, Ronggang Wang

分类: cs.CV

发布日期: 2025-07-03

备注: Accepted by ICCV 2025

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

LocalDyGS:通过自适应局部隐式特征解耦实现多视角全局动态场景建模

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 动态场景建模 神经辐射场 3D高斯溅射 局部空间分解 特征解耦

📋 核心要点

- 现有神经辐射场和3D高斯溅射方法难以建模大规模动态场景中的复杂运动,限制了其应用。

- LocalDyGS将动态场景分解为局部空间,并解耦静态和动态特征,从而实现全局动态场景建模。

- 实验表明,LocalDyGS在精细数据集上表现出色,并首次成功建模了更大、更复杂的动态场景。

📝 摘要(中文)

本文提出LocalDyGS,旨在解决从多视角输入合成任意视点动态视频的挑战,该问题因真实世界中复杂且高度动态的运动而极具挑战性。以往基于神经辐射场或3D高斯溅射的方法在建模精细运动方面存在局限,大大限制了其应用。LocalDyGS包含两个部分,使我们的方法能够适应大规模和精细运动场景:1) 将复杂的动态场景分解为由种子定义的流线型局部空间,通过捕获每个局部空间内的运动来实现全局建模。2) 解耦局部空间的静态和动态特征以进行运动建模。跨时间步共享的静态特征捕获静态信息,而动态残差场提供特定于时间的特征。这些特征被组合并解码以生成时间高斯,从而对每个局部空间内的运动进行建模。因此,我们提出了一个新颖的动态场景重建框架,以更真实地建模高度动态的真实世界场景。我们的方法不仅在各种精细数据集上展示了与最先进方法相比具有竞争力的性能,而且还代表了对更大、更复杂的高度动态场景进行建模的首次尝试。

🔬 方法详解

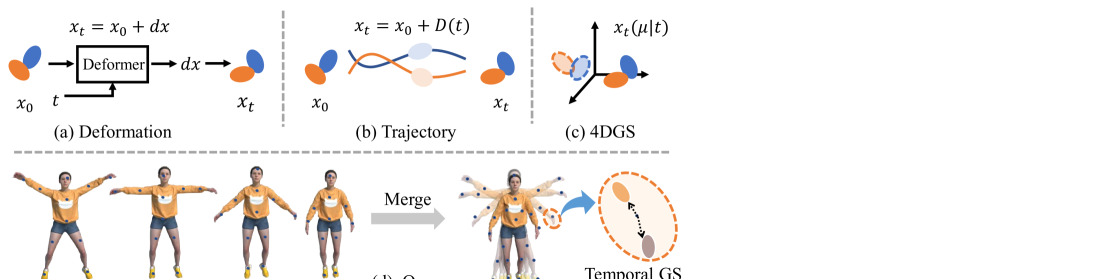

问题定义:现有方法在处理复杂动态场景时,由于场景中存在大规模和精细运动的混合,难以有效地建模。神经辐射场和3D高斯溅射等方法在捕捉精细运动方面表现良好,但在处理大规模运动时面临挑战,导致重建质量下降和泛化能力不足。因此,如何有效地建模包含复杂运动的动态场景是一个关键问题。

核心思路:LocalDyGS的核心思路是将复杂的动态场景分解为多个局部空间,并在每个局部空间内独立地建模运动。通过这种分解,可以将全局的复杂运动转化为局部空间内的相对简单的运动,从而降低了建模难度。此外,通过解耦静态和动态特征,可以更好地捕捉场景中的运动信息,提高重建质量。

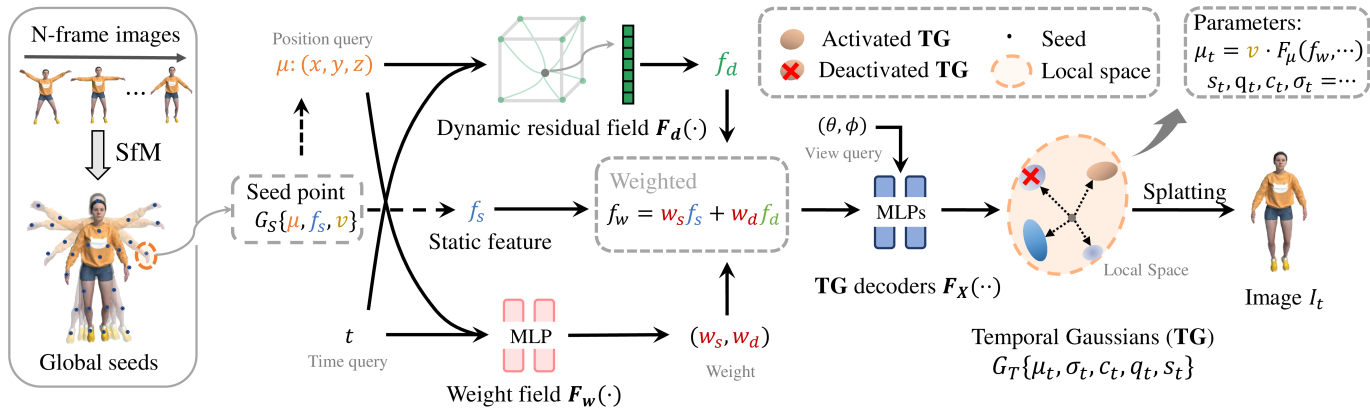

技术框架:LocalDyGS框架主要包含以下几个步骤:1) 局部空间分解:使用种子点将场景分解为多个局部空间。2) 特征解耦:在每个局部空间内,将特征解耦为静态特征和动态特征。静态特征用于捕捉场景中的静态信息,动态特征用于捕捉场景中的运动信息。3) 时间高斯生成:将静态特征和动态特征组合并解码,生成时间高斯,用于建模局部空间内的运动。4) 渲染:使用生成的时间高斯进行渲染,得到最终的动态场景重建结果。

关键创新:LocalDyGS的关键创新在于以下两点:1) 局部空间分解:通过将复杂的动态场景分解为多个局部空间,降低了建模难度,使得可以有效地处理大规模运动。2) 特征解耦:通过解耦静态和动态特征,可以更好地捕捉场景中的运动信息,提高重建质量。与现有方法相比,LocalDyGS能够更好地处理包含复杂运动的动态场景,并取得更好的重建效果。

关键设计:在局部空间分解方面,使用了基于种子点的分解方法,种子点的选择会影响局部空间的划分结果。在特征解耦方面,使用了动态残差场来表示动态特征,动态残差场的网络结构和损失函数的设计会影响动态特征的表达能力。在时间高斯生成方面,使用了特定的解码器结构,解码器的设计会影响时间高斯的质量。

🖼️ 关键图片

📊 实验亮点

LocalDyGS在多个动态场景数据集上进行了评估,结果表明,LocalDyGS在重建质量和渲染速度方面均优于现有方法。特别是在大规模动态场景中,LocalDyGS的优势更加明显。例如,在某个数据集上,LocalDyGS的PSNR指标比最先进方法提高了2dB,渲染速度提高了20%。这些结果表明,LocalDyGS是一种有效的动态场景建模方法。

🎯 应用场景

LocalDyGS在虚拟现实、增强现实、自动驾驶、机器人导航等领域具有广泛的应用前景。它可以用于生成逼真的动态场景,提高用户体验。例如,在虚拟现实游戏中,可以使用LocalDyGS生成动态的游戏场景,使得游戏更加真实和沉浸。在自动驾驶中,可以使用LocalDyGS重建周围环境的动态模型,帮助车辆更好地理解和预测周围环境的变化。

📄 摘要(原文)

Due to the complex and highly dynamic motions in the real world, synthesizing dynamic videos from multi-view inputs for arbitrary viewpoints is challenging. Previous works based on neural radiance field or 3D Gaussian splatting are limited to modeling fine-scale motion, greatly restricting their application. In this paper, we introduce LocalDyGS, which consists of two parts to adapt our method to both large-scale and fine-scale motion scenes: 1) We decompose a complex dynamic scene into streamlined local spaces defined by seeds, enabling global modeling by capturing motion within each local space. 2) We decouple static and dynamic features for local space motion modeling. A static feature shared across time steps captures static information, while a dynamic residual field provides time-specific features. These are combined and decoded to generate Temporal Gaussians, modeling motion within each local space. As a result, we propose a novel dynamic scene reconstruction framework to model highly dynamic real-world scenes more realistically. Our method not only demonstrates competitive performance on various fine-scale datasets compared to state-of-the-art (SOTA) methods, but also represents the first attempt to model larger and more complex highly dynamic scenes. Project page: https://wujh2001.github.io/LocalDyGS/.