Reasoning to Edit: Hypothetical Instruction-Based Image Editing with Visual Reasoning

作者: Qingdong He, Xueqin Chen, Chaoyi Wang, Yanjie Pan, Xiaobin Hu, Zhenye Gan, Yabiao Wang, Chengjie Wang, Xiangtai Li, Jiangning Zhang

分类: cs.CV

发布日期: 2025-07-02 (更新: 2025-09-26)

💡 一句话要点

提出ReasonBrain框架与Reason50K数据集,解决基于推理的图像编辑难题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 图像编辑 指令驱动 视觉推理 多模态学习 扩散模型

📋 核心要点

- 现有基于指令的图像编辑方法难以处理需要深度推理的隐式假设指令,数据集也缺乏对推理能力的有效支持。

- ReasonBrain框架利用多模态大语言模型生成编辑指导,并结合细粒度推理线索提取模块,增强对视觉和文本语义的理解。

- ReasonBrain在Reason50K数据集上表现出色,并在传统图像编辑任务中展现出强大的零样本泛化能力。

📝 摘要(中文)

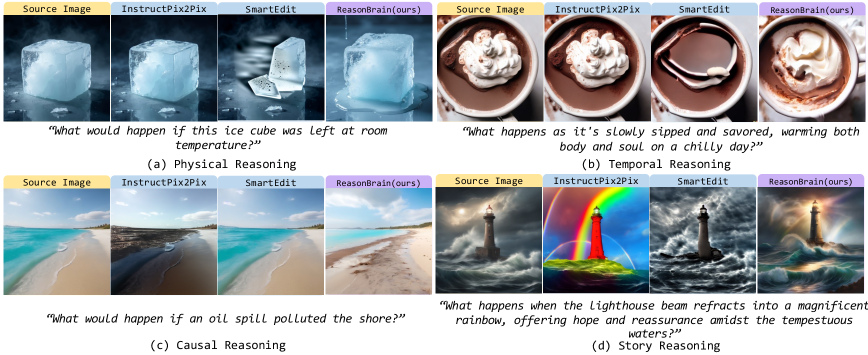

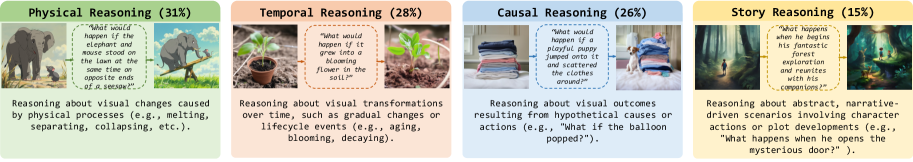

基于指令的图像编辑(IIE)随着扩散模型的成功而迅速发展。然而,现有的工作主要集中在简单和明确的指令上,以执行添加、删除、移动或交换对象等编辑操作。它们难以处理更复杂的隐式假设指令,这些指令需要更深入的推理来推断合理的视觉变化和用户意图。此外,当前的数据集对训练和评估具有推理意识的编辑能力的支持有限。在架构上,这些方法也缺乏支持这种推理的细粒度细节提取机制。为了解决这些限制,我们提出了Reason50K,这是一个大规模数据集,专门为训练和评估假设指令推理图像编辑而策划的,以及ReasonBrain,这是一个新颖的框架,旨在推理和执行跨不同场景的隐式假设指令。Reason50K包括超过50K个样本,涵盖四个关键推理场景:物理、时间、因果和故事推理。ReasonBrain利用多模态大型语言模型(MLLM)进行编辑指导生成,并利用扩散模型进行图像合成,结合细粒度推理线索提取(FRCE)模块来捕获支持指令推理所必需的详细视觉和文本语义。为了减轻语义损失,我们进一步引入了一种跨模态增强器(CME),它能够实现细粒度线索和MLLM派生特征之间的丰富交互。大量的实验表明,ReasonBrain在推理场景中始终优于最先进的基线,同时对传统的IIE任务表现出强大的零样本泛化能力。我们的数据集和代码将公开发布。

🔬 方法详解

问题定义:现有基于指令的图像编辑方法主要处理简单直接的指令,对于需要更深层次推理的隐式假设指令,例如“如果把桌子上的花瓶打碎会怎么样?”,则难以生成合理的编辑结果。现有数据集也缺乏对这种推理能力的有效训练和评估。

核心思路:论文的核心思路是利用多模态大语言模型(MLLM)的强大推理能力,结合细粒度的视觉信息提取,从而理解隐式指令背后的用户意图,并生成符合推理逻辑的编辑结果。通过构建Reason50K数据集,为模型训练和评估提供支持。

技术框架:ReasonBrain框架主要包含以下几个模块:1) 多模态大语言模型(MLLM):用于理解指令并生成编辑指导。2) 细粒度推理线索提取(FRCE)模块:用于提取图像和文本中与推理相关的细粒度语义信息。3) 跨模态增强器(CME):用于增强细粒度线索和MLLM特征之间的交互,减少语义损失。4) 扩散模型:用于根据编辑指导和增强后的特征生成最终的编辑图像。

关键创新:论文的关键创新在于:1) 提出了Reason50K数据集,填补了现有数据集在推理型图像编辑方面的空白。2) 设计了细粒度推理线索提取(FRCE)模块,能够有效提取图像和文本中的关键语义信息。3) 引入了跨模态增强器(CME),增强了视觉和文本特征之间的交互,提升了编辑效果。

关键设计:FRCE模块的具体实现细节未知,但其目标是提取图像和文本中与推理相关的细粒度语义信息,例如对象之间的关系、场景的上下文信息等。CME模块的设计目标是增强细粒度线索和MLLM特征之间的交互,具体实现方式未知,可能采用了注意力机制或其他融合策略。损失函数的设计也未知,但应该包含对生成图像质量和推理一致性的约束。

🖼️ 关键图片

📊 实验亮点

ReasonBrain在Reason50K数据集上取得了显著的性能提升,在四个推理场景(物理、时间、因果和故事推理)中均优于现有最先进的基线方法。此外,ReasonBrain在传统的基于指令的图像编辑任务中也表现出强大的零样本泛化能力,表明其具有良好的通用性和鲁棒性。具体性能数据未知,但论文强调了其在推理场景中的显著优势。

🎯 应用场景

该研究成果可应用于智能图像编辑、虚拟现实、游戏开发等领域。例如,用户可以通过输入假设性指令,快速生成各种场景下的图像变化,从而辅助设计、创作和决策。未来,该技术有望应用于更广泛的领域,例如自动驾驶、机器人导航等,提升人工智能系统的推理和决策能力。

📄 摘要(原文)

Instruction-based image editing (IIE) has advanced rapidly with the success of diffusion models. However, existing efforts primarily focus on simple and explicit instructions to execute editing operations such as adding, deleting, moving, or swapping objects. They struggle to handle more complex implicit hypothetical instructions that require deeper reasoning to infer plausible visual changes and user intent. Additionally, current datasets provide limited support for training and evaluating reasoning-aware editing capabilities. Architecturally, these methods also lack mechanisms for fine-grained detail extraction that support such reasoning. To address these limitations, we propose Reason50K, a large-scale dataset specifically curated for training and evaluating hypothetical instruction reasoning image editing, along with ReasonBrain, a novel framework designed to reason over and execute implicit hypothetical instructions across diverse scenarios. Reason50K includes over 50K samples spanning four key reasoning scenarios: Physical, Temporal, Causal, and Story reasoning. ReasonBrain leverages Multimodal Large Language Models (MLLMs) for editing guidance generation and a diffusion model for image synthesis, incorporating a Fine-grained Reasoning Cue Extraction (FRCE) module to capture detailed visual and textual semantics essential for supporting instruction reasoning. To mitigate the semantic loss, we further introduce a Cross-Modal Enhancer (CME) that enables rich interactions between the fine-grained cues and MLLM-derived features. Extensive experiments demonstrate that ReasonBrain consistently outperforms state-of-the-art baselines on reasoning scenarios while exhibiting strong zero-shot generalization to conventional IIE tasks. Our dataset and code will be released publicly.