Robust brain age estimation from structural MRI with contrastive learning

作者: Carlo Alberto Barbano, Benoit Dufumier, Edouard Duchesnay, Marco Grangetto, Pietro Gori

分类: eess.IV, cs.CV

发布日期: 2025-07-02 (更新: 2025-12-06)

备注: Update version (submitted to PRL); 8 pages

💡 一句话要点

提出对比学习以增强结构性MRI脑龄估计的鲁棒性

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 脑龄估计 对比学习 结构性MRI 神经影像 机器学习 阿尔茨海默病 认知障碍 损失函数

📋 核心要点

- 现有的脑龄估计方法主要依赖L1监督,存在泛化能力不足和对数据集偏差敏感的问题。

- 本文提出了一种基于对比学习的脑龄估计方法,利用新颖的对比损失函数$ ext{L}^{exp}$来增强模型的鲁棒性和可扩展性。

- 实验结果表明,使用对比学习的模型在多个数据集上显著降低了脑龄估计的平均绝对误差,并且在临床诊断性能上表现优异。

📝 摘要(中文)

从结构性MRI中估计脑龄已成为表征正常与病理性衰老的重要工具。本文探讨了对比学习作为一种可扩展且鲁棒的替代L1监督方法进行脑龄估计。我们引入了一种新颖的对比损失函数$ ext{L}^{exp}$,并在超过20,000个扫描的多个公共神经影像数据集上进行了评估。实验结果显示,预训练在多样化数据上的扩展显著提高了泛化性能,外部平均绝对误差(MAE)几乎减半。此外,$ ext{L}^{exp}$对与站点相关的混淆因素具有鲁棒性,随着训练规模的增加,扫描仪可预测性保持较低。对比模型可靠地捕捉到认知障碍和阿尔茨海默病患者的加速衰老,支持其作为神经影像的基础模型的潜力。

🔬 方法详解

问题定义:本文旨在解决现有脑龄估计方法在泛化能力和对数据集偏差敏感性方面的不足。传统的L1监督方法在多样化数据集上表现不佳,难以适应不同的扫描仪和数据来源。

核心思路:论文提出通过对比学习来增强脑龄估计的鲁棒性,设计了一种新颖的对比损失函数$ ext{L}^{exp}$,以提高模型在多样化数据上的表现。对比学习能够有效捕捉样本间的相似性和差异性,从而提升模型的泛化能力。

技术框架:整体架构包括数据预处理、对比学习模型的训练和评估三个主要阶段。首先,对来自不同站点的MRI数据进行标准化处理;其次,利用对比学习框架训练模型,最后通过多种指标评估模型性能。

关键创新:最重要的技术创新在于引入了对比损失函数$ ext{L}^{exp}$,该函数在处理与站点相关的混淆因素时表现出色,显著提高了模型的鲁棒性。与传统L1监督方法相比,$ ext{L}^{exp}$在保持低误差的同时,增强了模型的可解释性和适用性。

关键设计:在模型设计中,采用了多层卷积神经网络结构,并通过大规模多站点数据进行预训练。损失函数$ ext{L}^{exp}$的设计考虑了样本间的对比关系,确保了模型在不同数据集上的一致性和稳定性。

🖼️ 关键图片

📊 实验亮点

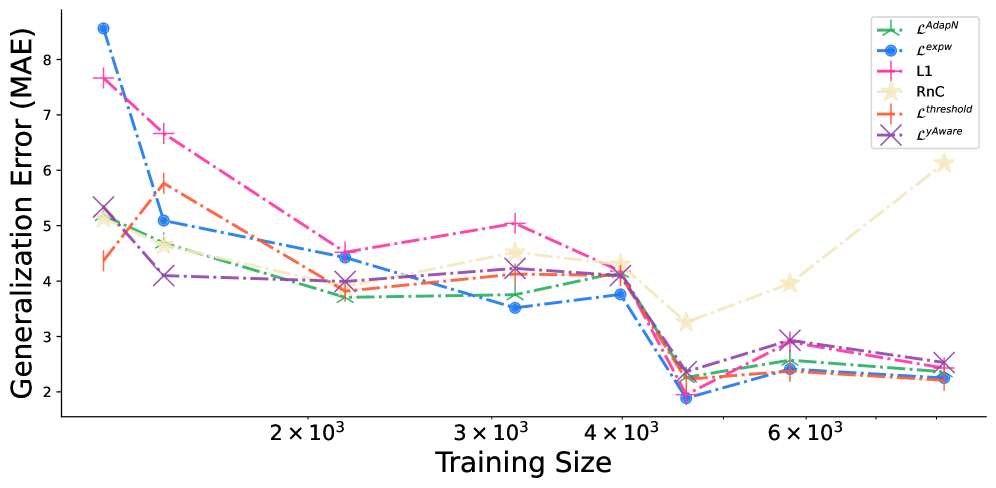

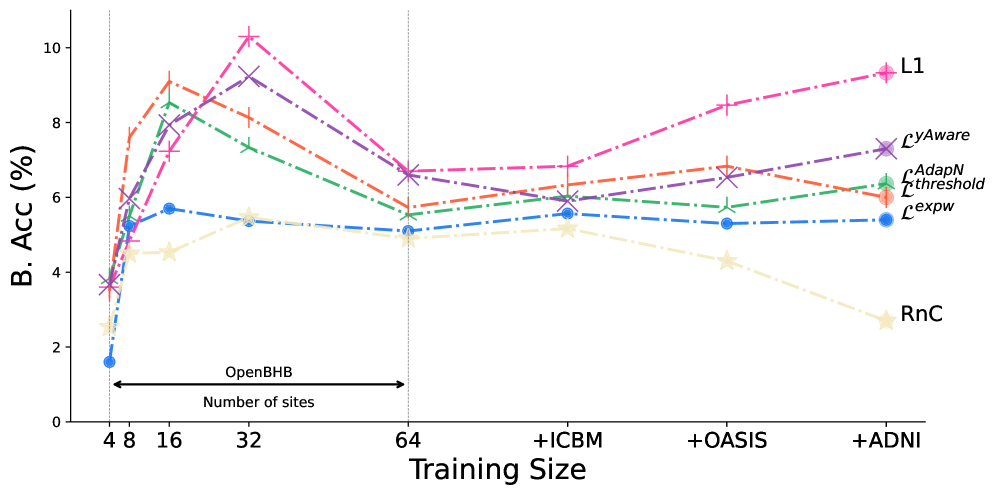

实验结果显示,采用对比学习的模型在多个公共数据集上的外部平均绝对误差(MAE)减少了近50%。此外,$ ext{L}^{exp}$在处理与站点相关的混淆因素时表现出色,保持了低扫描仪可预测性,显示出其在临床应用中的潜力。

🎯 应用场景

该研究的潜在应用领域包括临床神经影像学、老年医学和认知障碍的早期诊断。通过提供更准确的脑龄估计,能够帮助医生更好地理解患者的衰老过程及其与疾病的关系,进而制定个性化的治疗方案。未来,该方法有望在大规模临床研究中得到应用,推动脑健康管理的发展。

📄 摘要(原文)

Estimating brain age from structural MRI has emerged as a powerful tool for characterizing normative and pathological aging. In this work, we explore contrastive learning as a scalable and robust alternative to L1-supervised approaches for brain age estimation. We introduce a novel contrastive loss function, $\mathcal{L}^{exp}$, and evaluate it across multiple public neuroimaging datasets comprising over 20,000 scans. Our experiments reveal four key findings. First, scaling pre-training on diverse, multi-site data consistently improves generalization performance, cutting external mean absolute error (MAE) nearly in half. Second, $\mathcal{L}^{exp}$ is robust to site-related confounds, maintaining low scanner-predictability as training size increases. Third, contrastive models reliably capture accelerated aging in patients with cognitive impairment and Alzheimer's disease, as shown through brain age gap analysis, ROC curves, and longitudinal trends. Lastly, unlike L1-supervised baselines, $\mathcal{L}^{exp}$ maintains a strong correlation between brain age accuracy and downstream diagnostic performance, supporting its potential as a foundation model for neuroimaging. These results position contrastive learning as a promising direction for building generalizable and clinically meaningful brain representations.